Técnicas de aprendizaje

Conceptos de grandes modelos lingüísticos (LLM)

Vidhi Chugh

AI strategist and ethicist

¿Dónde estamos?

Superar las limitaciones de los datos

- Ajuste fino: entrenamiento de un modelo preentrenado para una tarea específica.

- Pero, ¿qué pasa si hay pocos datos etiquetados o ninguno?

- Aprendizaje N-shot: zero-shot, few-shot y multi-shot.

Aprendizaje por transferencia

- Aprender de una tarea y transferir lo aprendido a tareas relacionadas

- Transferencia de conocimientos del piano a la guitarra

- Leer notas musicales

- Comprender el ritmo

- Comprensión de conceptos musicales

- Aprendizaje N-shot

- Zero-shot: sin datos específicos para la tarea

- Few-shot: pocos datos específicos para la tarea

- Multi-shot: relativamente más datos de entrenamiento

Aprendizaje zero-shot

- Sin formación explícita.

- Utiliza la comprensión del lenguaje y el contexto.

- Generaliza sin ejemplos previos.

1 Freepik

Aprendizaje a partir de unos pocos ejemplos (few-shot)

- Aprende una nueva tarea con algunos ejemplos.

- Aprendizaje único: ajuste fino a partir de un solo ejemplo

- Conocimientos previos para responder a nuevas preguntas

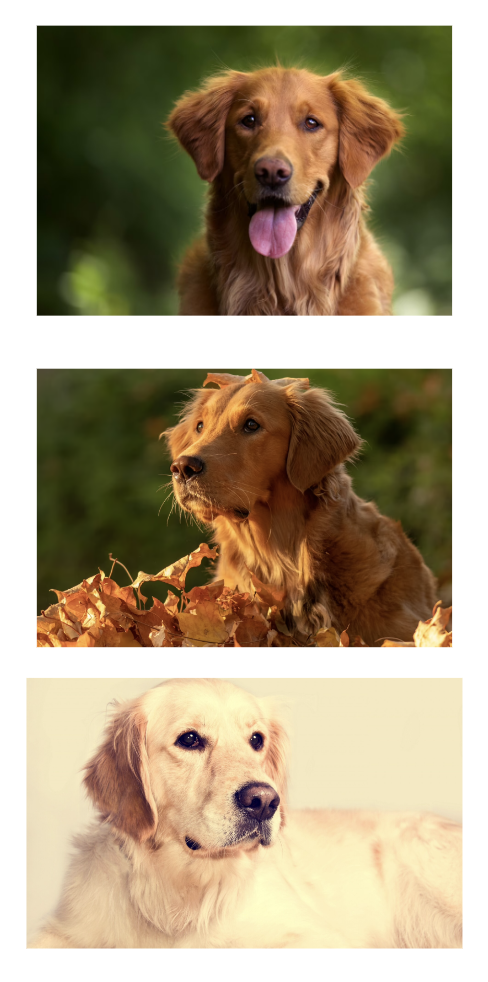

Aprendizaje multi-shot

- Requiere más ejemplos que few-shot.

- Tareas anteriores, más nuevos ejemplos

- Por ejemplo, un modelo entrenado con Golden Retriever

1 Freepik

Aprendizaje multi-shot

- Resultado del modelo: Labrador Retriever

- Ahorra tiempo en la recopilación y el etiquetado de datos.

- Sin concesiones en cuanto a precisión

1 Freepik

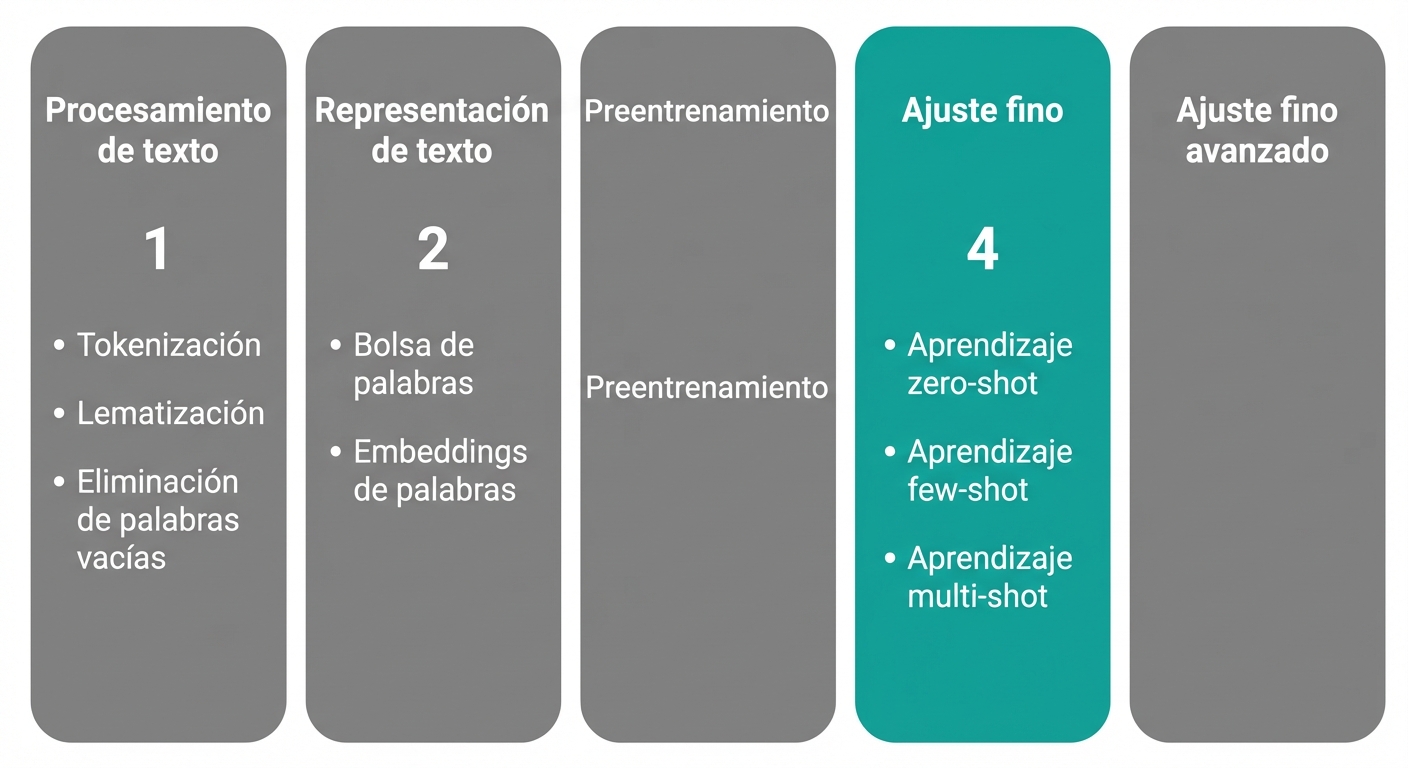

Elementos básicos hasta ahora

- Flujo de trabajo de preparación de datos

- Ajuste fino

- Técnicas de aprendizaje N-shot

- A continuación: preentrenamiento

¡Vamos a practicar!

Conceptos de grandes modelos lingüísticos (LLM)