Random Forests

Machine learning con modelos basados en árboles en Python

Elie Kawerk

Data Scientist

Bagging

Estimador base: Decision Tree, Logistic Regression, Neural Net, ...

Cada estimador se entrena en una muestra bootstrap distinta del train

Los estimadores usan todas las features para entrenar y predecir

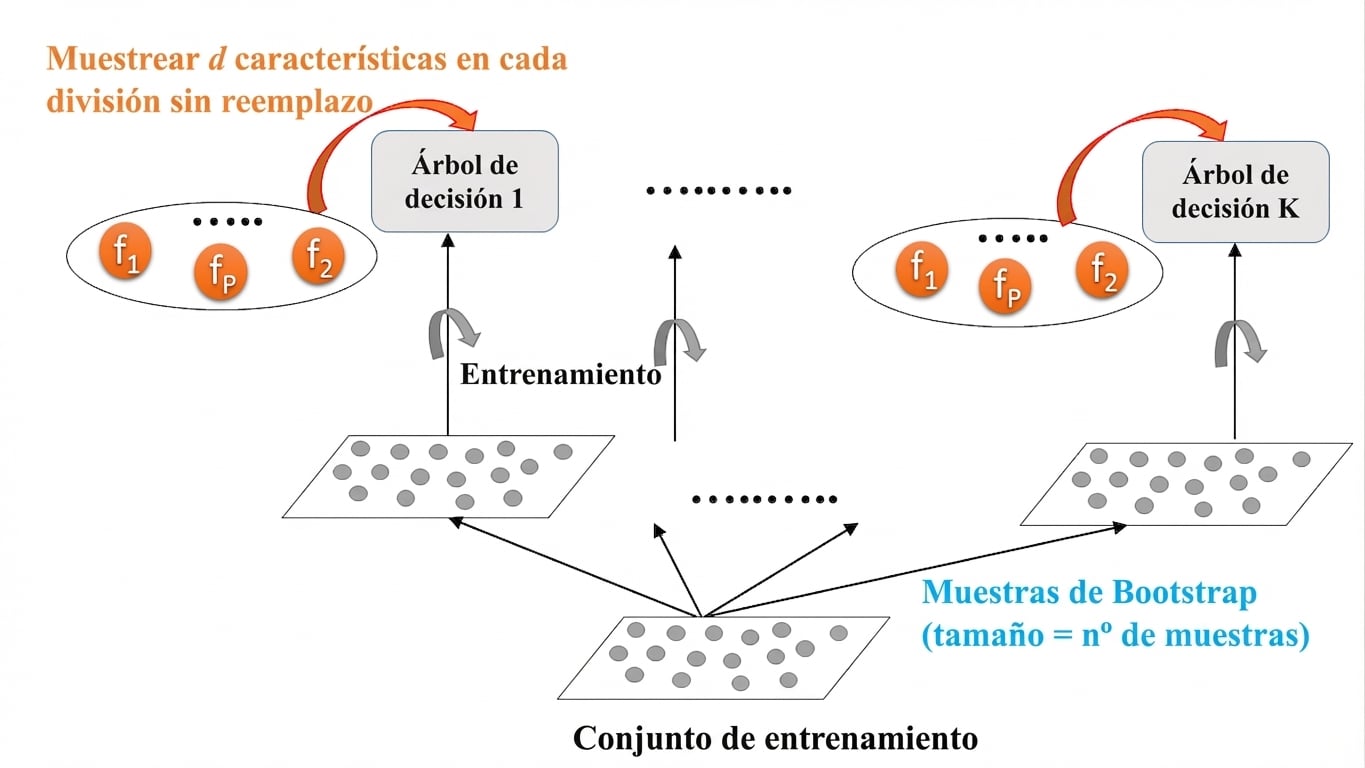

Más diversidad con Random Forests

Estimador base: Decision Tree

Cada estimador se entrena en una muestra bootstrap distinta del mismo tamaño que el train

RF añade más aleatoriedad al entrenar cada árbol

Se muestrean d features en cada nodo sin reemplazo

( d < número total de features )

Random Forests: Entrenamiento

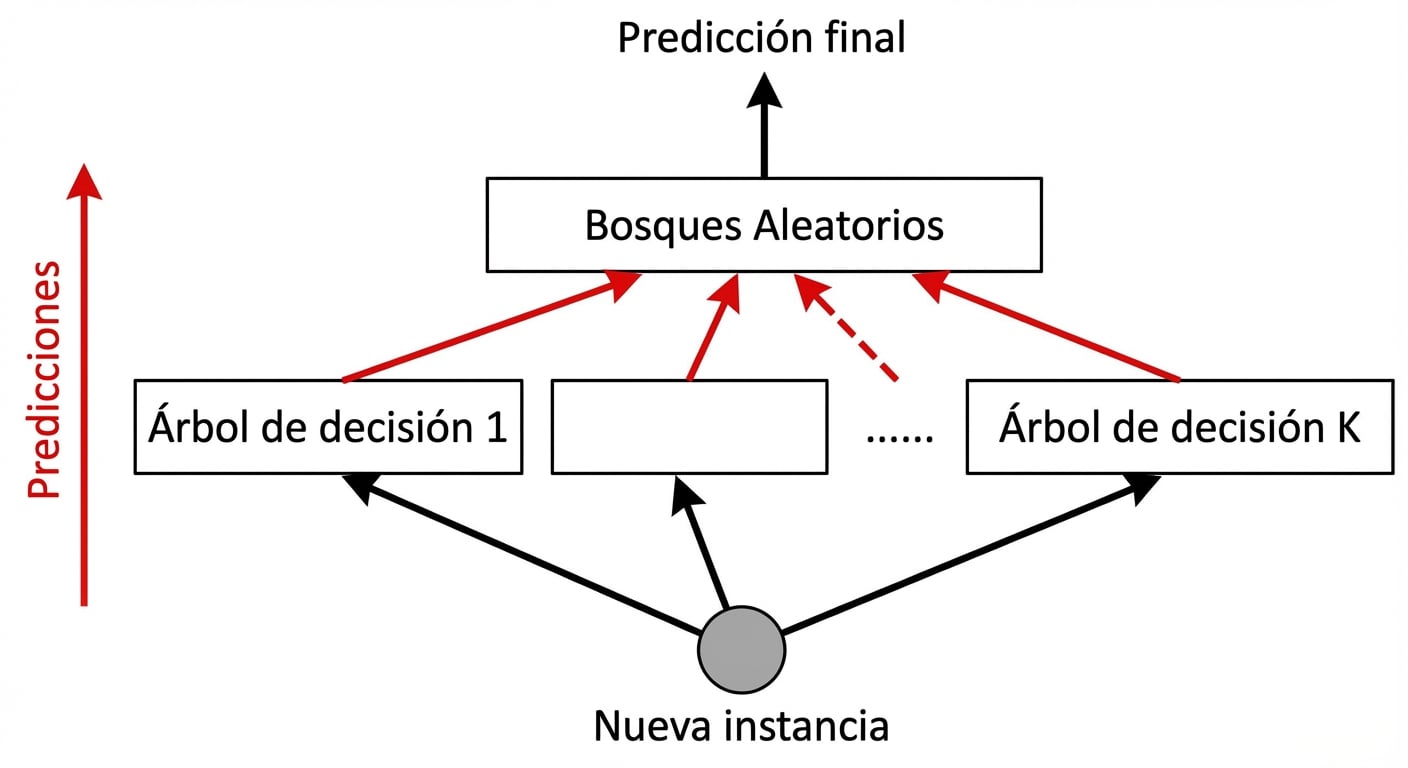

Random Forests: Predicción

Random Forests: Clasificación y regresión

Clasificación:

- Agrega predicciones por voto mayoritario

RandomForestClassifieren scikit-learn

Regresión:

- Agrega predicciones promediando

RandomForestRegressoren scikit-learn

Random Forest Regressor en sklearn (dataset auto)

# Basic imports

from sklearn.ensemble import RandomForestRegressor

from sklearn.model_selection import train_test_split

from sklearn.metrics import mean_squared_error as MSE

# Set seed for reproducibility

SEED = 1

# Split dataset into 70% train and 30% test

X_train, X_test, y_train, y_test = train_test_split(X, y,

test_size=0.3,

random_state=SEED)

# Instancia un RandomForestRegressor 'rf' con 400 estimadores rf = RandomForestRegressor(n_estimators=400, min_samples_leaf=0.12, random_state=SEED)# Ajusta 'rf' al conjunto de entrenamiento rf.fit(X_train, y_train) # Predice las etiquetas del conjunto de prueba 'y_pred' y_pred = rf.predict(X_test)

# Evalúa el RMSE en prueba

rmse_test = MSE(y_test, y_pred)**(1/2)

# Imprime el RMSE en prueba

print('Test set RMSE of rf: {:.2f}'.format(rmse_test))

Test set RMSE of rf: 3.98

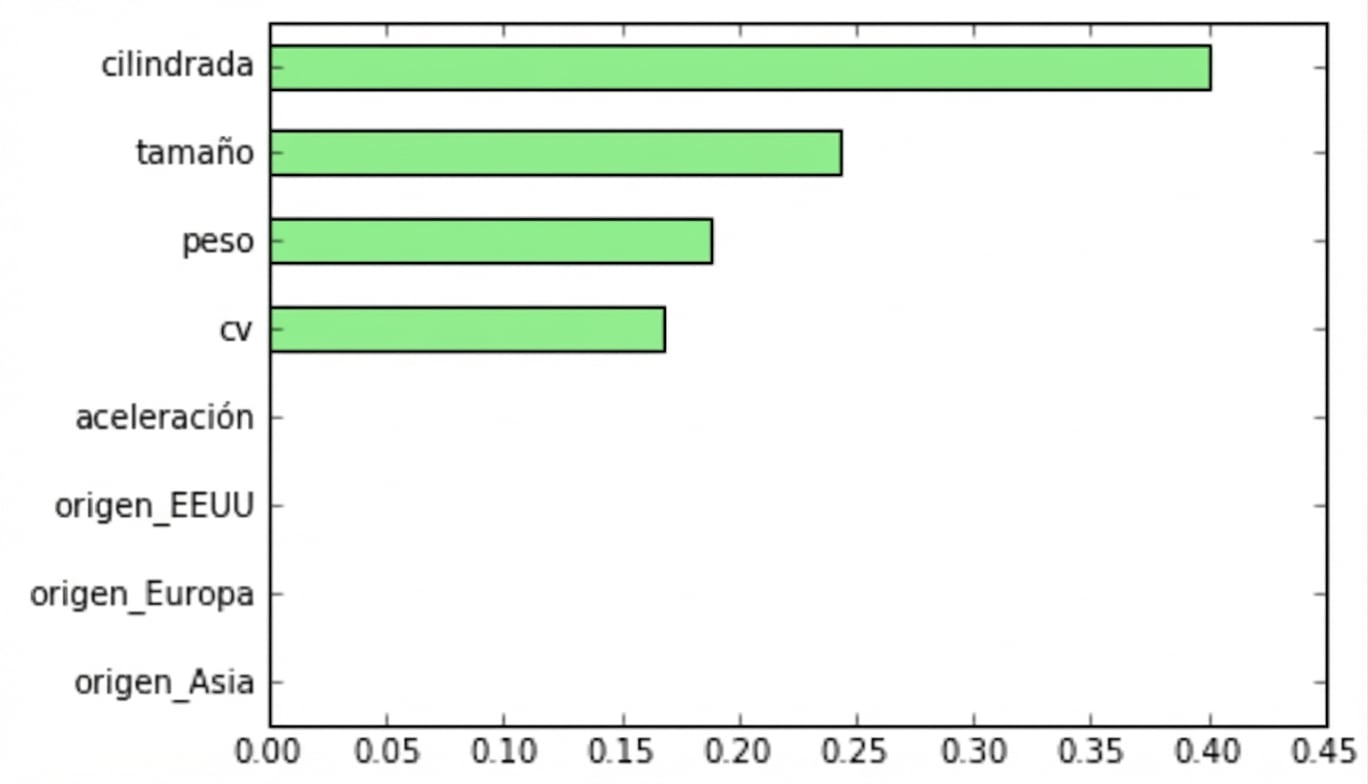

Importancia de variables

Métodos basados en árboles: permiten medir la importancia de cada feature en la predicción.

En sklearn:

- cuánto usan los nodos del árbol una feature (media ponderada) para reducir la impureza

- se accede con el atributo

feature_importance_

Importancia de variables en sklearn

import pandas as pd

import matplotlib.pyplot as plt

# Crea una pd.Series con las importancias

importances_rf = pd.Series(rf.feature_importances_, index = X.columns)

# Ordena importances_rf

sorted_importances_rf = importances_rf.sort_values()

# Grafica barras horizontales

sorted_importances_rf.plot(kind='barh', color='lightgreen'); plt.show()

Importancia de variables en sklearn

¡Vamos a practicar!

Machine learning con modelos basados en árboles en Python