AdaBoost

Machine learning con modelos basados en árboles en Python

Elie Kawerk

Data Scientist

Boosting

Boosting: Método de conjunto que combina varios aprendices débiles para formar uno fuerte.

Aprendiz débil: Modelo que rinde un poco mejor que el azar.

Ejemplo de aprendiz débil: Tocón de decisión (CART con profundidad máxima 1).

Boosting

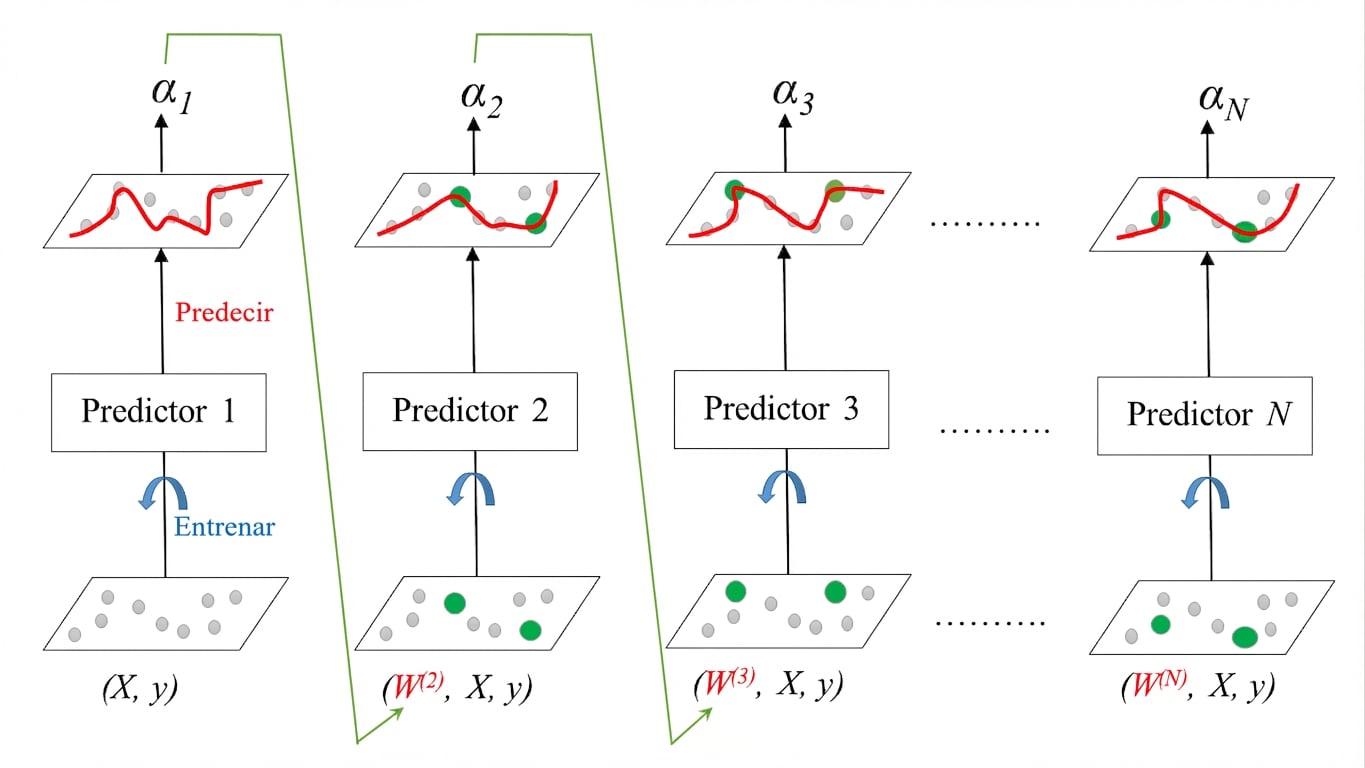

Entrena un conjunto de predictores secuencialmente.

Cada predictor corrige a su predecesor.

Métodos de boosting más populares:

AdaBoost,

Gradient Boosting.

Adaboost

Significa Adaptive Boosting.

Cada predictor presta más atención a las instancias mal predichas por su predecesor.

Se logra cambiando los pesos de las instancias de entrenamiento.

A cada predictor se le asigna un coeficiente $\alpha$.

$\alpha$ depende del error de entrenamiento del predictor.

AdaBoost: Entrenamiento

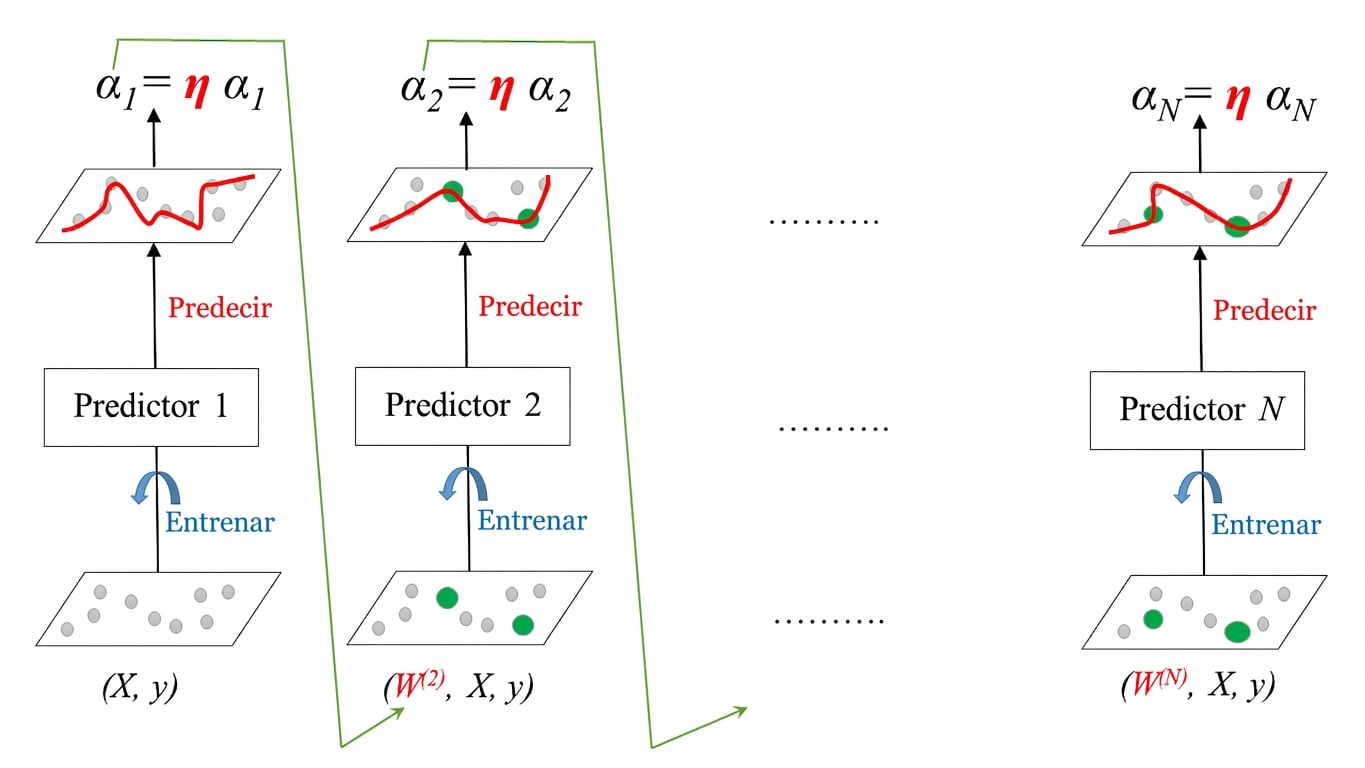

Tasa de aprendizaje

Tasa de aprendizaje: $0 < \eta \leq 1$

AdaBoost: Predicción

Clasificación:

- Votación mayoritaria ponderada.

- En sklearn:

AdaBoostClassifier.

Regresión:

- Media ponderada.

- En sklearn:

AdaBoostRegressor.

Clasificación con AdaBoost en sklearn (Breast Cancer)

# Import models and utility functions

from sklearn.ensemble import AdaBoostClassifier

from sklearn.tree import DecisionTreeClassifier

from sklearn.metrics import roc_auc_score

from sklearn.model_selection import train_test_split

# Set seed for reproducibility

SEED = 1

# Split data into 70% train and 30% test

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.3,

stratify=y,

random_state=SEED)

# Instantiate a classification-tree 'dt' dt = DecisionTreeClassifier(max_depth=1, random_state=SEED)# Instantiate an AdaBoost classifier 'adab_clf' adb_clf = AdaBoostClassifier(base_estimator=dt, n_estimators=100)# Fit 'adb_clf' to the training set adb_clf.fit(X_train, y_train) # Predict the test set probabilities of positive class y_pred_proba = adb_clf.predict_proba(X_test)[:,1]# Evaluate test-set roc_auc_score adb_clf_roc_auc_score = roc_auc_score(y_test, y_pred_proba)

Clasificación con AdaBoost en sklearn (Breast Cancer)

# Print adb_clf_roc_auc_score

print('ROC AUC score: {:.2f}'.format(adb_clf_roc_auc_score))

ROC AUC score: 0.99

¡Vamos a practicar!

Machine learning con modelos basados en árboles en Python