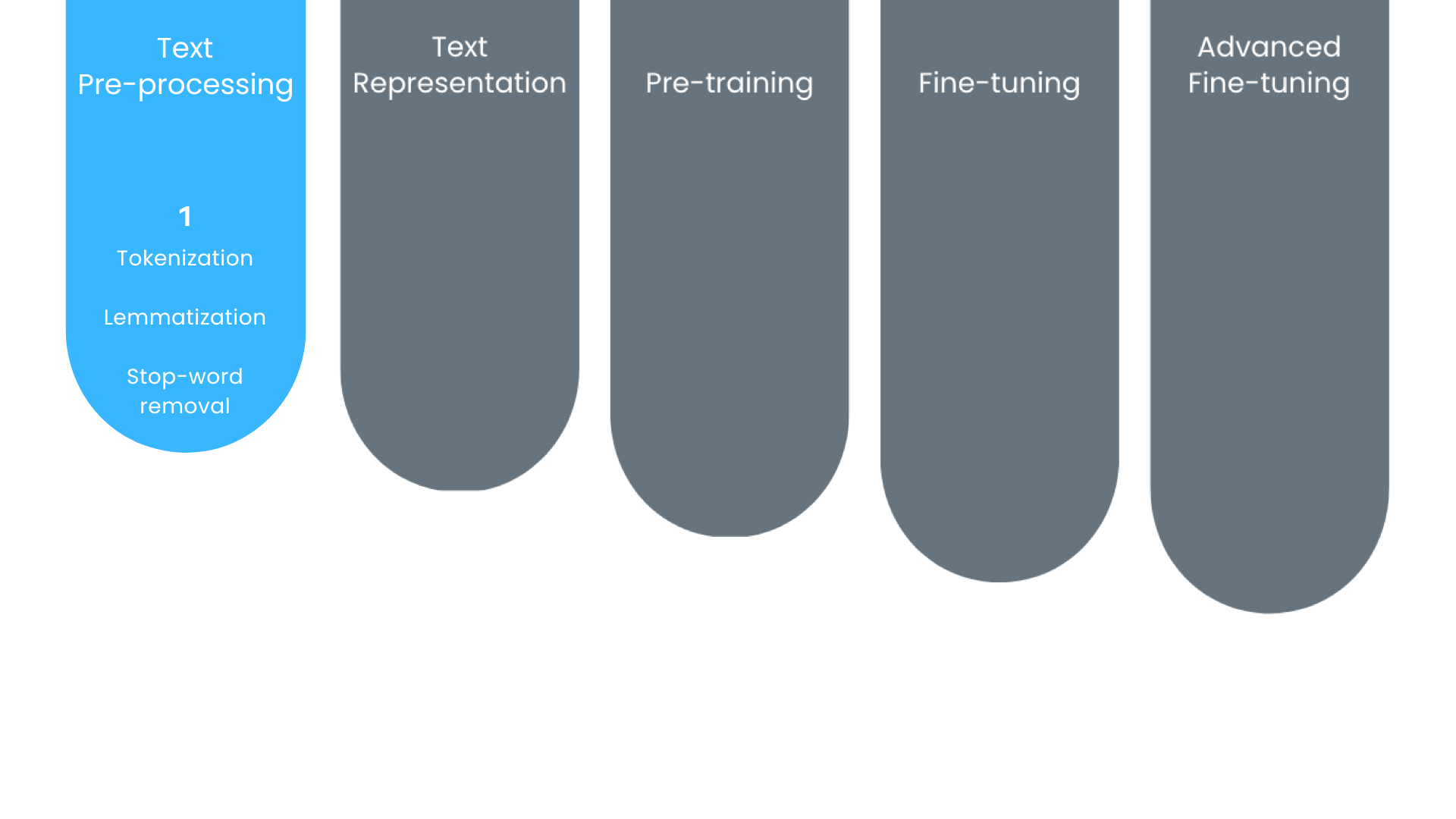

Visão geral do PLN

Conceitos de Grandes Modelos de Linguagem (LLMs)

Vidhi Chugh

AI strategist and ethicist

Onde estamos?

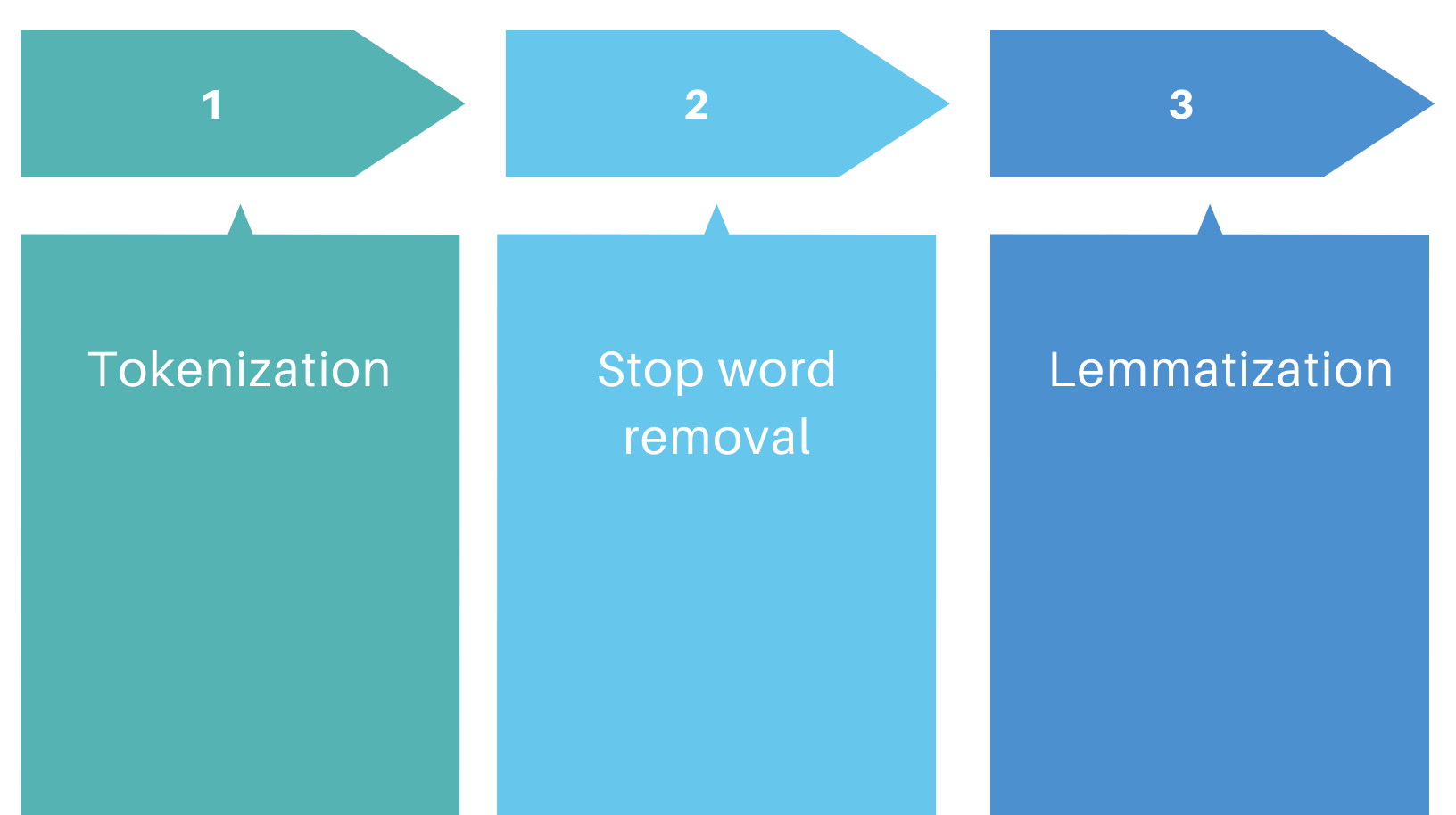

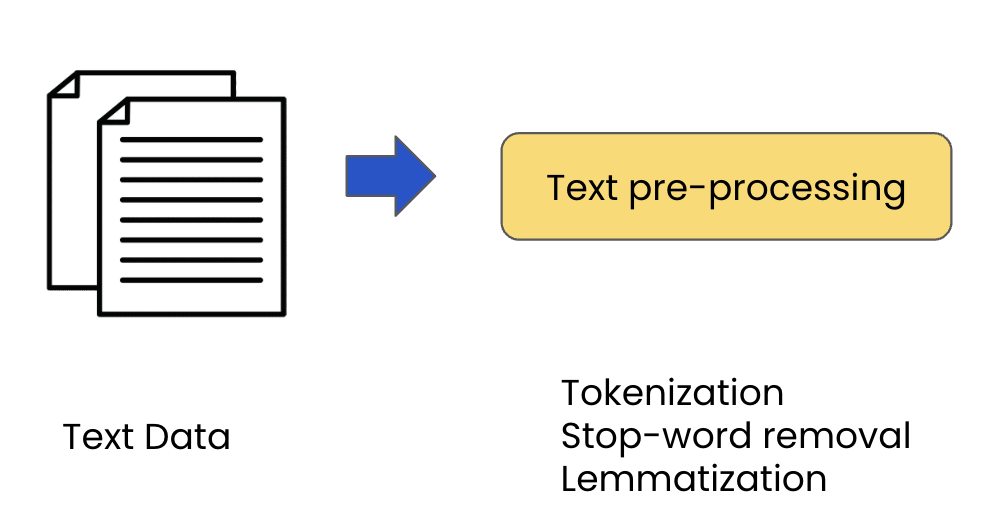

Pré-processamento de textos

- Podem ser feitas em uma ordem diferente, pois são independentes

Tokenização

- Divide o texto em palavras individuais ou tokens

Texto:

- "Trabalhar com técnicas de processamento de linguagem natural é complicado".

Tokenização:

- [“Trabalhar”, “com”, “técnicas”, “de”, “processamento”, “de”, “linguagem”, “natural”, “é”, “complicado”, “.”]

- Converte em uma lista

Remoção de palavras irrelevantes

- Palavras irrelevantes (stop words) não acrescentam significado

- Eliminadas pela remoção de palavras irrelevantes

- Antes da remoção das palavras irrelevantes:

- [“Trabalhar”, “com”, “técnicas”, “de”, “processamento”, “de”, “linguagem”, “natural”, “é”, “complicado”, “.”]

- Depois de tirar as palavras irrelevantes:

- [“Trabalhar”, “técnicas”, “processamento”, “linguagem”, “natural”, “complicado”, “.”]

Lematização

- Agrupar palavras ligeiramente diferentes com significado parecido

- Reduz as palavras à sua forma básica

- Mapeadas à sua forma canônica

Conversando -> Conversar

Conversou -> Conversar

Conversávamos -> Conversar

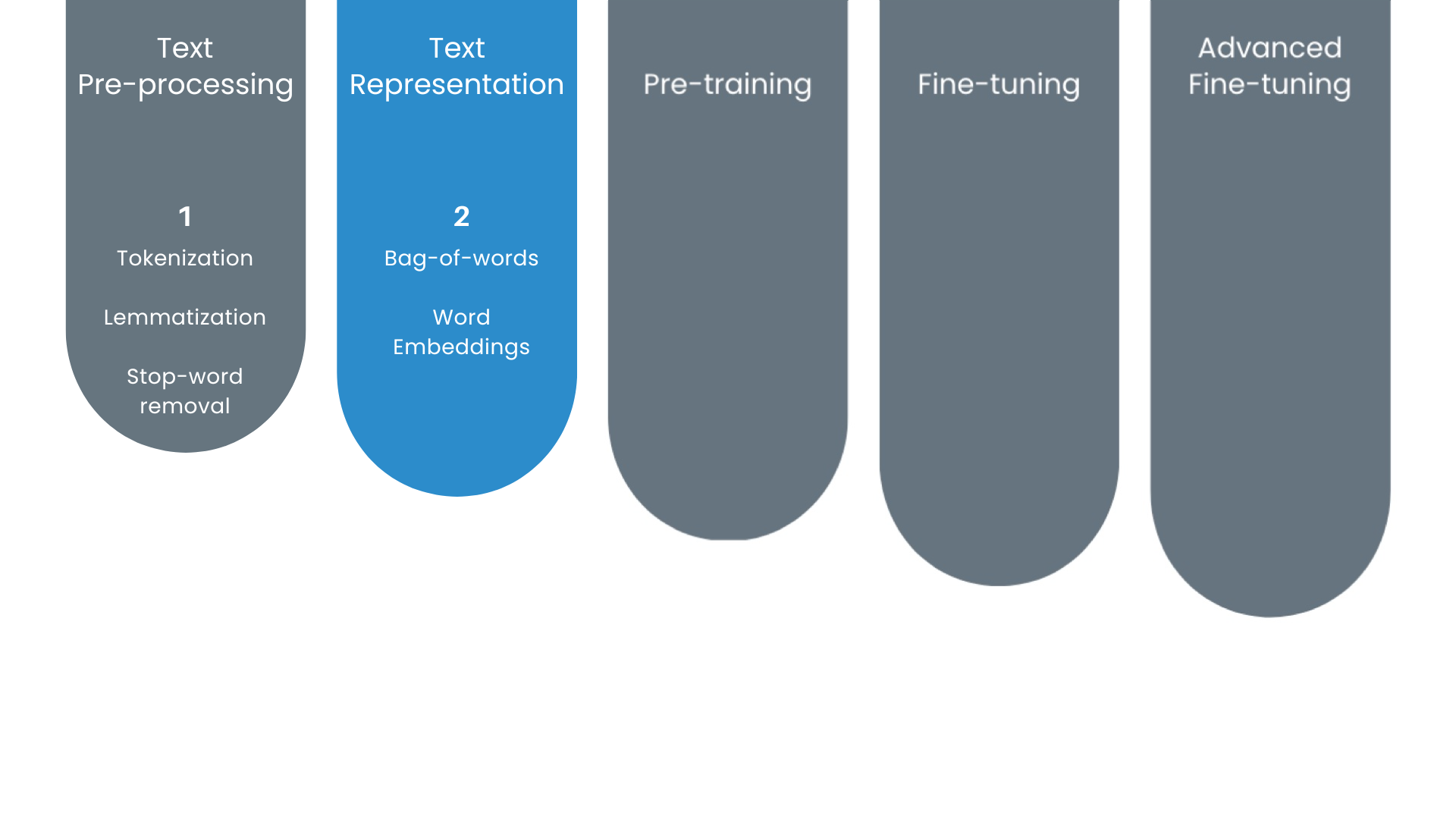

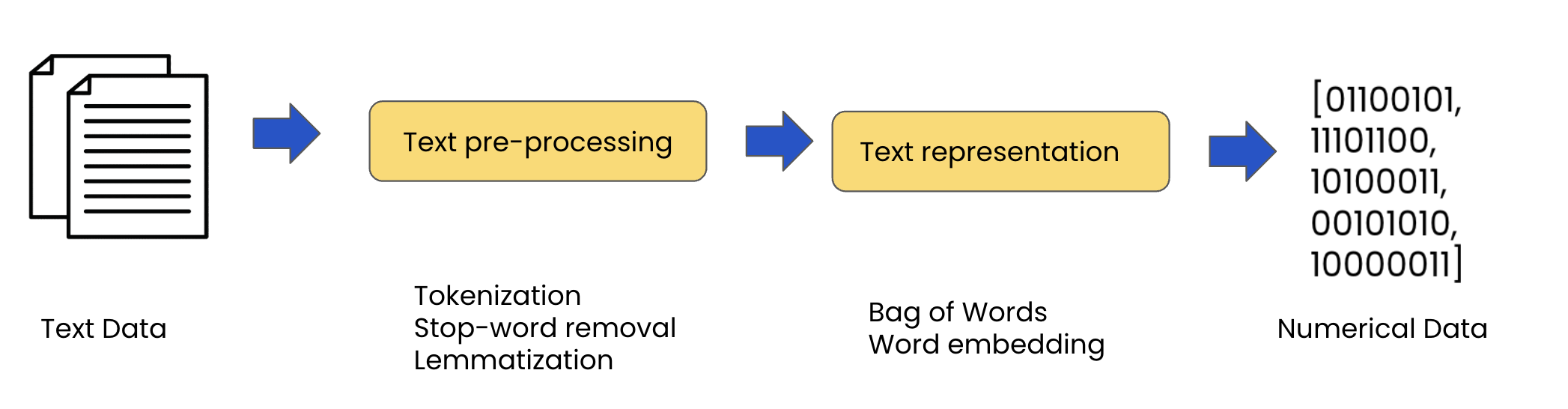

Representação de textos

Representação de textos

- Converter dados de textos em formato numérico

- Saco de palavras (bag of words)

- Representação vetorial de palavras (embeddings)

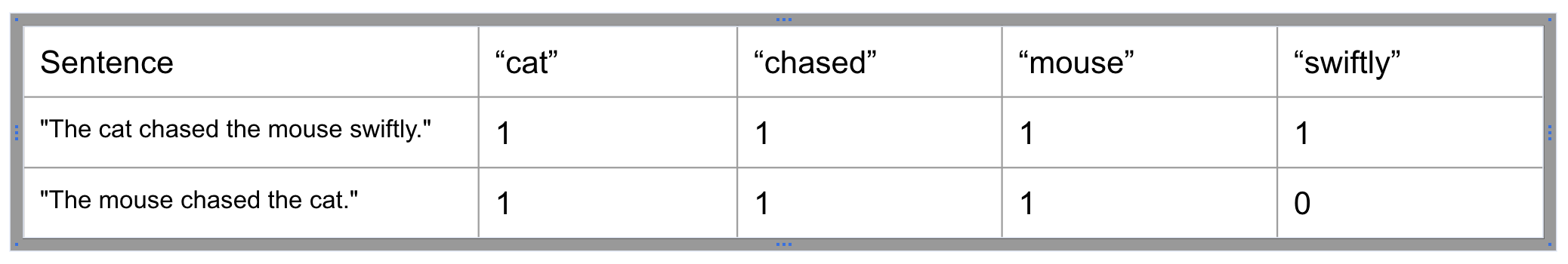

Saco de palavras (bag of words)

- De texto para uma matriz de contagem de palavras

- 0 indica a ausência de uma palavra

Limitações do saco de palavras

Não capta a ordem nem o contexto

- Pode levar a interpretações erradas

- Frases parecidas, mas com significado contrário

- “O gato perseguiu o rato rapidamente.”

- “O rato perseguiu o gato.”

Não capta a semântica entre as palavras

- Trata palavras relacionadas como independentes

- Como “gato” e “rato”

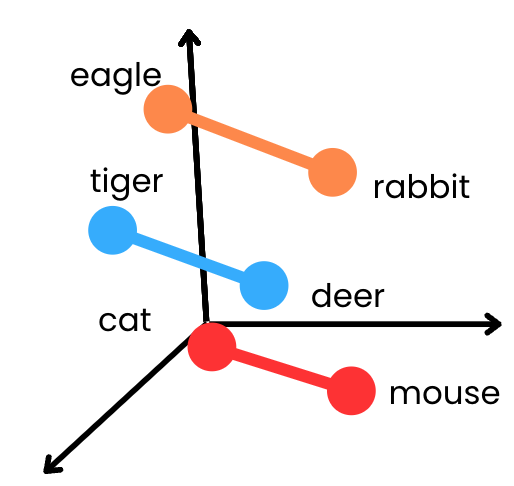

Representação vetorial de palavras

- Captam os significados semânticos como números

| Gato | Rato | |

|---|---|---|

| Planta | -0.9 | -0.8 |

| Peludo | 0.9 | 0.7 |

| Carnívoro | 0.9 | -0.8 |

- Gato [-0.9, 0.9, 0.9]

- Relação predador-presa:

Formato legível por máquina

- Começar pelo pré-processamento dos textos

Formato legível por máquina

- Converter textos pré-processados em formato numérico

Vamos praticar!

Conceitos de Grandes Modelos de Linguagem (LLMs)