A biblioteca evaluate

Introdução a LLMs em Python

Jasmin Ludolf

Senior Data Science Content Developer, DataCamp

A biblioteca evaluate

import evaluateaccuracy = evaluate.load("accuracy")print(accuracy.description)

A acurácia é a proporção de previsões corretas

no total de casos processados. Pode ser calculada com:

Accuracy = (TP + TN) / (TP + TN + FP + FN)

Onde:

TP: True positive (verdadeiro positivo)

TN: True negative (verdadeiro negativo)

FP: False positive (falso positivo)

FN: False negative (falso negativo)

- Métrica: avalia o desempenho com base no ground truth

- Comparação: compara dois modelos

- Medição: gera insights sobre o dataset

Atributo features

print(accuracy.features)

{'predictions': Value(dtype='int32', id=None),

'references': Value(dtype='int32', id=None)}

Inspecionando os inputs exigidos por uma métrica

- 'predictions': saídas do modelo

- 'references': ground truth

- .features: indica o tipo suportado para rótulos, ex.: 'int32' ou 'float32'

f1 = evaluate.load("f1")

print(f1.features)

{'predictions': Value(dtype='int32', id=None),

'references': Value(dtype='int32', id=None)}

pearson_corr = evaluate.load("pearsonr")

print(pearson_corr.features)

{'predictions': Value(dtype='float32', id=None),

'references': Value(dtype='float32', id=None)}

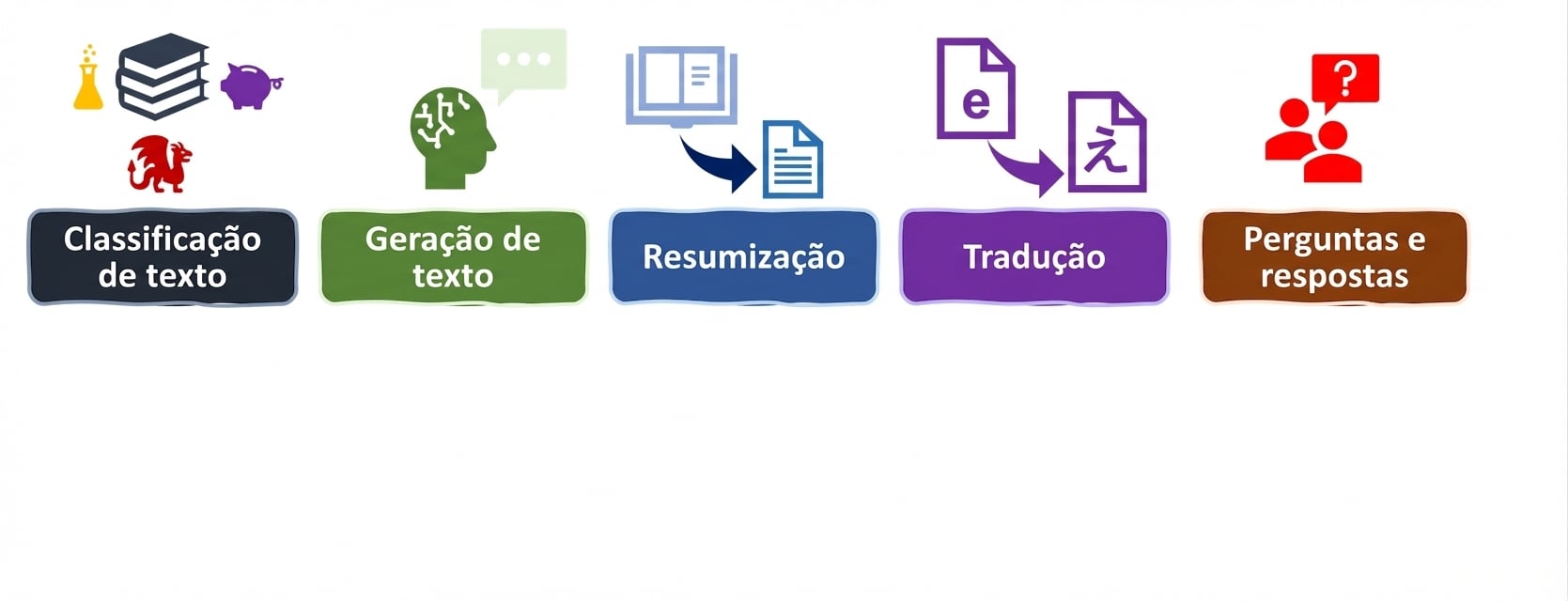

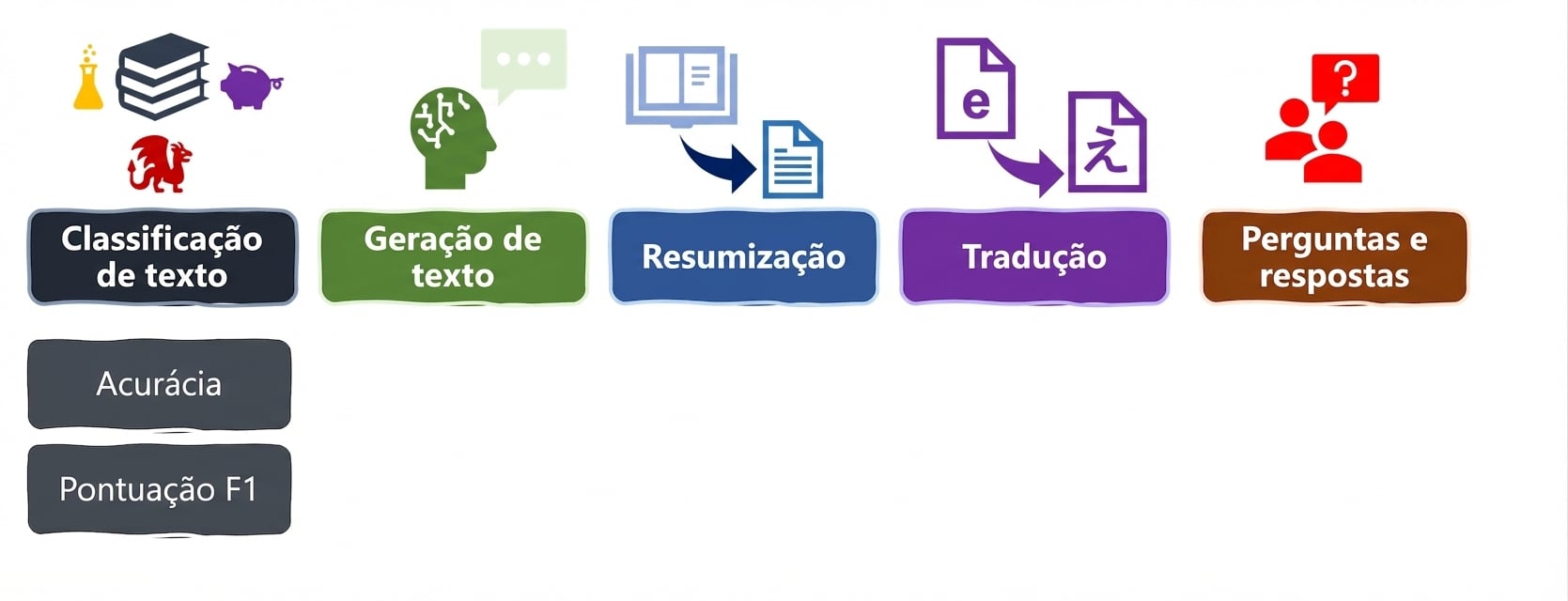

Tarefas e métricas de LLM

Tarefas e métricas de LLM

Métricas de classificação

accuracy = evaluate.load("accuracy")

precision = evaluate.load("precision")

recall = evaluate.load("recall")

f1 = evaluate.load("f1")

from transformers import pipeline classifier = pipeline("text-classification", model=model, tokenizer=tokenizer) predictions = classifier(evaluation_text)predicted_labels = [1 if pred["label"] == "POSITIVE" else 0 for pred in predictions]

Saídas das métricas

real_labels = [0,1,0,1,1]

predicted_labels = [0,0,0,1,1]

print(accuracy.compute(references=real_labels, predictions=predicted_labels))

print(precision.compute(references=real_labels, predictions=predicted_labels))

print(recall.compute(references=real_labels, predictions=predicted_labels))

print(f1.compute(references=real_labels, predictions=predicted_labels))

{'accuracy': 0.8}

{'precision': 1.0}

{'recall': 0.6666666666666666}

{'f1': 0.8}

Avaliando nosso modelo ajustado

# Carrega modelo e tokenizer salvos com # .from_pretrained("my_finetuned_files")new_data = ["This is movie was disappointing!", "This is the best movie ever!"] new_input = tokenizer(new_data, return_tensors="pt", padding=True, truncation=True, max_length=64) with torch.no_grad(): outputs = model(**new_input) predicted = torch.argmax(outputs.logits, dim=1).tolist()

real = [0,1]

print(accuracy.compute(references=real,

predictions=predicted))

print(precision.compute(references=real,

predictions=predicted))

print(recall.compute(references=real,

predictions=predicted))

print(f1.compute(references=real,

predictions=predicted))

{'accuracy': 1.0}

{'precision': 1.0}

{'recall': 1.0}

{'f1': 1.0}

Escolhendo a métrica certa

- Fique atento: cada métrica traz insights e tem limitações

- Seja abrangente: use combinação de métricas (e KPIs do domínio quando possível)

Vamos praticar!

Introdução a LLMs em Python