Dimensão intrínseca

Unsupervised Learning em Python

Benjamin Wilson

Director of Research at lateral.io

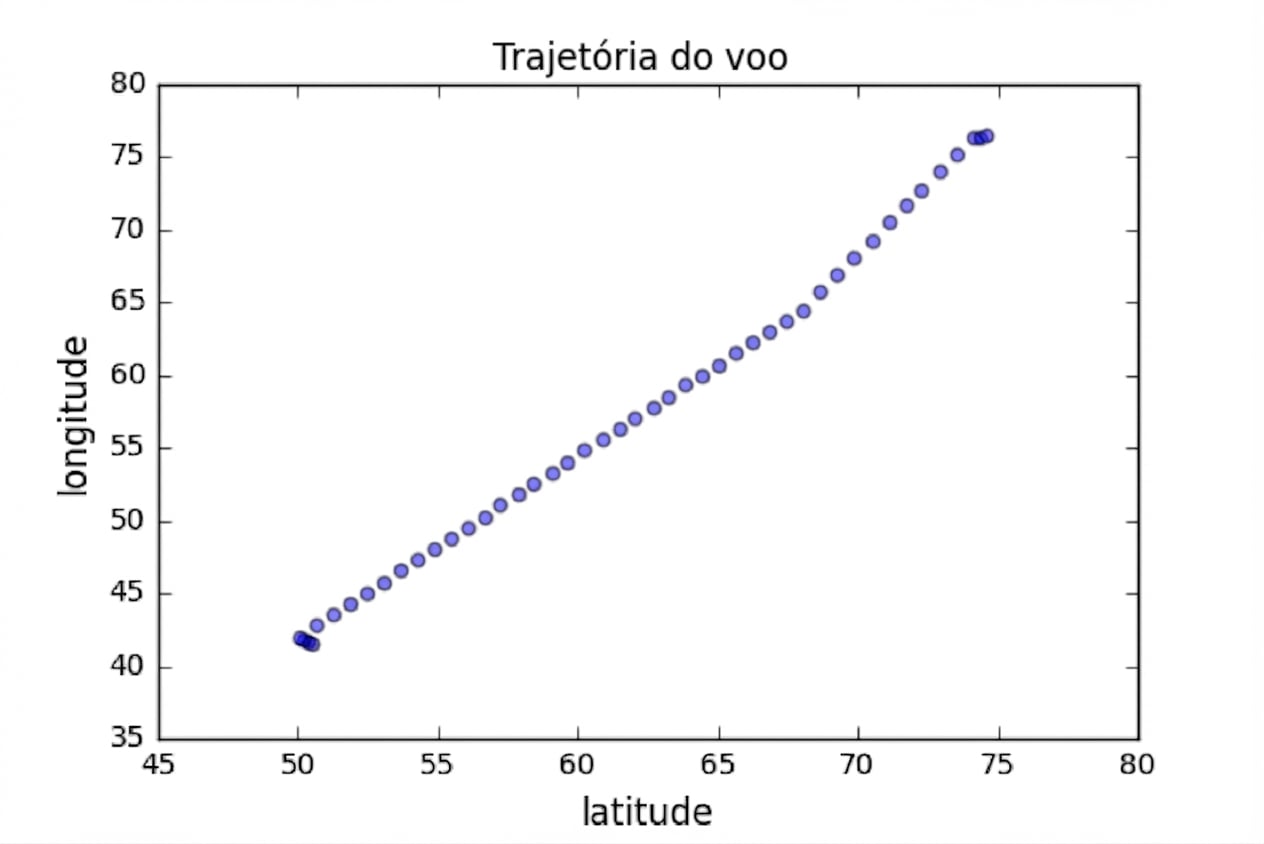

Dimensão intrínseca de uma rota de voo

- 2 variáveis: longitude e latitude ao longo de uma rota de voo

- Parece ser 2D

- Mas dá para aproximar com 1 variável: deslocamento ao longo da rota

- Intrinsecamente 1D

latitude longitude

50.529 41.513

50.360 41.672

50.196 41.835

...

Dimensão intrínseca

- Dimensão intrínseca = nº de variáveis para aproximar o dataset

- Ideia central da redução de dimensionalidade

- Qual a representação mais compacta das amostras?

- Pode ser detectada com PCA

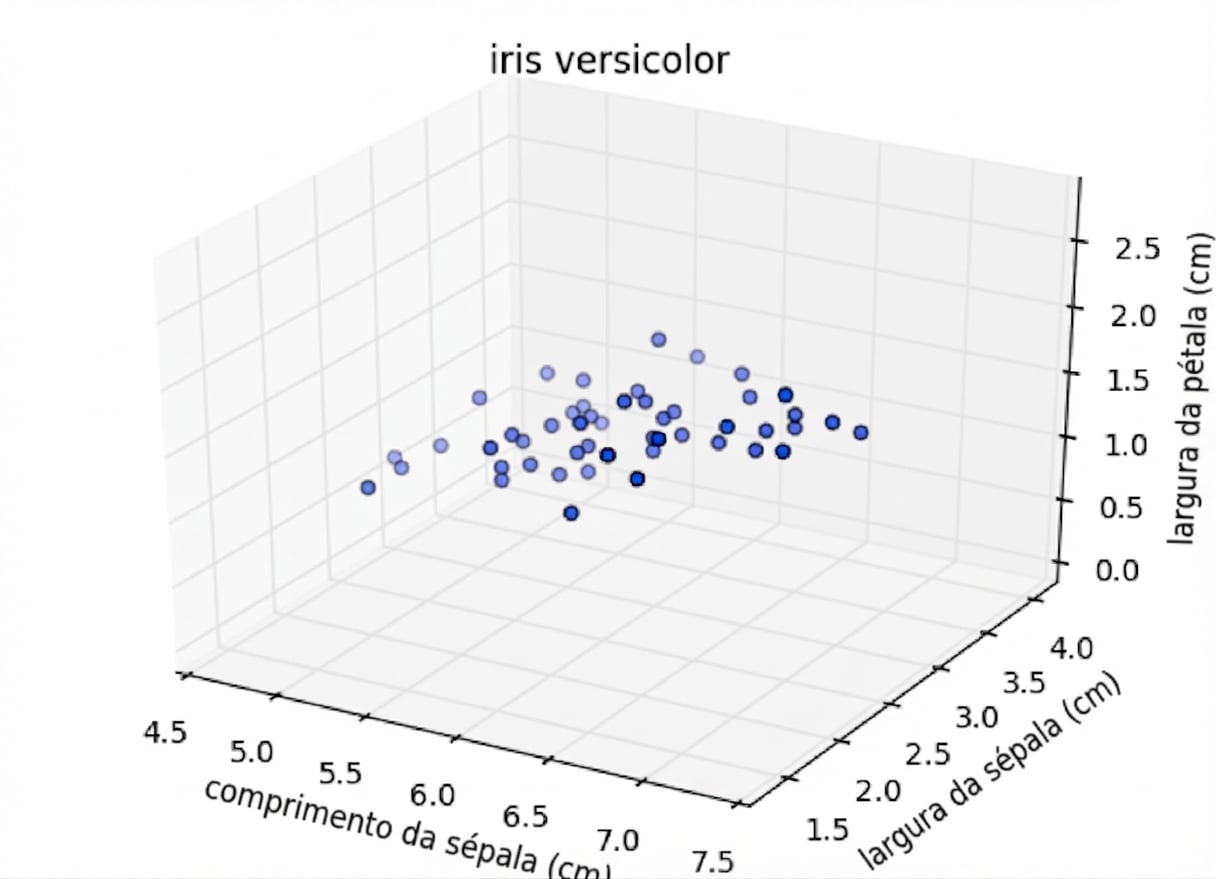

Dataset versicolor

- "versicolor", uma espécie de íris

- Só 3 variáveis: comprimento da sépala, largura da sépala e largura da pétala

- Amostras são pontos em 3D

Dataset versicolor tem dimensão intrínseca 2

- Amostras perto de um plano 2D

- Então dá para aproximar com 2 variáveis

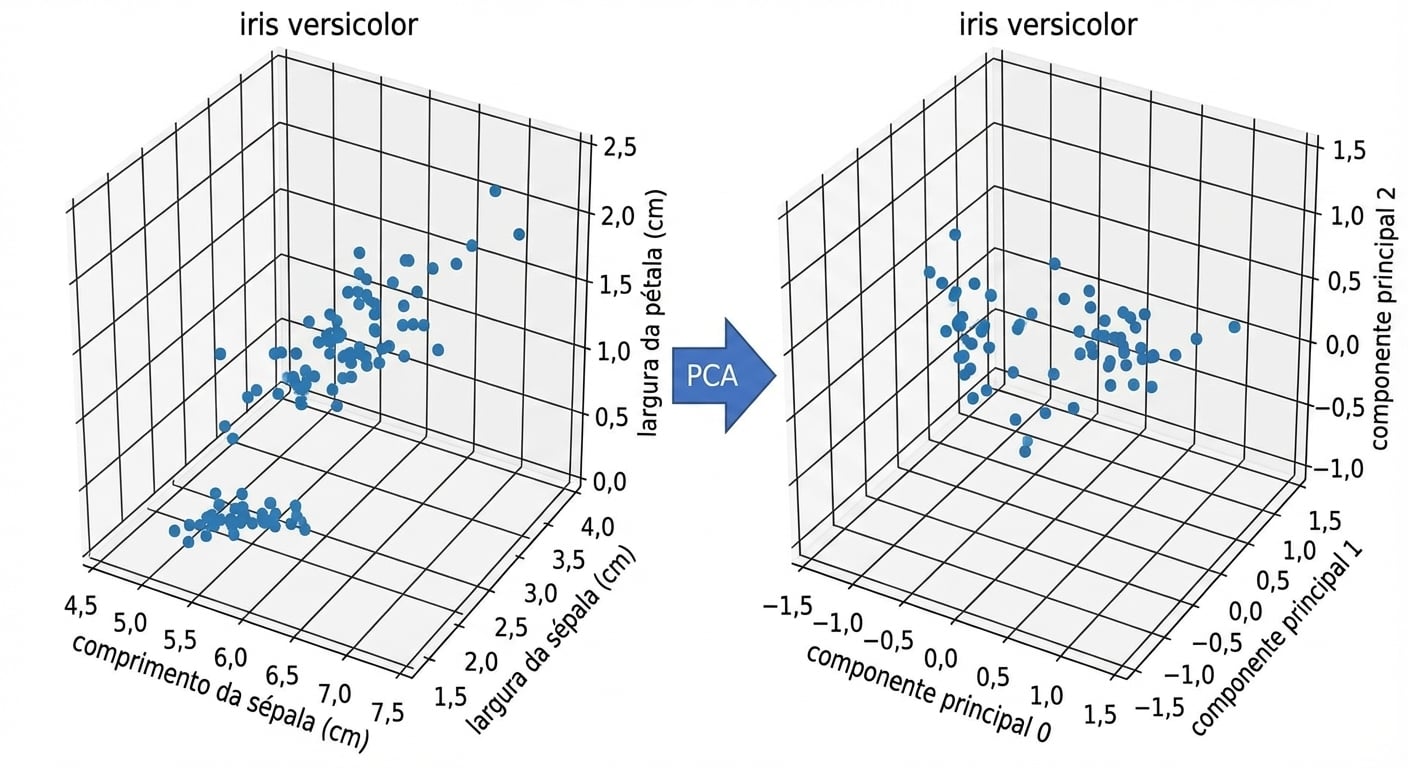

PCA identifica a dimensão intrínseca

- Gráficos de dispersão funcionam só com 2 ou 3 variáveis

- PCA identifica a dimensão intrínseca com qualquer número de variáveis

- Dimensão intrínseca = número de componentes do PCA com variância relevante

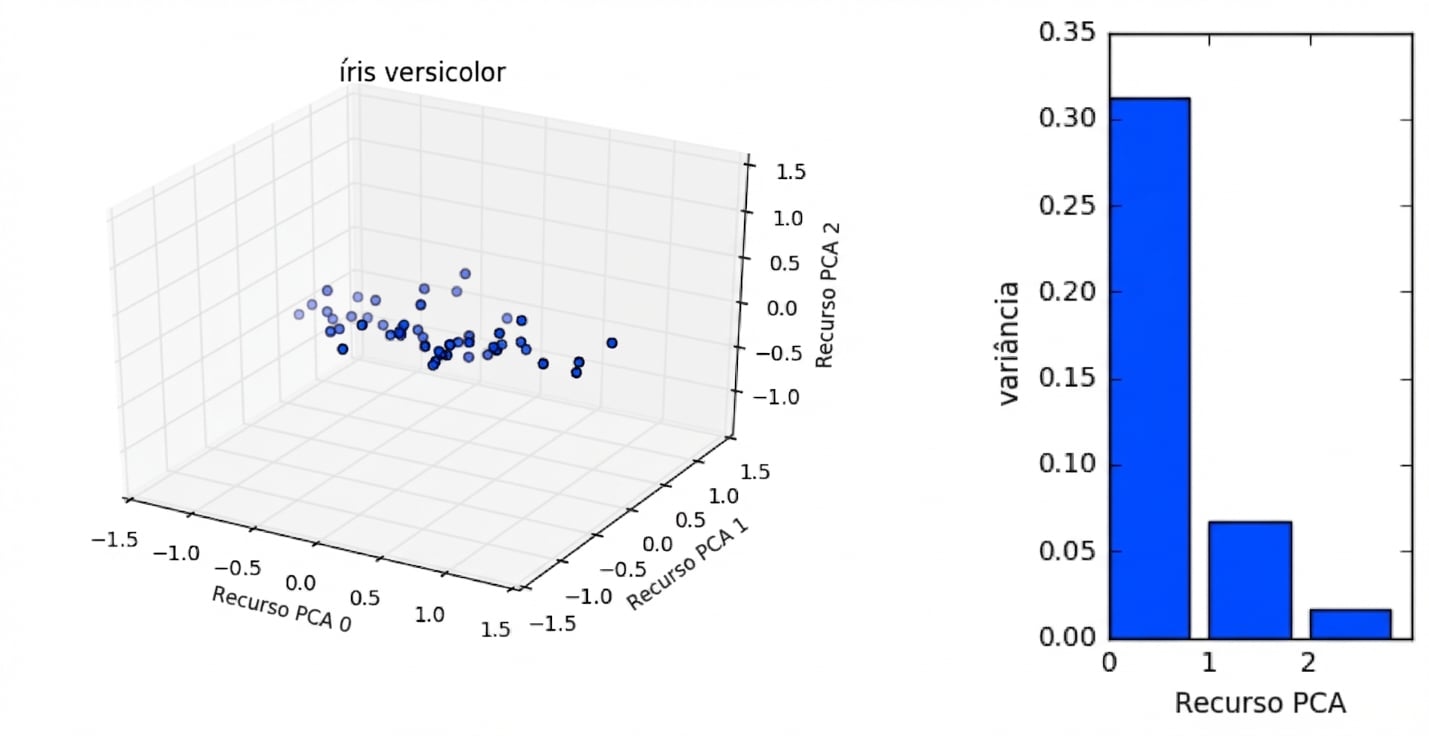

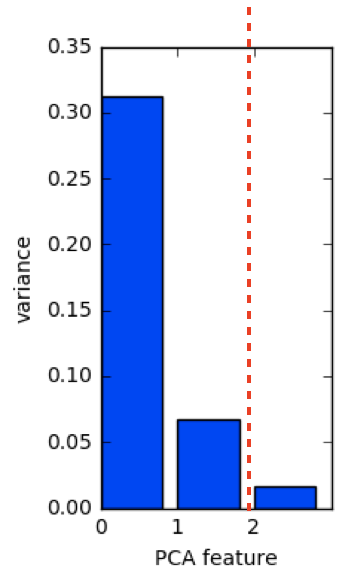

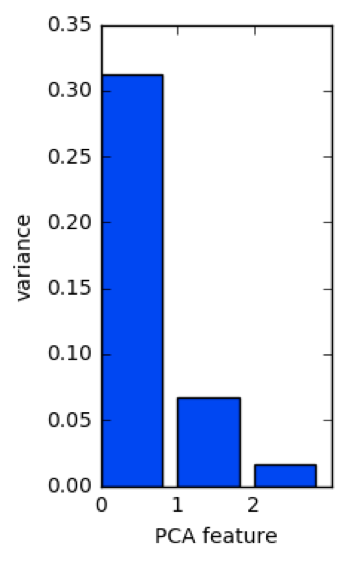

PCA das amostras de versicolor

Componentes do PCA ordenados por variância (decrescente)

Variância e dimensão intrínseca

- Dimensão intrínseca = nº de componentes do PCA com variância relevante

- No exemplo: os dois primeiros componentes

- Logo, dimensão intrínseca = 2

Plotando as variâncias dos componentes do PCA

samples= array de amostras de versicolor

import matplotlib.pyplot as plt from sklearn.decomposition import PCApca = PCA()pca.fit(samples)

PCA()

features = range(pca.n_components_)

Plotando as variâncias dos componentes do PCA

plt.bar(features, pca.explained_variance_)

plt.xticks(features)

plt.ylabel('variance')

plt.xlabel('PCA feature')

plt.show()

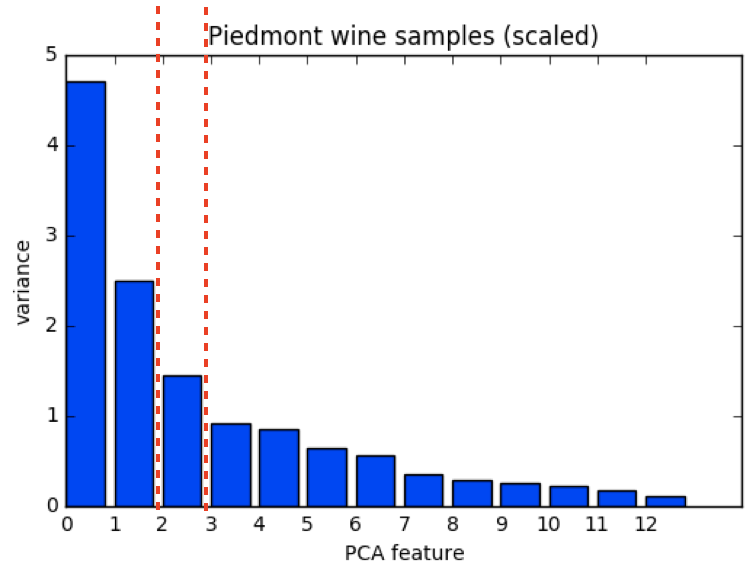

Dimensão intrínseca pode ser ambígua

- Dimensão intrínseca é uma idealização

- ... nem sempre há uma única resposta correta!

- Vinhos do Piemonte: dá para argumentar por 2, 3 ou mais

Vamos praticar!

Unsupervised Learning em Python