Uso de LLM preentrenados

Introducción a los LLMs en Python

Jasmin Ludolf

Senior Data Science Content Developer, DataCamp

Comprensión del lenguaje

Generación de lenguaje

Generación de texto

generator = pipeline(task="text-generation", model="distilgpt2")

prompt = "The Gion neighborhood in Kyoto is famous for"

output = generator(prompt, max_length=100, pad_token_id=generator.tokenizer.eos_token_id)

- Coherente

- Con sentido

- Texto similar al humano

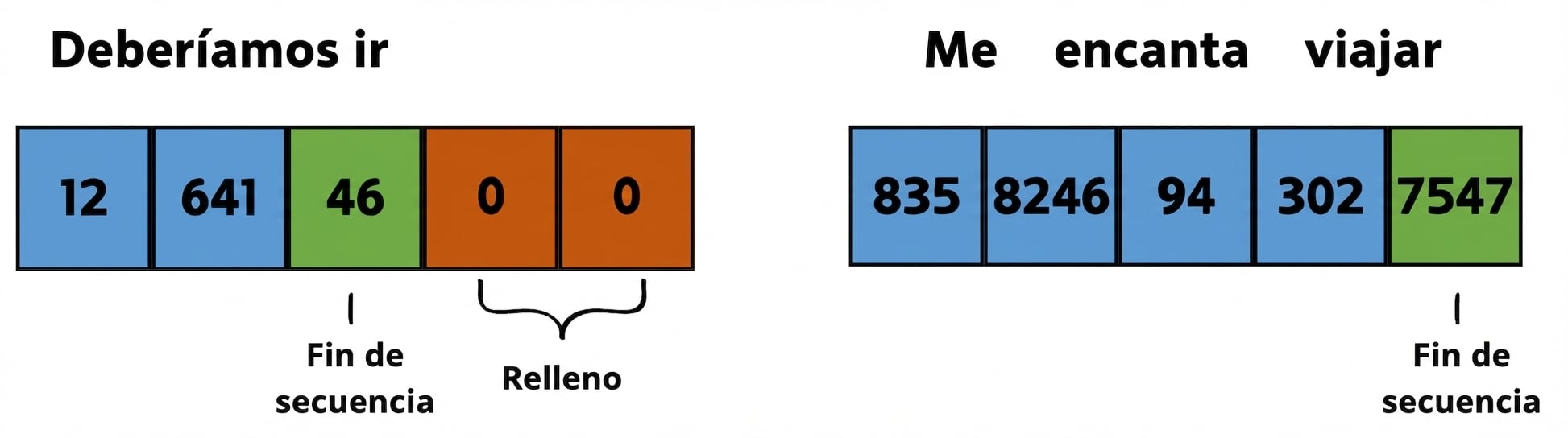

eos_token_id: ID del token de fin de secuencia

Generación de texto

pad_token_id: rellena hastamax_length- Padding: añadir tokens

- Ajustarlo a

generator.tokenizer.eos_token_idmarca el fin del texto útil, aprendido en el entrenamiento - El modelo genera hasta

max_lengthopad_token_id truncation = True

Generación de texto

generator = pipeline(task="text-generation", model="distilgpt2") prompt = "The Gion neighborhood in Kyoto is famous for" output = generator(prompt, max_length=100, pad_token_id=generator.tokenizer.eos_token_id)print(output[0]["generated_text"])

The Gion neighborhood in Kyoto is famous for its many colorful green forests, such as the

Red Hill, the Red River and the Red River. The Gion neighborhood is home to the world's

tallest trees.

- La salida puede ser subóptima si el prompt es vago

Guiar la salida

generator = pipeline(task="text-generation", model="distilgpt2")review = "This book was great. I enjoyed the plot twist in Chapter 10." response = "Dear reader, thank you for your review." prompt = f"Book review:\n{review}\n\nBook shop response to the review:\n{response}"output = generator(prompt, max_length=100, pad_token_id=generator.tokenizer.eos_token_id) print(output[0]["generated_text"])

Dear reader, thank you for your review. We'd like to thank you for your reading!

Traducción automática

- Hugging Face tiene una lista completa de tareas y modelos de traducción

translator = pipeline(task="translation_en_to_es", model="Helsinki-NLP/opus-mt-en-es")text = "Walking amid Gion's Machiya wooden houses was a mesmerizing experience."output = translator(text, clean_up_tokenization_spaces=True)print(output[0]["translation_text"])

Caminar entre las casas de madera Machiya de Gion fue una experiencia fascinante.

¡Vamos a practicar!

Introducción a los LLMs en Python