Lernmethoden

Konzepte großer Sprachmodelle (LLMs)

Vidhi Chugh

AI strategist and ethicist

In welchem Abschnitt befinden wir uns?

Datenbeschränkungen überwinden

- Fine-Tuning / Feinabstimmung: Ein bereits trainiertes Modell für eine bestimmte Aufgabe trainieren

- Aber was ist, wenn es kaum oder gar keine gekennzeichneten Daten gibt?

- N-Shot-Lernen: Zero-Shot, Few-Shot und Multi-Shot

Transferlernen

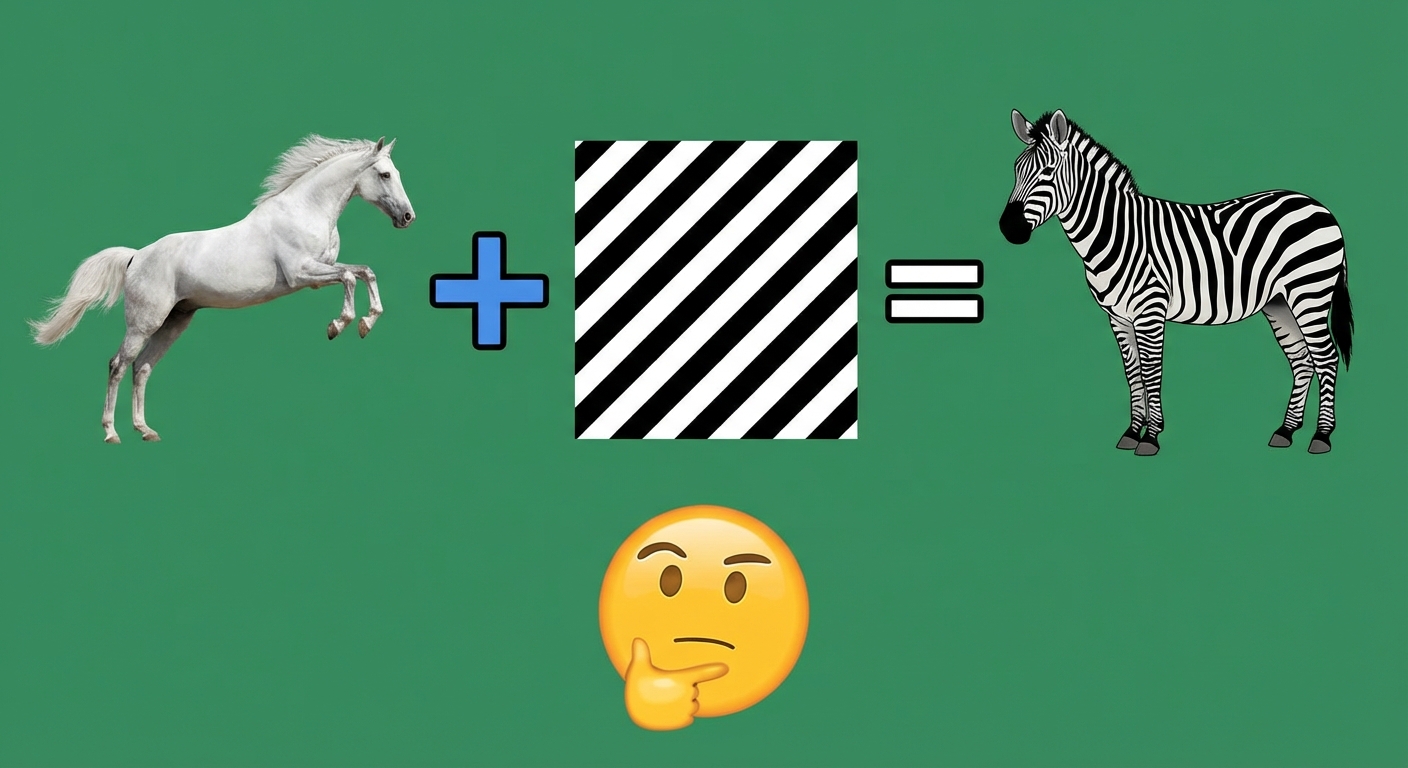

- Aus einer Aufgabe lernen und das Gelernte auf ähnliche Aufgaben anwenden

- Vom Klavierspiel auf das Gitarrenspiel

- Noten lesen

- Rhythmus verstehen

- Musikalische Konzepte verstehen

- N-shot-Lernen

- Zero-Shot – keine Daten

- Few-Shot – wenige Daten

- Multi-Shot – relativ viele Trainingsdaten

Zero-Shot-Lernen

- Kein spezielles Training

- Nutzt Sprachverständnis und Kontext

- Verallgemeinert ohne vorherige Beispiele

1 Freepik

Few-Shot-Lernen

- Lernen neuer Aufgaben mit Beispielen

- One-Shot-Lernen: Feinabstimmung anhand eines einzigen Beispiels

- Vorwissen, um neue Fragen zu beantworten

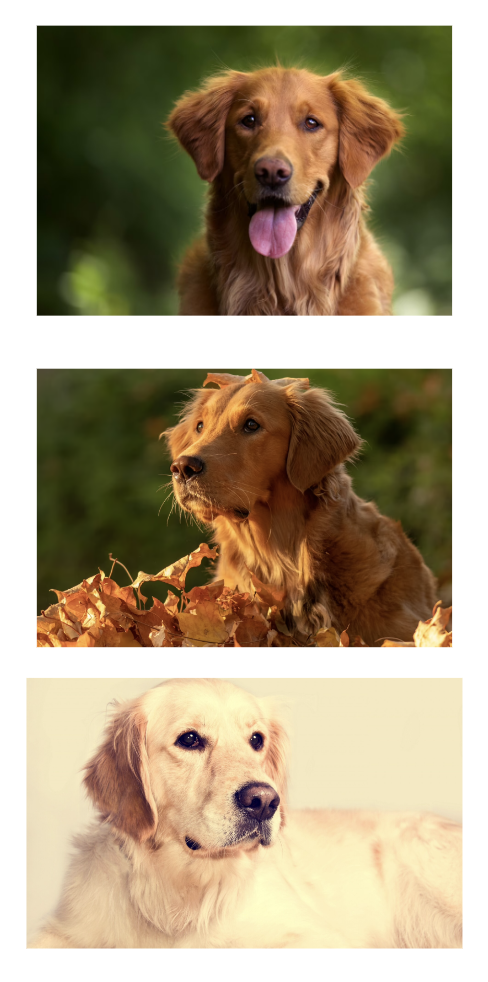

Multi-Shot-Lernen

- Benötigt mehr Beispiele als Few-Shot

- Vorherige Aufgaben plus neue Beispiele

- Zum Beispiel ein Modell, das mit Golden Retrievern trainiert wurde

1 Freepik

Multi-Shot-Lernen

- Modellausgabe: Labrador Retriever

- Spart Zeit beim Sammeln und Kennzeichnen von Daten

- Keine Kompromisse bei der Genauigkeit

1 Freepik

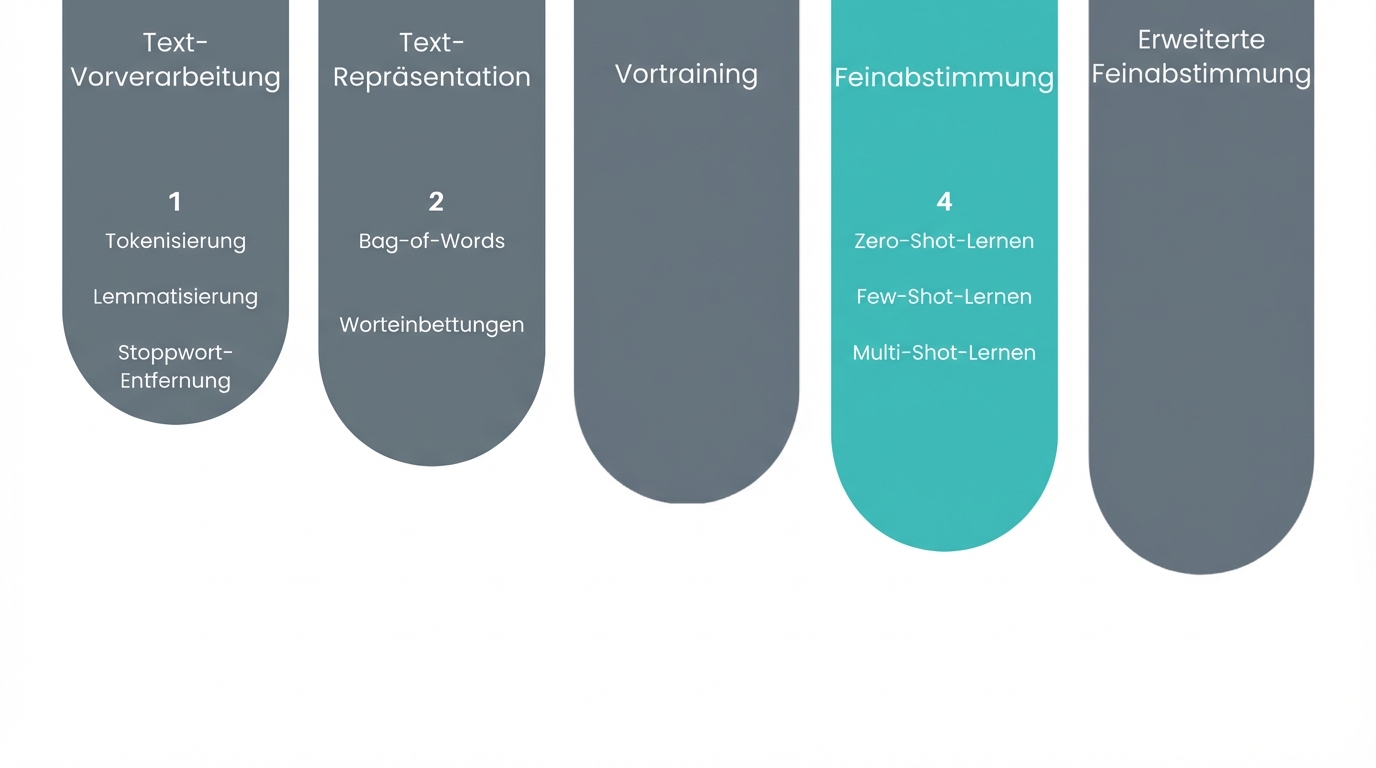

Bisherige Bausteine

- Workflow zur Datenaufbereitung

- Fine-tuning / Feinabstimmung

- N-Shot-Lernmethoden

- Als nächstes: Pre-Training / Vorabtraining

Lass uns üben!

Konzepte großer Sprachmodelle (LLMs)