Eine Produktions-Pipeline erstellen

Einführung in Apache Airflow mit Python

Mike Metzger

Data Engineer

DAGs & Tasks ausführen

So führst du einen bestimmten Task über die Kommandozeile aus:

airflow tasks test <dag_id> <task_id> <date>

So startest du einen kompletten DAG:

airflow dags trigger -e <date> <dag_id>

Operatoren – Kurzüberblick

- BashOperator – erwartet

bash_command - PythonOperator – erwartet

python_callable - BranchPythonOperator – benötigt

python_callableundprovide_context=True. Die Callable muss**kwargsakzeptieren. - FileSensor – benötigt das Argument

filepathund ggf. die Attributemodeoderpoke_interval

Template – Hinweise

- Viele Objekte in Airflow können Templates nutzen

- Bestimmte Felder erlauben Template-Strings, andere nicht

- Prüfe das in der eingebauten Doku:

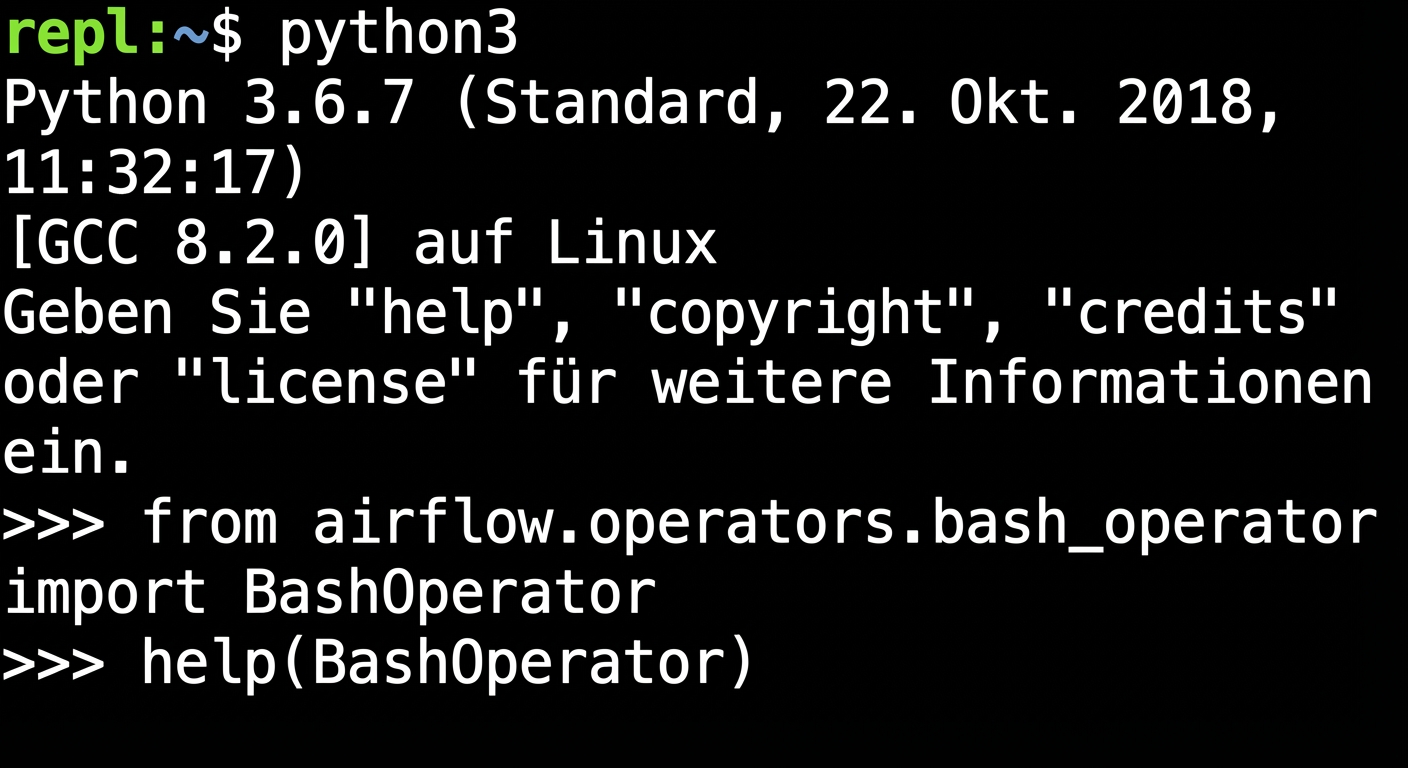

- Python3-Interpreter öffnen

- Benötigte Bibliotheken importieren (z. B.

from airflow.operators.bash import BashOperator) - In der Shell

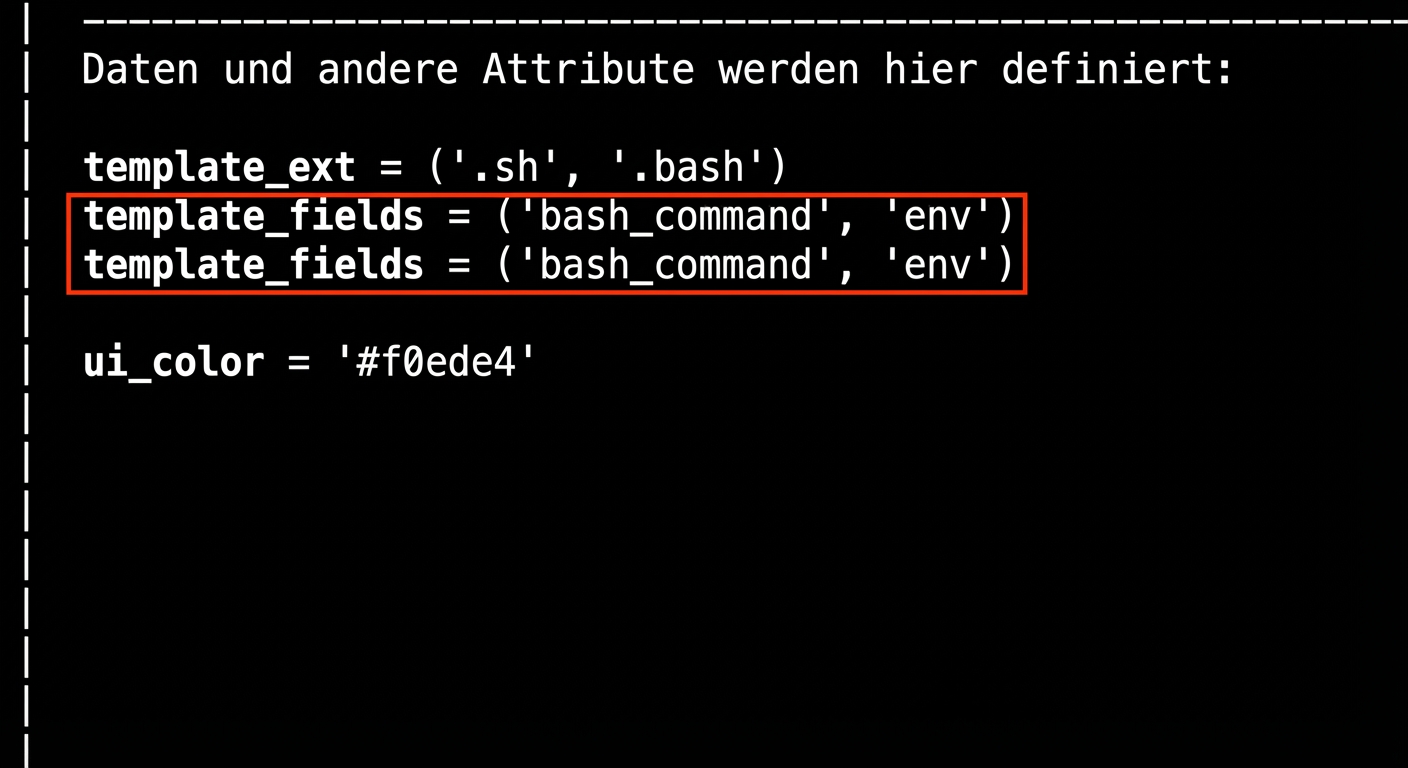

help(<Airflow-Objekt>)ausführen, z. B.help(BashOperator) - Nach der Zeile mit template_fields suchen. Dort stehen die Argumente, die Templates unterstützen.

Beispiel: Template-Dokumentation

Lass uns üben!

Einführung in Apache Airflow mit Python