Airflow-Aufgaben

Einführung in Apache Airflow mit Python

Mike Metzger

Data Engineer

Aufgaben

Aufgaben sind:

- Instanzen von Operatoren

- Meist einer Python-Variable zugewiesen

example_task = BashOperator(task_id='bash_example', bash_command='echo "Example!"') - In Airflow-Tools per task_id referenziert

Aufgabenabhängigkeiten

$$

- Legen eine Ausführungsreihenfolge fest

- Für Workflows nicht zwingend, aber meist vorhanden

- Heißen upstream oder downstream Aufgaben

- Ab Airflow 1.8 mit Bitshift-Operatoren definiert

- >>, der Upstream-Operator

- <<, der Downstream-Operator

Upstream vs. Downstream

Upstream bedeutet davor

Downstream bedeutet danach

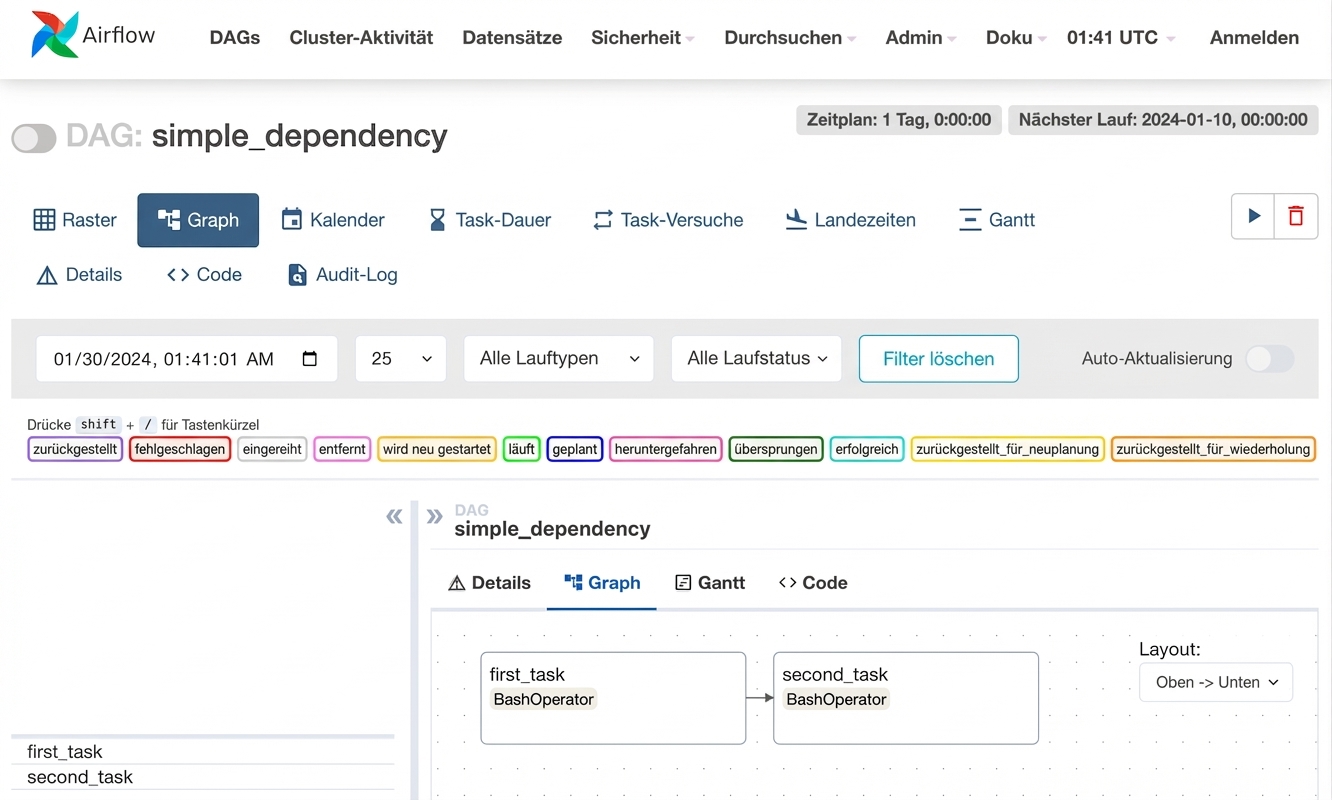

Einfache Aufgabenabhängigkeit

# Define the tasks task1 = BashOperator(task_id='first_task', bash_command='echo 1' )task2 = BashOperator(task_id='second_task', bash_command='echo 2' )# Set first_task to run before second_task task1 >> task2 # or task2 << task1

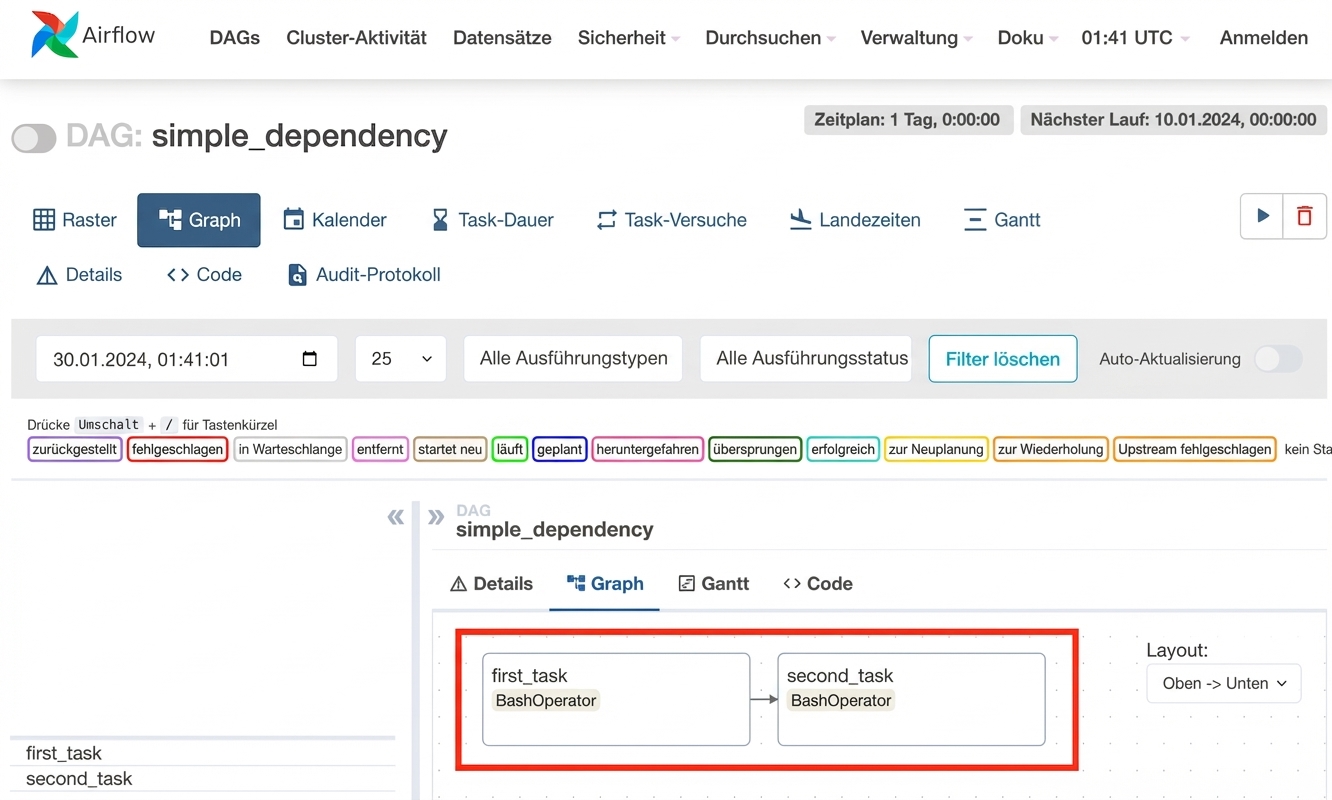

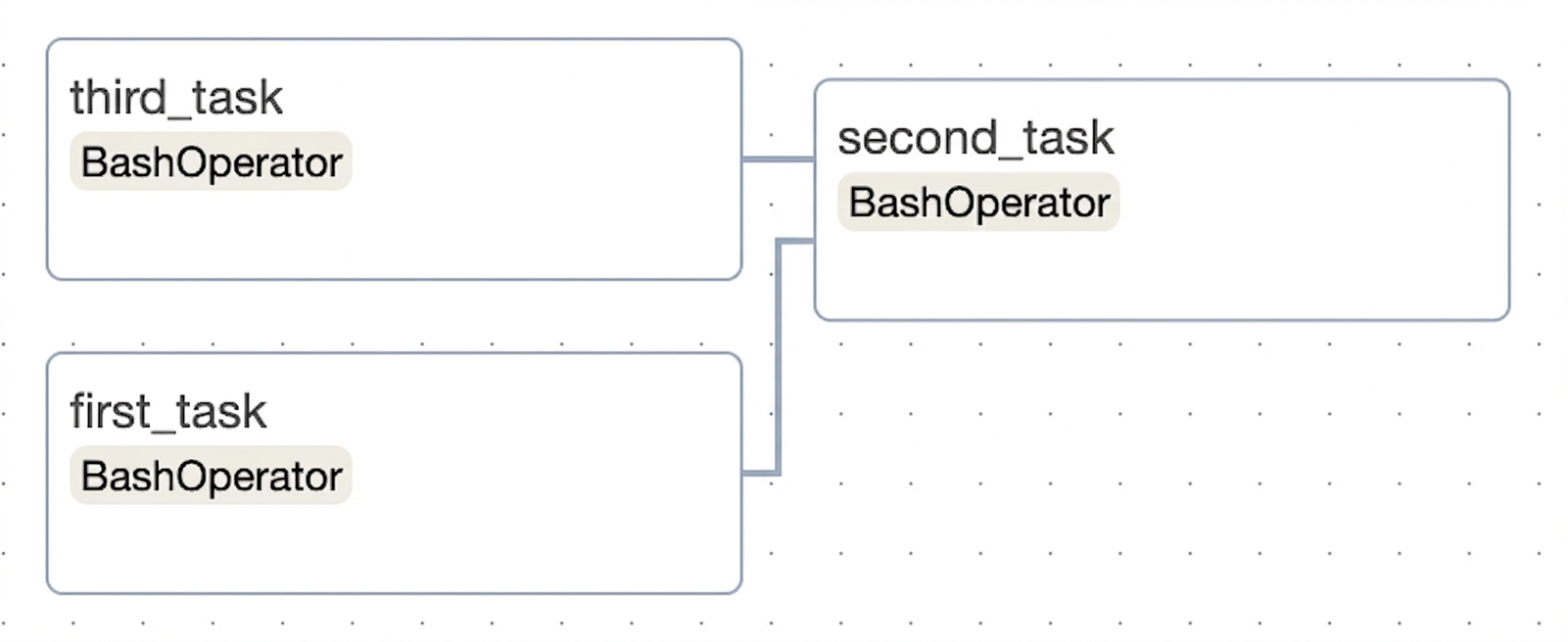

Aufgabenabhängigkeiten in der Airflow-UI

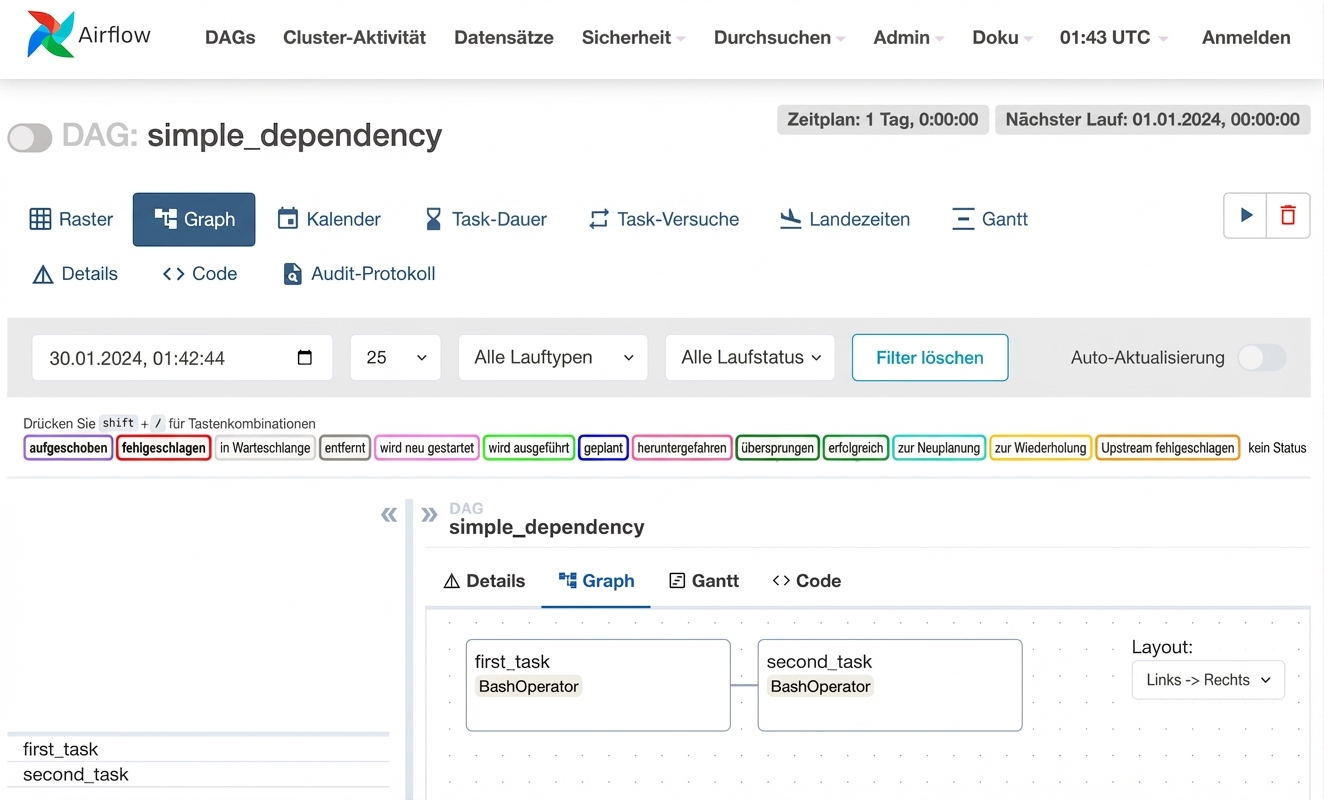

Aufgabenabhängigkeiten in der Airflow-UI

Aufgabenabhängigkeiten in der Airflow-UI

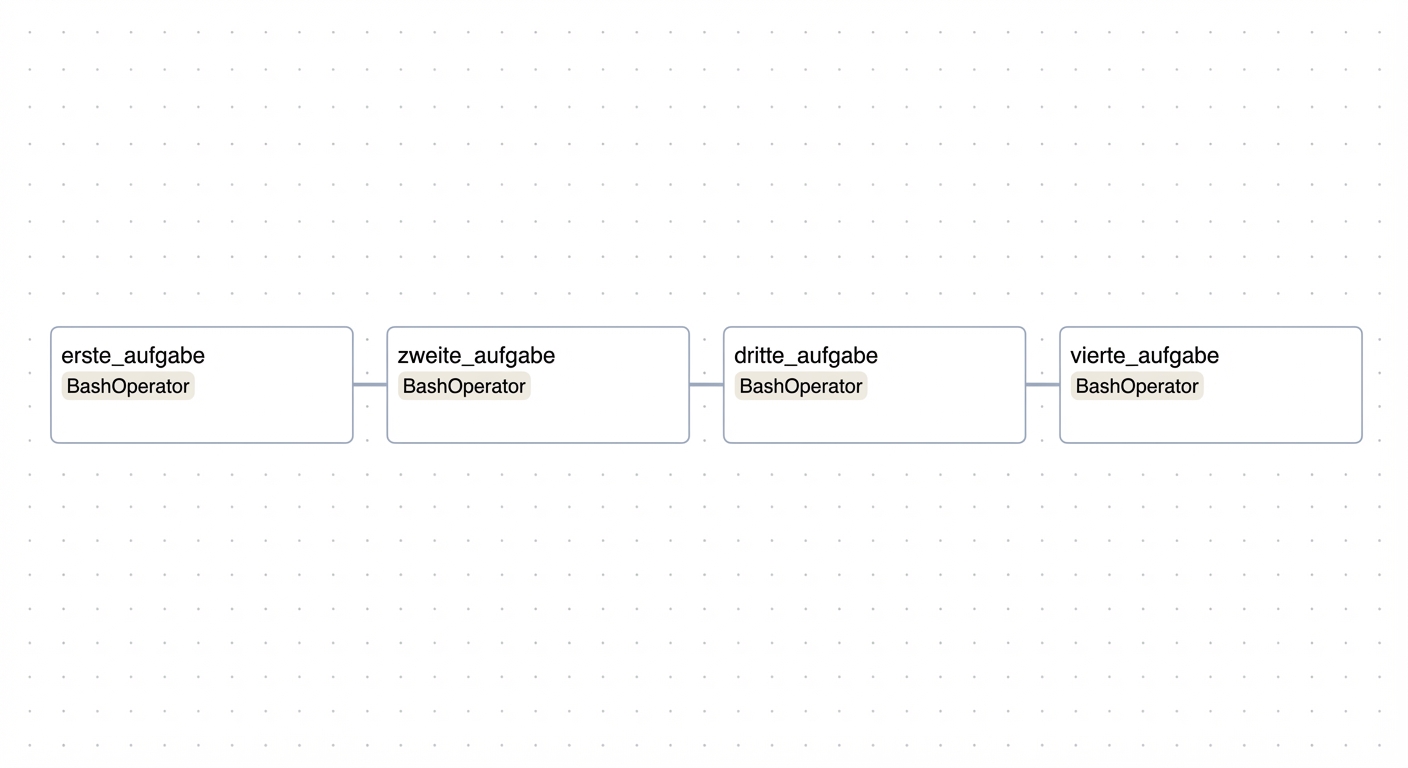

Mehrere Abhängigkeiten

Verkettete Abhängigkeiten:

task1 >> task2 >> task3 >> task4

Gemischte Abhängigkeiten:

task1 >> task2 << task3

oder:

task1 >> task2

task3 >> task2

Lass uns üben!

Einführung in Apache Airflow mit Python