Generalisierungsfehler

Maschinelles Lernen mit baumbasierten Modellen in Python

Elie Kawerk

Data Scientist

Überwachtes Lernen – Ein Blick hinter die Kulissen

- Überwachtes Lernen: $y =f(x)$, $f$ ist nicht bekannt.

Ziele des überwachten Lernens

Finde ein Modell $\hat{f}$, das am besten passt: für $f$: $\hat{f} \approx f$

$\hat{f}$ kann eine logistische Regression, ein Entscheidungsbaum, oder ein neuronales Netzwerk, etc. sein

Störendes Rauschen so gut es geht ausblenden.

Ziel: $\hat{f}$ soll bei unbekannten Datensätzen einen geringen Vorhersagefehler aufweisen.

Herausforderungen bei der Annäherung $f$

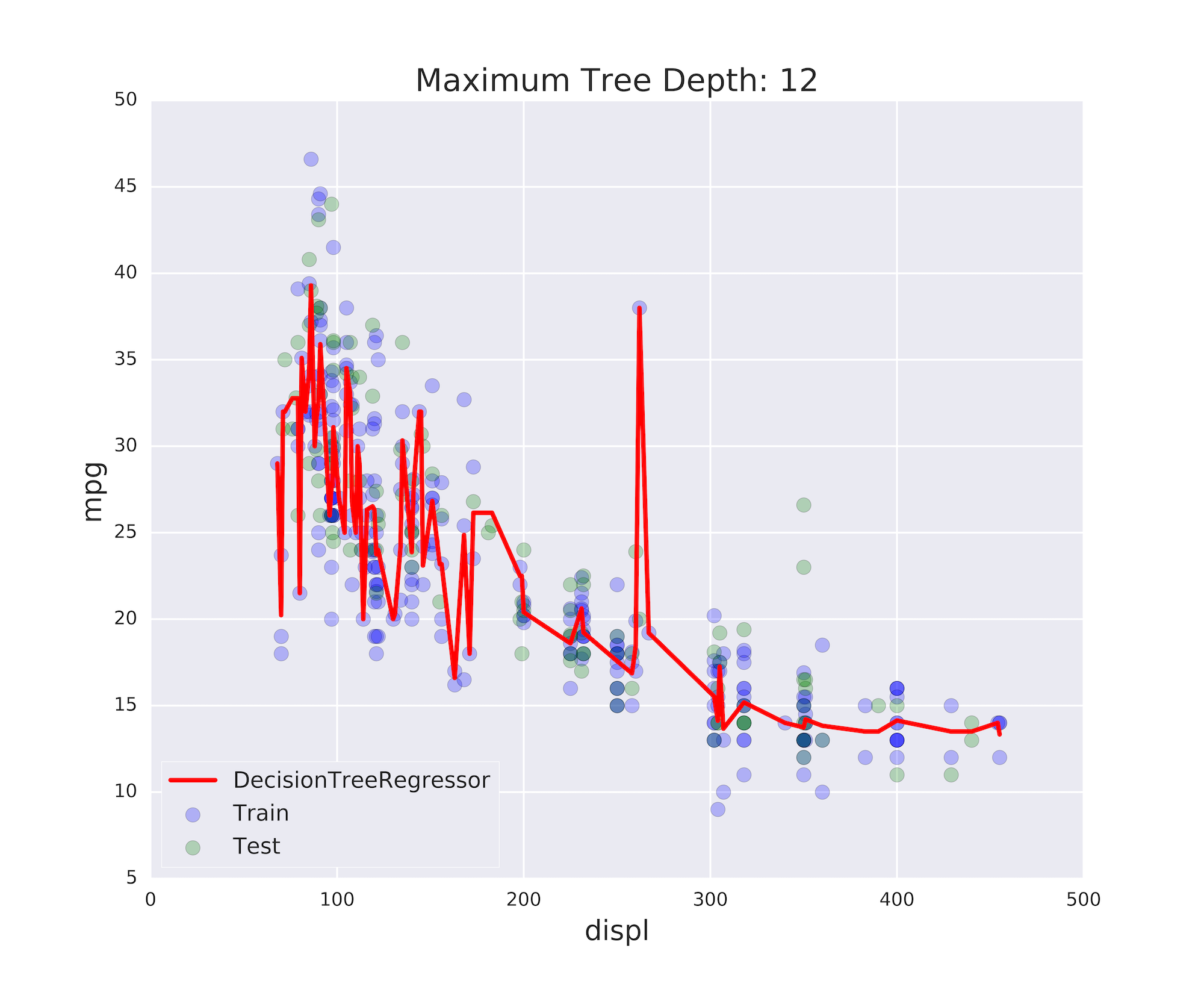

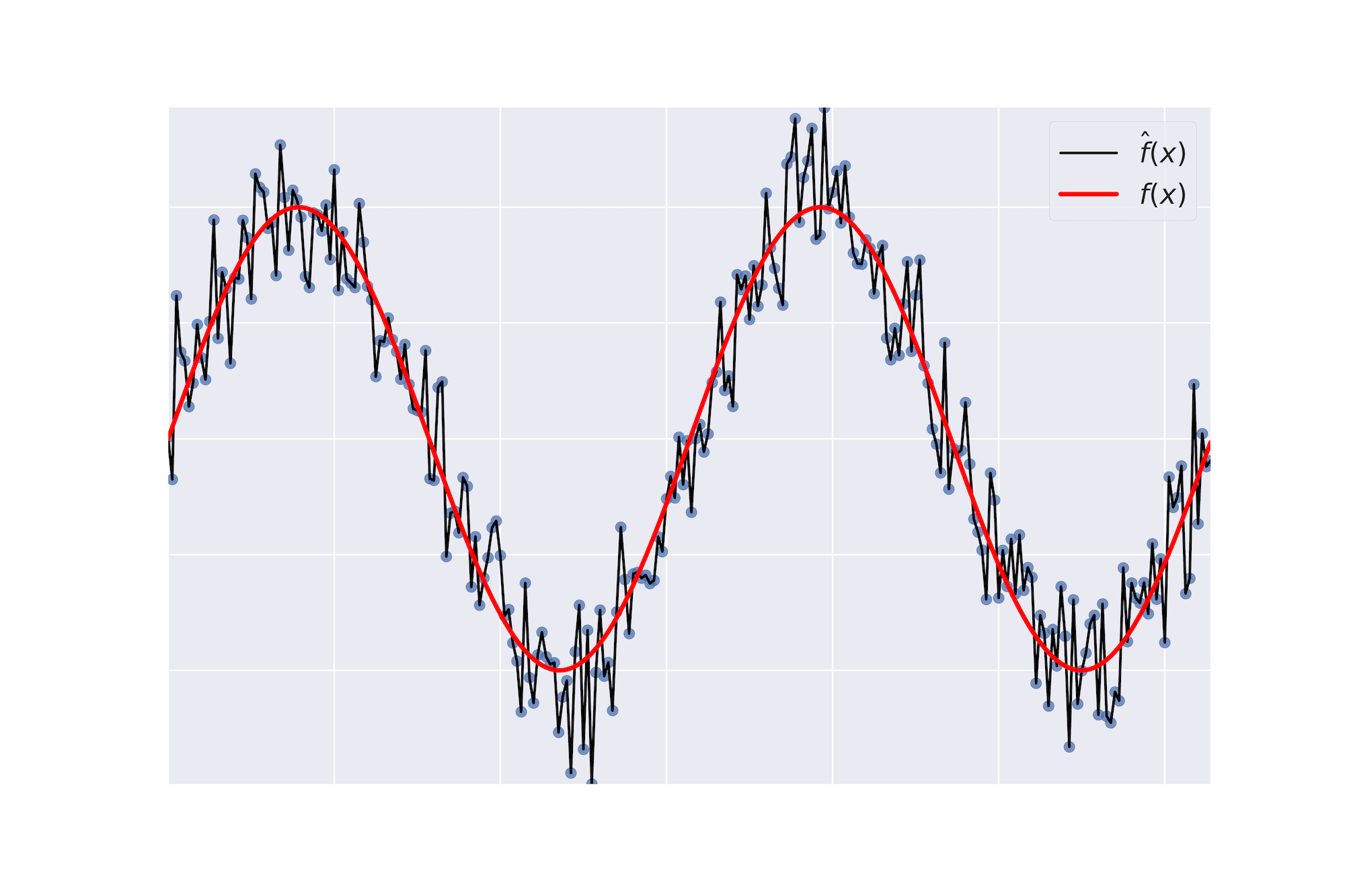

Überanpassung:

$\hat{f}(x)$ passt auf das Rauschen des Trainingsdatensatzes an.

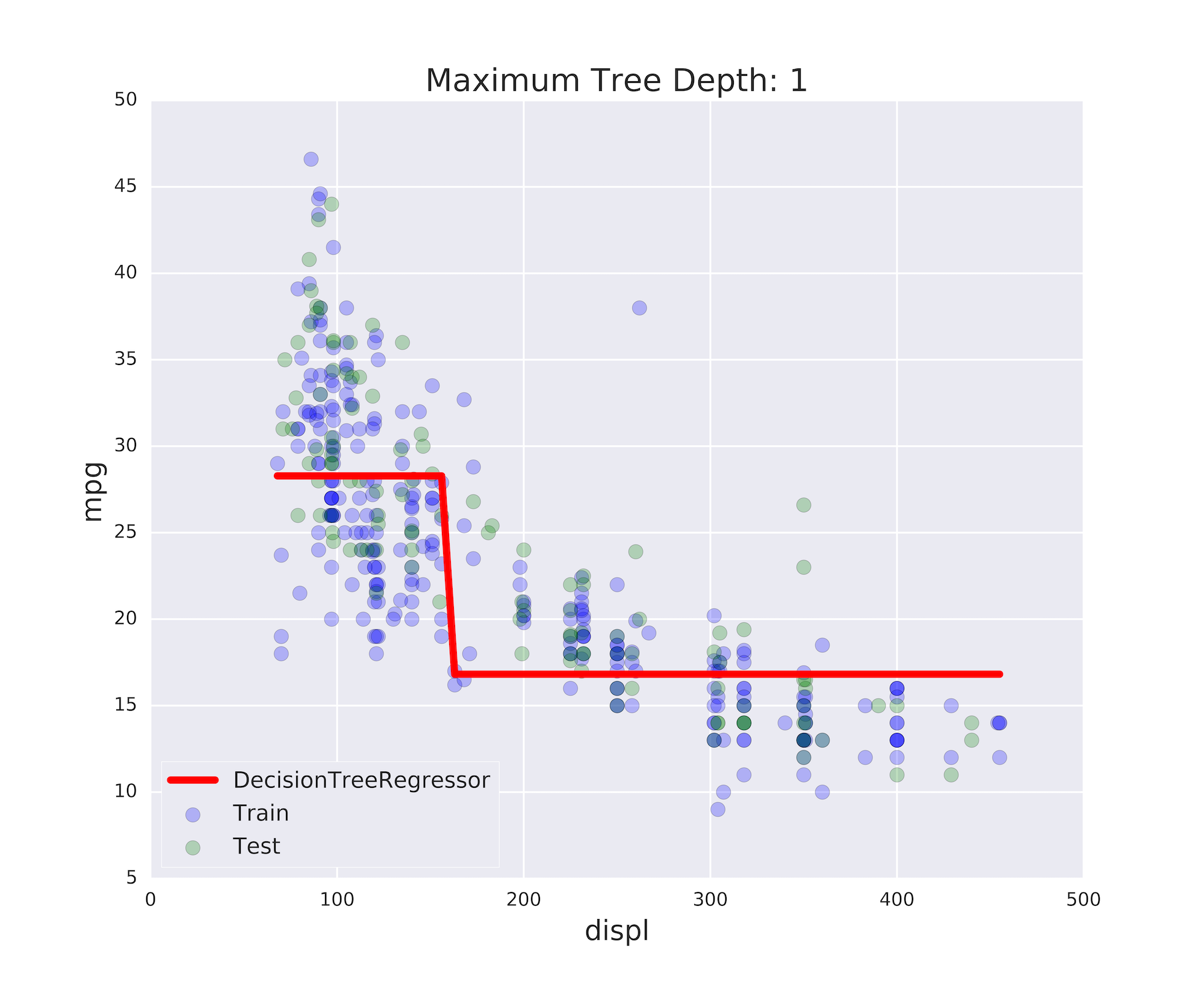

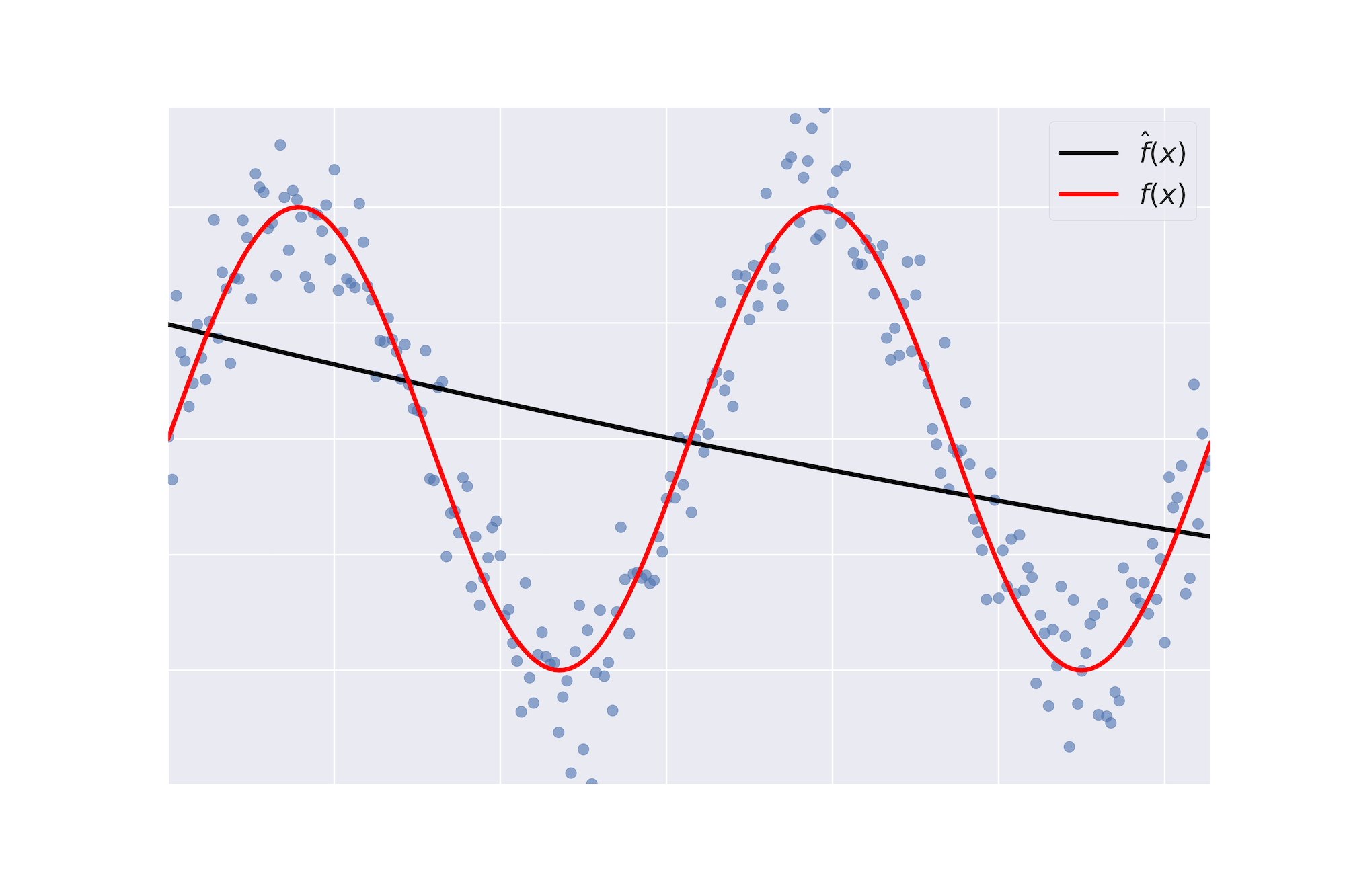

Unteranpassung:

$\hat{f}$ ist nicht flexibel genug, um sich $f$ anzunähern.

Überanpassung

Unteranpassung

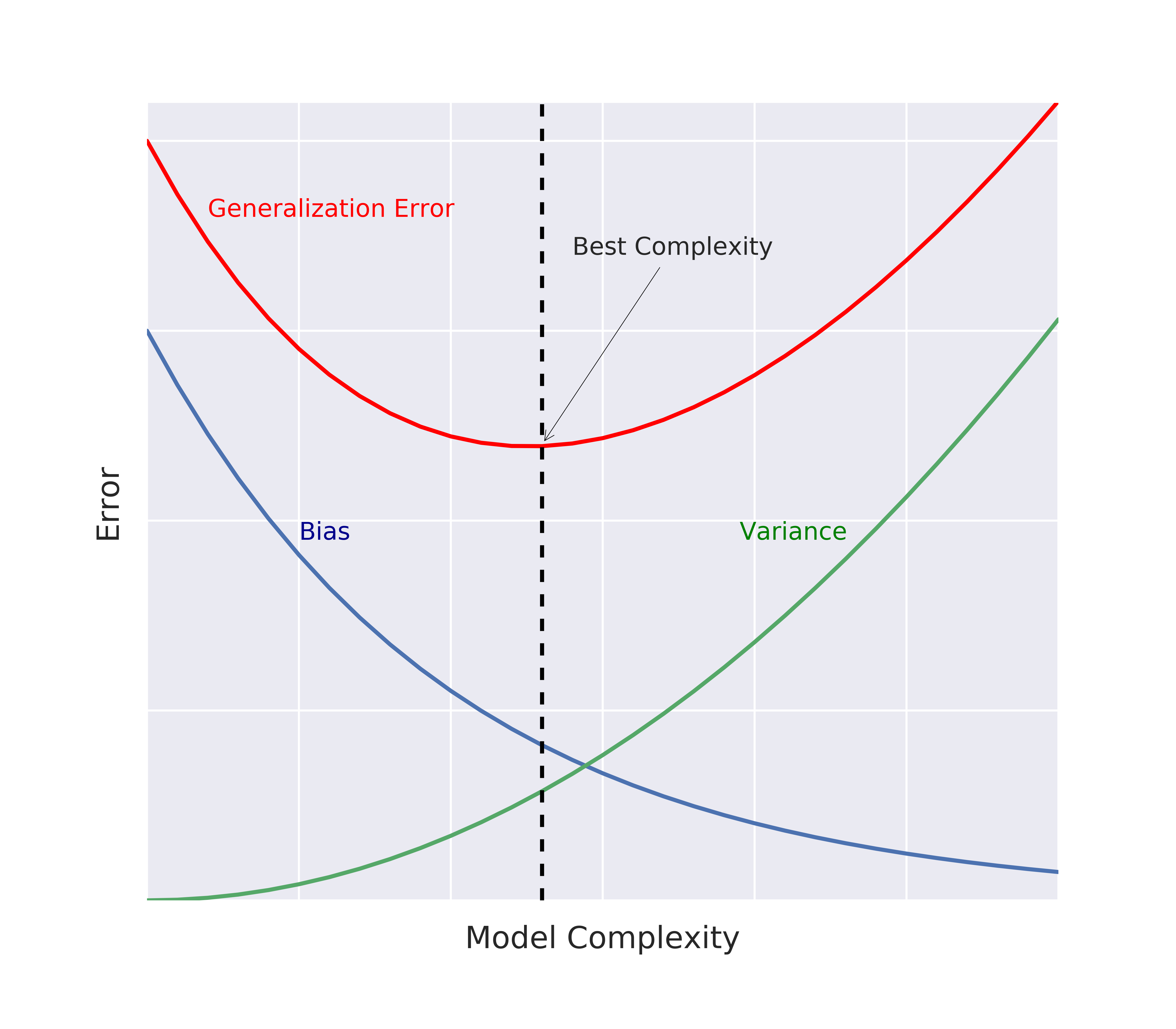

Generalisierungsfehler

Generalisierungsfehler von $\hat{f}$: Generalisiert $\hat{f}$ gut mit unbekannten Daten?

Man kann das wie folgt aufschlüsseln:

Generalisierungsfehler von $\hat{f} = bias^2 + variance + \text{irreducible error}$

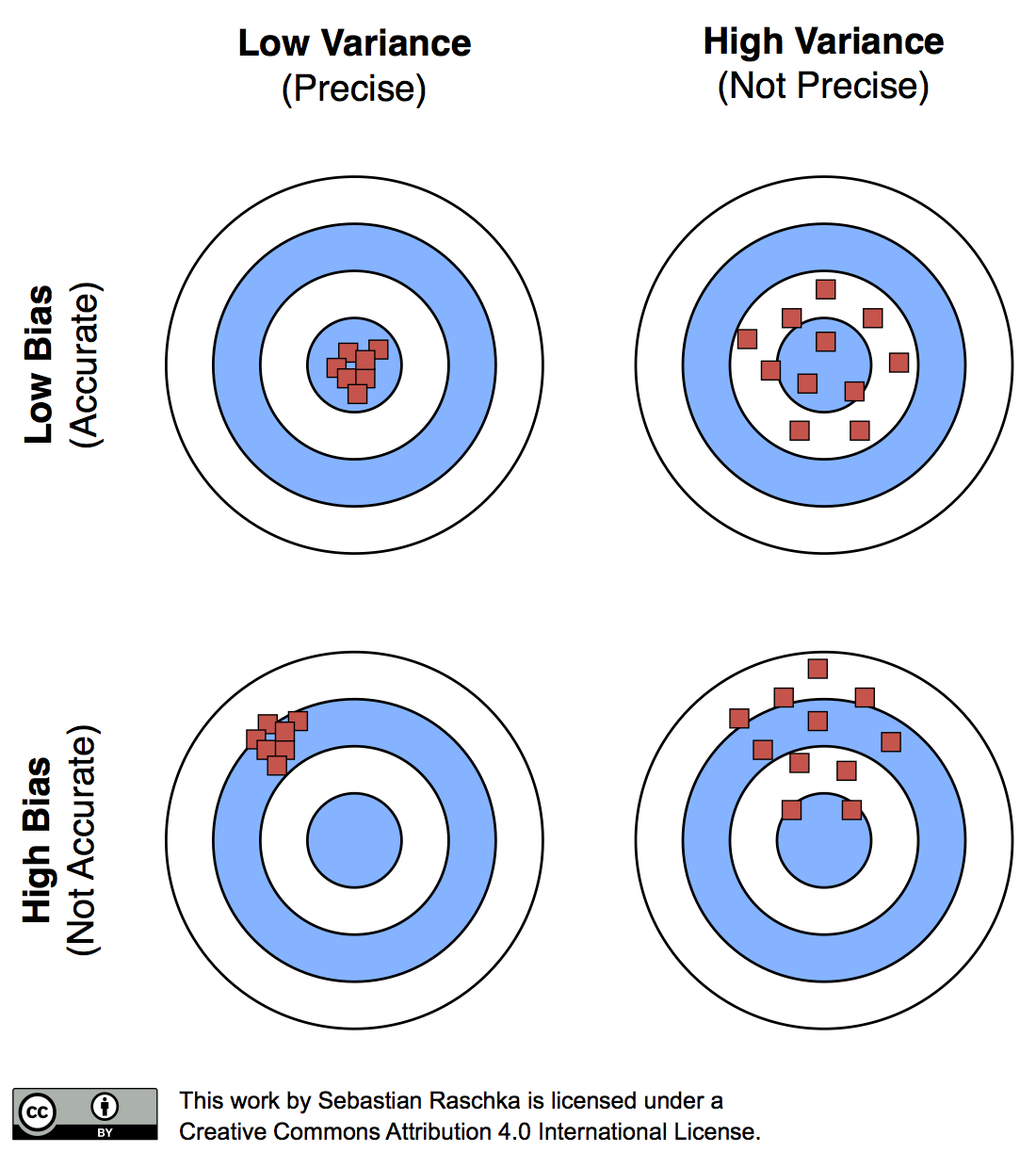

Bias

- Bias: Fehlerbegriff, der dir im Durchschnitt sagt, wie viel $\hat{f} \neq f$.

Varianz

- Varianz: Zeigt dir, wie unbeständig $\hat{f}$ über verschiedene Trainingsdatensätze hinweg ist.

Modellkomplexität

Modellkomplexität: Legt fest, wie flexibel die Funktion $\hat{f}$ ist.

Beispiel: Maximale Baumtiefe, Mindeststichproben pro Blatt

Bias-Varianz-Abwägung

Bias-Varianz-Abwägung: Eine visuelle Erklärung

Lass uns üben!

Maschinelles Lernen mit baumbasierten Modellen in Python