Células LSTM e GRU

Aprendizagem profunda intermediária com PyTorch

Michal Oleszak

Machine Learning Engineer

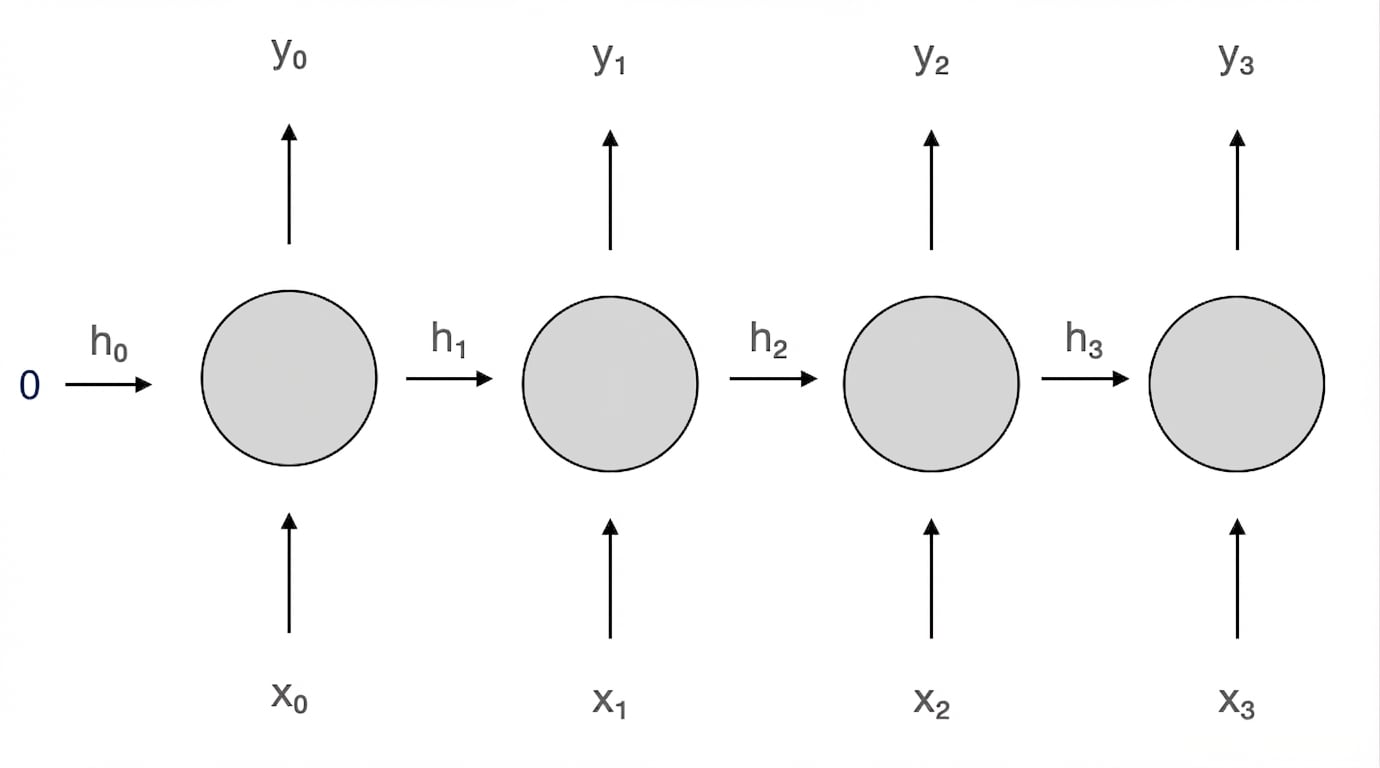

Problema de memória de curto prazo

- Células RNN mantêm memória via estado oculto

- Essa memória é de curtíssimo prazo

- Duas células mais fortes resolvem isso:

- LSTM (Long Short-Term Memory)

- GRU (Gated Recurrent Unit)

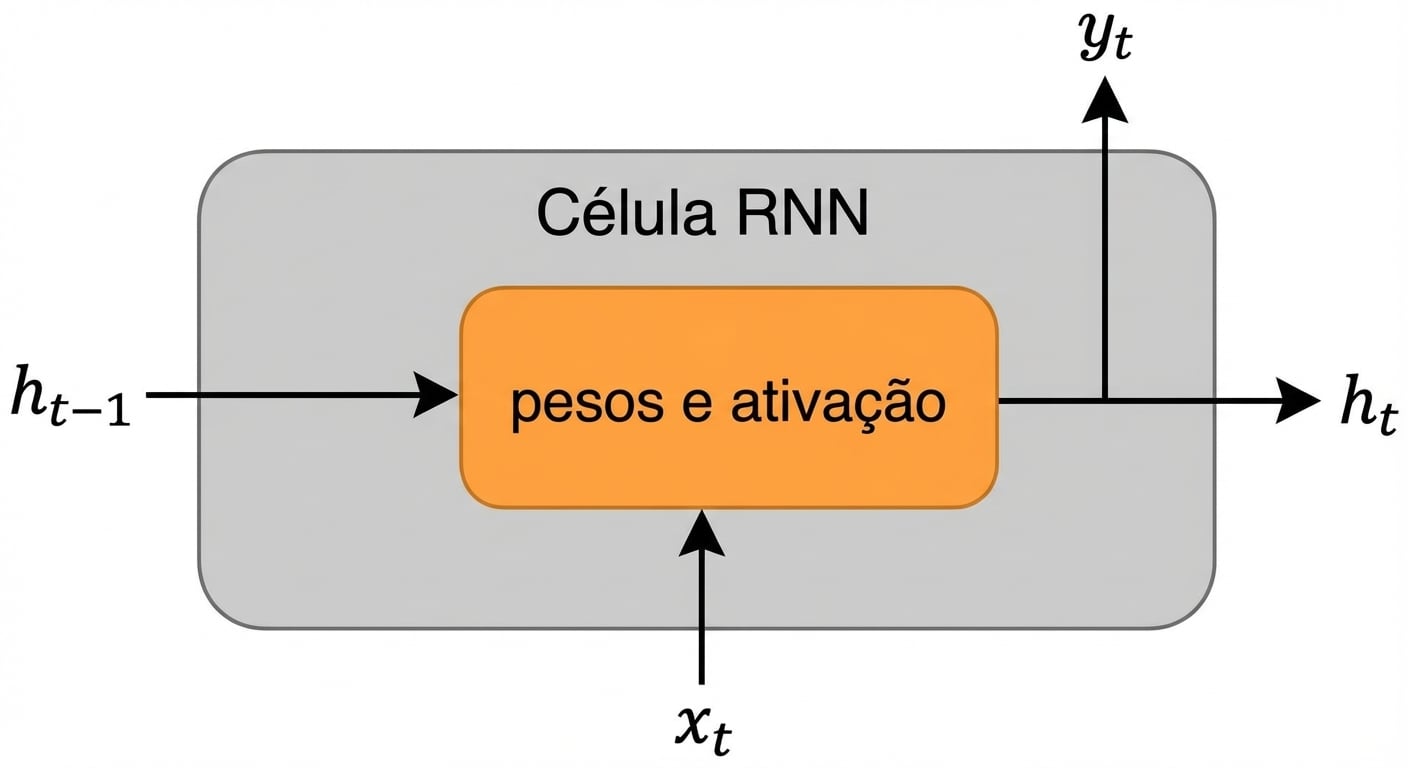

Célula RNN

- Duas entradas:

- dado atual

x - estado oculto anterior

h

- dado atual

- Duas saídas:

- saída atual

y - próximo estado oculto

h

- saída atual

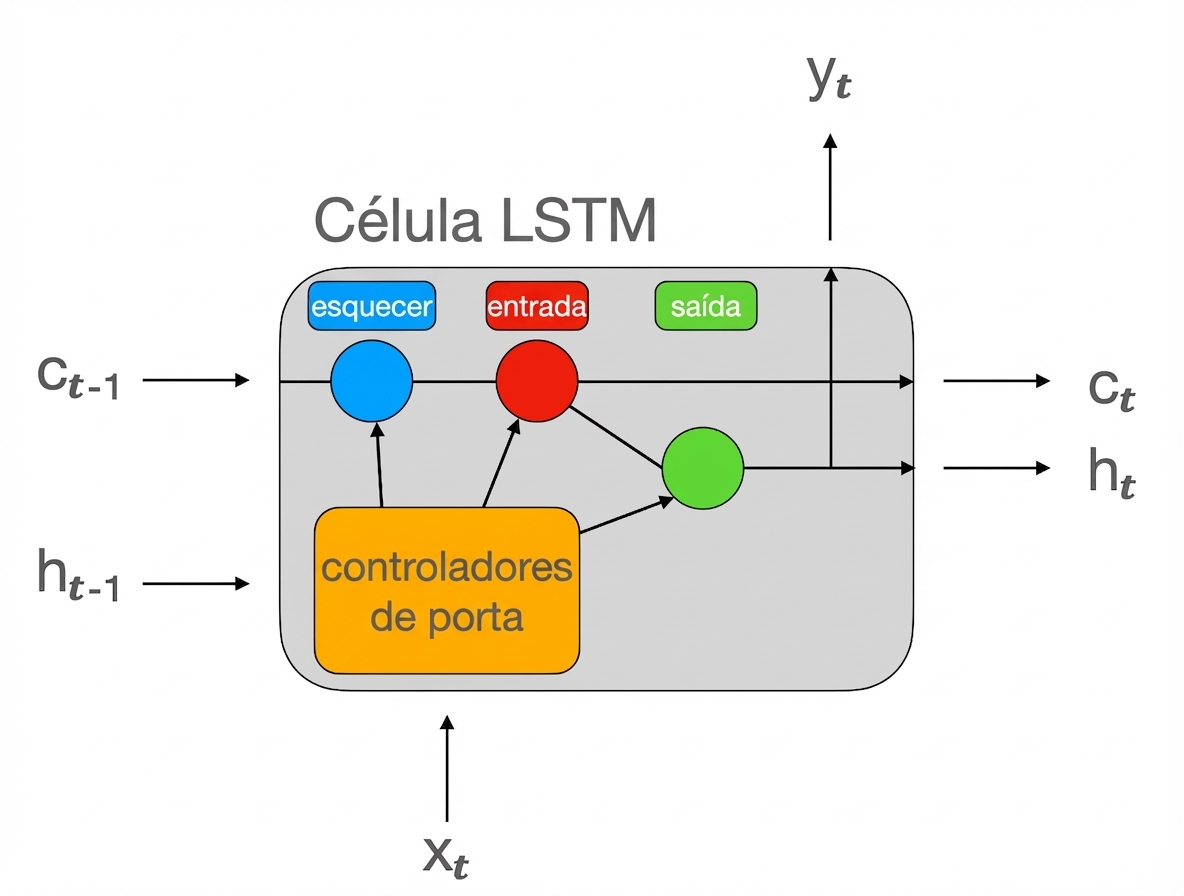

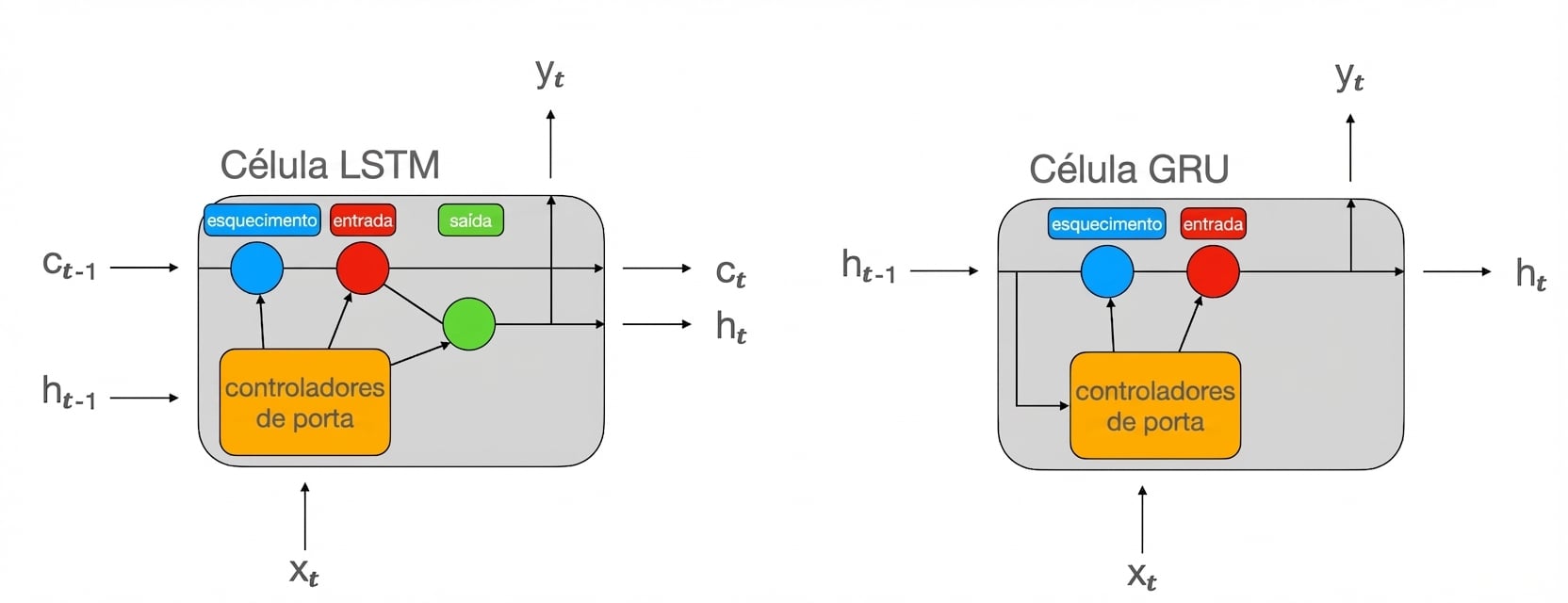

Célula LSTM

- Saídas

heysão iguais

Três entradas e saídas (dois estados ocultos):

h: curto prazoc: longo prazo

Três “portas”:

- Porta de esquecimento: o que remover da memória longa

- Porta de entrada: o que salvar na memória longa

- Porta de saída: o que retornar no passo atual

LSTM no PyTorch

class Net(nn.Module): def __init__(self, input_size): super().__init__()self.lstm = nn.LSTM( input_size=1, hidden_size=32, num_layers=2, batch_first=True, ) self.fc = nn.Linear(32, 1)def forward(self, x): h0 = torch.zeros(2, x.size(0), 32) c0 = torch.zeros(2, x.size(0), 32)out, _ = self.lstm(x, (h0, c0))out = self.fc(out[:, -1, :]) return out

__init__():- Troca

nn.RNNpornn.LSTM

- Troca

forward():- Adiciona outro estado oculto

c - Inicializa

cehcom zeros - Passa ambos os estados para a camada

lstm

- Adiciona outro estado oculto

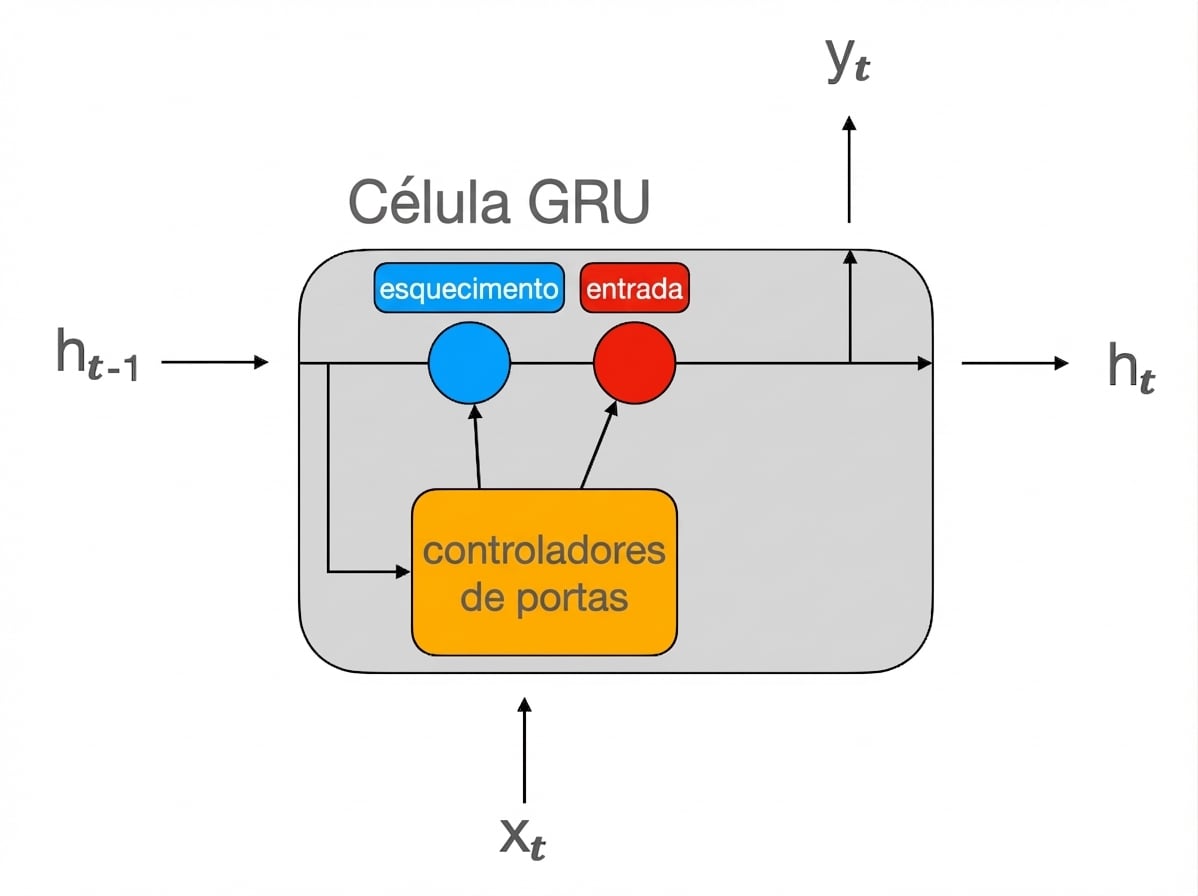

Célula GRU

- Versão simplificada da LSTM

- Só um estado oculto

- Sem porta de saída

GRU no PyTorch

class Net(nn.Module): def __init__(self, input_size): super().__init__()self.gru = nn.GRU( input_size=1, hidden_size=32, num_layers=2, batch_first=True, ) self.fc = nn.Linear(32, 1)def forward(self, x): h0 = torch.zeros(2, x.size(0), 32) out, _ = self.gru(x, h0) out = self.fc(out[:, -1, :]) return out

__init__():- Troca

nn.RNNpornn.GRU

- Troca

forward():- Usa a camada

gru

- Usa a camada

Uso RNN, LSTM ou GRU?

- RNN quase não é mais usada

- GRU é mais simples que LSTM = menos computação

- Desempenho relativo varia por caso de uso

- Testa as duas e compara

Vamos praticar!

Aprendizagem profunda intermediária com PyTorch