Células LSTM y GRU

Aprendizaje profundo intermedio con PyTorch

Michal Oleszak

Machine Learning Engineer

Problema de memoria a corto plazo

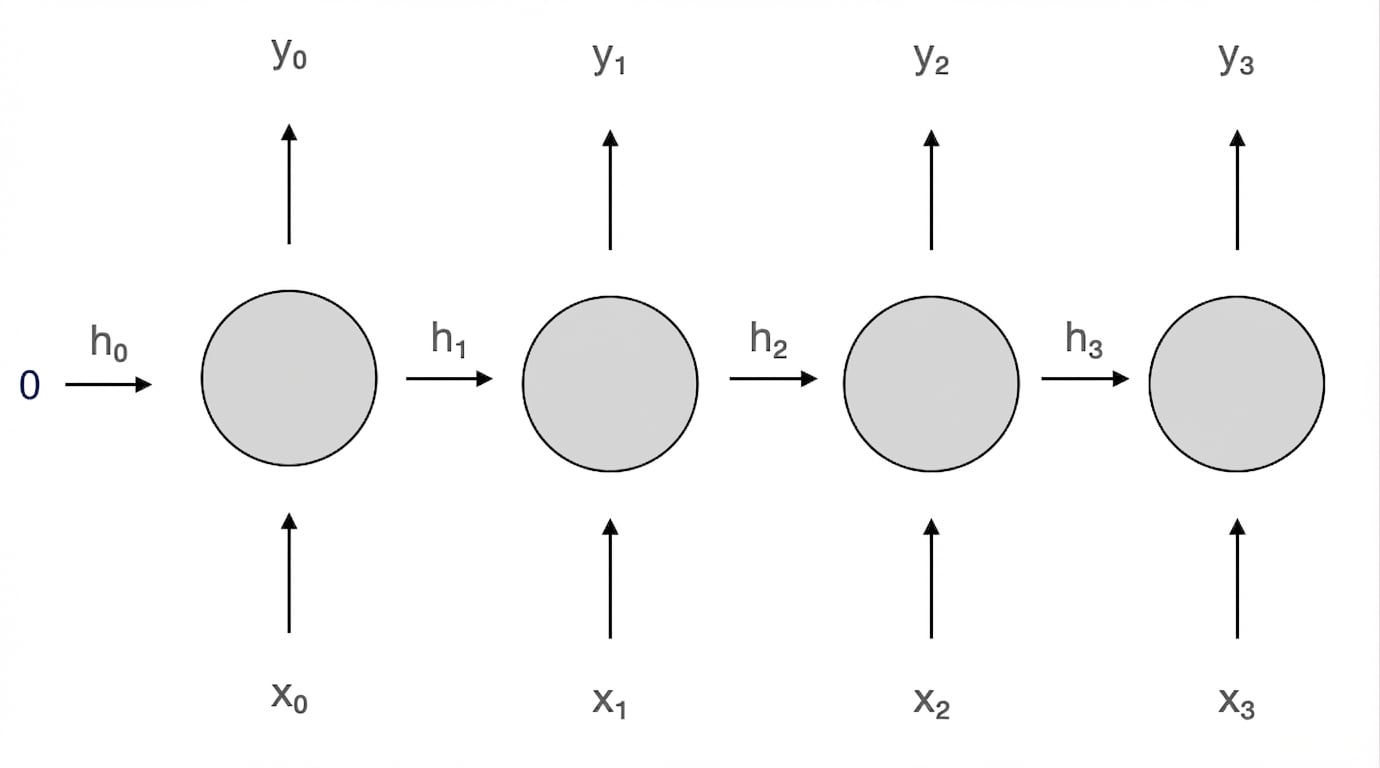

- Las células RNN mantienen la memoria a través de un estado oculto.

- Esta memoria es muy a corto plazo.

- Dos celdas más potentes resuelven el problema:

- Célula LSTM (memoria a corto y largo plazo)

- Célula GRU (unidad recurrente con puerta)

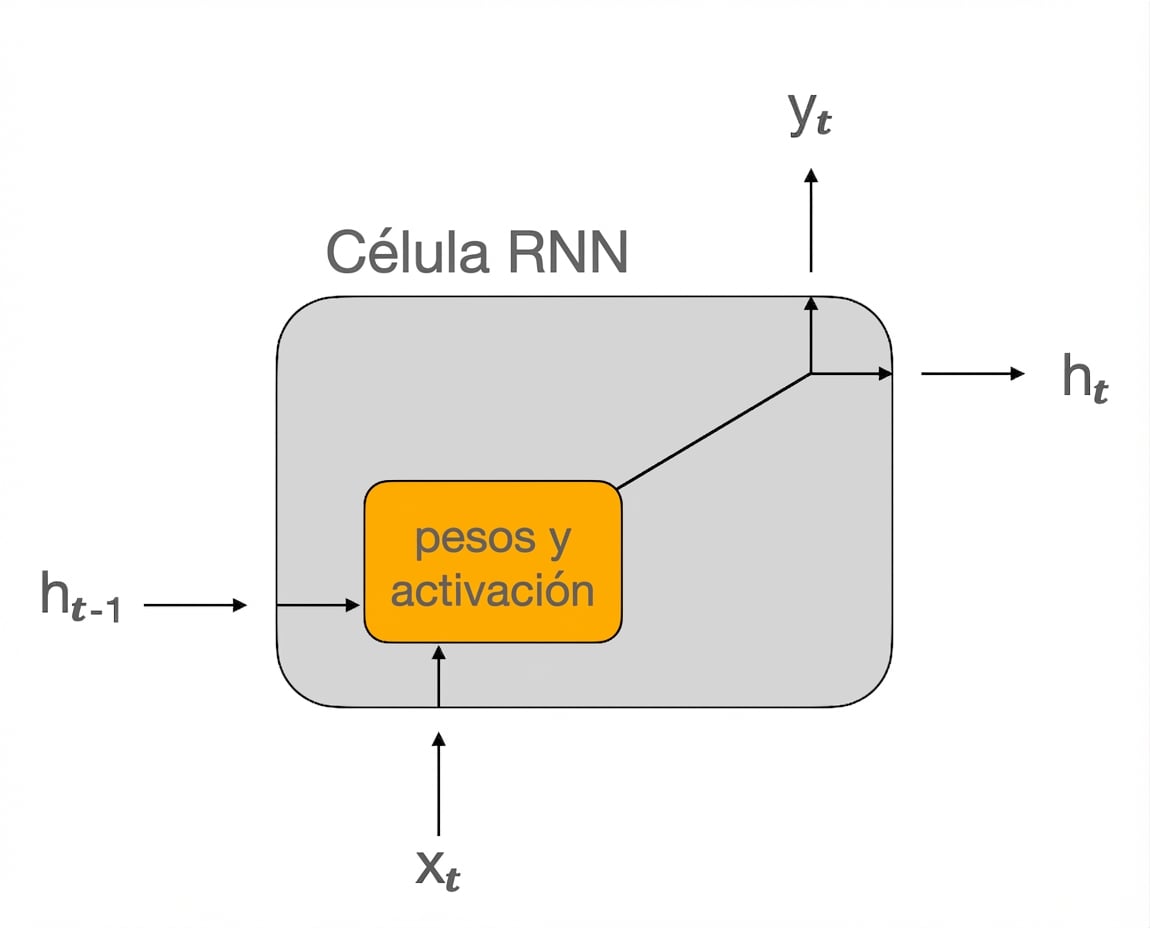

célula RNN

- Dos entradas:

- datos de entrada actuales

x - estado oculto anterior

h

- datos de entrada actuales

- Dos salidas:

- salida de corriente

y - siguiente estado oculto

h

- salida de corriente

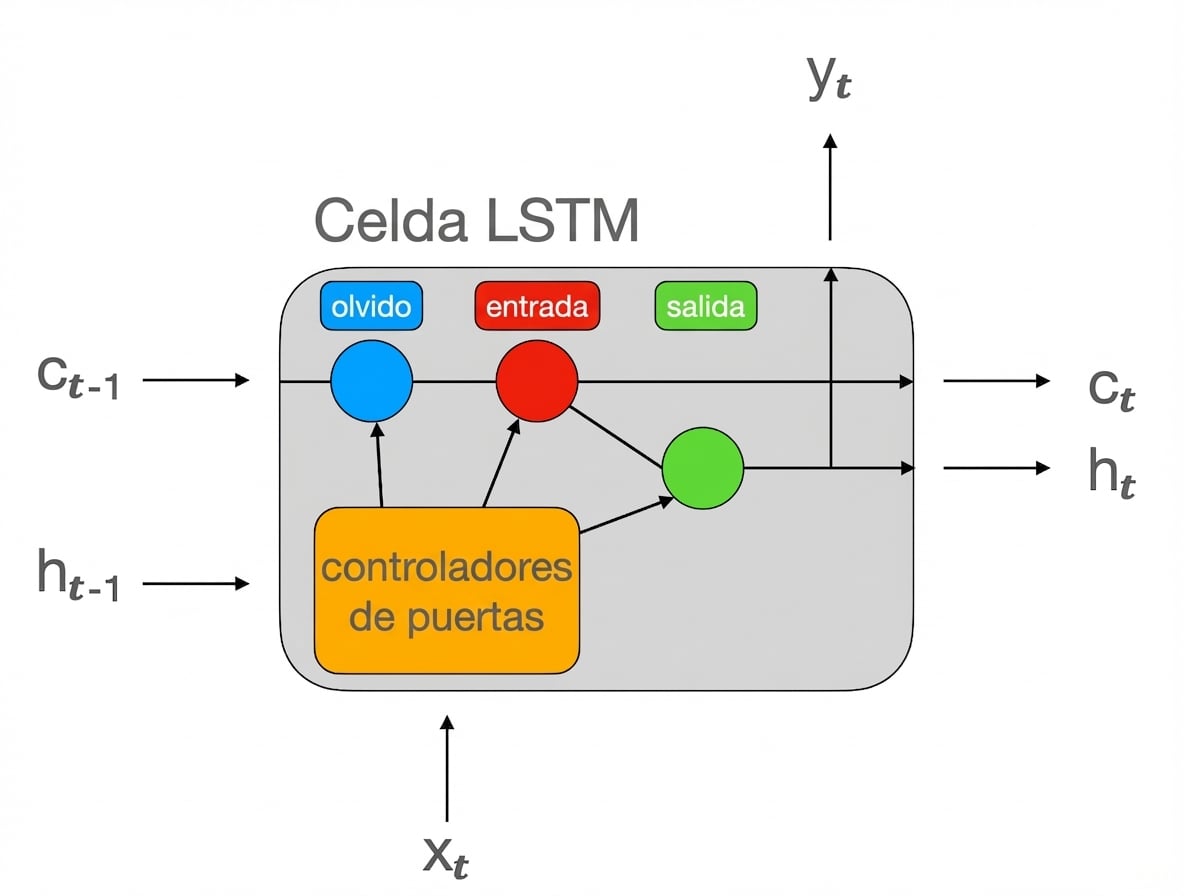

celda LSTM

- Los resultados

hyyson los mismos.

Tres entradas y salidas (dos estados ocultos):

h: estado a corto plazoc: estado a largo plazo

Tres «puertas»:

- Olvídate de la puerta: qué eliminar de la memoria a largo plazo

- Puerta de entrada: qué guardar en la memoria a largo plazo

- Puerta de salida: qué devolver en el paso de tiempo actual.

LSTM en PyTorch

class Net(nn.Module): def __init__(self, input_size): super().__init__()self.lstm = nn.LSTM( input_size=1, hidden_size=32, num_layers=2, batch_first=True, ) self.fc = nn.Linear(32, 1)def forward(self, x): h0 = torch.zeros(2, x.size(0), 32) c0 = torch.zeros(2, x.size(0), 32)out, _ = self.lstm(x, (h0, c0))out = self.fc(out[:, -1, :]) return out

__init__():- Sustituir

nn.RNNpornn.LSTM

- Sustituir

forward():- Añade otro estado oculto

c - Inicializa

cyhcon ceros. - Pasa ambos estados ocultos a una cap

lstm.

- Añade otro estado oculto

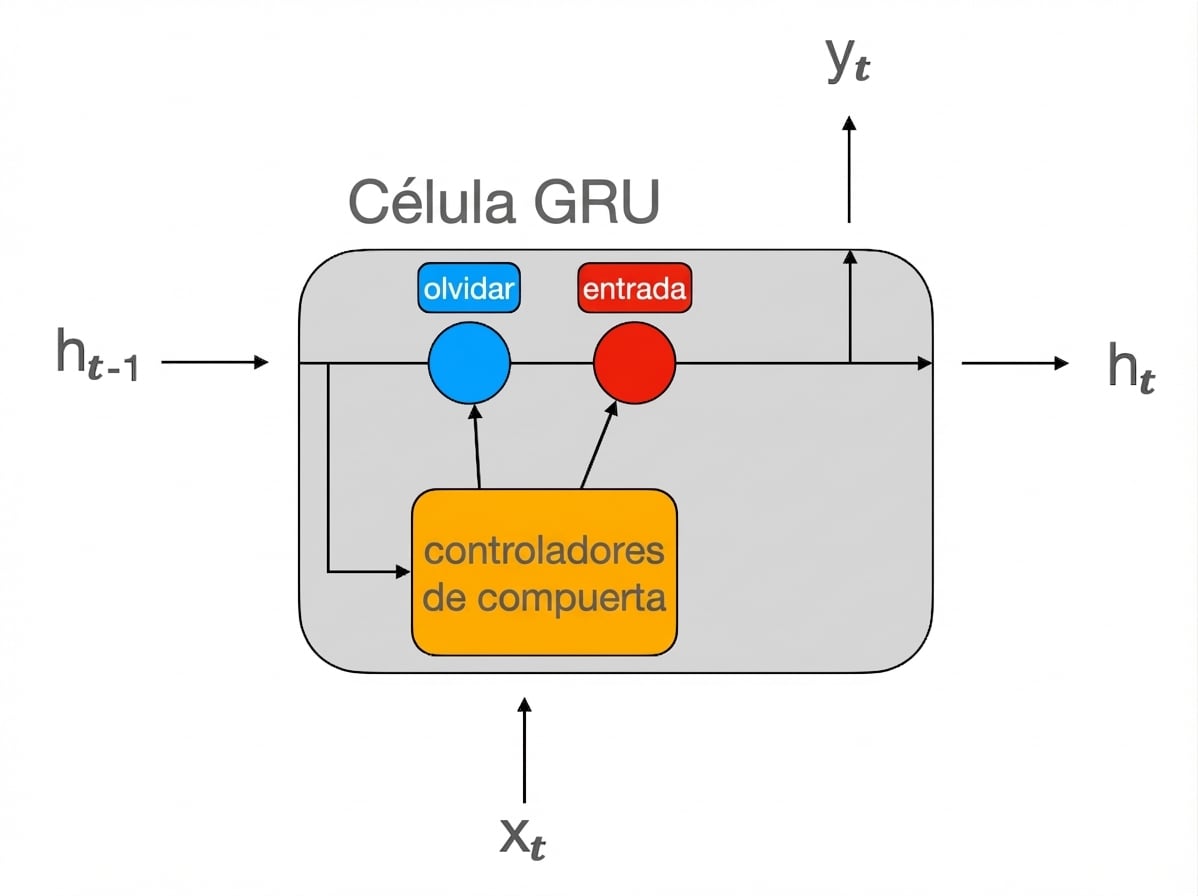

célula GRU

- Versión simplificada de la celda LSTM

- Solo un estado oculto

- Sin salida de puerta

GRU en PyTorch

class Net(nn.Module): def __init__(self, input_size): super().__init__()self.gru = nn.GRU( input_size=1, hidden_size=32, num_layers=2, batch_first=True, ) self.fc = nn.Linear(32, 1)def forward(self, x): h0 = torch.zeros(2, x.size(0), 32) out, _ = self.gru(x, h0) out = self.fc(out[:, -1, :]) return out

__init__():- Sustituir

nn.RNNpornn.GRU

- Sustituir

forward():- Utiliza la capa «

gru» (Ajustes globales).

- Utiliza la capa «

¿Debería usar RNN, LSTM o GRU?

- Las RNN ya no se utilizan mucho.

- GRU es más sencillo que LSTM = menos computación

- El rendimiento relativo varía según el caso de uso.

- Prueba ambos y compara.

¡Vamos a practicar!

Aprendizaje profundo intermedio con PyTorch