Techniques d'apprentissage

Concepts des grands modèles de langage (LLM)

Vidhi Chugh

AI strategist and ethicist

Où sommes-nous ?

Dépasser les contraintes liées aux données

- Affinage : entraînement d'un modèle pré-entraîné pour une tâche spécifique

- Cependant, que faire s'il y a peu ou pas de données étiquetées ?

- * Apprentissage N-shot : zero-shot, few-shot et multi-shot

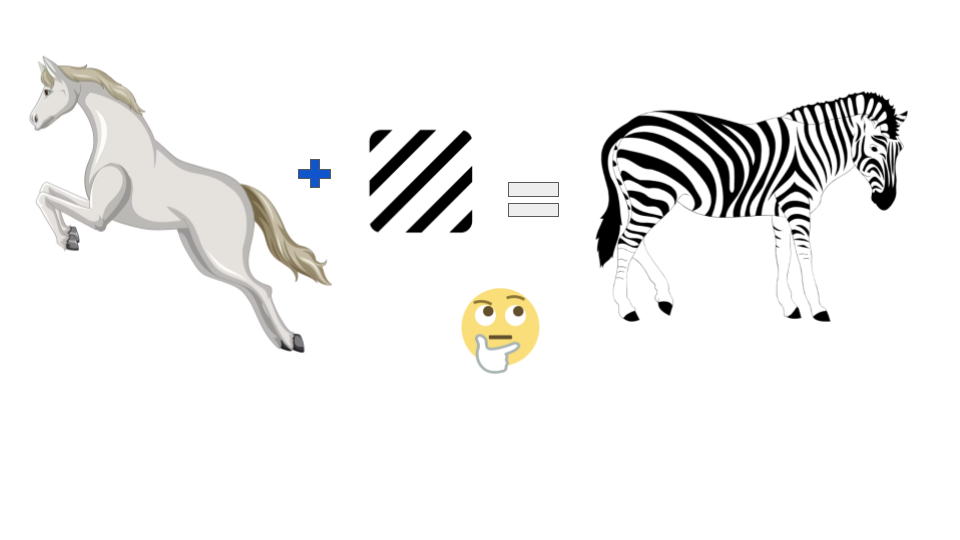

Apprentissage par transfert

- Tirer des enseignements d'une tâche et les appliquer à une tâche connexe

- Transférer des connaissances en piano vers la guitare

- Lecture des notes de musique

- Compréhension du rythme

- Compréhension des concepts musicaux

- Apprentissage N-shot

- Zero-shot - Aucune donnée spécifique à la tâche

- Few-shot - Peu de données spécifiques à la tâche

- Multi-shot - Données d'entraînement relativement plus importantes

Apprentissage zero-shot

- Aucun entraînement spécifique

- Utilise la compréhension du langage et le contexte

- Généralise sans exemples préalables

1 Freepik

Apprentissage few-shot

- Apprendre une nouvelle tâche à l'aide de quelques exemples

- Apprentissage one-shot : l’affinage à partir d’un seul exemple

- Connaissances préalables pour répondre à une nouvelle question

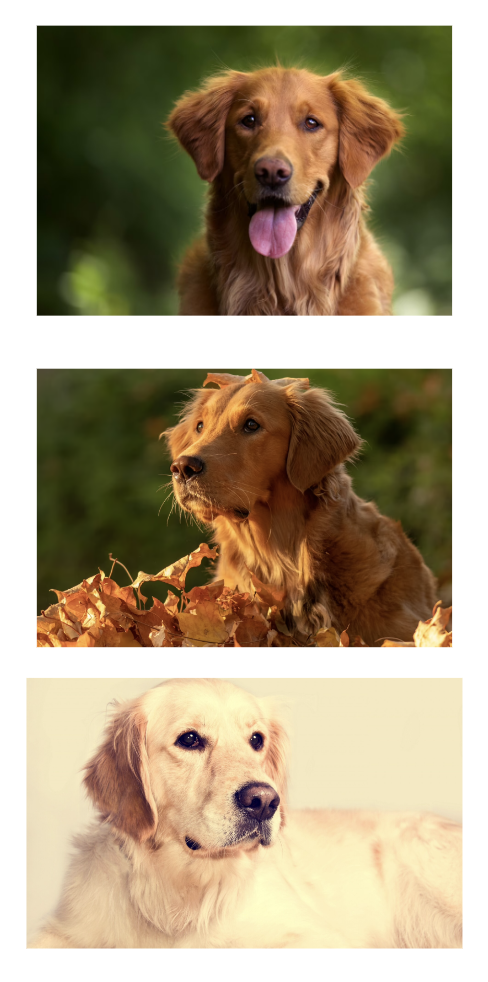

Apprentissage multi-shot

- Nécessite davantage d'exemples que le few-shot

- Tâches précédentes, ainsi que de nouveaux exemples

- Par exemple, un modèle entraîné sur un Golden Retriever

1 Freepik

Apprentissage multi-shot

- Résultat du modèle : Labrador Retriever

- Permet de gagner du temps dans la collecte et l'étiquetage des données.

- Aucun compromis sur la précision

1 Freepik

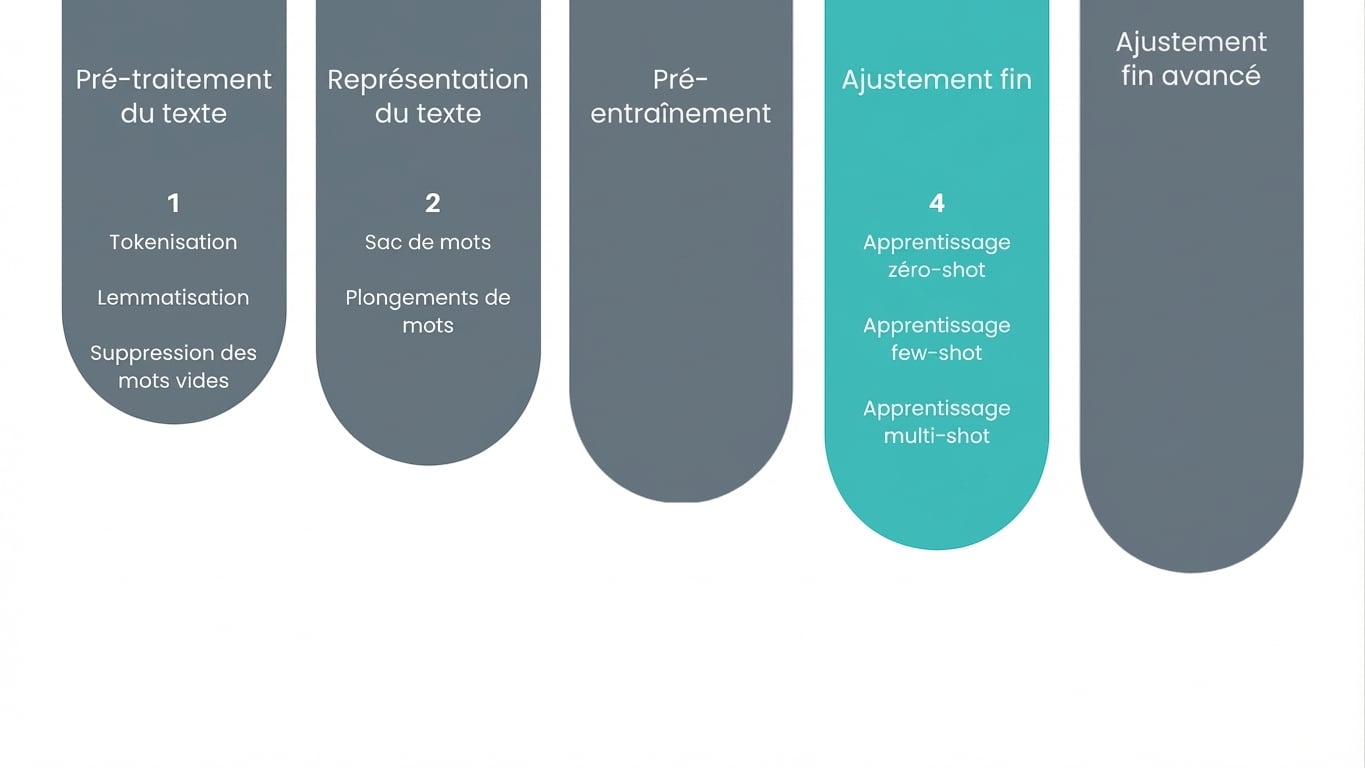

Les éléments constitutifs jusqu'à présent

- Processus de préparation des données

- Affinage

- Techniques d'apprentissage N-shot

- Étape suivante : pré-entraînement

Passons à la pratique !

Concepts des grands modèles de langage (LLM)