Présentation du Transformer

Concepts des grands modèles de langage (LLM)

Vidhi Chugh

AI strategist and ethicist

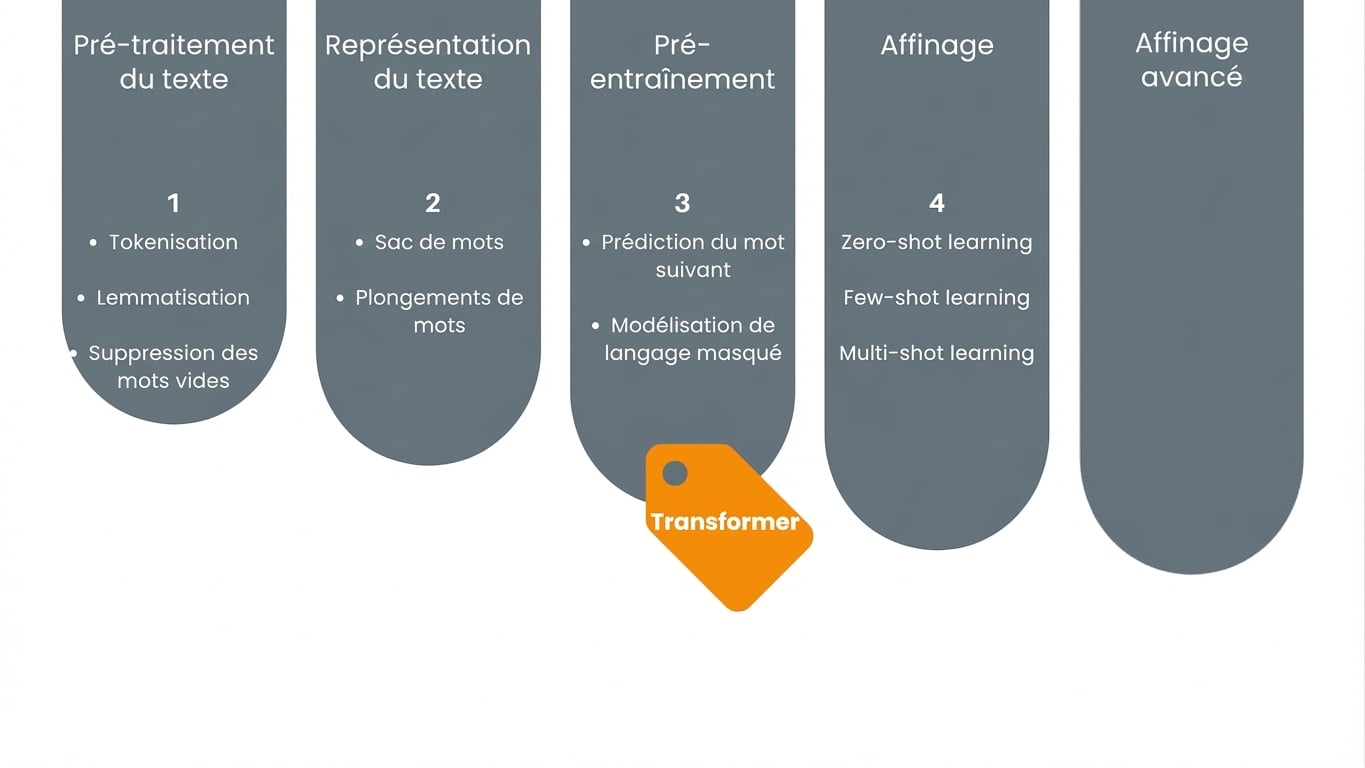

Où sommes-nous ?

Qu'est-ce qu'un Transformer ?

- « L'attention est tout ce dont vous avez besoin »

- Modélisation linguistique innovante

- Architecture de Transformer

- Relation entre les mots

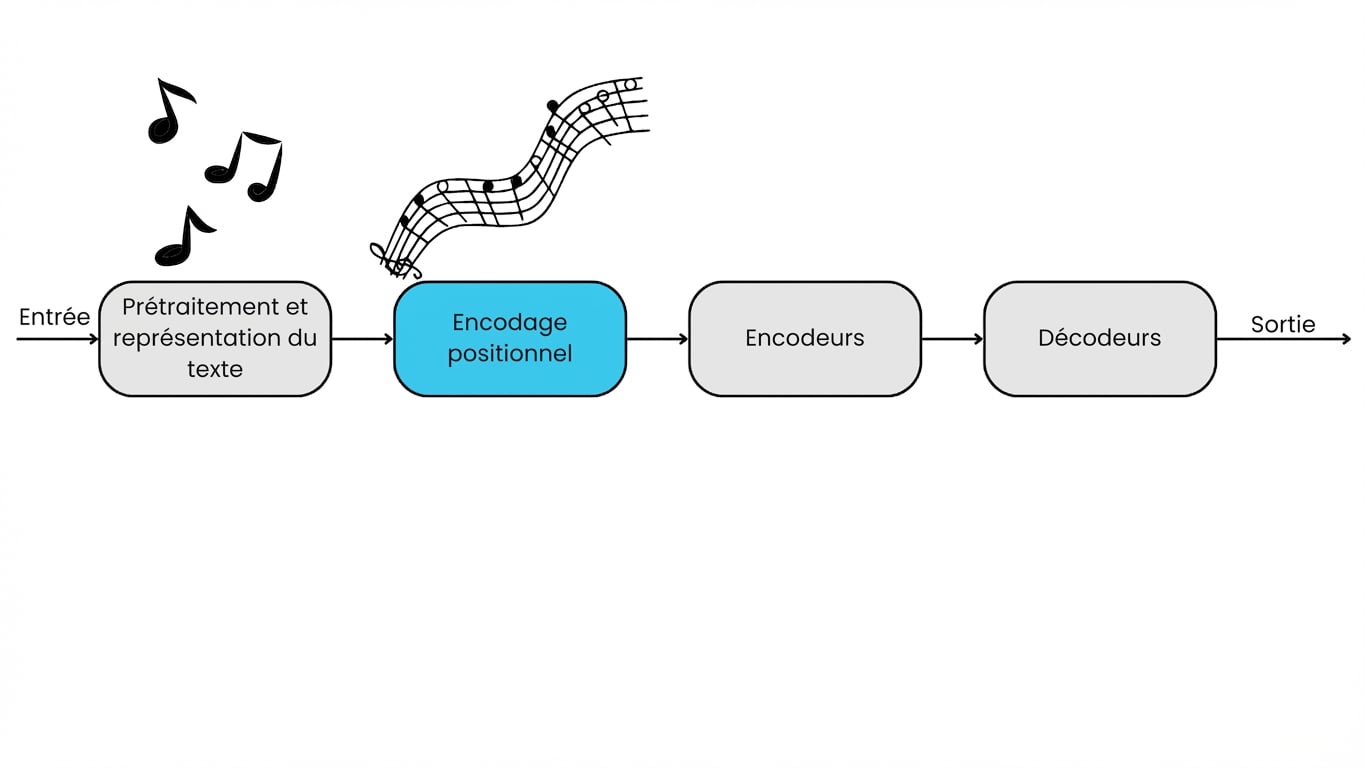

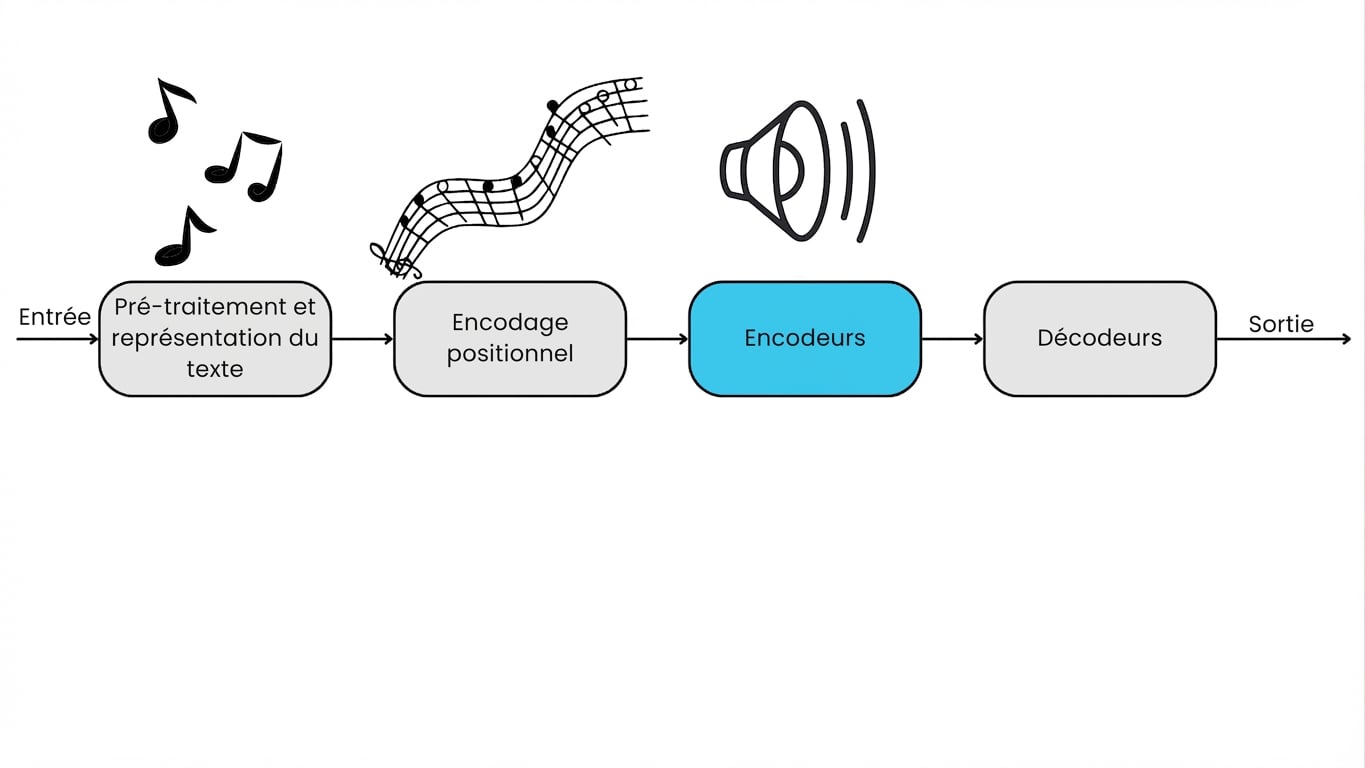

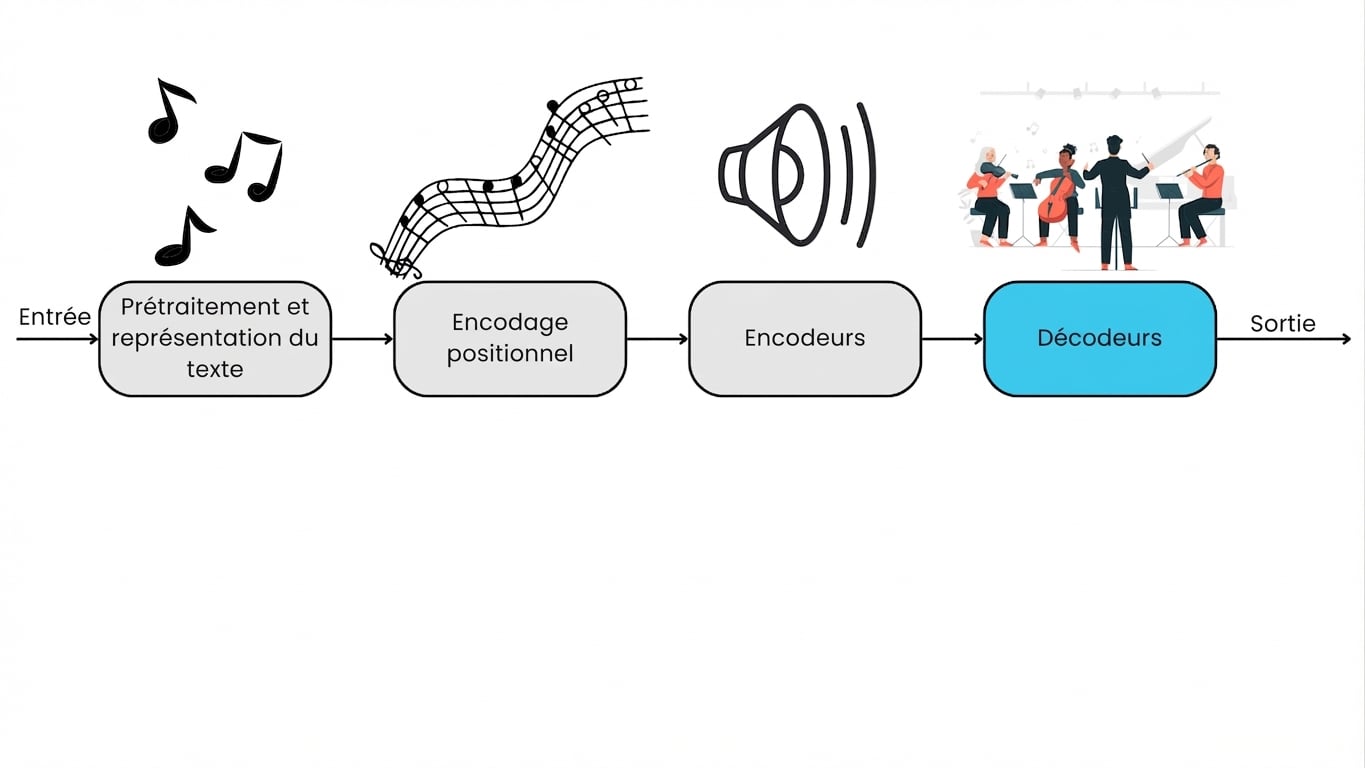

- Composants : Pré-traitement, encodage positionnel, encodeurs et décodeurs

1 arXiv : L'attention est tout ce dont vous avez besoin

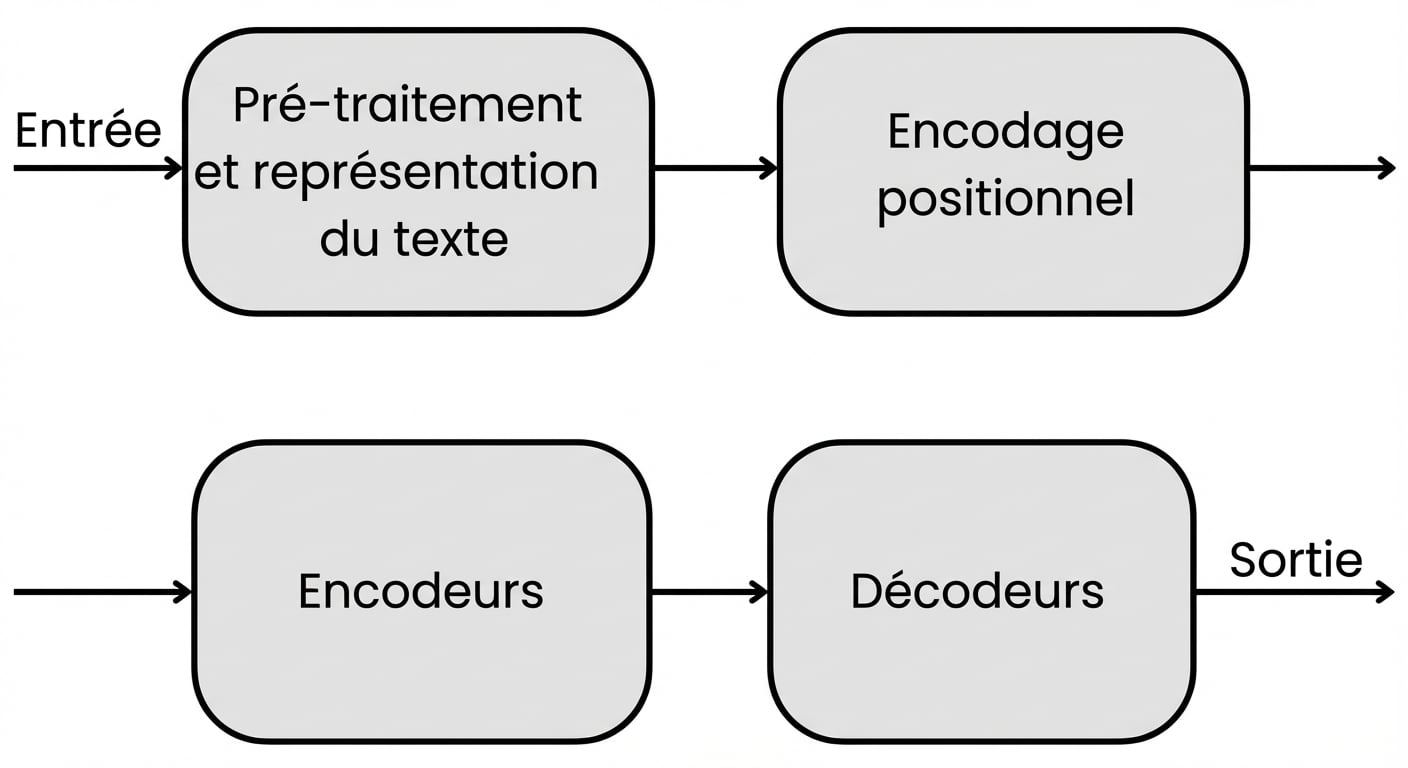

À l'intérieur du Transformer

- Entrée : Jane, qui réside à New York et occupe un poste dans le domaine des logiciels

- Sortie : ingénieure, apprécie découvrir de nouveaux restaurants dans la ville.

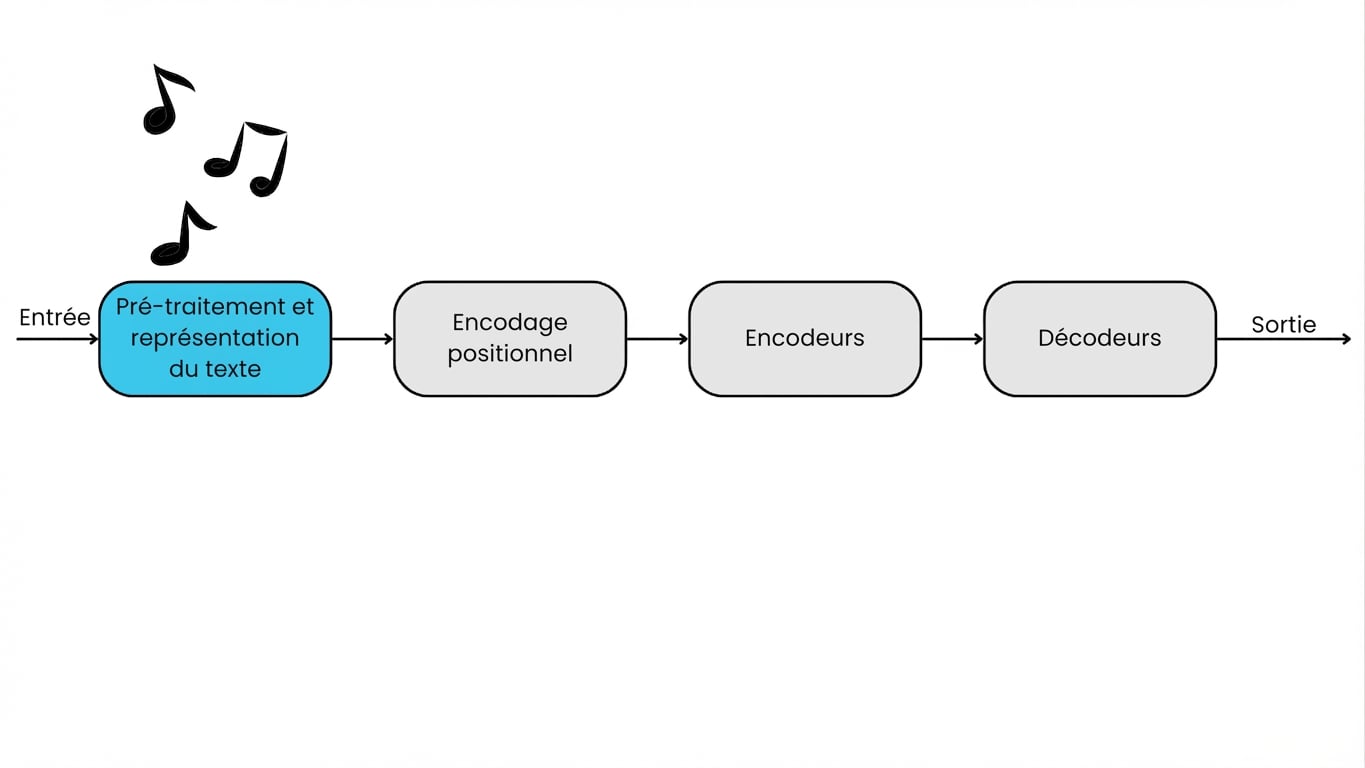

Les Transformers sont comparables à un orchestre.

Pré-traitement et représentation du texte

- Pré-traitement du texte : tokenisation, suppression des mots vides, lemmatisation

- Représentation textuelle : plongement lexical

Encodage positionnel

- Informations sur la position de chaque mot

- Comprendre les mots éloignés

Encodeurs

- Mécanisme d'attention : dirige l'attention vers des mots et des relations spécifiques.

- Réseau neuronal : traiter des caractéristiques spécifiques

Décodeurs

- Comprend l'attention et les réseaux neuronaux

- Génère la sortie

Transformers et dépendances de mots éloignés

- Défi initial : dépendance des mots éloignés

- Attention : se concentre sur les différentes parties de l'entrée.

Exemple : « Jane, qui réside à New York et occupe le poste d'ingénieure en informatique, apprécie découvrir de nouveaux restaurants dans la ville. »

« Jane » — « apprécie découvrir de nouveaux restaurants »

Traite plusieurs parties en même temps

- Limites des modèles de langage traditionnels :

- Séquentiel - un mot à la fois

- Transformers :

- Traitent plusieurs parties à la fois

- Traitement plus rapide

- Par exemple :

- « Le chat s'est assis sur le tapis. »

- Traite simultanément les mots « chat », « assis », « sur », « le » et « tapis ».

Passons à la pratique !

Concepts des grands modèles de langage (LLM)