Créer un pipeline de production

Introduction à Apache Airflow en Python

Mike Metzger

Data Engineer

Exécuter des DAGs et des tâches

Pour exécuter une tâche précise en ligne de commande :

airflow tasks test <dag_id> <task_id> <date>

Pour exécuter un DAG complet :

airflow dags trigger -e <date> <dag_id>

Rappel des opérateurs

- BashOperator — attend un

bash_command - PythonOperator — attend un

python_callable - BranchPythonOperator — requiert un

python_callableetprovide_context=True. Le callable doit accepter**kwargs. - FileSensor — requiert l’argument

filepathet peut nécessiter les attributsmodeoupoke_interval

Rappels sur les templates

- De nombreux objets Airflow acceptent des modèles (templates)

- Certains champs acceptent des chaînes modélisées, d’autres non

- Pour vérifier, utilisez la documentation intégrée :

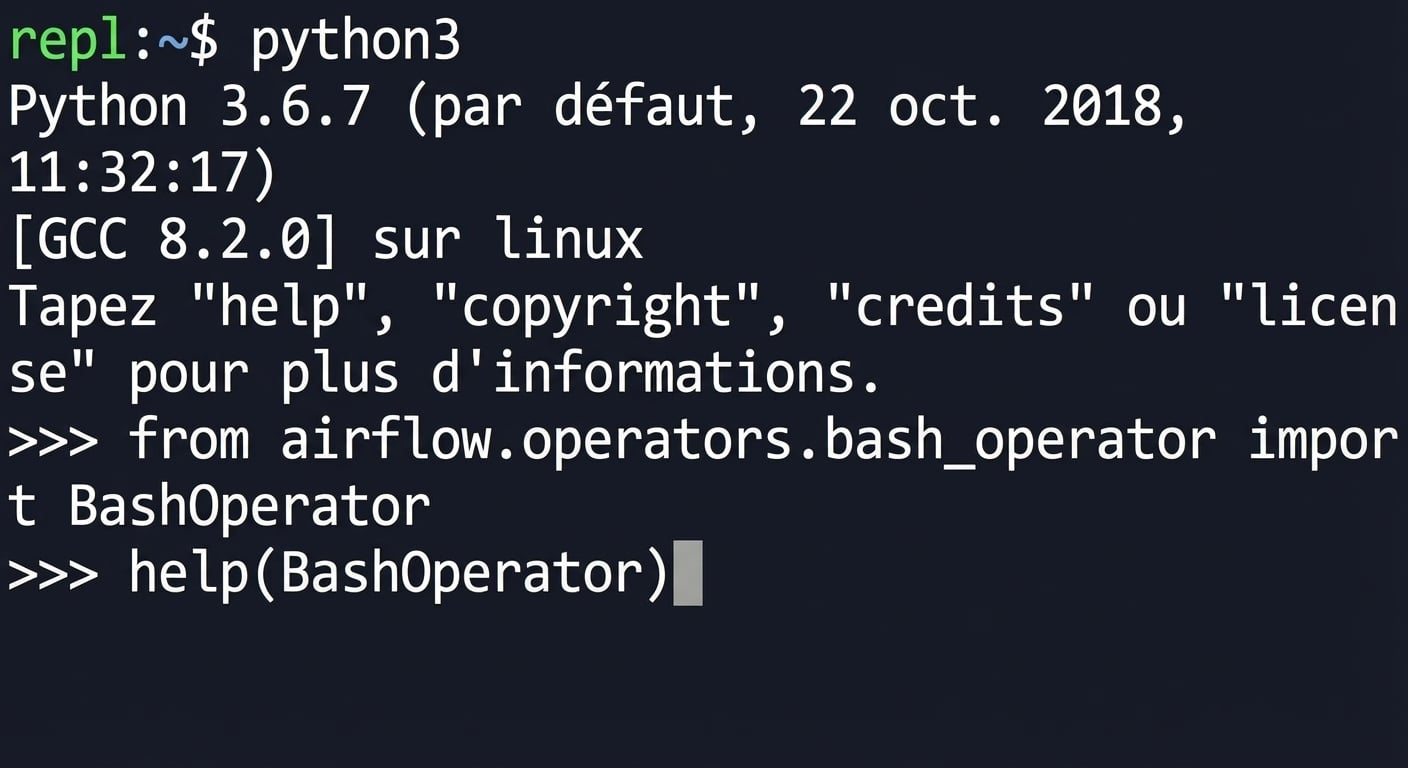

- Ouvrez l’interpréteur python3

- Importez les bibliothèques nécessaires (ex.

from airflow.operators.bash import BashOperator) - Au prompt, exécutez

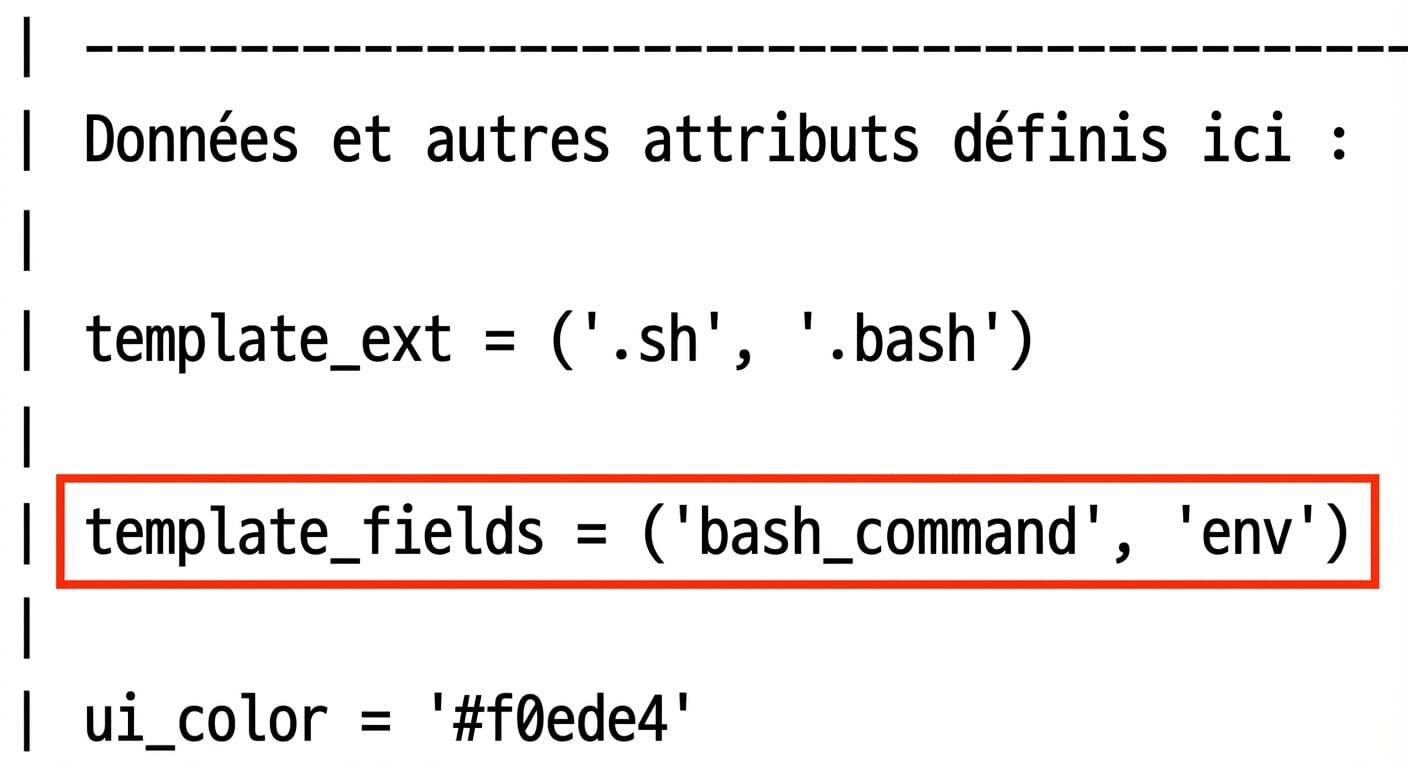

help(<objet Airflow>), ex.help(BashOperator) - Recherchez une ligne mentionnant template_fields. Elle indique les arguments compatibles avec les modèles.

Exemple de documentation des templates

Passons à la pratique !

Introduction à Apache Airflow en Python