Optimizer, Training und Evaluation

Deep Learning mit PyTorch für Fortgeschrittene

Michal Oleszak

Machine Learning Engineer

Training-Loop

import torch.nn as nn import torch.optim as optim criterion = nn.BCELoss() optimizer = optim.SGD(net.parameters(), lr=0.01)for epoch in range(1000): for features, labels in dataloader_train:optimizer.zero_grad()outputs = net(features)loss = criterion( outputs, labels.view(-1, 1) )loss.backward()optimizer.step()

- Loss-Funktion und Optimizer festlegen

BCELossfür binäre KlassifikationSGD-Optimizer

- Über Epochen und Trainingsbatches iterieren

- Gradienten zurücksetzen

- Forward-Pass: Modelloutputs holen

- Loss berechnen

- Gradienten berechnen

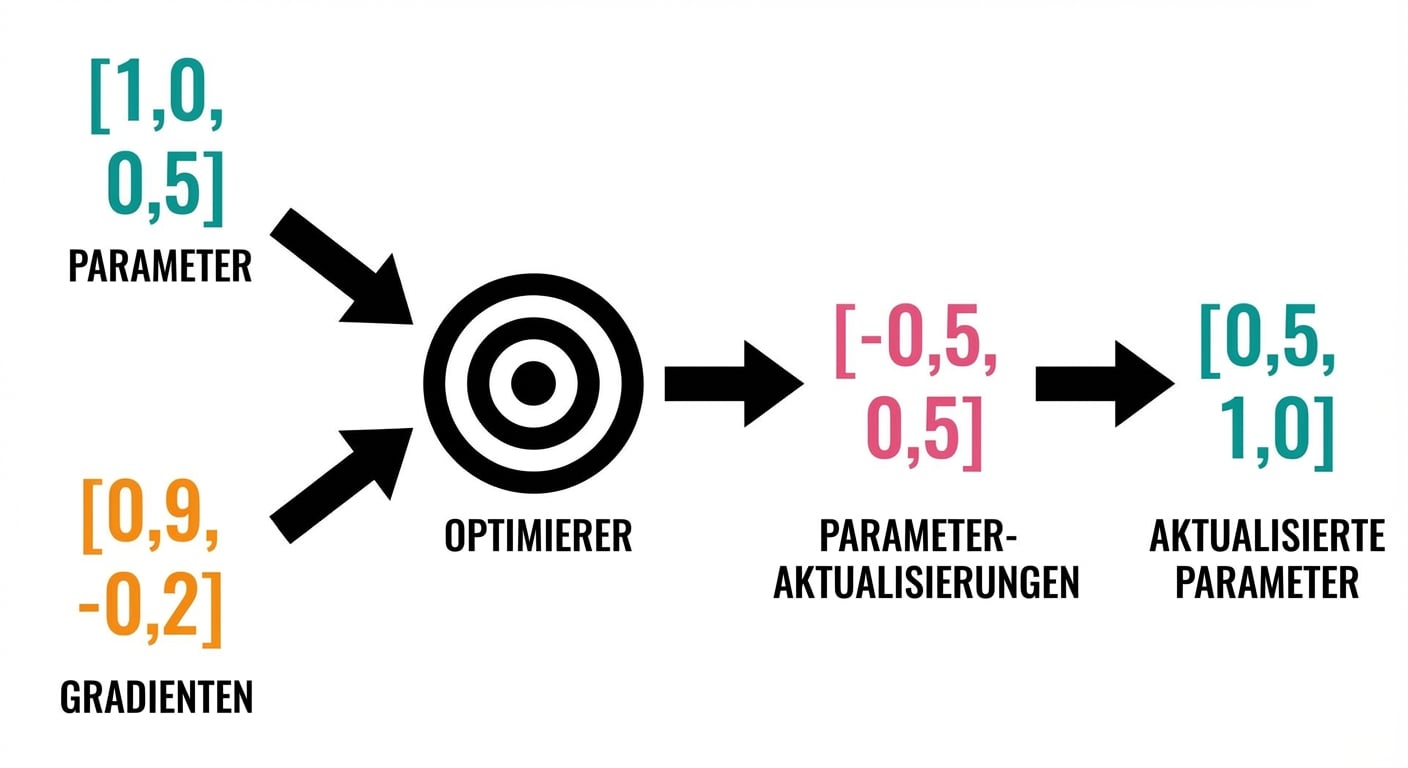

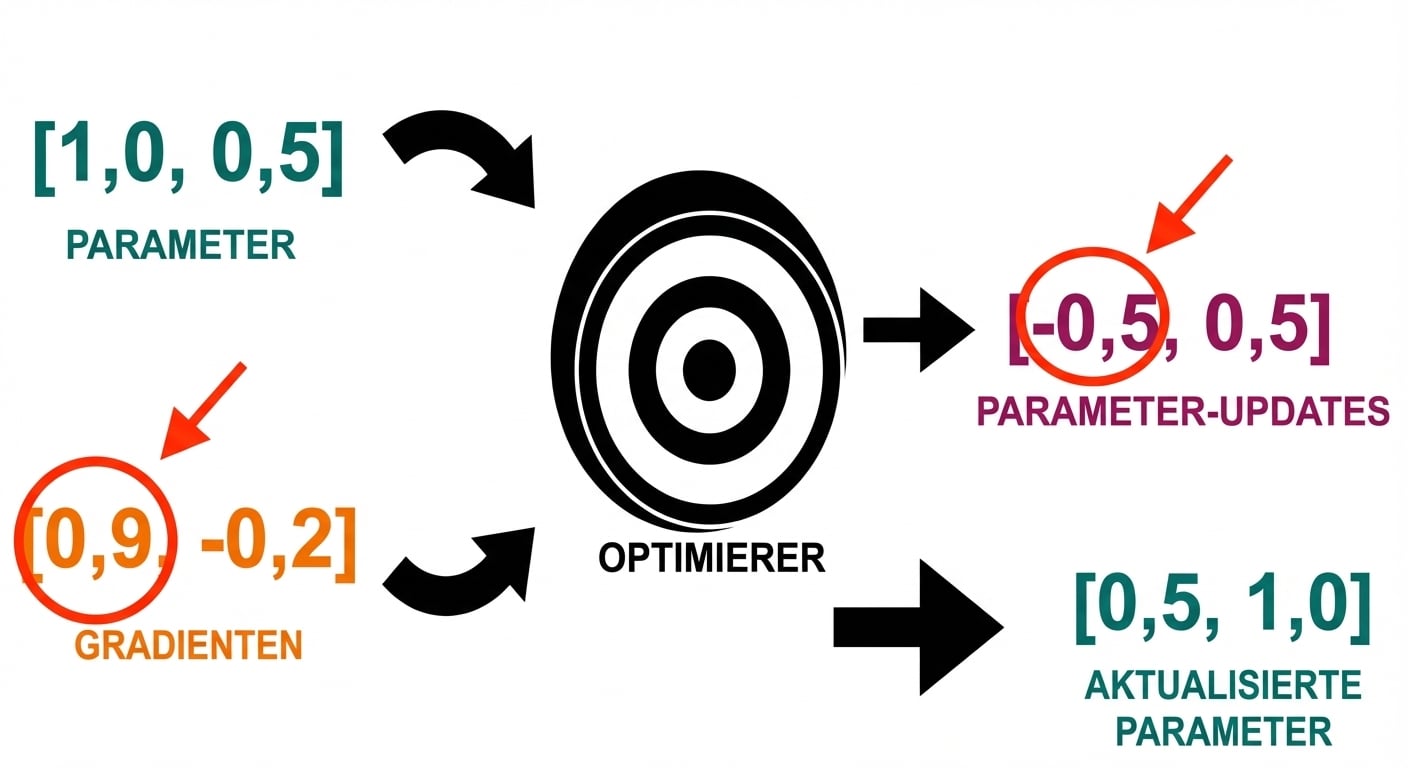

- Optimizer-Schritt: Parameter updaten

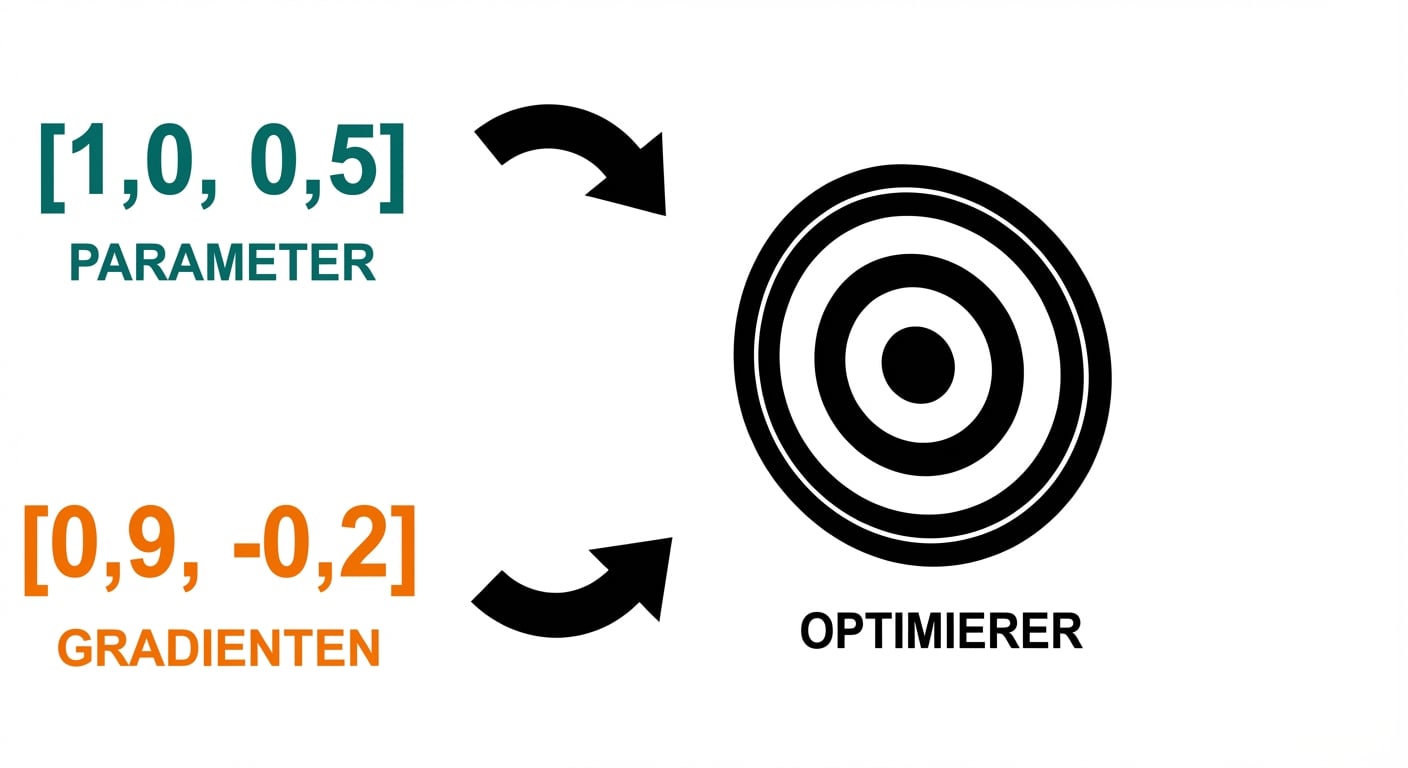

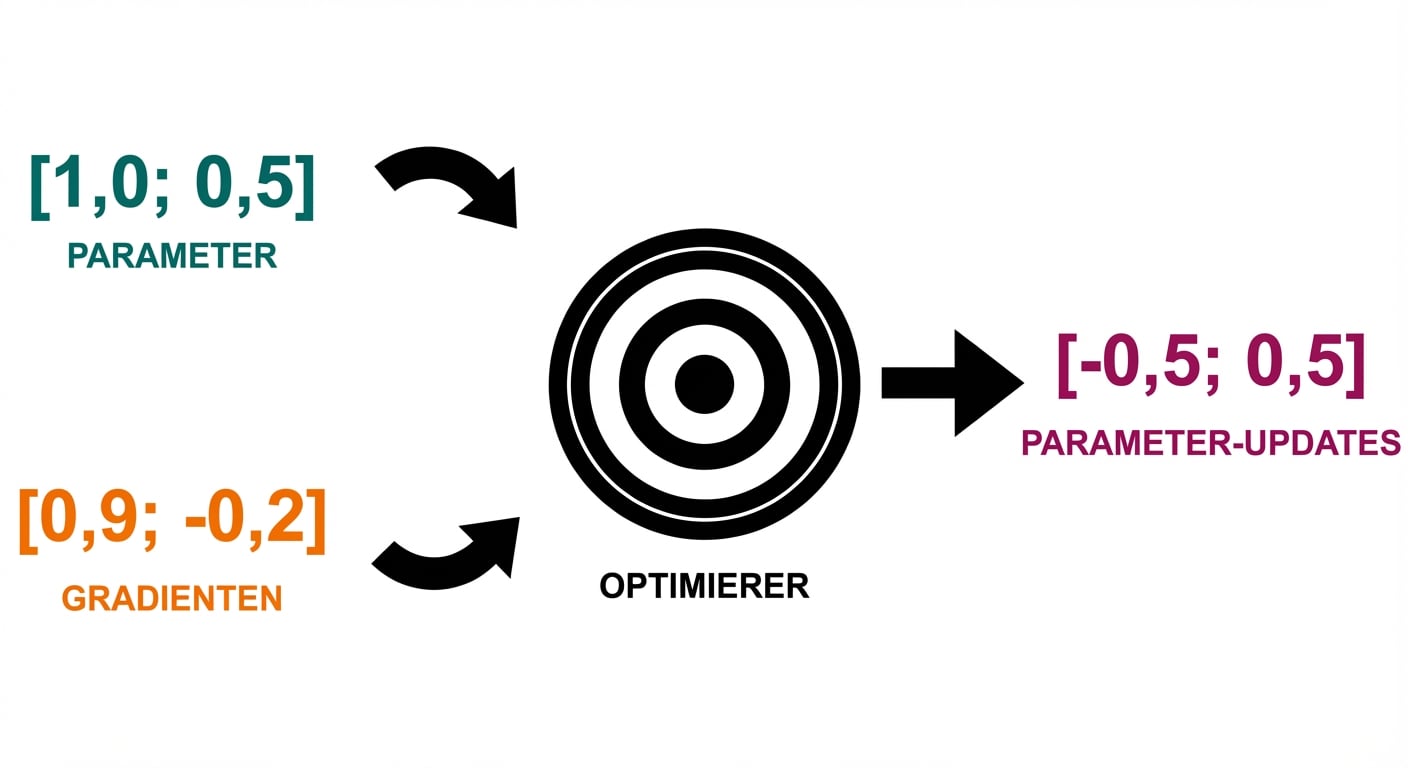

Wie ein Optimizer arbeitet

Wie ein Optimizer arbeitet

Wie ein Optimizer arbeitet

Wie ein Optimizer arbeitet

Wie ein Optimizer arbeitet

Stochastic Gradient Descent (SGD)

optimizer = optim.SGD(net.parameters(), lr=0.01)

- Update hängt von der Lernrate ab

- Einfach und effizient für Basismodelle

- In der Praxis selten genutzt

Adaptive Gradient (Adagrad)

optimizer = optim.Adagrad(net.parameters(), lr=0.01)

- Passt die Lernrate je Parameter an

- Gut für spärliche Daten

- Lernrate kann zu schnell sinken

Root Mean Square Propagation (RMSprop)

optimizer = optim.RMSprop(net.parameters(), lr=0.01)

- Update je Parameter basierend auf der Größe früherer Gradienten

Adaptive Moment Estimation (Adam)

optimizer = optim.Adam(net.parameters(), lr=0.01)

- Wohl am vielseitigsten und am weitesten verbreitet

- RMSprop + Gradientenmomentum

- Oft der Standard-Optimizer

Modellevaluierung

from torchmetrics import Accuracy acc = Accuracy(task="binary")net.eval() with torch.no_grad(): for features, labels in dataloader_test:outputs = net(features)preds = (outputs >= 0.5).float()acc(preds, labels.view(-1, 1))accuracy = acc.compute() print(f"Accuracy: {accuracy}")

Accuracy: 0.6759443283081055

- Accuracy-Metrik einrichten

- Modell in Eval-Modus und über Testbatches ohne Gradienten iterieren

- Daten ins Modell: vorhergesagte Wahrscheinlichkeiten holen

- Vorhersage-Labels berechnen

- Accuracy-Metrik updaten

Lass uns üben!

Deep Learning mit PyTorch für Fortgeschrittene