Rekurrente Neuronale Netze

Deep Learning mit PyTorch für Fortgeschrittene

Michal Oleszak

Machine Learning Engineer

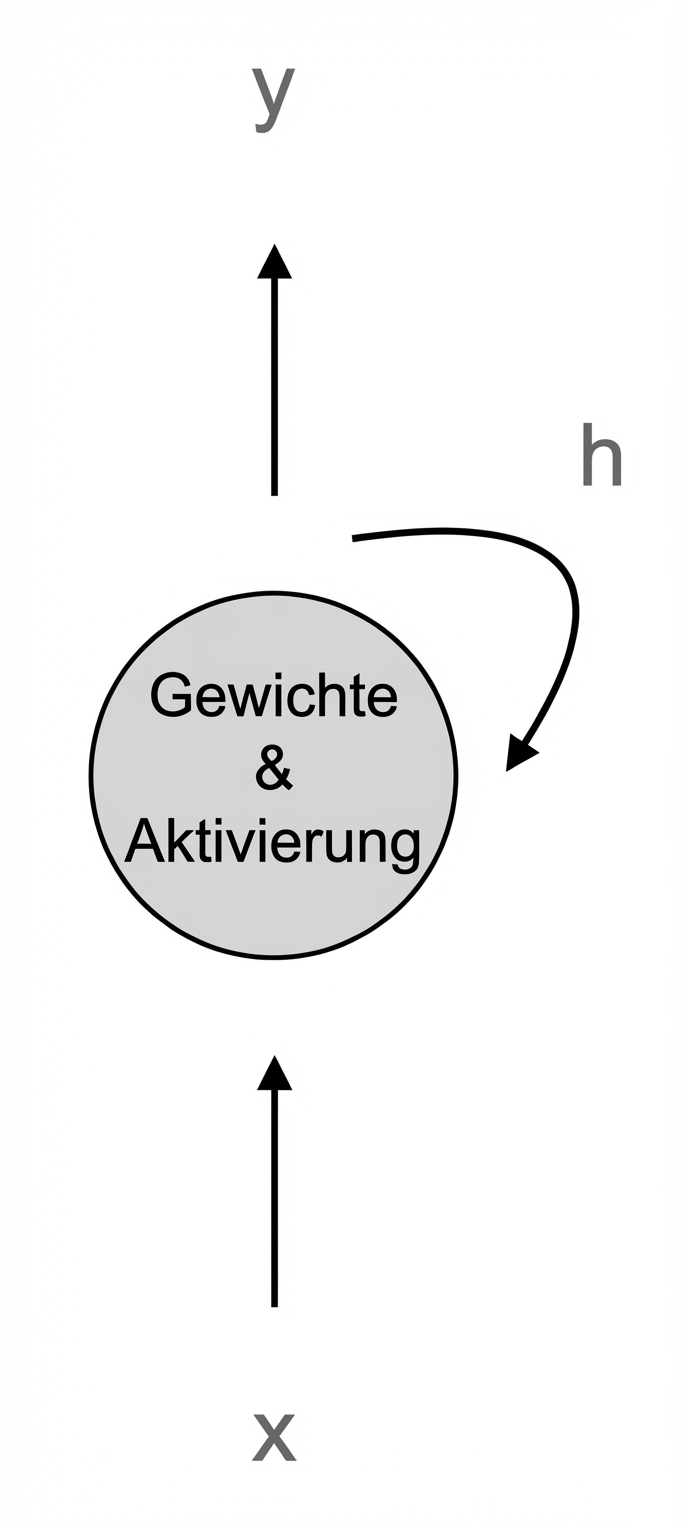

Rekurrentes Neuron

- Feedforward-Netze

- RNNs: haben Rückwärtsverbindungen

- Rekurrentes Neuron:

- Input

x - Output

y - Verborgener Zustand

h

- Input

- In PyTorch:

nn.RNN()

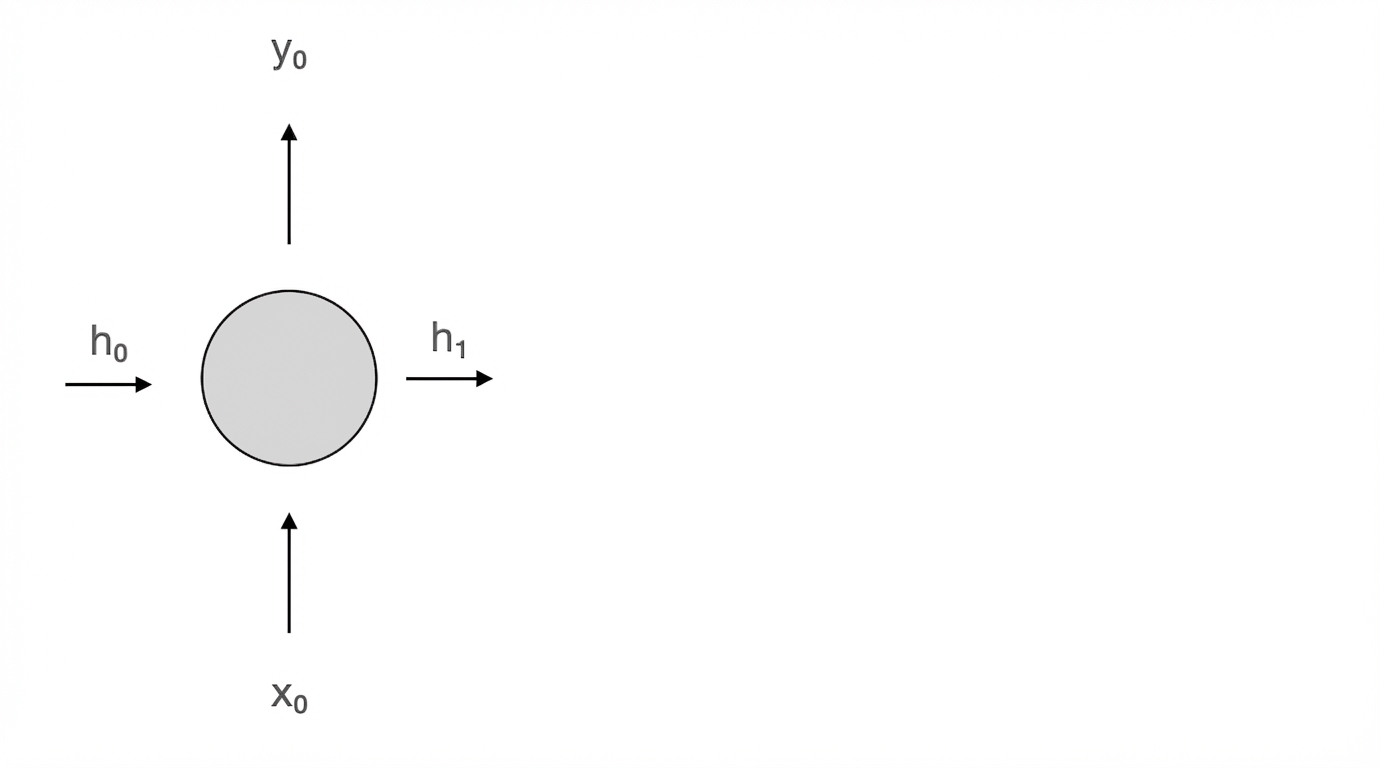

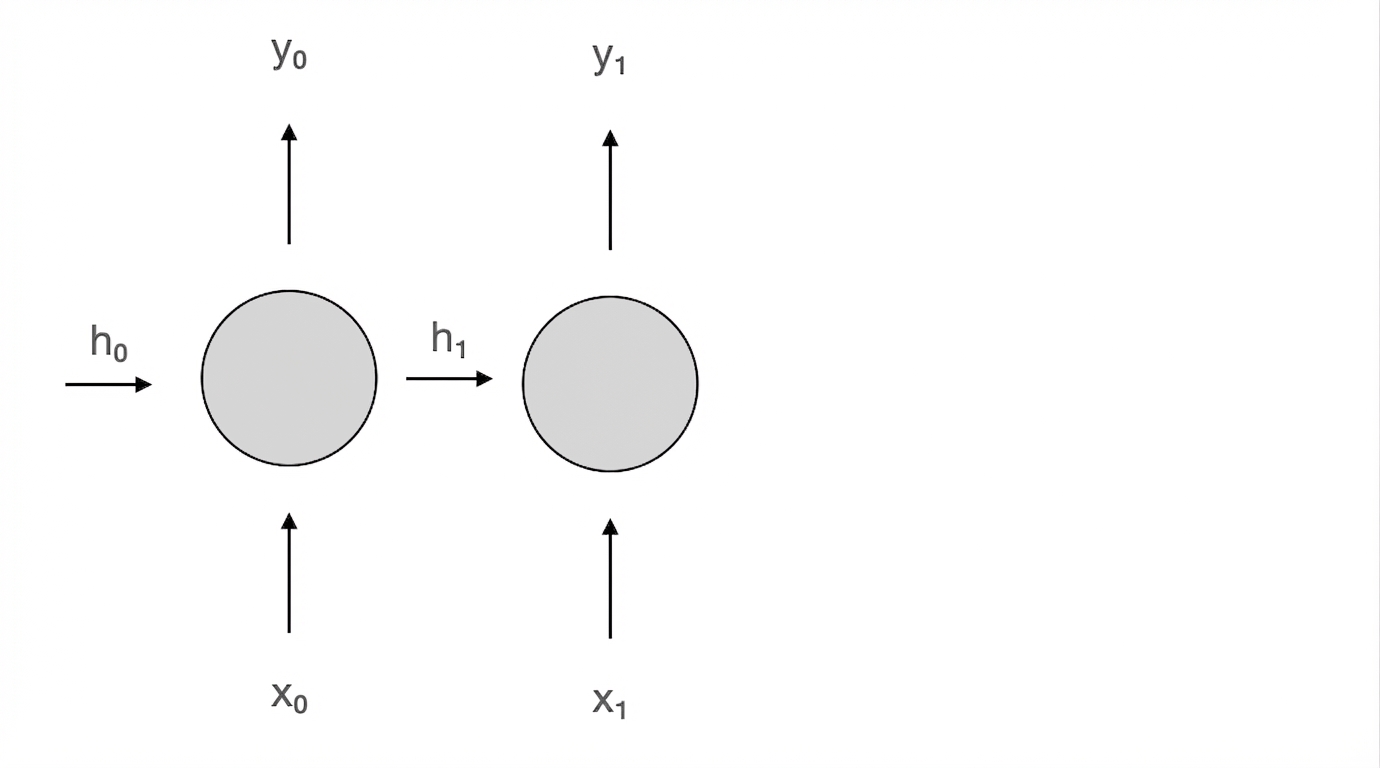

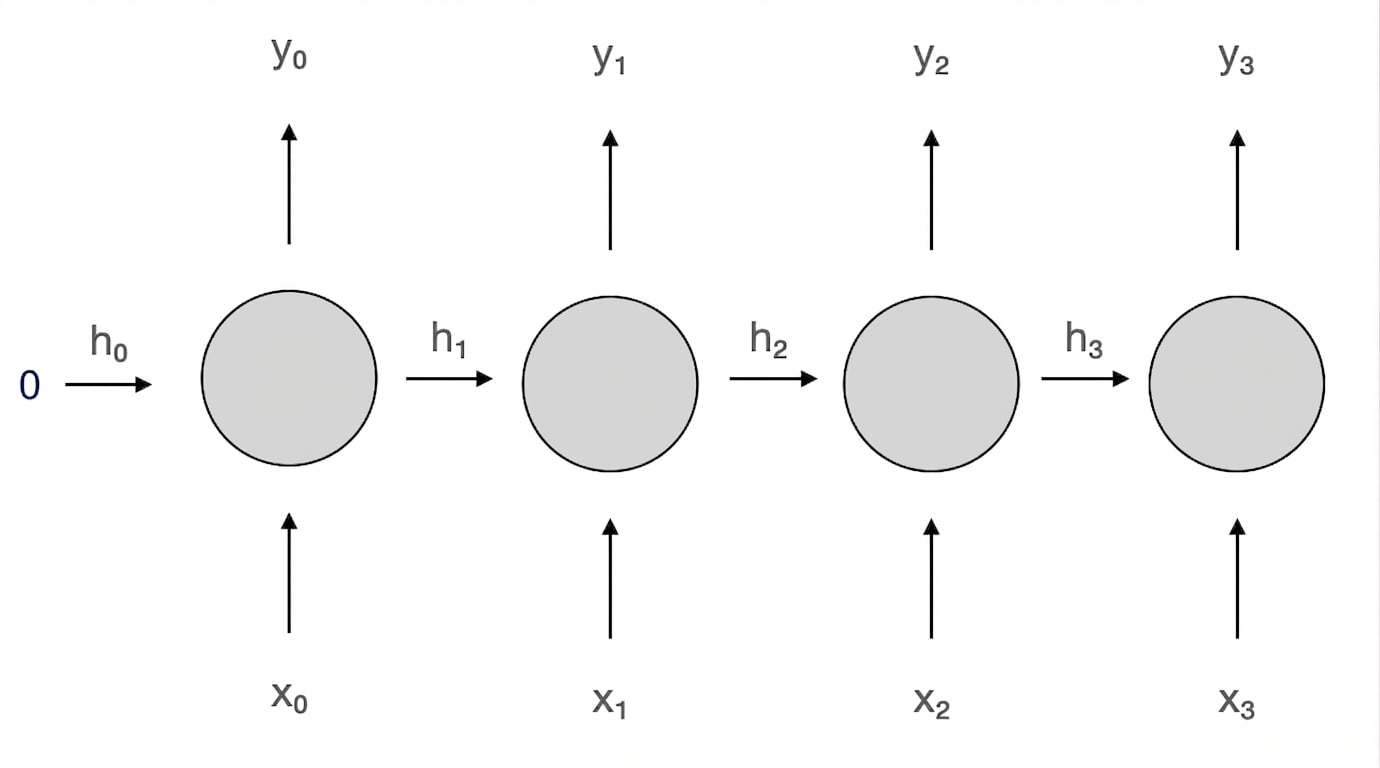

Rekurrentes Neuron über die Zeit aufrollen

Rekurrentes Neuron über die Zeit aufrollen

Rekurrentes Neuron über die Zeit aufrollen

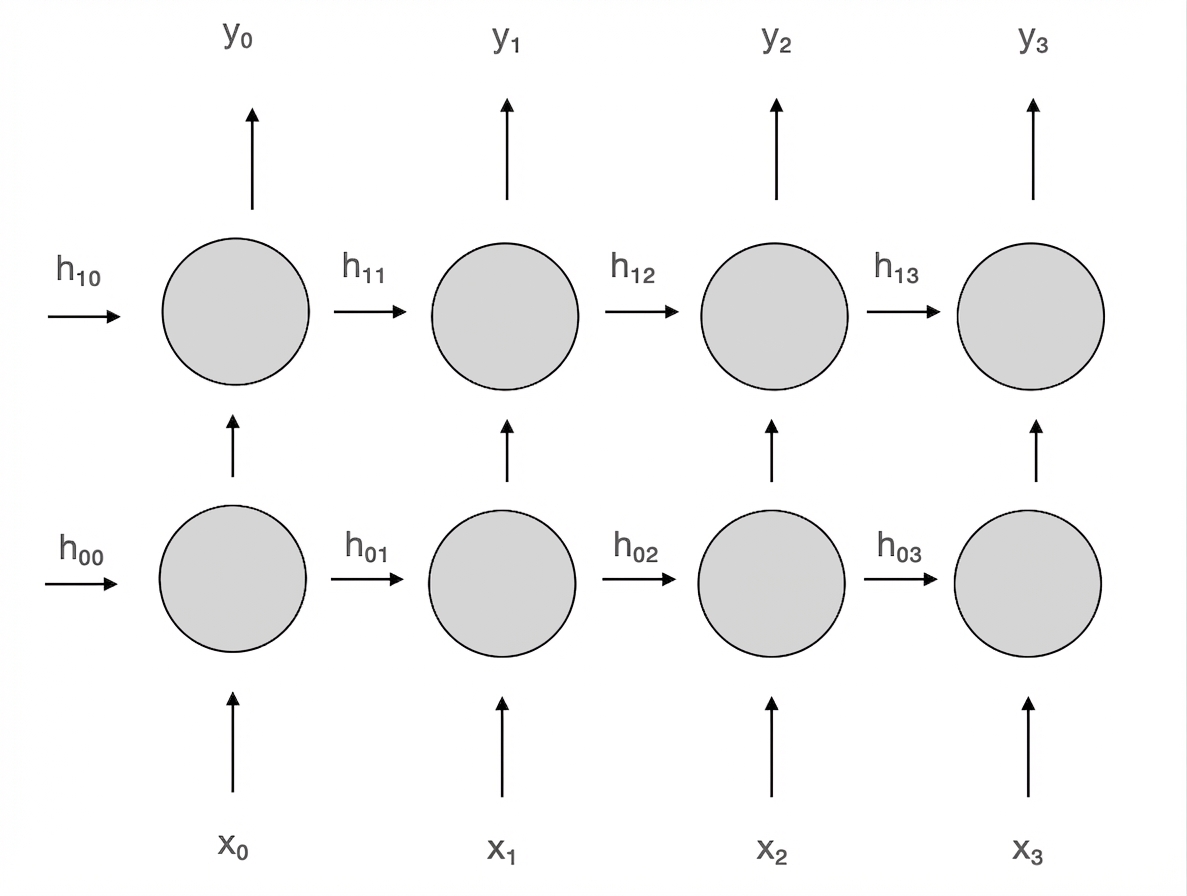

Tiefe RNNs

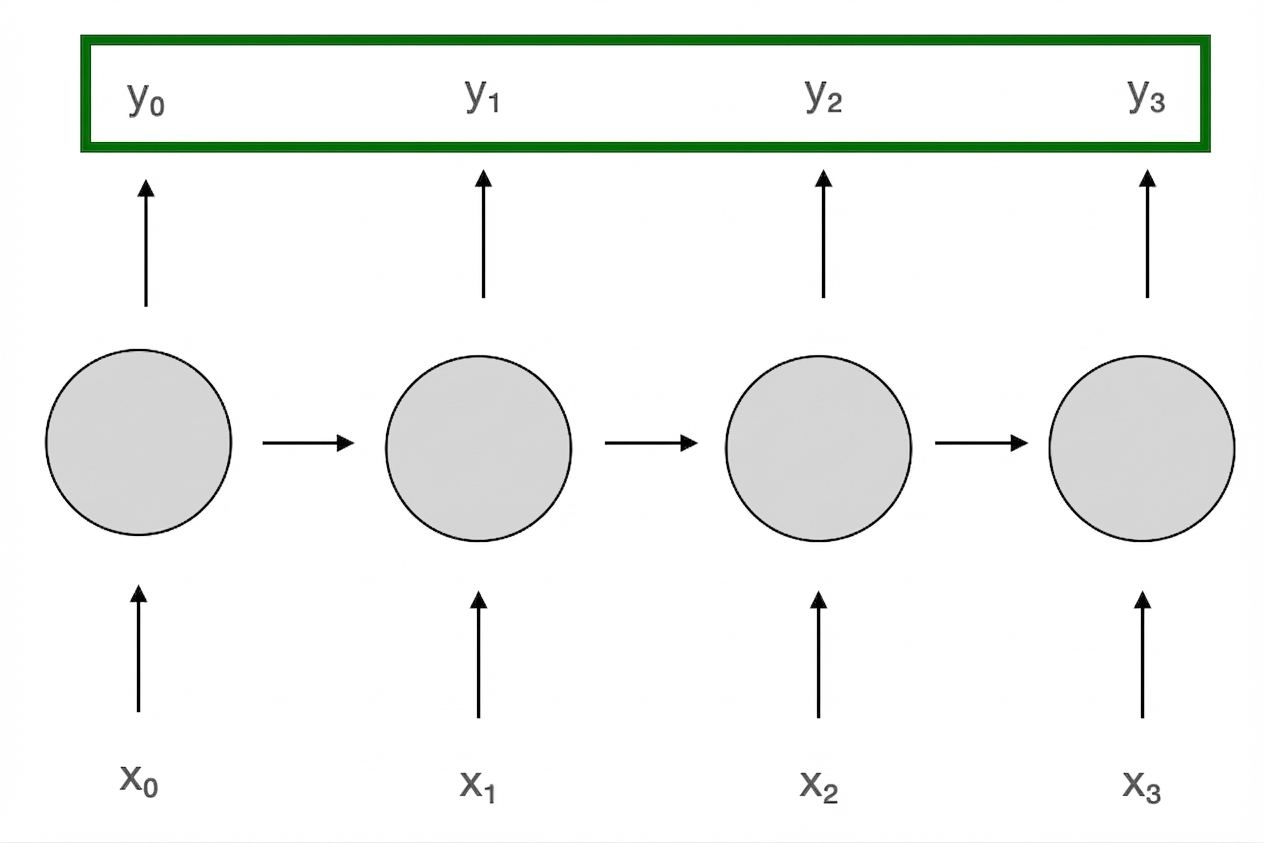

Sequence-to-Sequence-Architektur

- Sequenz als Eingabe, gesamte Ausgabesequenz nutzen

- Beispiel: Spracherkennung in Echtzeit

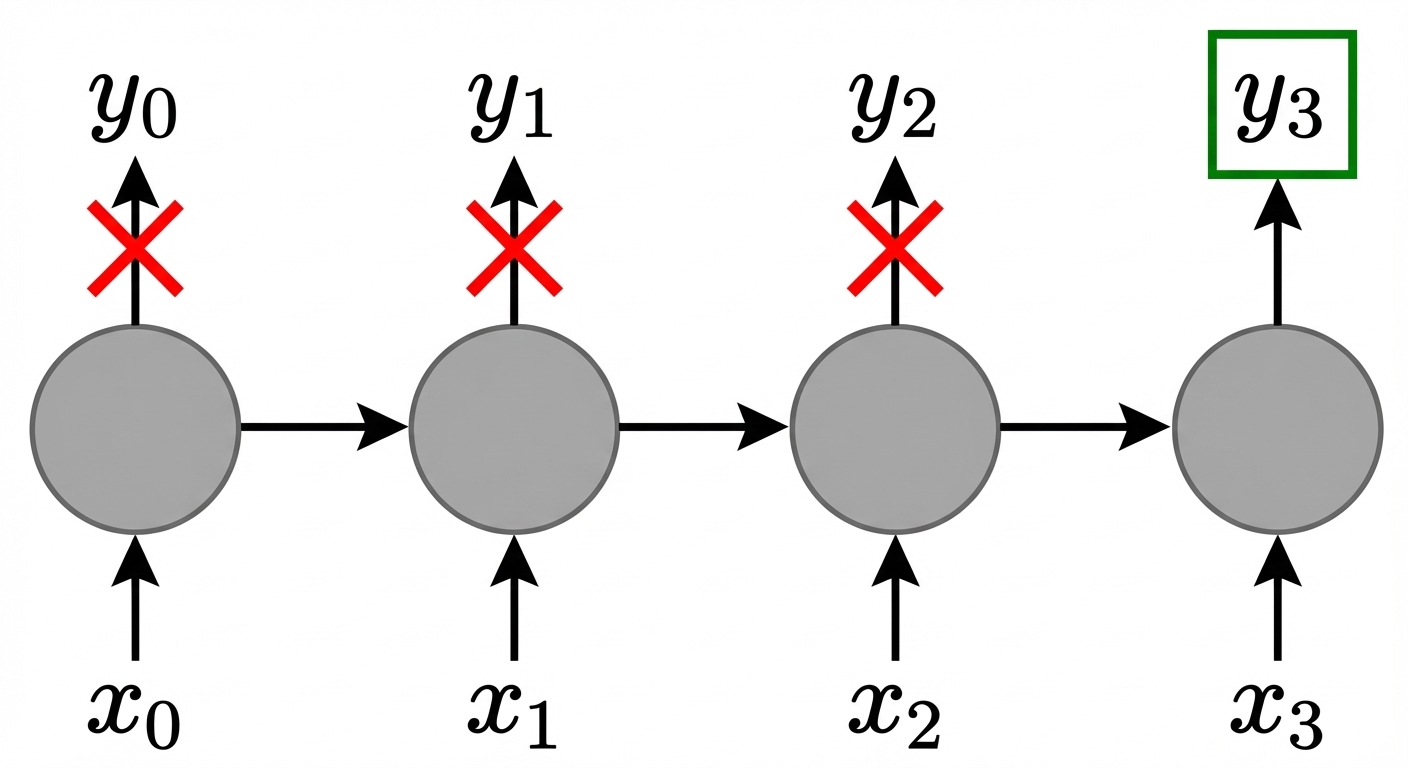

Sequence-to-Vector-Architektur

- Sequenz als Eingabe, nur letzte Ausgabe nutzen

- Beispiel: Text-Themenklassifikation

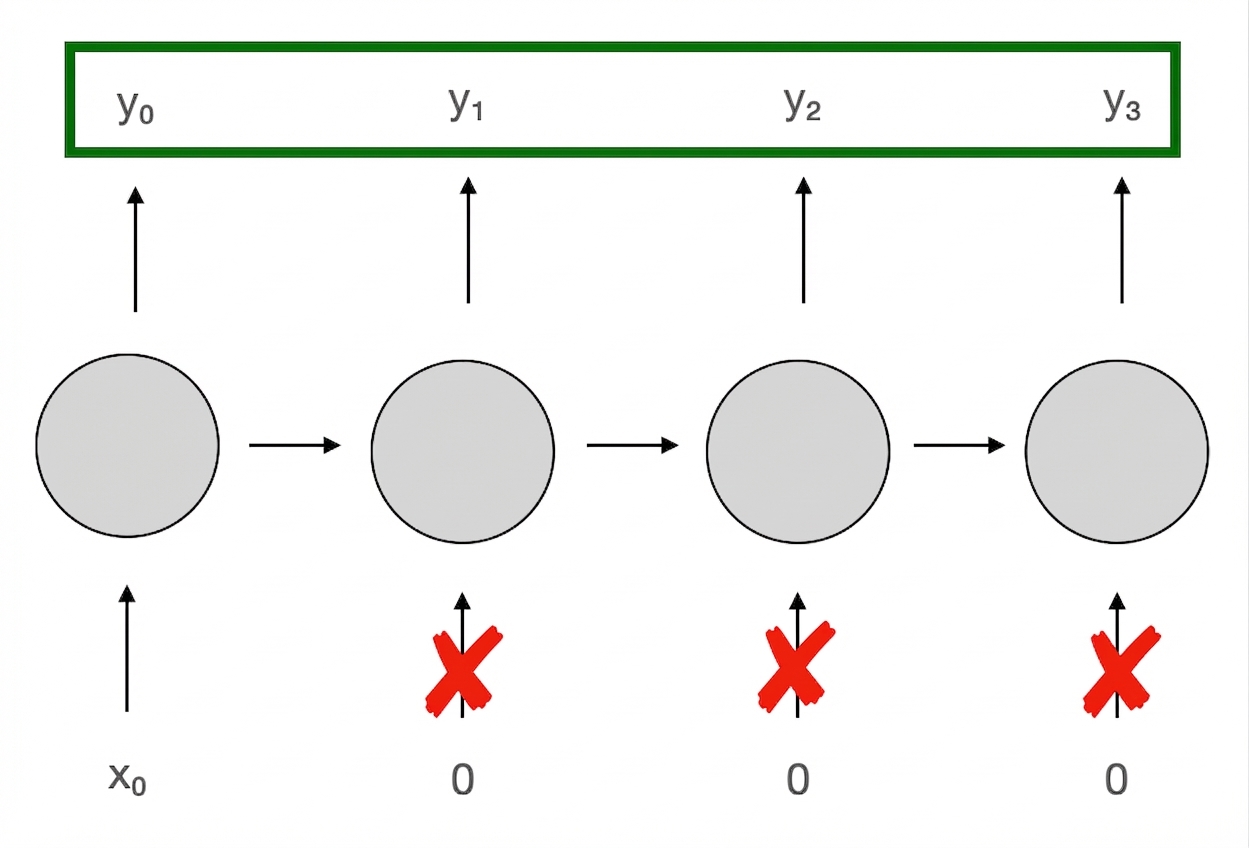

Vector-to-Sequence-Architektur

- Ein einzelner Eingang, gesamte Ausgabesequenz nutzen

- Beispiel: Textgenerierung

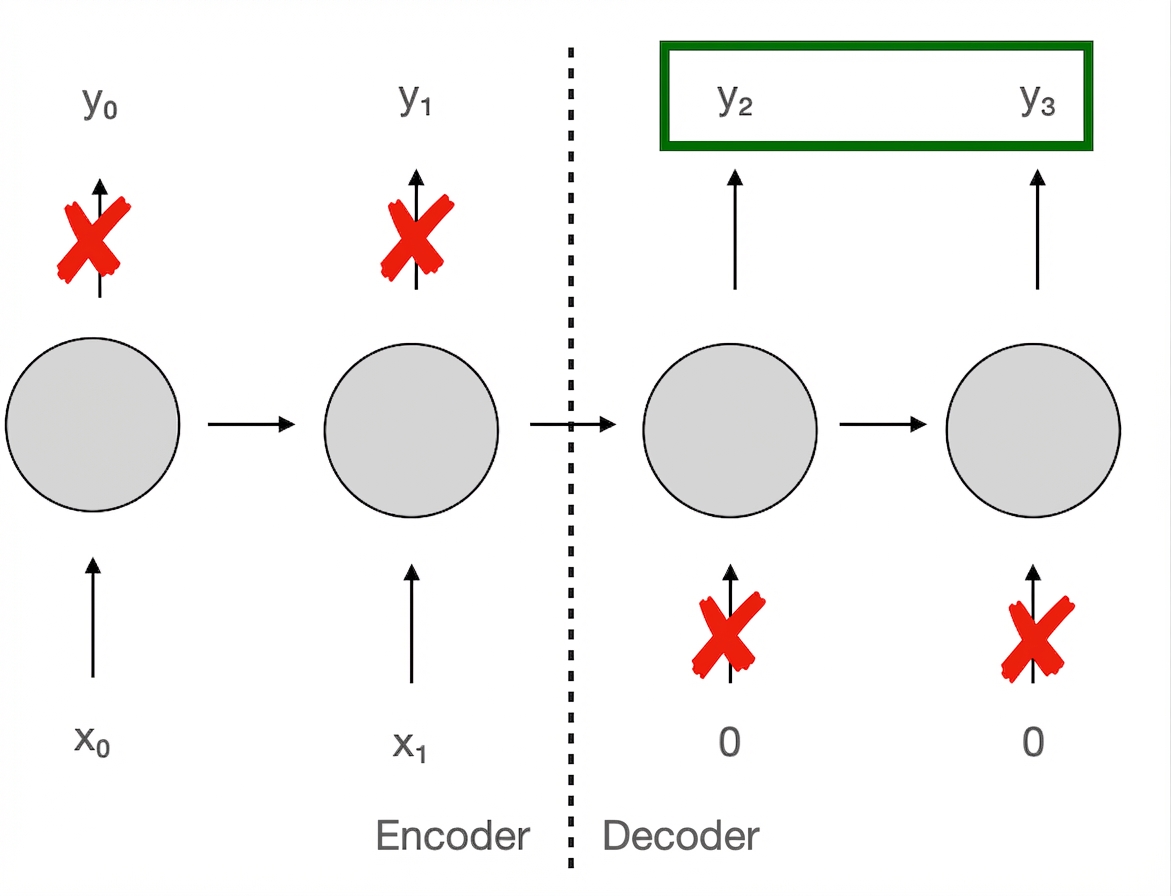

Encoder-Decoder-Architektur

- Ganze Eingabesequenz verarbeiten, danach Ausgabesequenz nutzen

- Beispiel: Maschinelle Übersetzung

RNN in PyTorch

class Net(nn.Module): def __init__(self): super().__init__()self.rnn = nn.RNN( input_size=1, hidden_size=32, num_layers=2, batch_first=True, )self.fc = nn.Linear(32, 1)def forward(self, x): h0 = torch.zeros(2, x.size(0), 32)out, _ = self.rnn(x, h0)out = self.fc(out[:, -1, :]) return out

- Modellklasse mit

__init__definieren - Rekurrente Schicht

self.rnndefinieren - Lineare Schicht

fcdefinieren - In

forward()ersten Hidden State auf Nullen setzen - Eingabe und ersten Hidden State durch RNN-Schicht geben

- Letzte RNN-Ausgabe wählen und durch lineare Schicht geben

Lass uns üben!

Deep Learning mit PyTorch für Fortgeschrittene