Convolutional Neural Networks

Deep Learning mit PyTorch für Fortgeschrittene

Michal Oleszak

Machine Learning Engineer

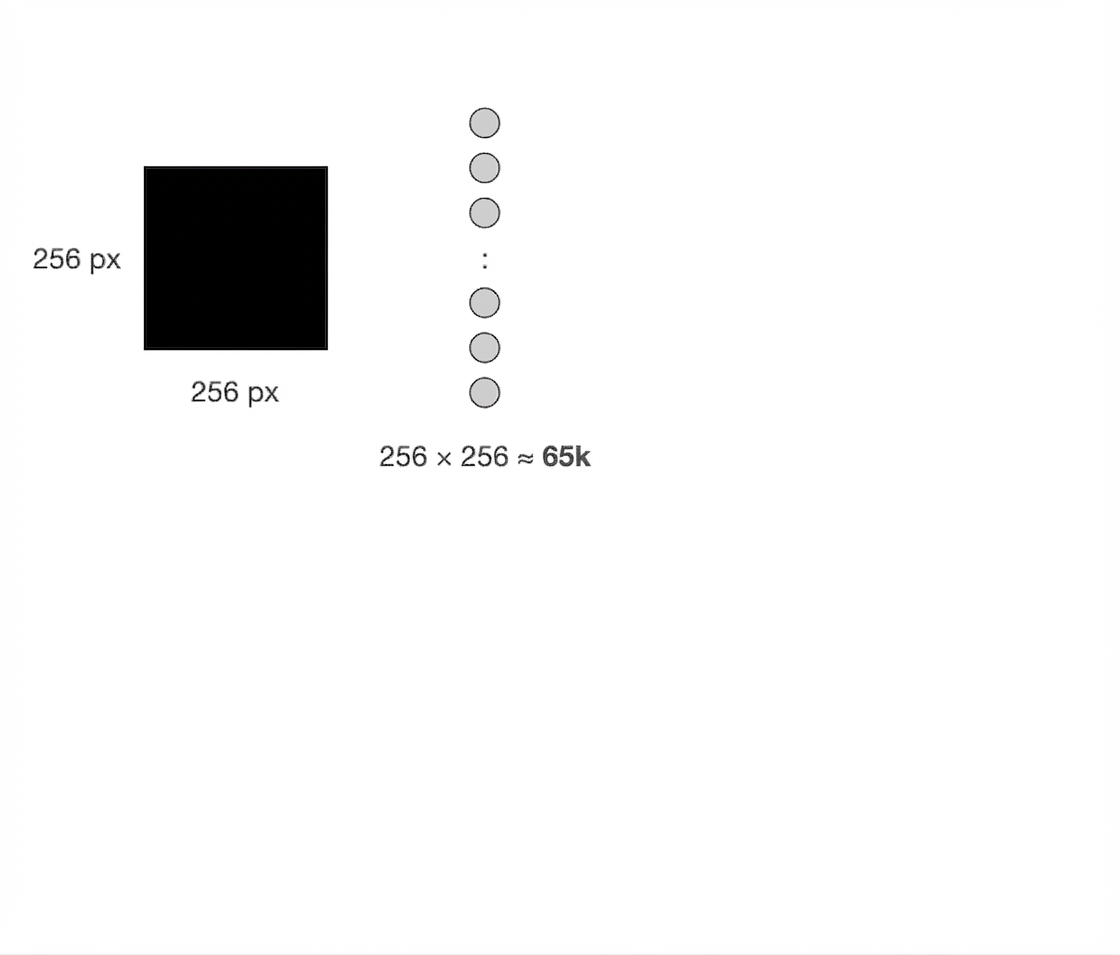

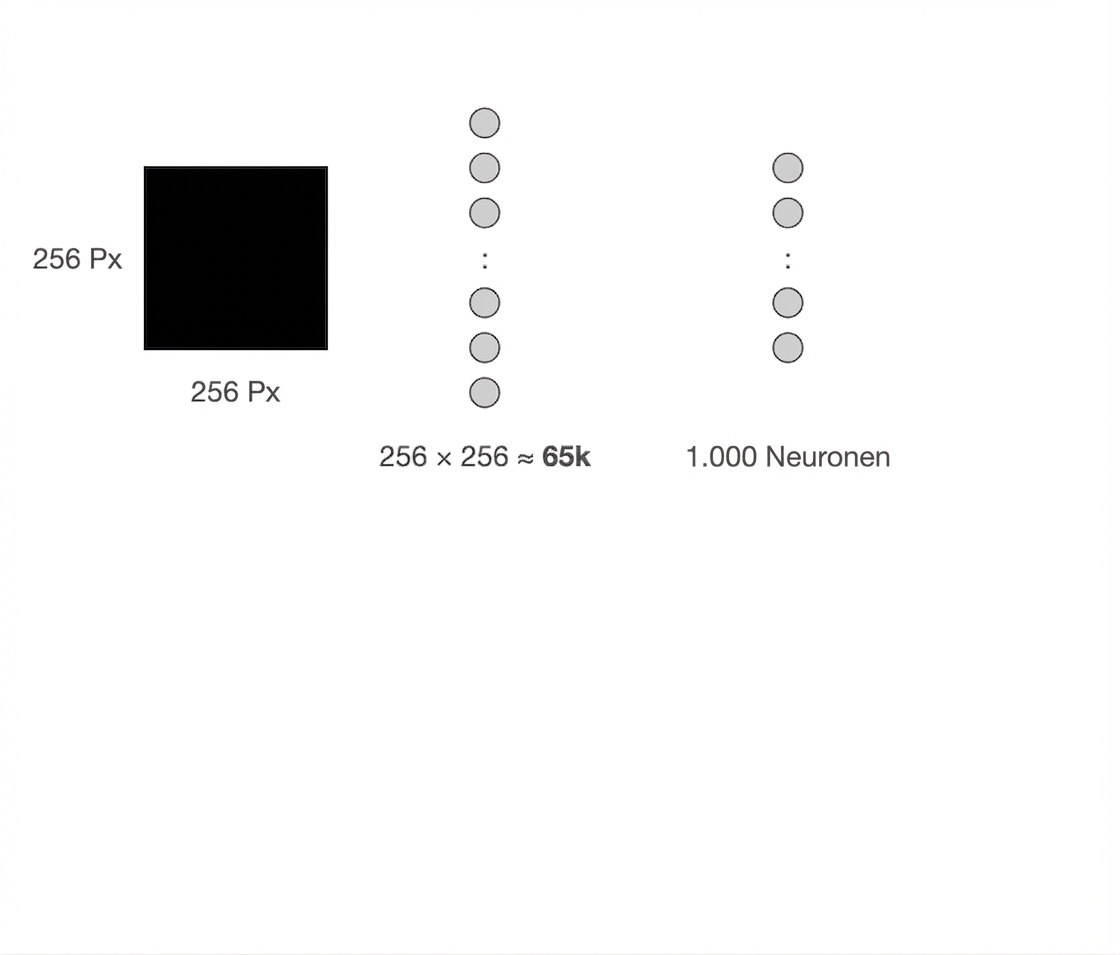

Warum keine linearen Schichten?

Warum keine linearen Schichten?

Warum keine linearen Schichten?

Warum keine linearen Schichten?

Warum keine linearen Schichten?

Warum keine linearen Schichten?

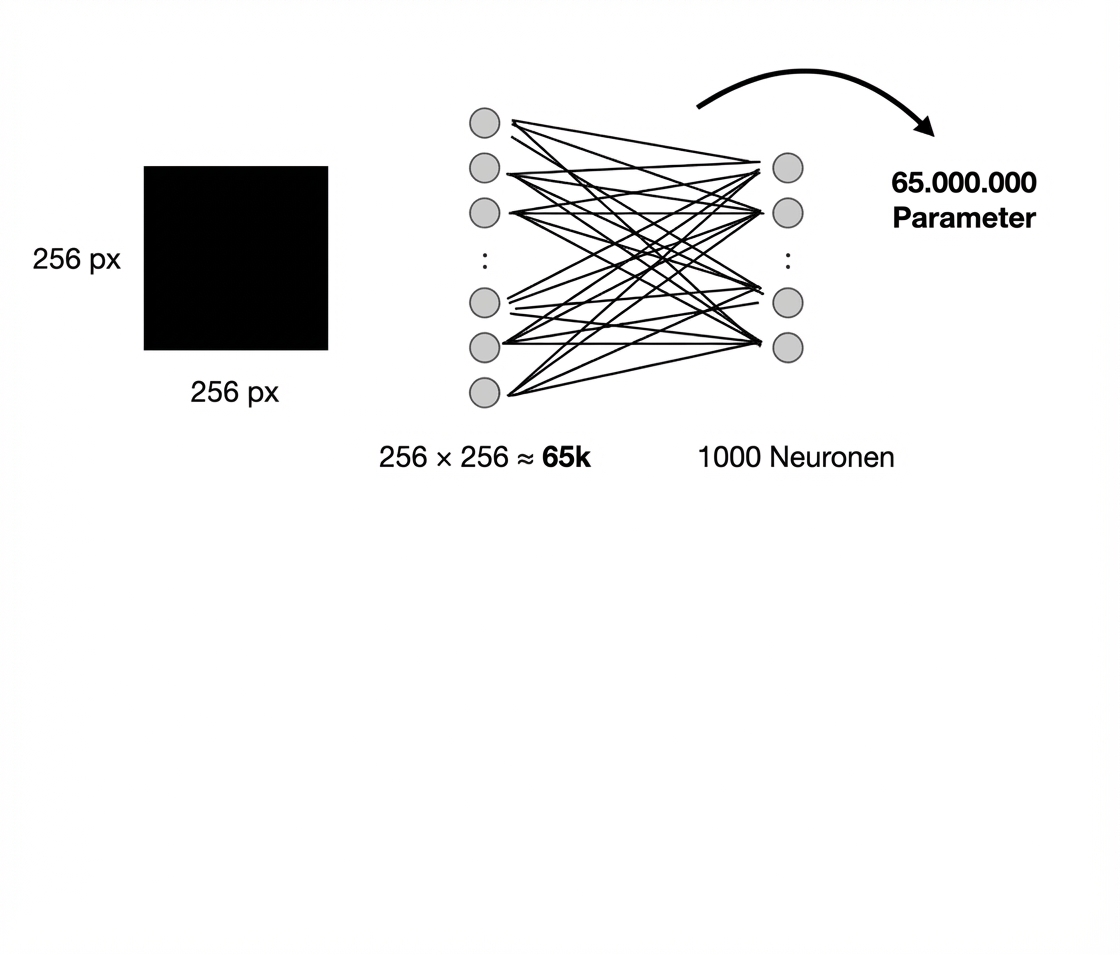

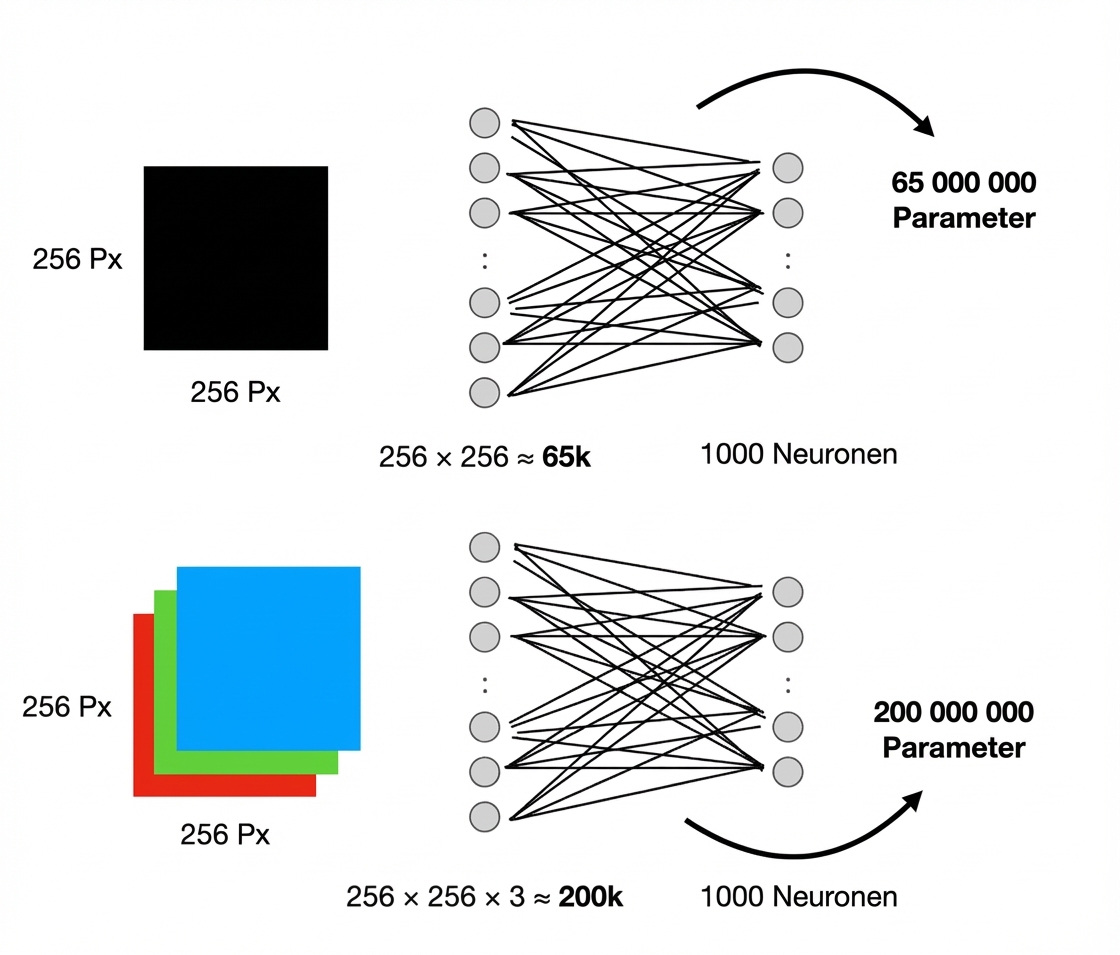

- Lineare Schichten:

- Langsames Training

- Overfitting

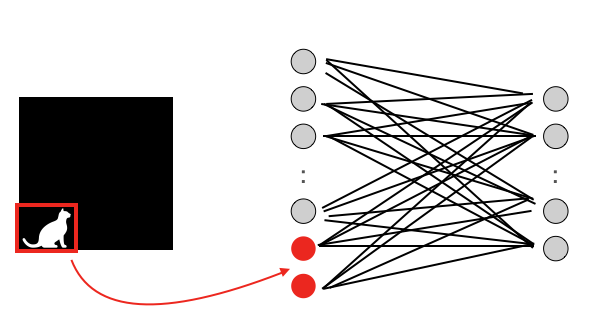

- Erkennen keine räumlichen Muster

- Bessere Alternative: Convolution-Schichten!

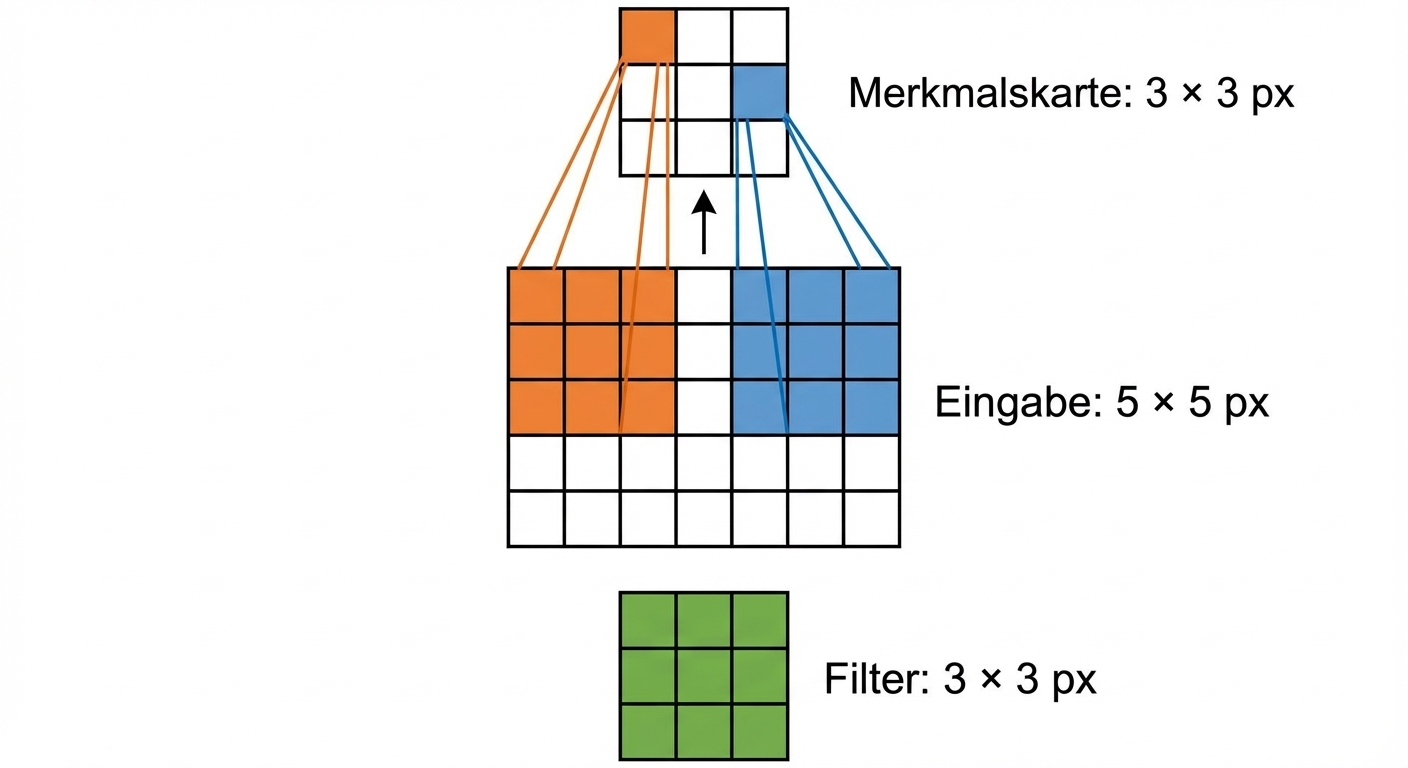

Convolution-Schicht

- Filterparameter über das Input schieben

- An jeder Position: Convolution berechnen

- Ergebnis: Feature-Map

- Erhält räumliche Muster des Inputs

- Weniger Parameter als lineare Schicht

- Ein Filter = eine Feature-Map

- Aktivierungen auf Feature-Maps anwenden

- Alle Feature-Maps kombiniert ergeben das Output

nn.Conv2d(3, 32, kernel_size=3)

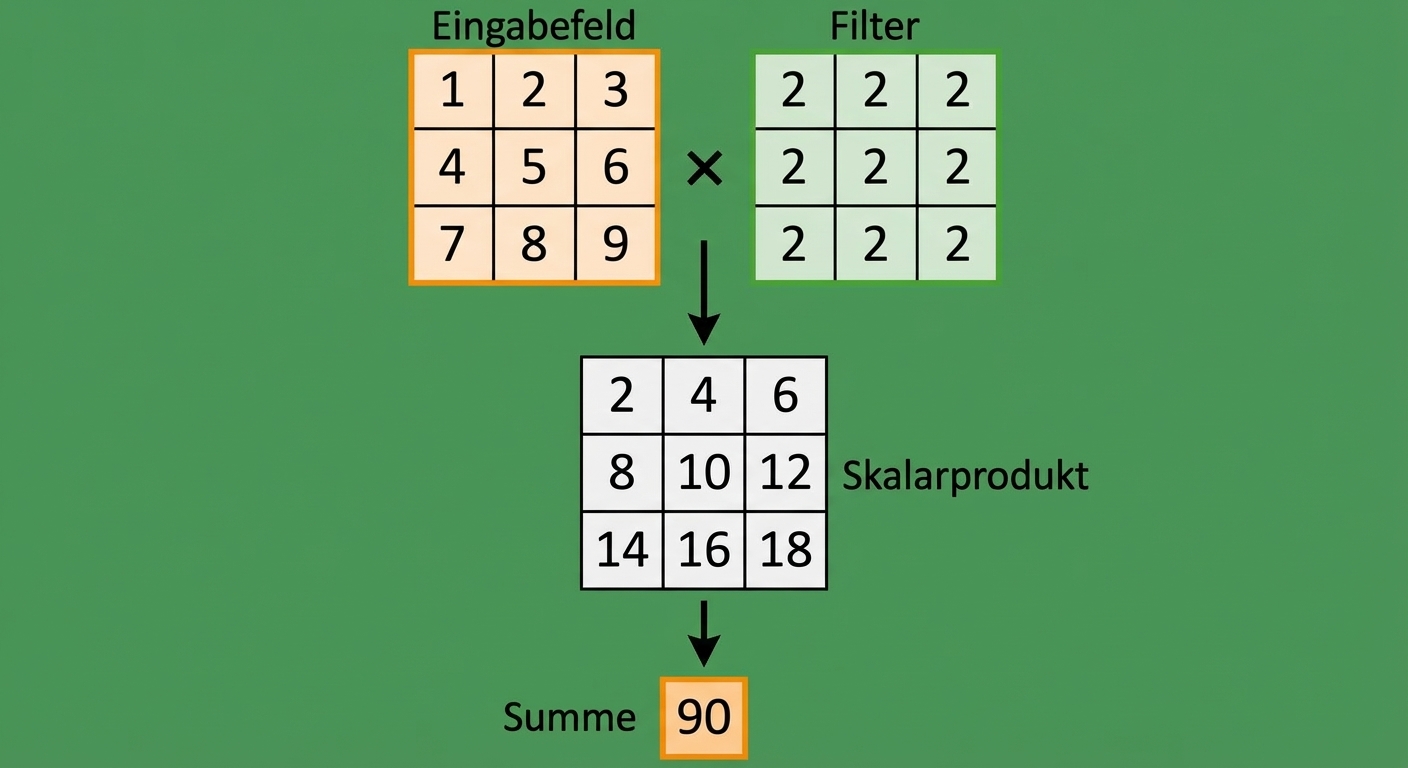

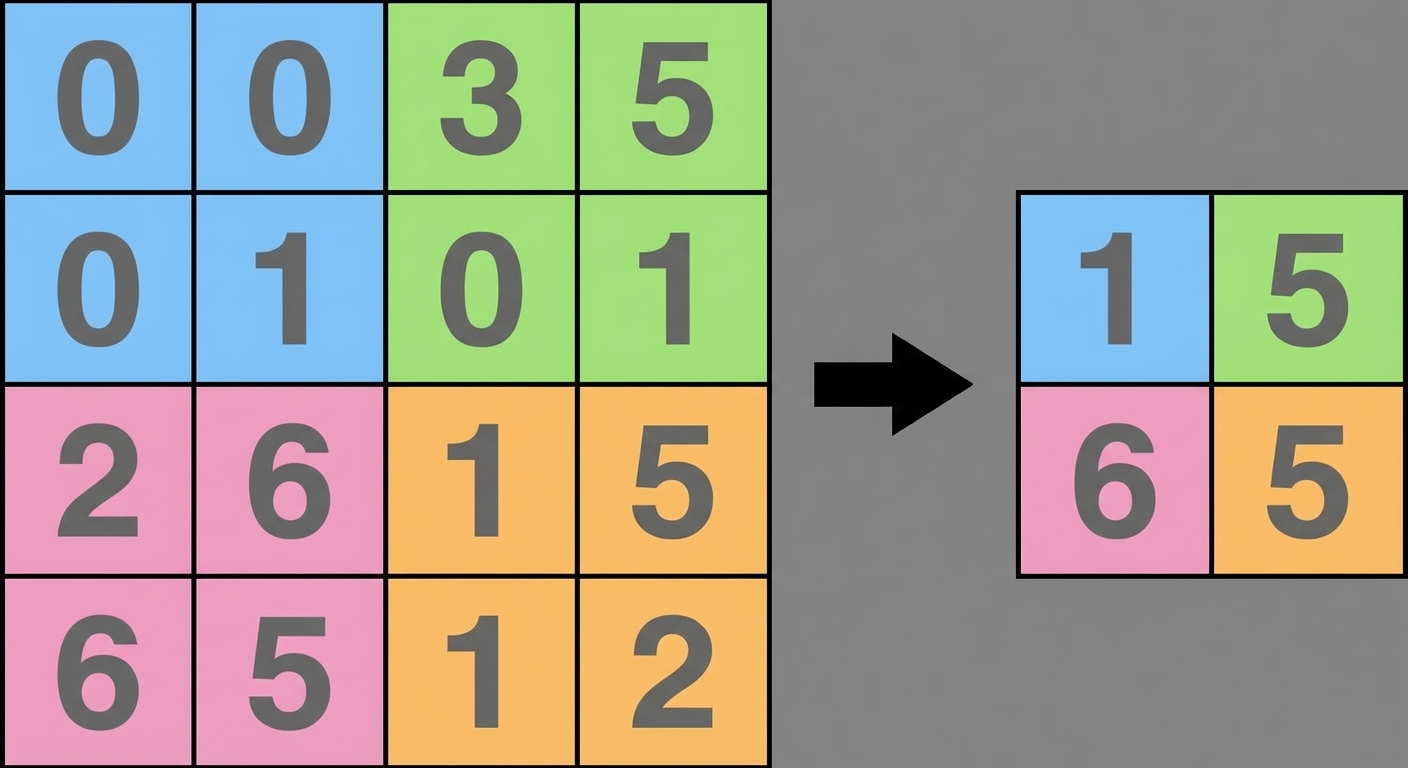

Convolution

- Skalarprodukt aus Input-Patch und Filter berechnen

- Links oben: 2 × 1 = 2

- Ergebnis aufsummieren

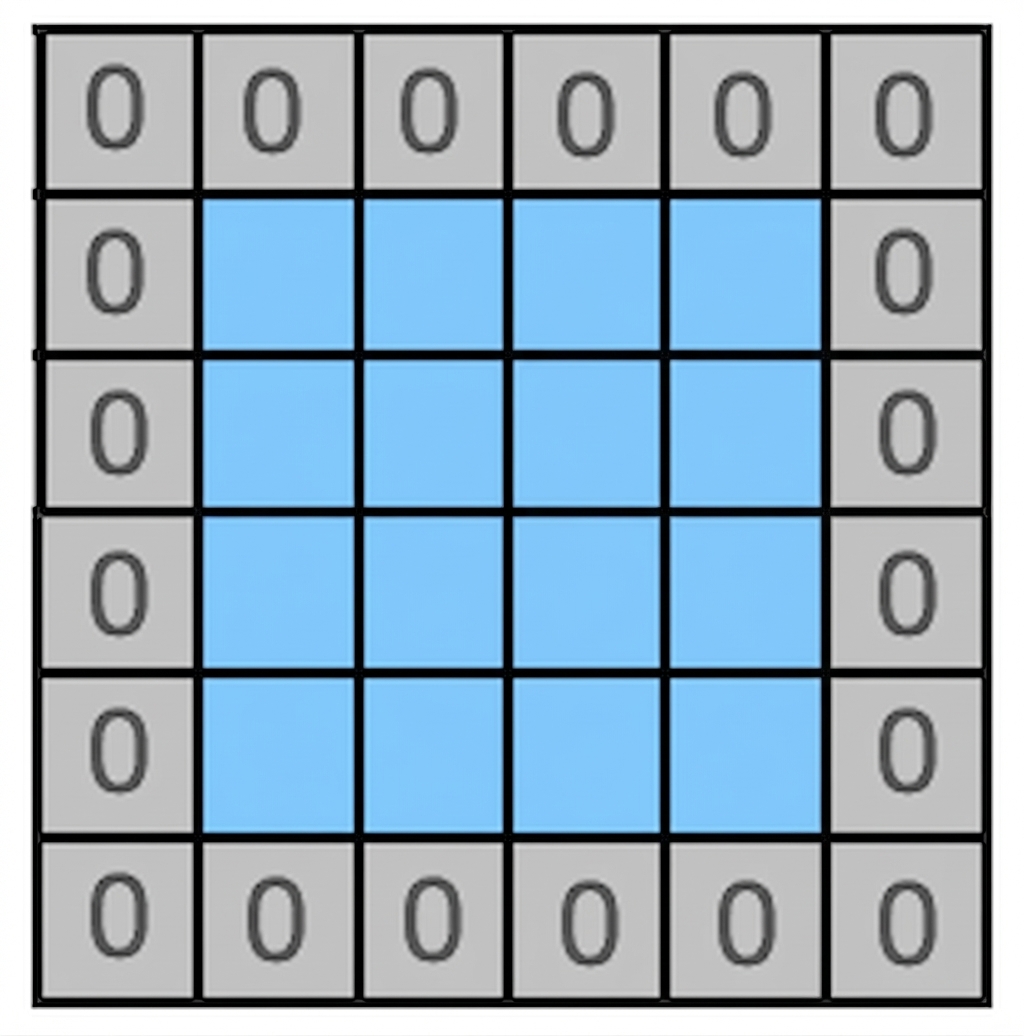

Zero-Padding

- Dem Input der Convolution-Schicht einen Rahmen aus Nullen hinzufügen

nn.Conv2d(

3, 32, kernel_size=3, padding=1

)

- Erhält die räumlichen Dimensionen von Input und Output

- Behandelt Randpixel gleich wie andere

Max-Pooling

- Nicht überlappendes Fenster über das Input schieben

- An jeder Position nur den Maximalwert behalten

- Nach Convolution-Schichten zur Reduktion der räumlichen Dimensionen

nn.MaxPool2d(kernel_size=2)

Convolutional Neural Network

class Net(nn.Module): def __init__(self, num_classes): super().__init__()self.feature_extractor = nn.Sequential( nn.Conv2d(3, 32, kernel_size=3, padding=1), nn.ELU(), nn.MaxPool2d(kernel_size=2), nn.Conv2d(32, 64, kernel_size=3, padding=1), nn.ELU(), nn.MaxPool2d(kernel_size=2), nn.Flatten(), )self.classifier = nn.Linear(64*16*16, num_classes)def forward(self, x): x = self.feature_extractor(x) x = self.classifier(x) return x

feature_extractor: (Convolution, Aktivierung, Pooling), zweimal, dann Flattenclassifier: eine lineare Schichtforward(): Eingabebild durch Feature-Extractor und Klassifizierer schicken

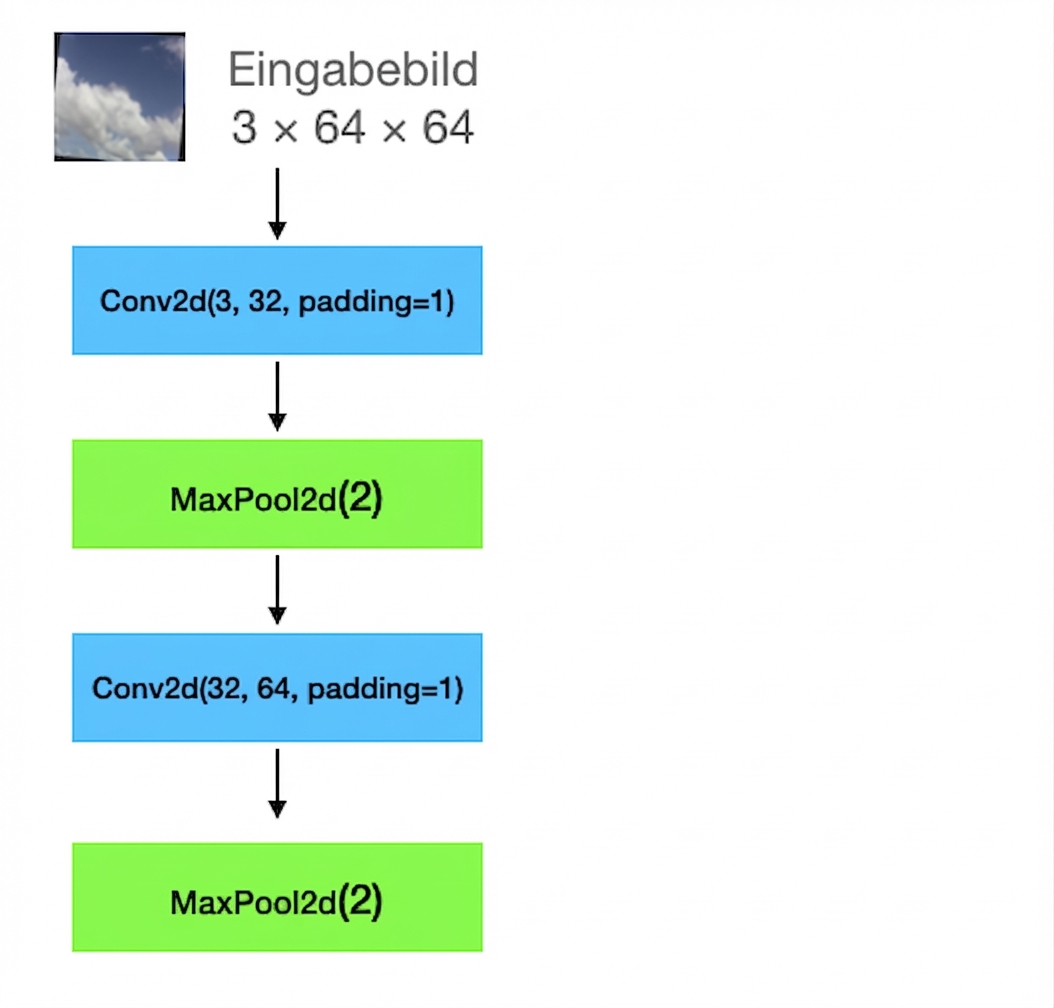

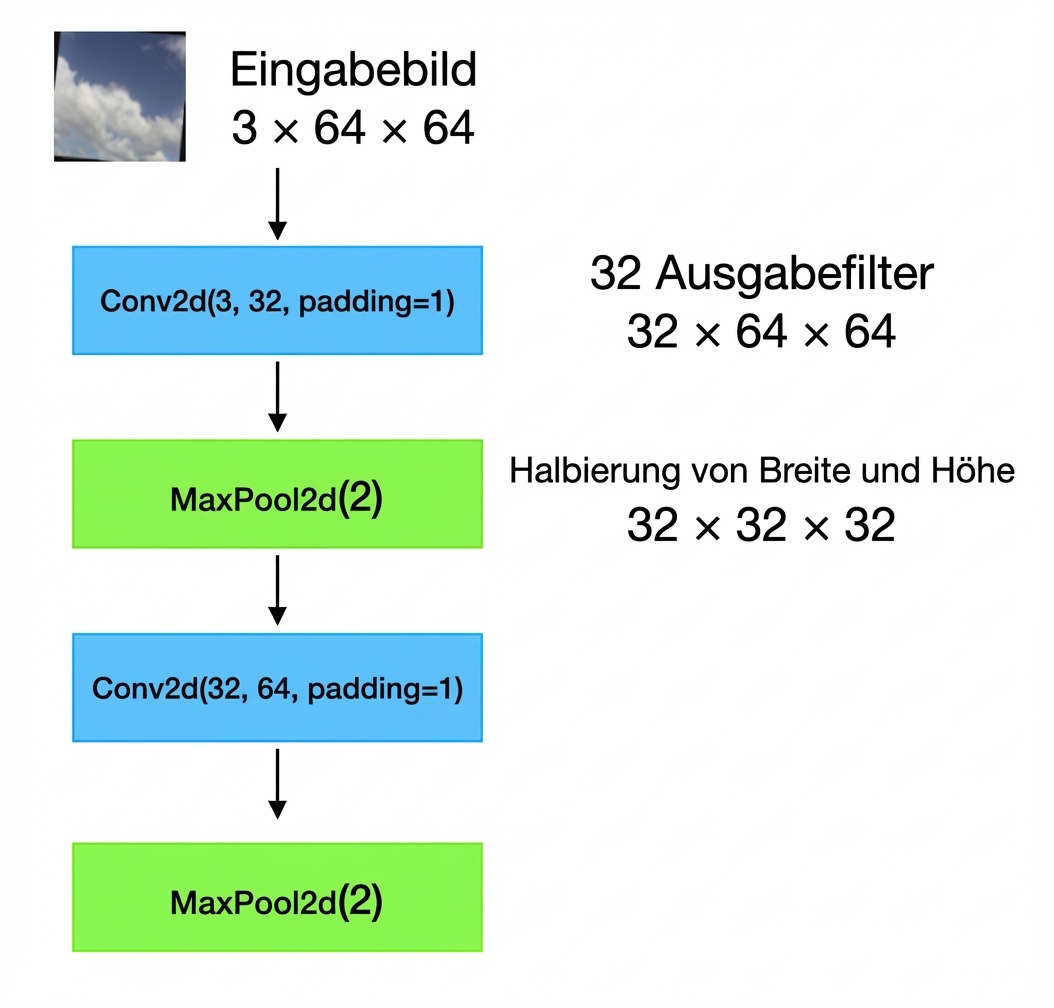

Output-Größe des Feature-Extractors

self.feature_extractor = nn.Sequential(

nn.Conv2d(3, 32, kernel_size=3, padding=1),

nn.ELU(),

nn.MaxPool2d(kernel_size=2),

nn.Conv2d(32, 64, kernel_size=3, padding=1),

nn.ELU(),

nn.MaxPool2d(kernel_size=2),

nn.Flatten(),

)

self.classifier = nn.Linear(64*16*16, num_classes)

`

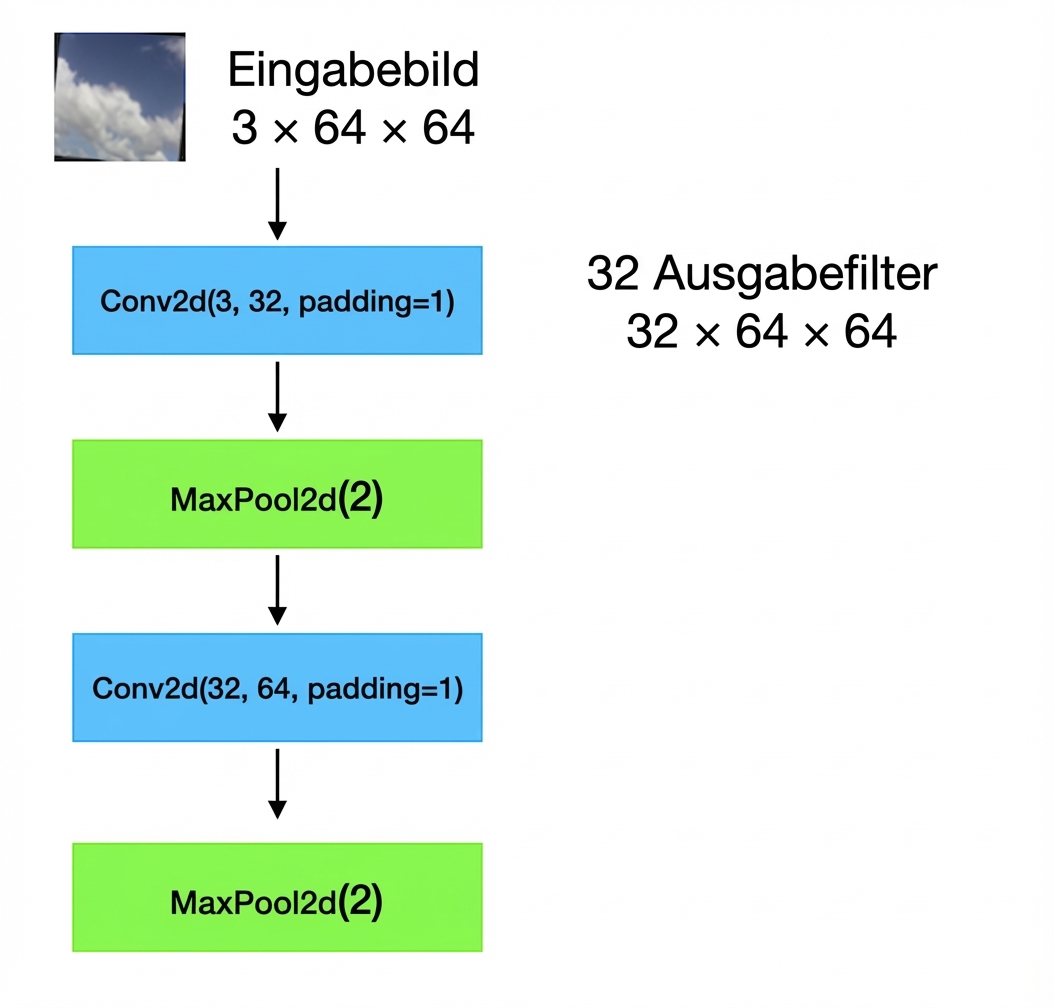

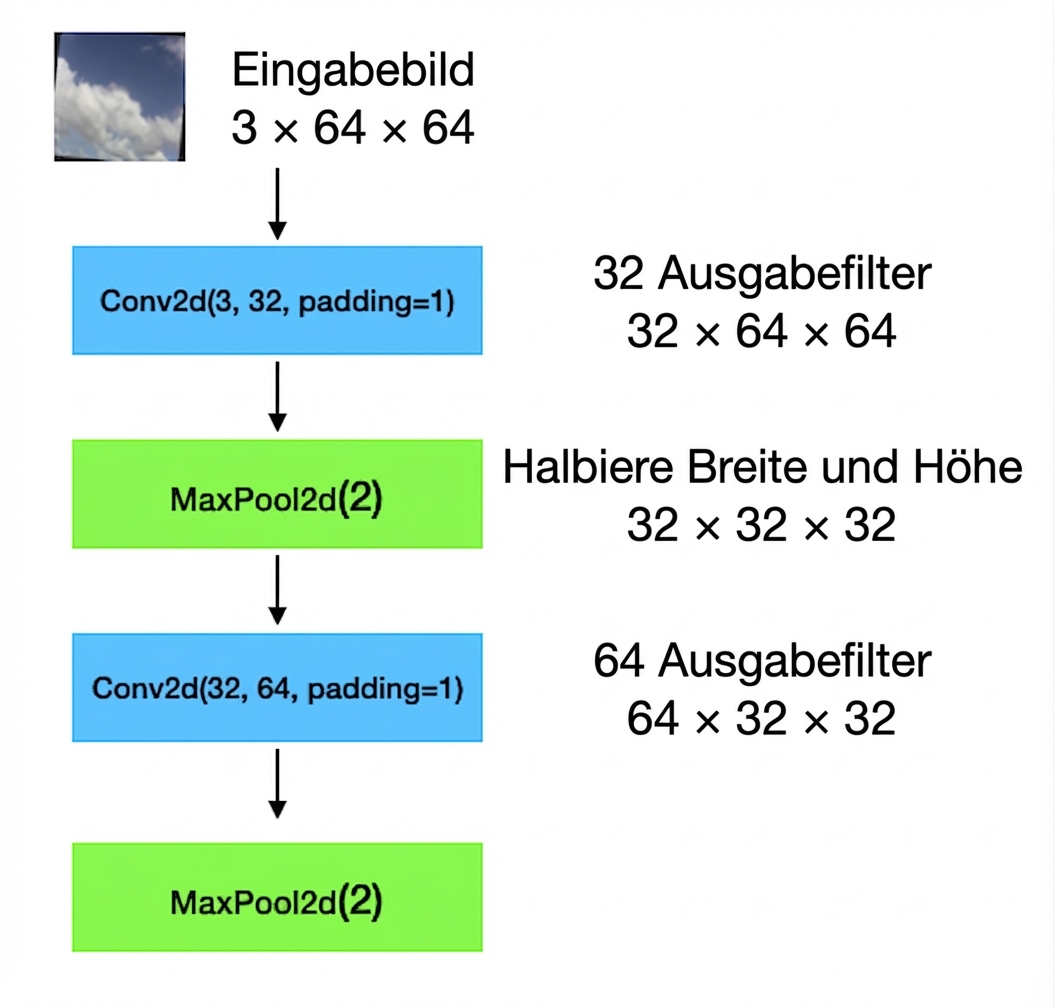

Output-Größe des Feature-Extractors

self.feature_extractor = nn.Sequential(

nn.Conv2d(3, 32, kernel_size=3, padding=1),

nn.ELU(),

nn.MaxPool2d(kernel_size=2),

nn.Conv2d(32, 64, kernel_size=3, padding=1),

nn.ELU(),

nn.MaxPool2d(kernel_size=2),

nn.Flatten(),

)

self.classifier = nn.Linear(64*16*16, num_classes)

`

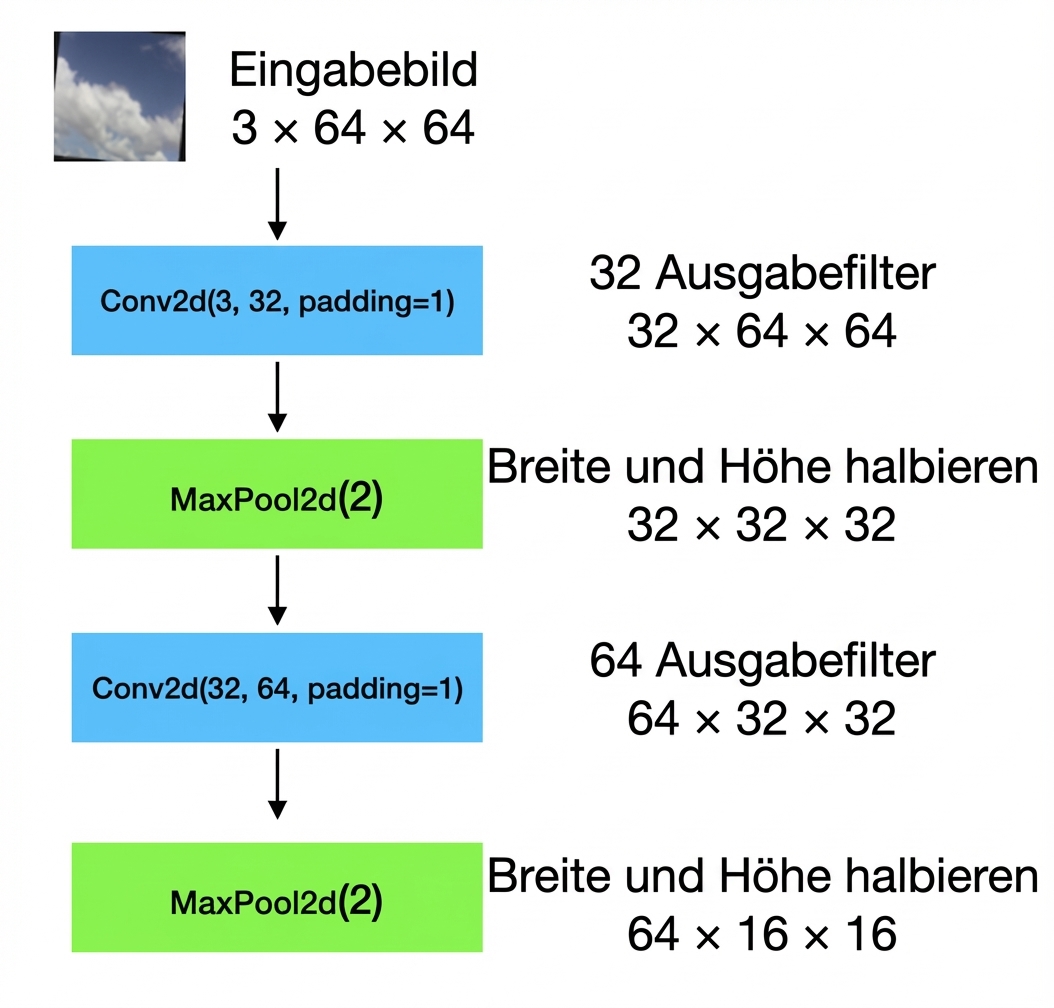

Output-Größe des Feature-Extractors

self.feature_extractor = nn.Sequential(

nn.Conv2d(3, 32, kernel_size=3, padding=1),

nn.ELU(),

nn.MaxPool2d(kernel_size=2),

nn.Conv2d(32, 64, kernel_size=3, padding=1),

nn.ELU(),

nn.MaxPool2d(kernel_size=2),

nn.Flatten(),

)

self.classifier = nn.Linear(64*16*16, num_classes)

`

Output-Größe des Feature-Extractors

self.feature_extractor = nn.Sequential(

nn.Conv2d(3, 32, kernel_size=3, padding=1),

nn.ELU(),

nn.MaxPool2d(kernel_size=2),

nn.Conv2d(32, 64, kernel_size=3, padding=1),

nn.ELU(),

nn.MaxPool2d(kernel_size=2),

nn.Flatten(),

)

self.classifier = nn.Linear(64*16*16, num_classes)

`

Output-Größe des Feature-Extractors

self.feature_extractor = nn.Sequential(

nn.Conv2d(3, 32, kernel_size=3, padding=1),

nn.ELU(),

nn.MaxPool2d(kernel_size=2),

nn.Conv2d(32, 64, kernel_size=3, padding=1),

nn.ELU(),

nn.MaxPool2d(kernel_size=2),

nn.Flatten(),

)

self.classifier = nn.Linear(64*16*16, num_classes)

`

Lass uns üben!

Deep Learning mit PyTorch für Fortgeschrittene