Exécution des modèles Hugging Face

Travailler avec Hugging Face

Jacob H. Marquez

Lead Data Engineer

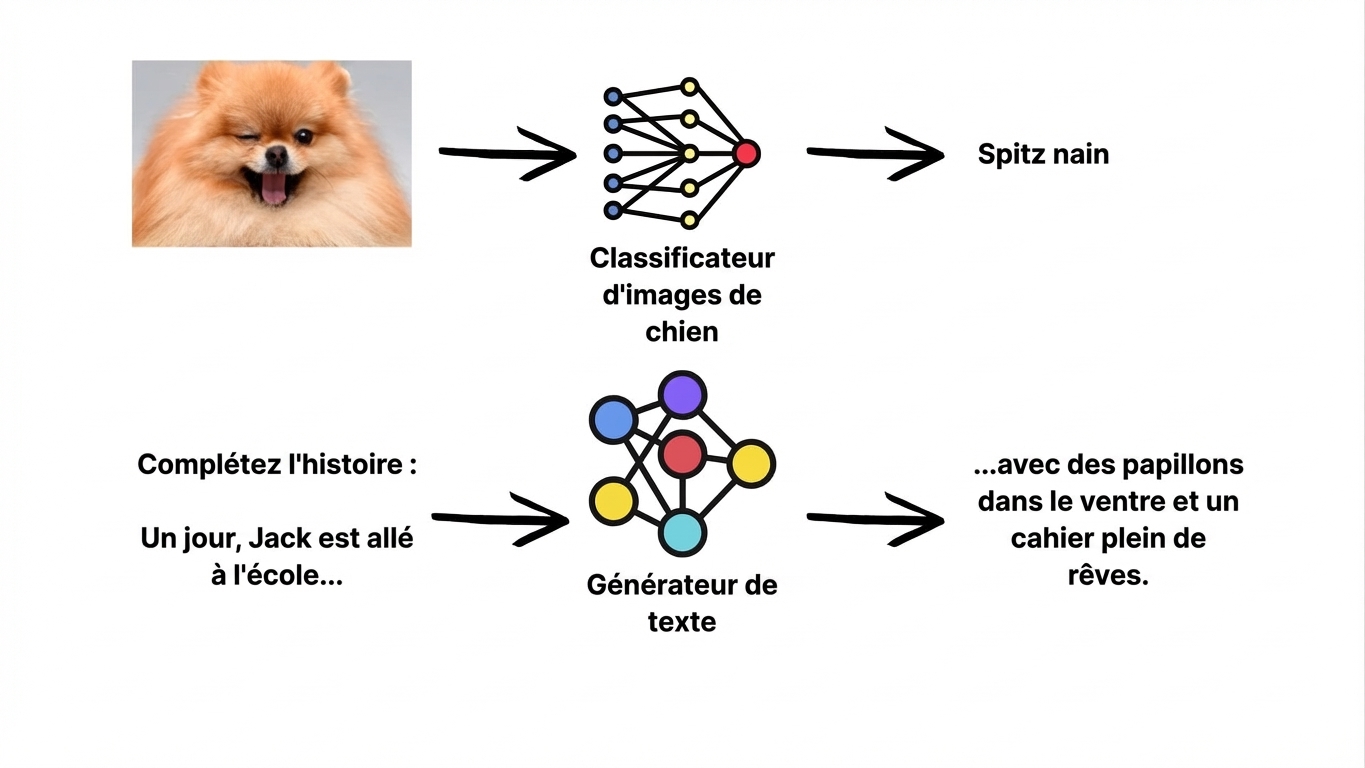

Inférence avec Hugging Face

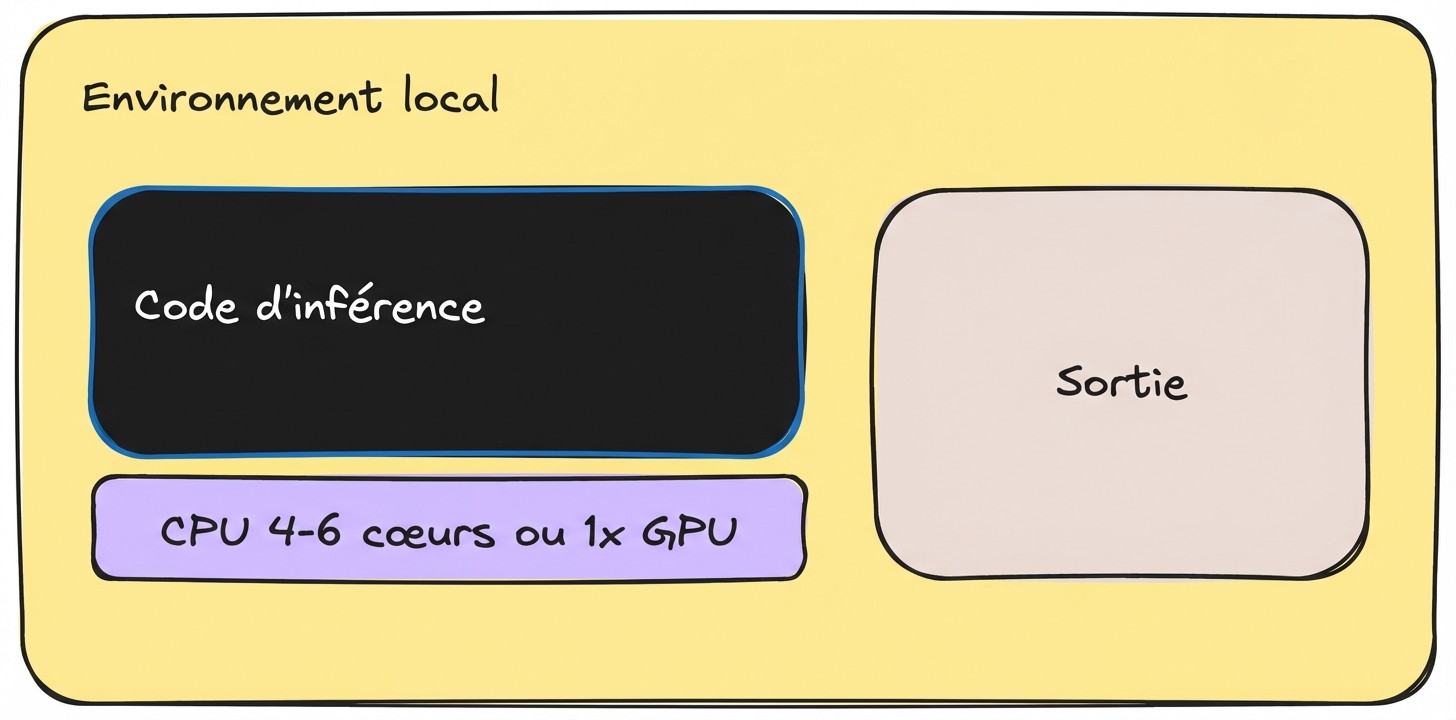

Inférence locale

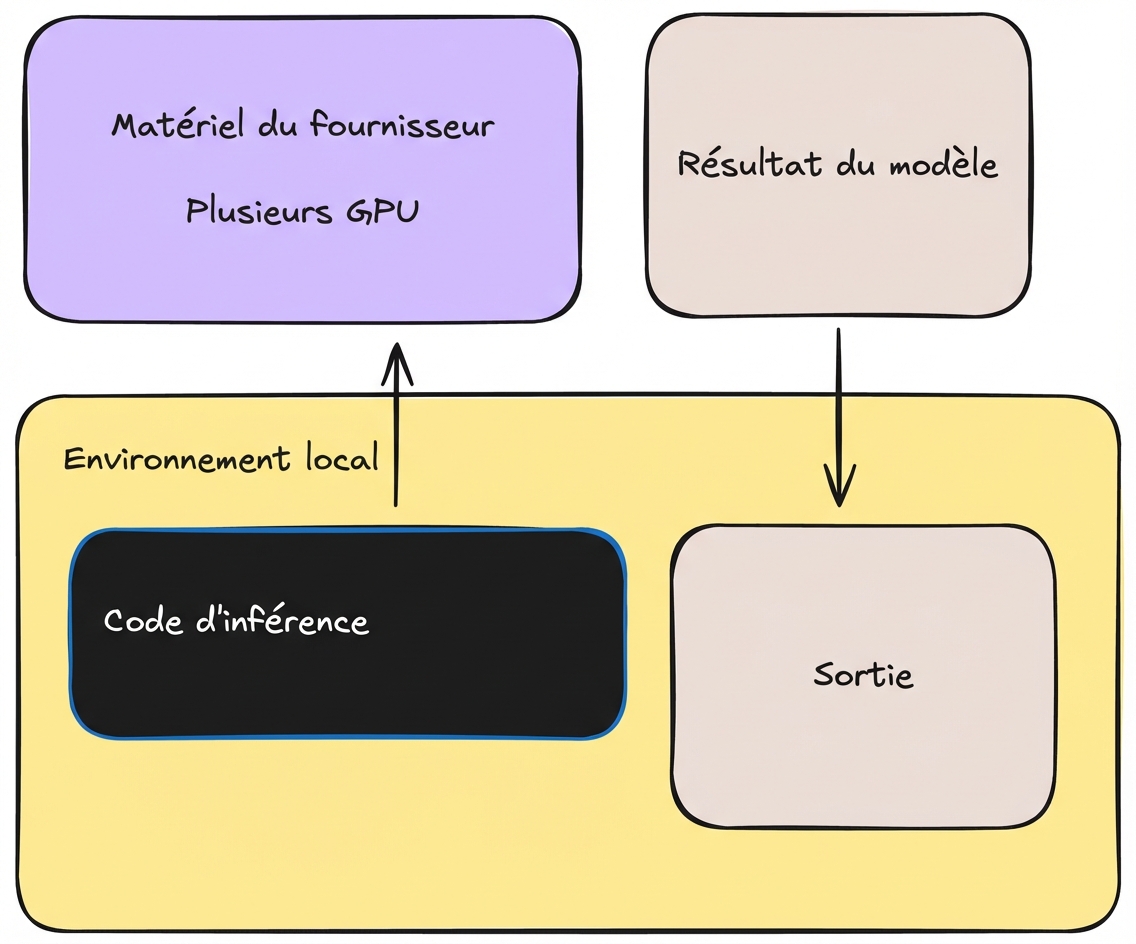

Fournisseurs d'inférence

1 https://huggingface.co/docs/inference-providers/en/index

Inférence avec Hugging Face

Inférence locale

- 🆓 Gratuit

- 😃 Pratique

- 😴 Lent et exigeant en ressources

Fournisseurs d'inférence

- 💨 Rapide

- 🆓 Gratuit pour commencer

1 https://huggingface.co/docs/inference-providers/en/index

Présentation de la bibliothèque Transformers

- Simplifie le travail avec des modèles pré-entraînés

1 https://github.com/huggingface/transformers

Le pipeline

from transformers import pipelinegpt2_pipeline = pipeline(task="text-generation", model="openai-community/gpt2")print(gpt2_pipeline("What if AI"))

[{'generated_text': 'What if AI wouldn\'t be used?"

I had to agree with your

theory. If a machine\'s learning algorithm is a perfect match for all of a

human\'s needs, then you may not have a problem with it. My problem was whether'}]

1 Fiche modèle : https://huggingface.co/openai-community/gpt2

Ajustement des paramètres du pipeline

from transformers import pipeline gpt2_pipeline = pipeline(task="text-generation", model="openai-community/gpt2")results = gpt2_pipeline("What if AI", max_new_tokens=10, num_return_sequences=2)for result in results: print(result['generated_text'])

What if AI had never existed?

What if AI could be really smarter than us?

Utilisation des fournisseurs d'inférence

import os

from huggingface_hub import InferenceClient

client = InferenceClient(

provider="together",

api_key=os.environ["HF_TOKEN"],

)

1 https://huggingface.co/docs/inference-providers/en/index

completion = client.chat.completions.create(

model="deepseek-ai/DeepSeek-V3",

messages=[

{

"role": "user",

"content": "What is the capital of France?"

}

],

)

1 https://huggingface.co/docs/inference-providers/en/index

print(completion.choices[0].message)

The capital of France is **Paris**. It is known for its iconic landmarks such as

the Eiffel Tower, the Louvre Museum, and Notre-Dame Cathedral.

Would you like any additional information about Paris or France?

Passons à la pratique !

Travailler avec Hugging Face