Grundlagen von Big Data

Grundlagen von Big Data mit PySpark

Upendra Devisetty

Science Analyst, CyVerse

Was ist Big Data?

- Big Data bezeichnet die Analyse und Anwendung von Datensätzen, die für herkömmliche Datenverarbeitungssoftware zu komplex sind – Wikipedia

Die 3 Vs von Big Data

Volumen, Vielfalt und Geschwindigkeit

Volumen: Größe der Daten

Vielfalt: Unterschiedliche Quellen und Formate

Geschwindigkeit: Tempo der Daten

Big-Data-Konzepte und -Begriffe

Cluster-Computing: Zusammenführung von Ressourcen mehrerer Maschinen

Paralleles Rechnen: Gleichzeitige Berechnung auf einem Rechner

Verteiltes Rechnen: Verbund vernetzter Knoten, die parallel laufen

Batch-Verarbeitung: Job in Teile zerlegen und auf einzelnen Maschinen ausführen

Echtzeitverarbeitung: Unmittelbare Verarbeitung von Daten

Systeme zur Big-Data-Verarbeitung

Hadoop/MapReduce: Skalierbares, fehlertolerantes Framework in Java

Open Source

Batch-Verarbeitung

Apache Spark: Allgemeines, sehr schnelles Cluster-Computing-System

Open Source

Batch- und Echtzeitverarbeitung

Hinweis: Apache Spark wird heute meist Hadoop/MapReduce vorgezogen

Funktionen des Apache-Spark-Frameworks

Verteiltes Cluster-Computing-Framework

Effiziente In-Memory-Berechnungen für große Datensätze

Blitzschnelles Datenverarbeitungs-Framework

Unterstützt Java, Scala, Python, R und SQL

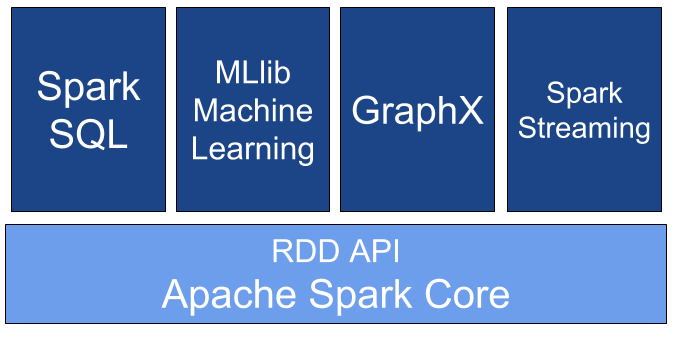

Apache Spark: Komponenten

Spark-Bereitstellungsmodi

Lokaler Modus: Einzelner Rechner, z. B. dein Laptop

- Praktisch für Tests, Debugging und Demos

Cluster-Modus: Satz vordefinierter Maschinen

- Gut für Produktion

Workflow: Lokal -> Cluster

Kein Codewechsel nötig

Als Nächstes: PySpark

Grundlagen von Big Data mit PySpark