Introduction au clustering

Principes fondamentaux des mégadonnées avec PySpark

Upendra Devisetty

Science Analyst, CyVerse

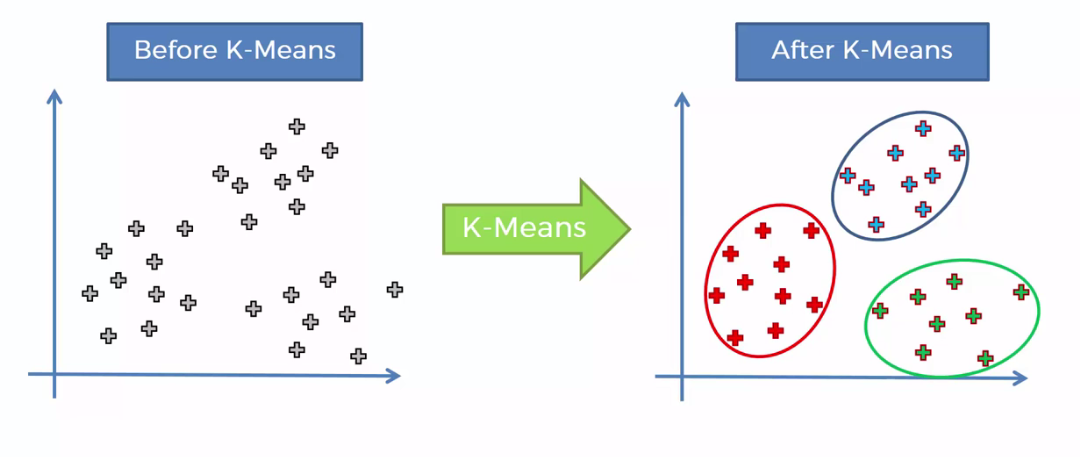

Qu’est-ce que le clustering ?

Le clustering est une tâche d’apprentissage non supervisé qui regroupe des données en ensembles

La bibliothèque PySpark MLlib prend en charge les modèles suivants

- K-means

- Mélange gaussien

- Clustering par itération de puissance (PIC)

- K-means biséqué

- K-means en flux (streaming)

Clustering K-means

- K-means est la méthode de clustering la plus courante

K-means avec Spark MLLib

RDD = sc.textFile("WineData.csv"). \

map(lambda x: x.split(",")).\

map(lambda x: [float(x[0]), float(x[1])])

RDD.take(5)

[[14.23, 2.43], [13.2, 2.14], [13.16, 2.67], [14.37, 2.5], [13.24, 2.87]]

Entraîner un modèle K-means

- L’apprentissage du modèle K-means se fait avec la méthode

KMeans.train()

from pyspark.mllib.clustering import KMeans

model = KMeans.train(RDD, k = 2, maxIterations = 10)

model.clusterCenters

[array([12.25573171, 2.28939024]), array([13.636875 , 2.43239583])]

Évaluer le modèle K-means

from math import sqrt

def error(point):

center = model.centers[model.predict(point)]

return sqrt(sum([x**2 for x in (point - center)]))

WSSSE = RDD.map(lambda point: error(point)).reduce(lambda x, y: x + y)

print("Within Set Sum of Squared Error = " + str(WSSSE))

Within Set Sum of Squared Error = 77.96236420499056

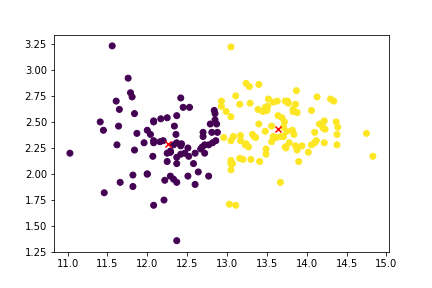

Visualiser les clusters K-means

Visualiser les clusters

wine_data_df = spark.createDataFrame(RDD, schema=["col1", "col2"])

wine_data_df_pandas = wine_data_df.toPandas()

cluster_centers_pandas = pd.DataFrame(model.clusterCenters, columns=["col1", "col2"])

cluster_centers_pandas.head()

plt.scatter(wine_data_df_pandas["col1"], wine_data_df_pandas["col2"]);

plt.scatter(cluster_centers_pandas["col1"], cluster_centers_pandas["col2"], color="red", marker="x");

Exercice sur le clustering

Principes fondamentaux des mégadonnées avec PySpark