Opérations RDD en PySpark

Principes fondamentaux des mégadonnées avec PySpark

Upendra Devisetty

Science Analyst, CyVerse

Aperçu des opérations PySpark

- Les transformations créent de nouveaux RDD

- Les actions exécutent des calculs sur les RDD

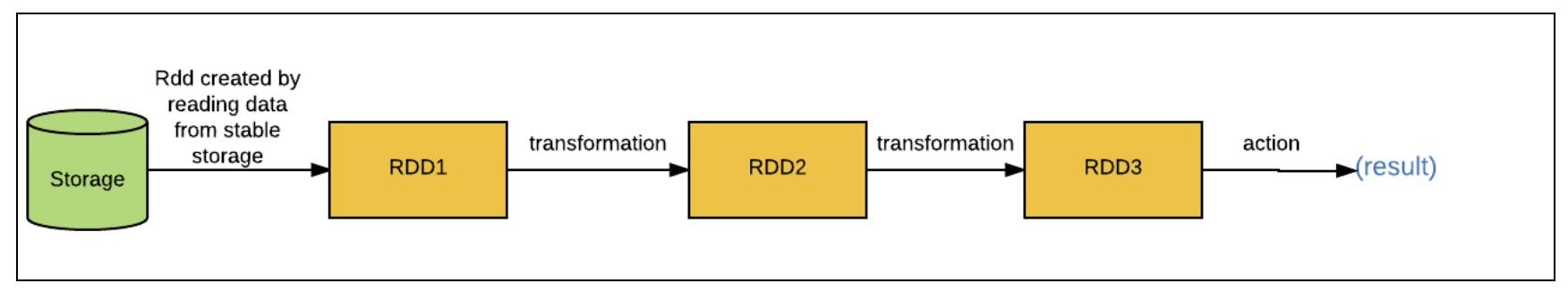

Transformations RDD

- Les transformations utilisent l’évaluation paresseuse (Lazy evaluation)

Transformations RDD de base

map(),filter(),flatMap(), etunion()

Transformation map()

- La transformation map() applique une fonction à tous les éléments du RDD

RDD = sc.parallelize([1,2,3,4])

RDD_map = RDD.map(lambda x: x * x)

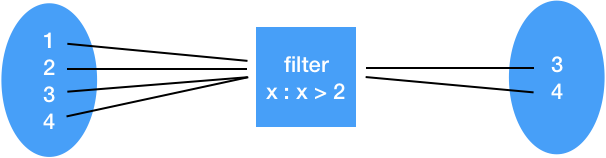

Transformation filter()

- La transformation filter retourne un nouveau RDD avec seulement les éléments satisfaisant la condition

RDD = sc.parallelize([1,2,3,4])

RDD_filter = RDD.filter(lambda x: x > 2)

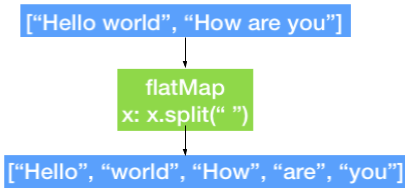

Transformation flatMap()

- La transformation flatMap() renvoie plusieurs valeurs pour chaque élément du RDD d’origine

RDD = sc.parallelize(["hello world", "how are you"])

RDD_flatmap = RDD.flatMap(lambda x: x.split(" "))

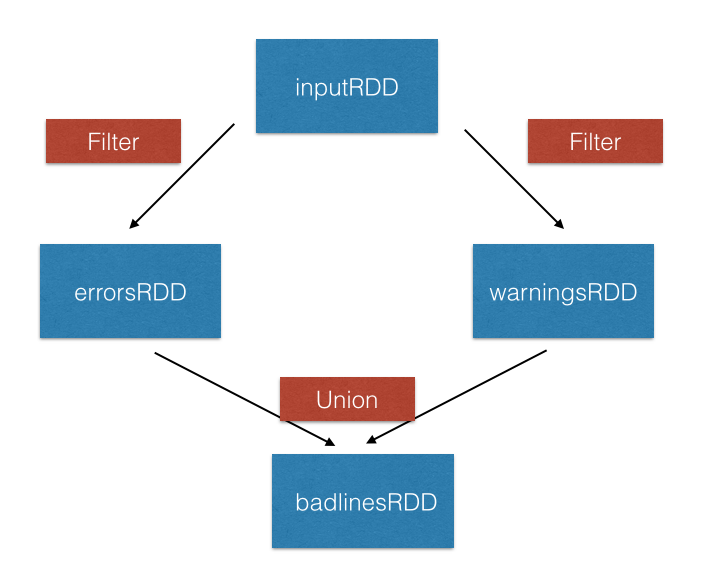

Transformation union()

inputRDD = sc.textFile("logs.txt")

errorRDD = inputRDD.filter(lambda x: "error" in x.split())

warningsRDD = inputRDD.filter(lambda x: "warnings" in x.split())

combinedRDD = errorRDD.union(warningsRDD)

Actions RDD

Opérations renvoyant une valeur après calcul sur le RDD

Actions RDD de base

collect()

take(N)

first()

count()

Actions collect() et take()

collect() renvoie tous les éléments du jeu de données sous forme de tableau

take(N) renvoie un tableau avec les N premiers éléments

RDD_map.collect()

[1, 4, 9, 16]

RDD_map.take(2)

[1, 4]

Actions first() et count()

- first() affiche le premier élément du RDD

RDD_map.first()

[1]

- count() renvoie le nombre d’éléments du RDD

RDD_flatmap.count()

5

Passons à la pratique !

Principes fondamentaux des mégadonnées avec PySpark