Optimiseurs, entraînement et évaluation

Deep learning intermédiaire avec PyTorch

Michal Oleszak

Machine Learning Engineer

Boucle d’entraînement

import torch.nn as nn import torch.optim as optim criterion = nn.BCELoss() optimizer = optim.SGD(net.parameters(), lr=0.01)for epoch in range(1000): for features, labels in dataloader_train:optimizer.zero_grad()outputs = net(features)loss = criterion( outputs, labels.view(-1, 1) )loss.backward()optimizer.step()

- Définir la fonction de perte et l’optimiseur

BCELosspour classification binaire- Optimiseur

SGD

- Itérer sur les époques et les lots d’entraînement

- Réinitialiser les gradients

- Passage avant : obtenir les sorties du modèle

- Calculer la perte

- Calculer les gradients

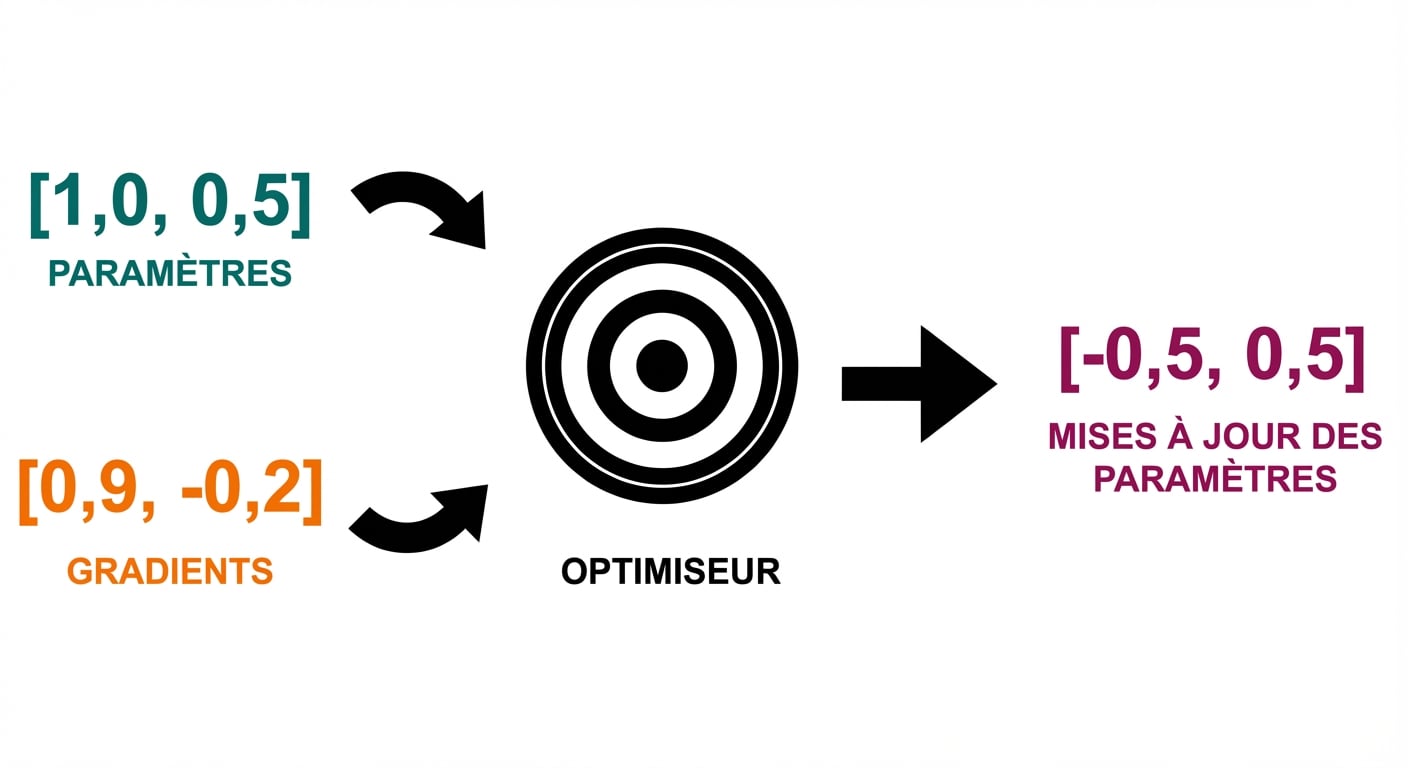

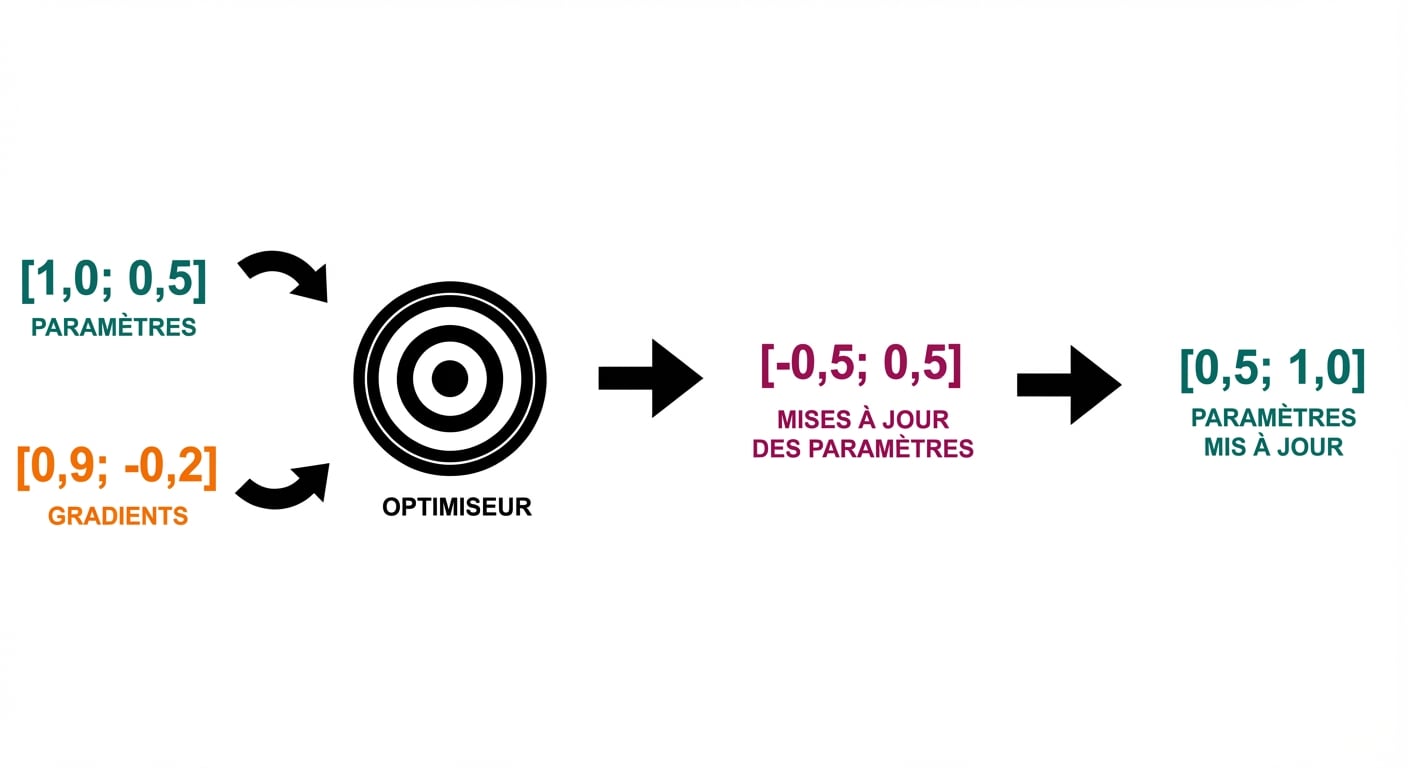

- Pas de l’optimiseur : mise à jour des paramètres

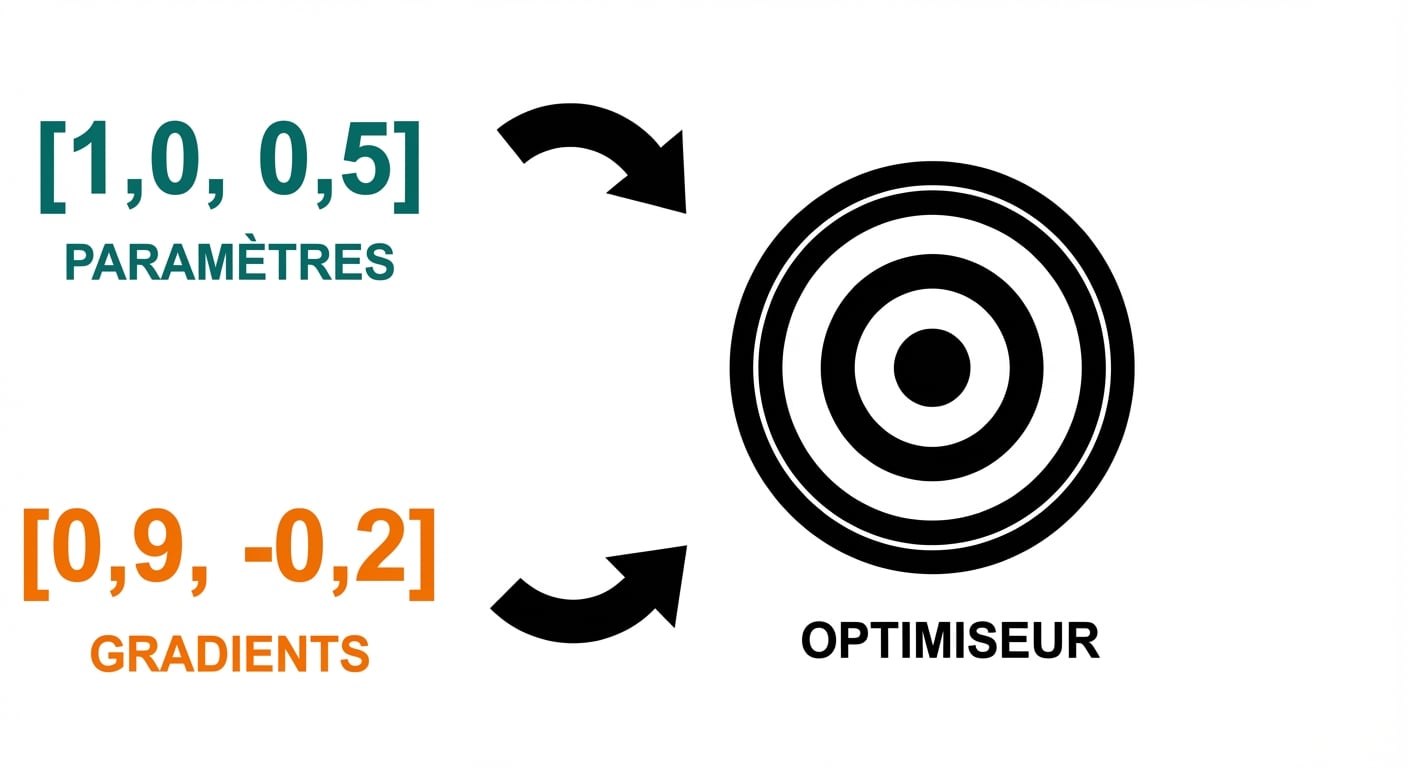

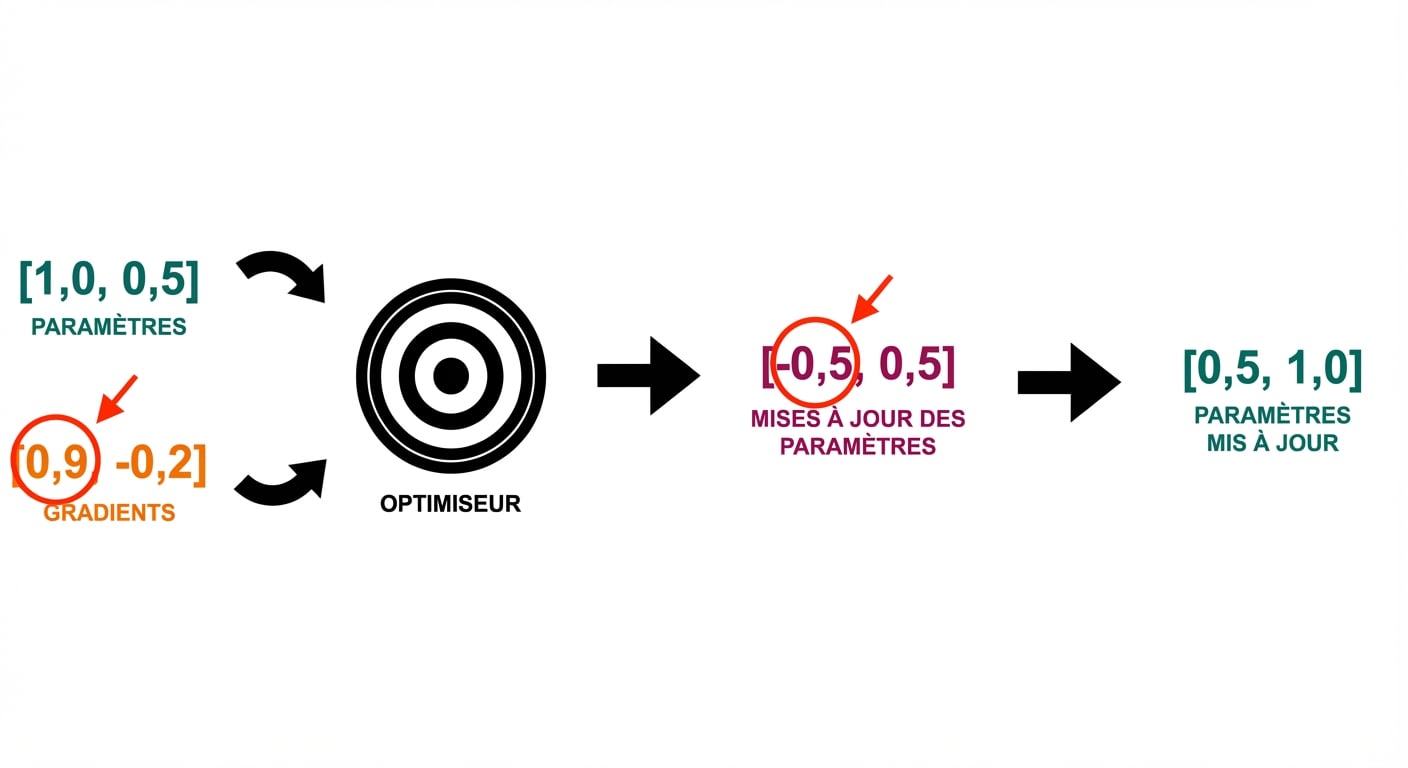

Fonctionnement d’un optimiseur

Fonctionnement d’un optimiseur

Fonctionnement d’un optimiseur

Fonctionnement d’un optimiseur

Fonctionnement d’un optimiseur

Descente de gradient stochastique (SGD)

optimizer = optim.SGD(net.parameters(), lr=0.01)

- Mise à jour dépend du taux d’apprentissage

- Simple et efficace pour des modèles basiques

- Peu utilisé en pratique

Gradient adaptatif (Adagrad)

optimizer = optim.Adagrad(net.parameters(), lr=0.01)

- Adapte le taux d’apprentissage par paramètre

- Bon pour les données clairsemées

- Peut réduire le taux trop vite

Propag. des moyennes quadratiques (RMSprop)

optimizer = optim.RMSprop(net.parameters(), lr=0.01)

- Mise à jour par paramètre selon la taille de ses gradients précédents

Estimation des moments adaptatifs (Adam)

optimizer = optim.Adam(net.parameters(), lr=0.01)

- Probablement le plus polyvalent et le plus utilisé

- RMSprop + momentum des gradients

- Souvent l’optimiseur par défaut

Évaluation du modèle

from torchmetrics import Accuracy acc = Accuracy(task="binary")net.eval() with torch.no_grad(): for features, labels in dataloader_test:outputs = net(features)preds = (outputs >= 0.5).float()acc(preds, labels.view(-1, 1))accuracy = acc.compute() print(f"Accuracy: {accuracy}")

Accuracy: 0.6759443283081055

- Configurer la métrique d’exactitude

- Mettre le modèle en mode éval. et itérer sur les lots test sans gradients

- Passer les données au modèle pour obtenir les probabilités prédites

- Calculer les étiquettes prédites

- Mettre à jour la métrique d’exactitude

Passons à la pratique !

Deep learning intermédiaire avec PyTorch