Cellules LSTM et GRU

Deep learning intermédiaire avec PyTorch

Michal Oleszak

Machine Learning Engineer

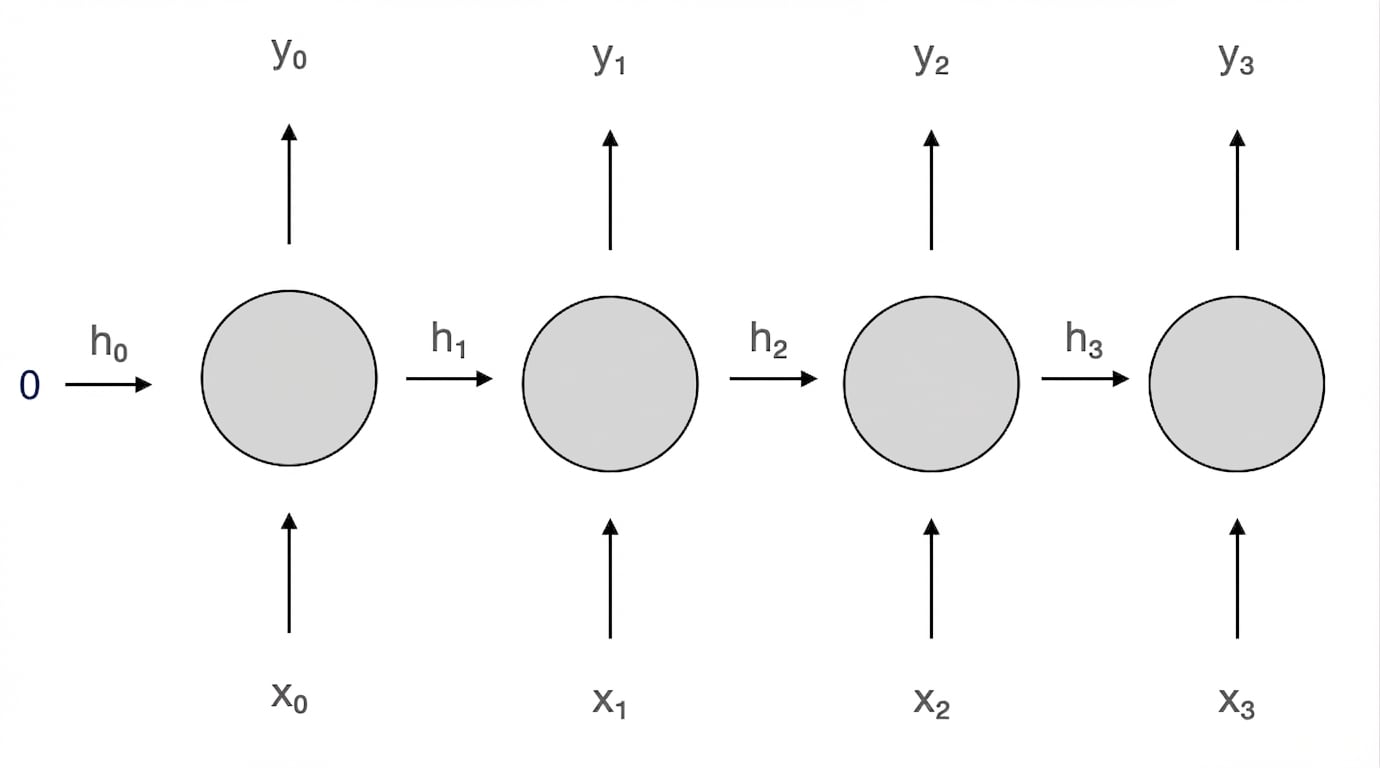

Problème de mémoire court terme

- Les cellules RNN gardent une mémoire via l’état caché

- Cette mémoire est très court terme

- Deux cellules plus puissantes résolvent le problème :

- LSTM (Long Short-Term Memory)

- GRU (Gated Recurrent Unit)

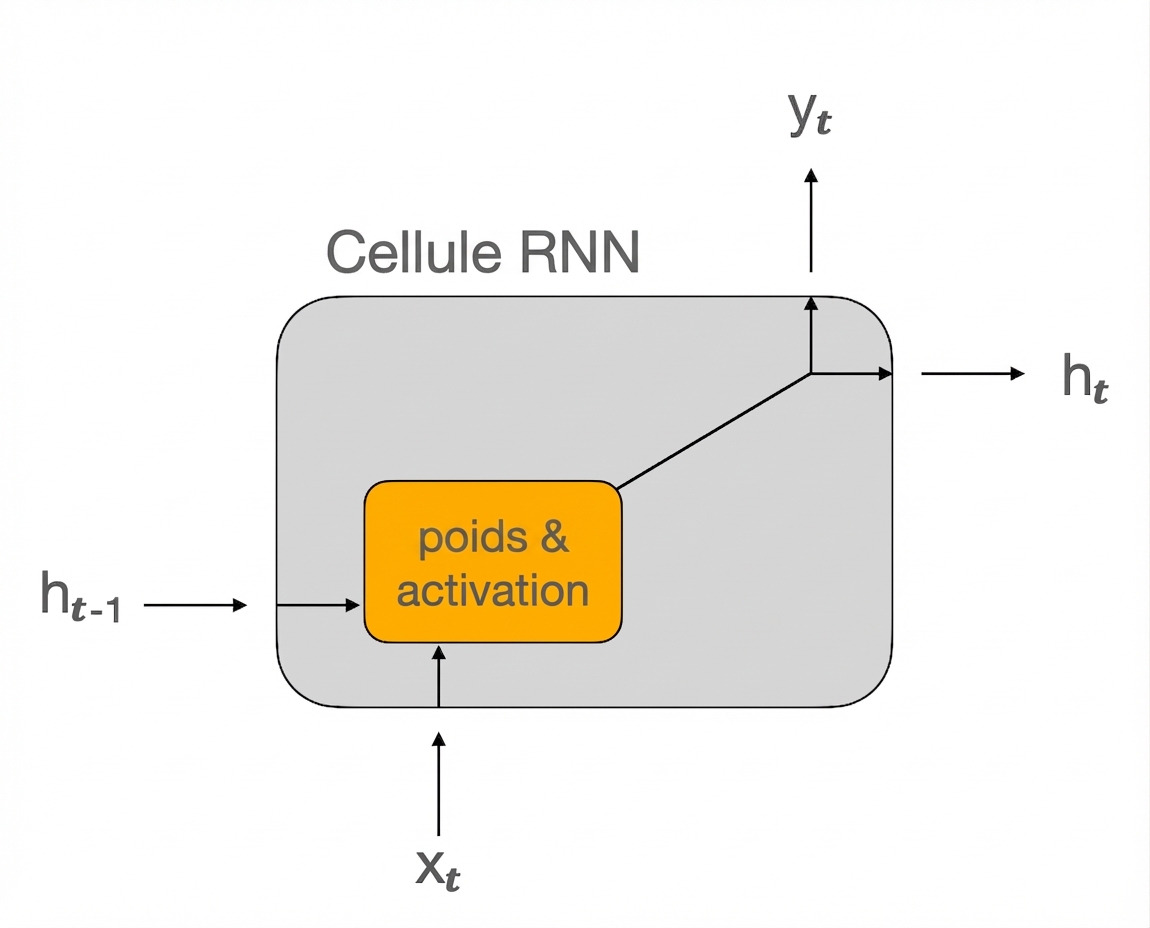

Cellule RNN

- Deux entrées :

- donnée courante

x - état caché précédent

h

- donnée courante

- Deux sorties :

- sortie courante

y - état caché suivant

h

- sortie courante

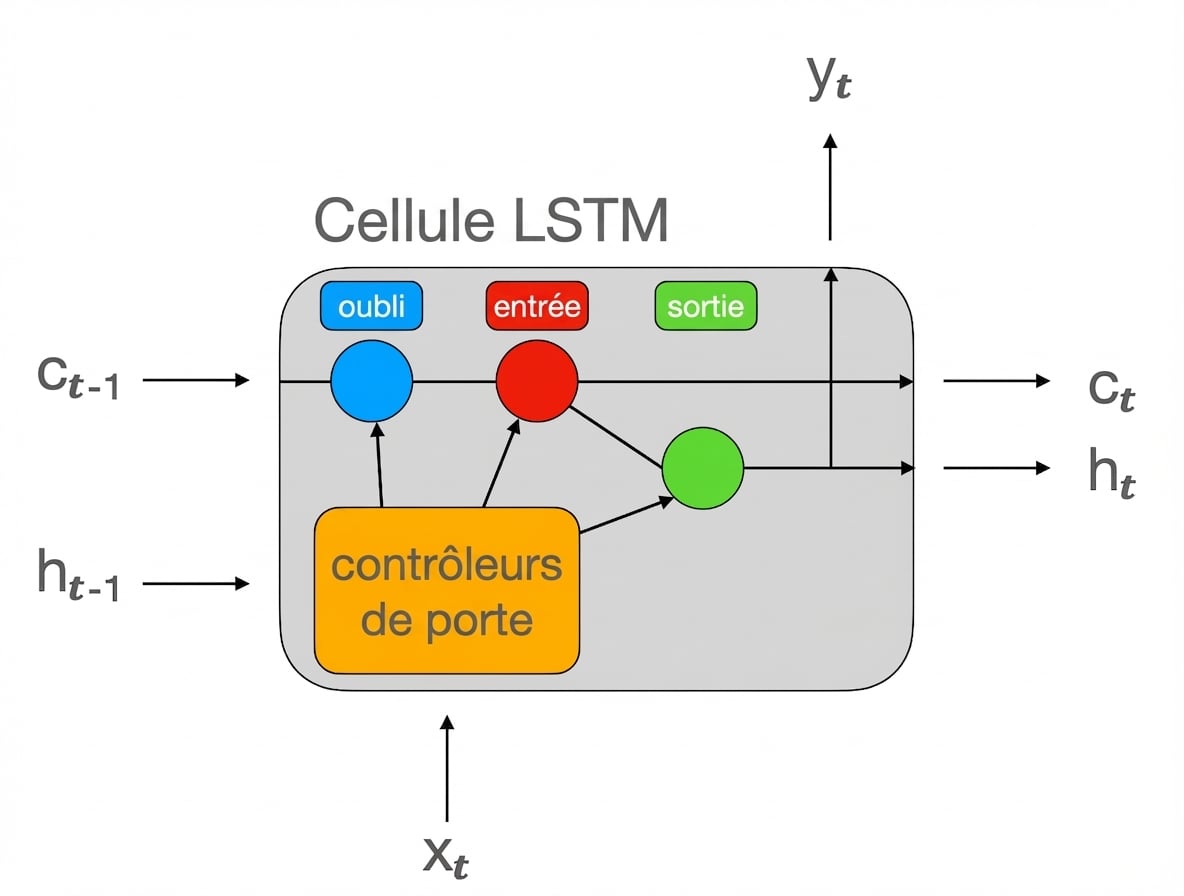

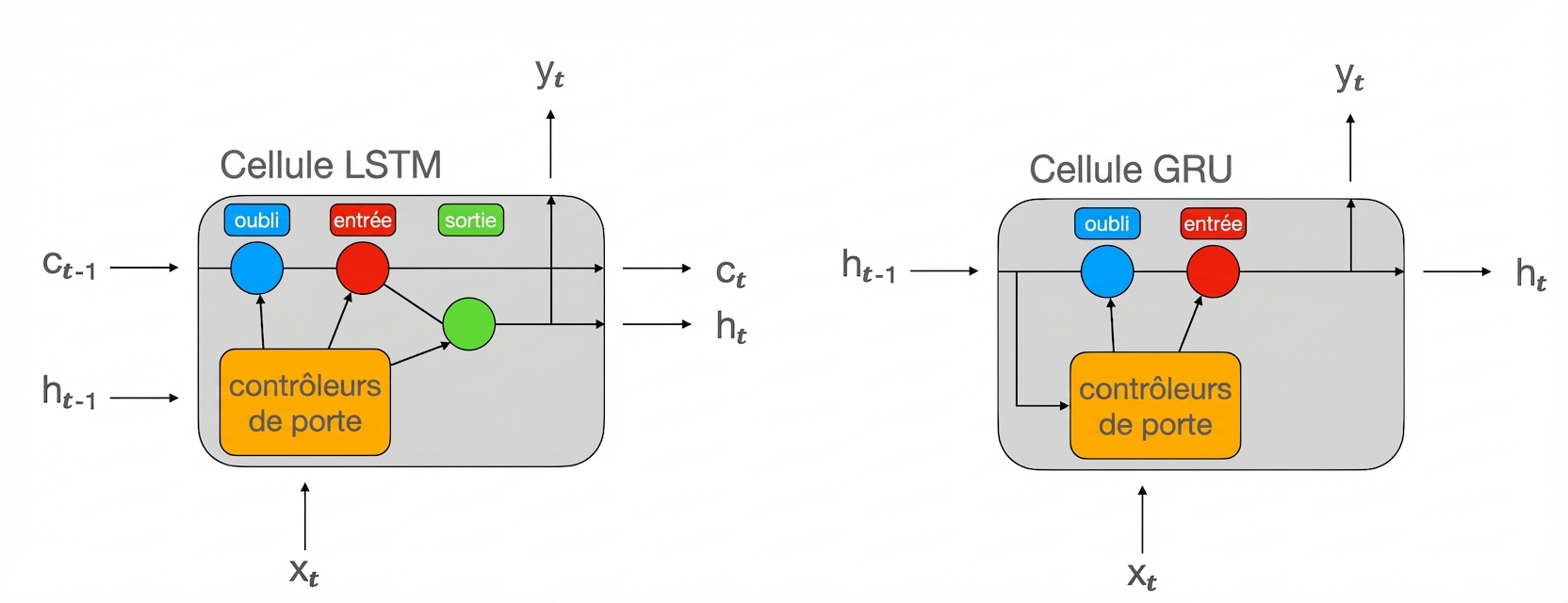

Cellule LSTM

- Les sorties

hetysont identiques

Trois entrées et sorties (deux états cachés) :

h: état court termec: état long terme

Trois « portes » :

- Porte d’oubli : quoi retirer de la mémoire long terme

- Porte d’entrée : quoi enregistrer en mémoire long terme

- Porte de sortie : quoi retourner au pas de temps courant

LSTM dans PyTorch

class Net(nn.Module): def __init__(self, input_size): super().__init__()self.lstm = nn.LSTM( input_size=1, hidden_size=32, num_layers=2, batch_first=True, ) self.fc = nn.Linear(32, 1)def forward(self, x): h0 = torch.zeros(2, x.size(0), 32) c0 = torch.zeros(2, x.size(0), 32)out, _ = self.lstm(x, (h0, c0))out = self.fc(out[:, -1, :]) return out

__init__():- Remplacez

nn.RNNparnn.LSTM

- Remplacez

forward():- Ajoutez un autre état caché

c - Initialisez

cethà zéro - Passez les deux états cachés à la couche

lstm

- Ajoutez un autre état caché

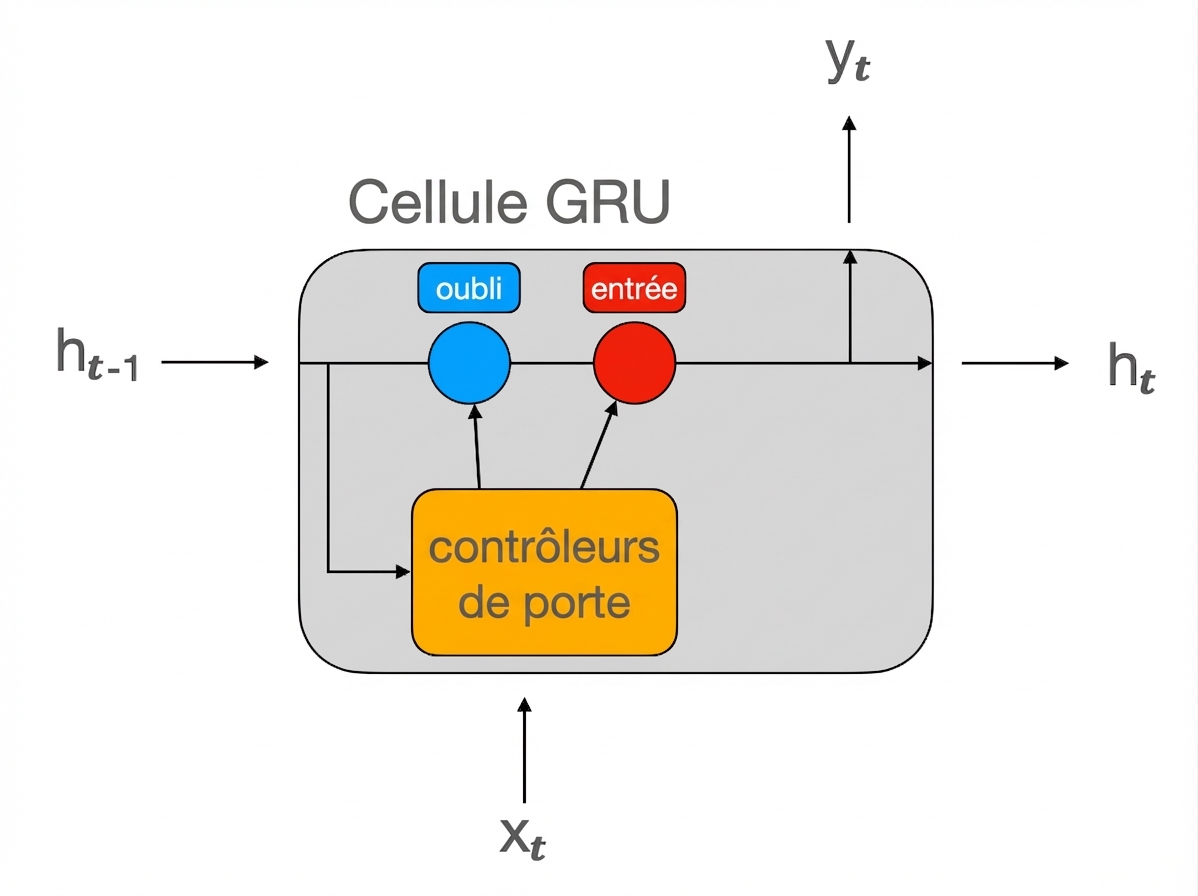

Cellule GRU

- Version simplifiée de la cellule LSTM

- Un seul état caché

- Pas de porte de sortie

GRU dans PyTorch

class Net(nn.Module): def __init__(self, input_size): super().__init__()self.gru = nn.GRU( input_size=1, hidden_size=32, num_layers=2, batch_first=True, ) self.fc = nn.Linear(32, 1)def forward(self, x): h0 = torch.zeros(2, x.size(0), 32) out, _ = self.gru(x, h0) out = self.fc(out[:, -1, :]) return out

__init__():- Remplacez

nn.RNNparnn.GRU

- Remplacez

forward():- Utilisez la couche

gru

- Utilisez la couche

Faut-il utiliser RNN, LSTM ou GRU ?

- RNN est peu utilisé désormais

- GRU est plus simple que LSTM = moins de calcul

- Les performances relatives varient selon le cas d’usage

- Testez les deux et comparez

Passons à la pratique !

Deep learning intermédiaire avec PyTorch