Réseaux de neurones récurrents

Deep learning intermédiaire avec PyTorch

Michal Oleszak

Machine Learning Engineer

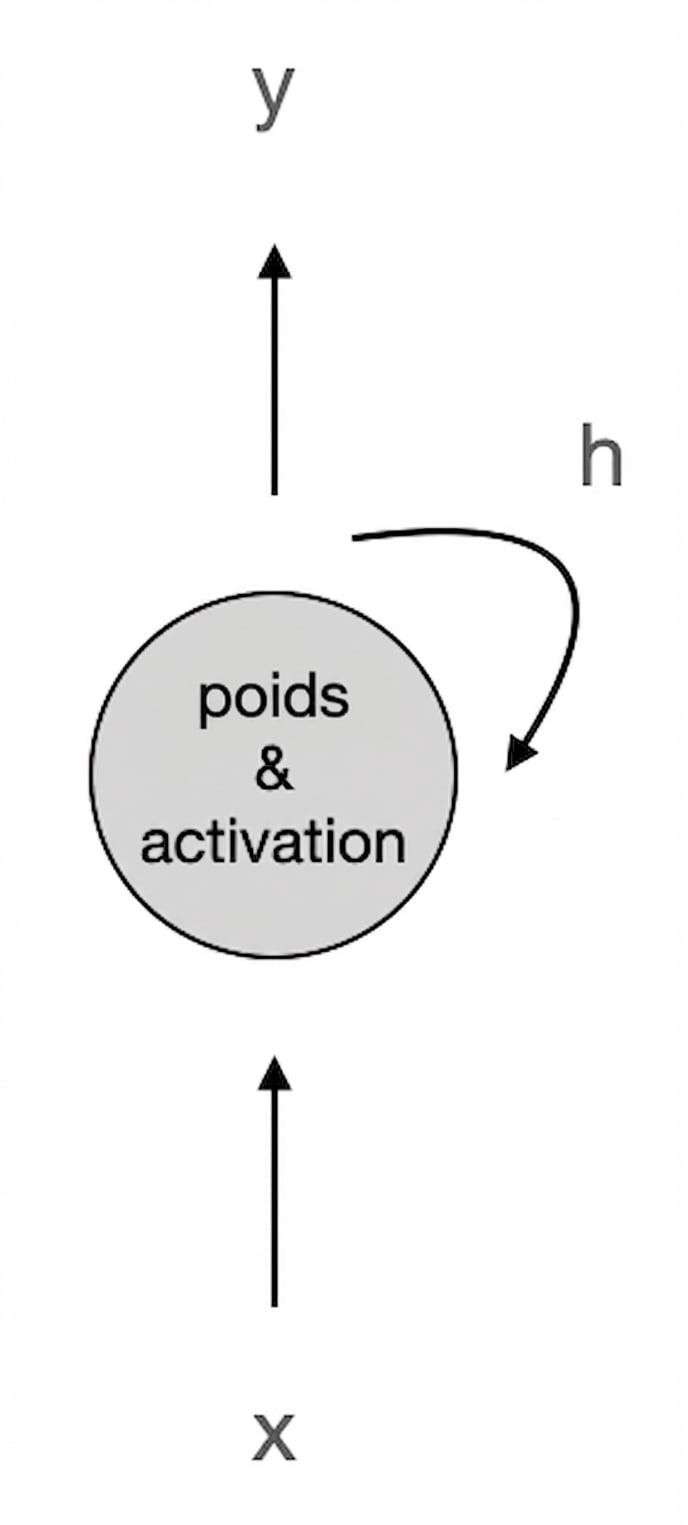

Neurone récurrent

- Réseaux feed-forward

- RNN: connexions en boucle arrière

- Neurone récurrent :

- Entrée

x - Sortie

y - État caché

h

- Entrée

- En PyTorch :

nn.RNN()

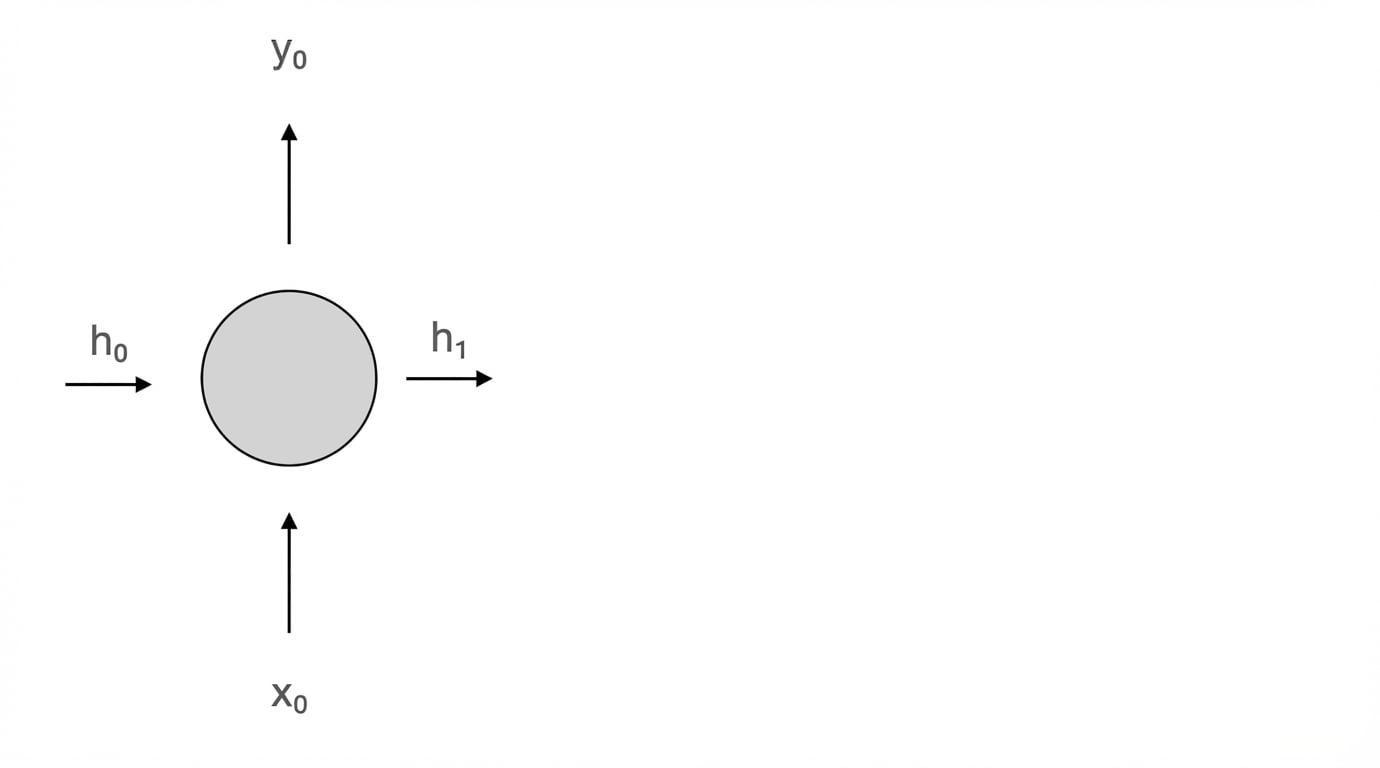

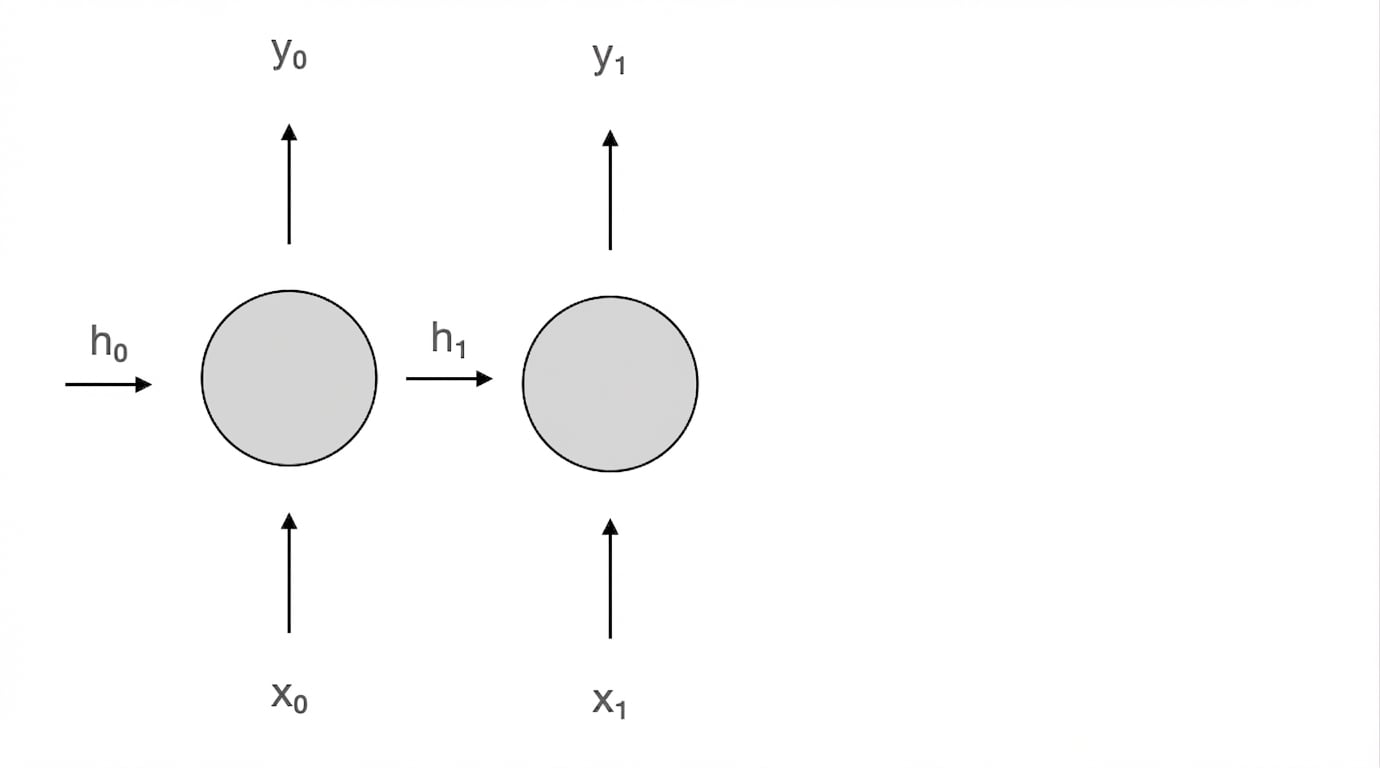

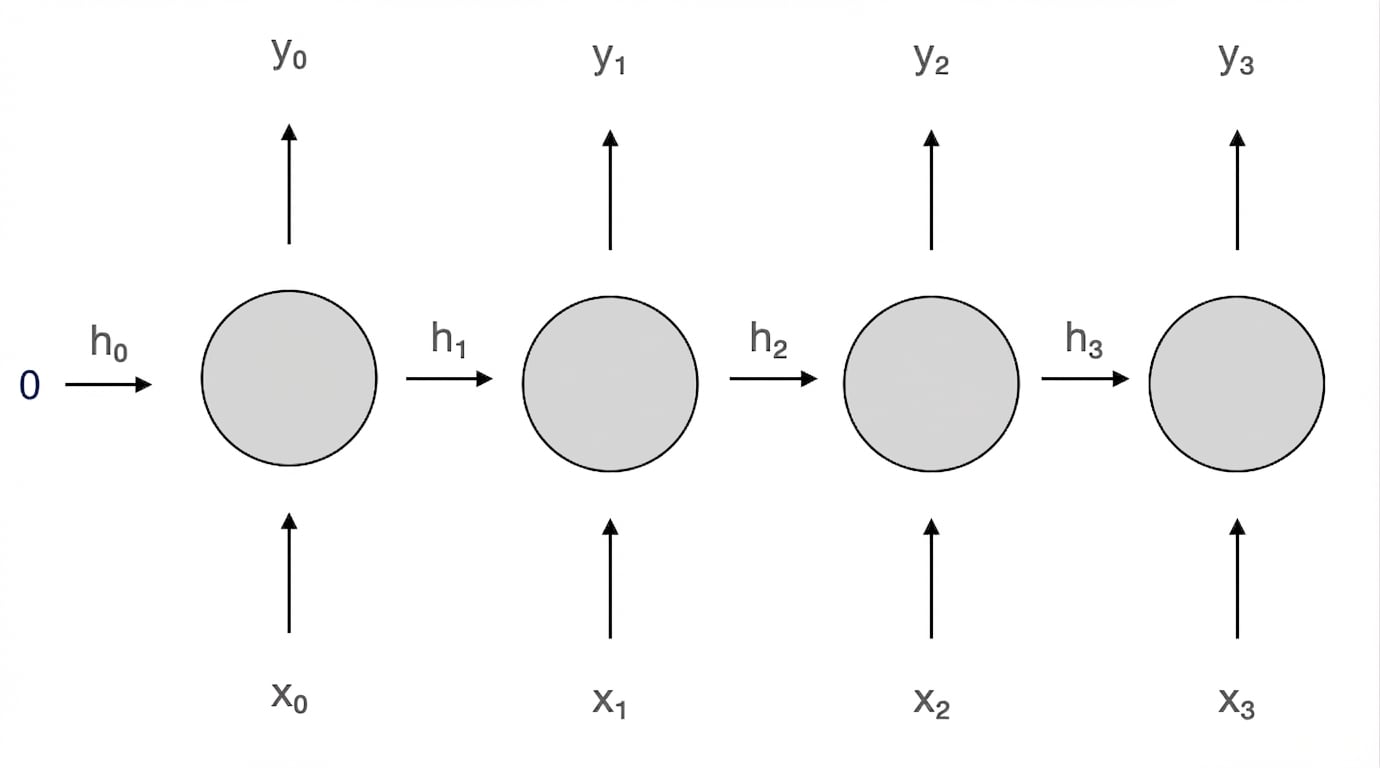

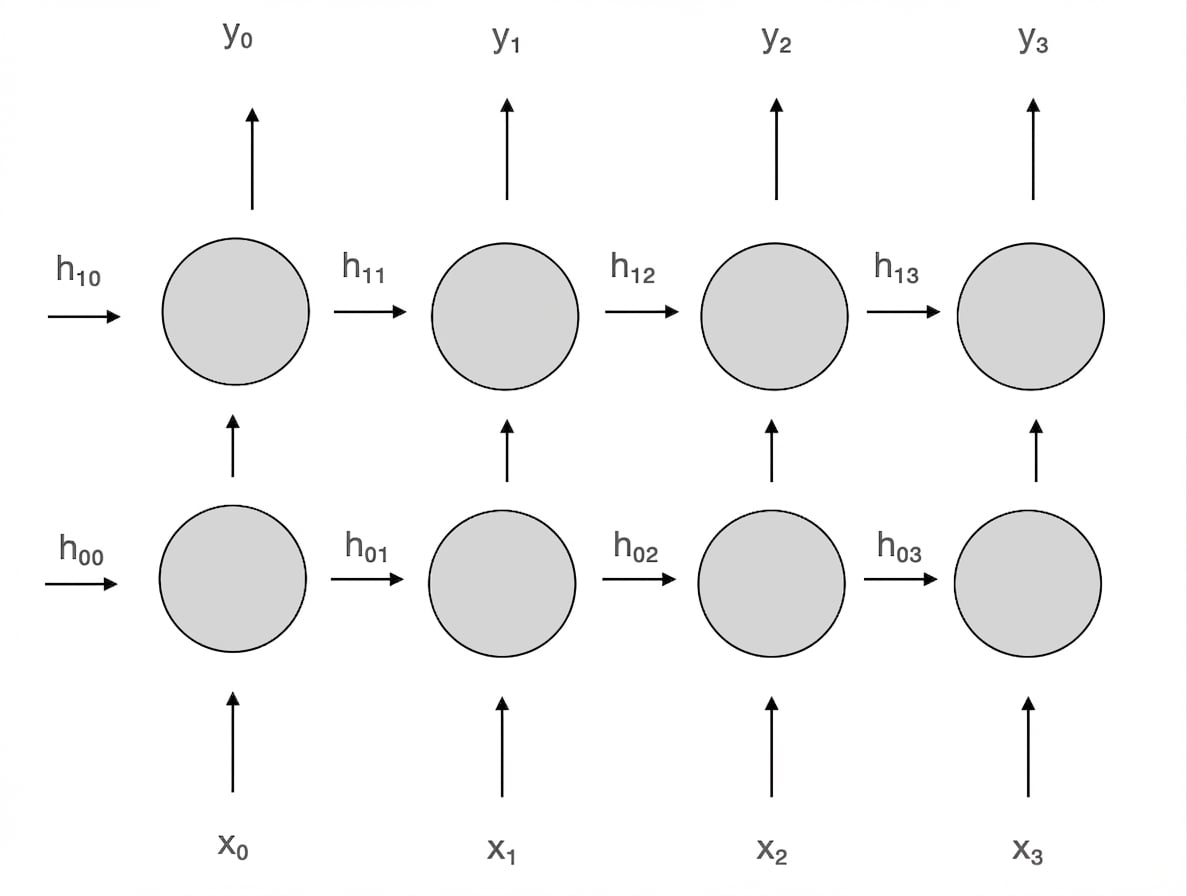

Dépliage du neurone récurrent dans le temps

Dépliage du neurone récurrent dans le temps

Dépliage du neurone récurrent dans le temps

RNN profonds

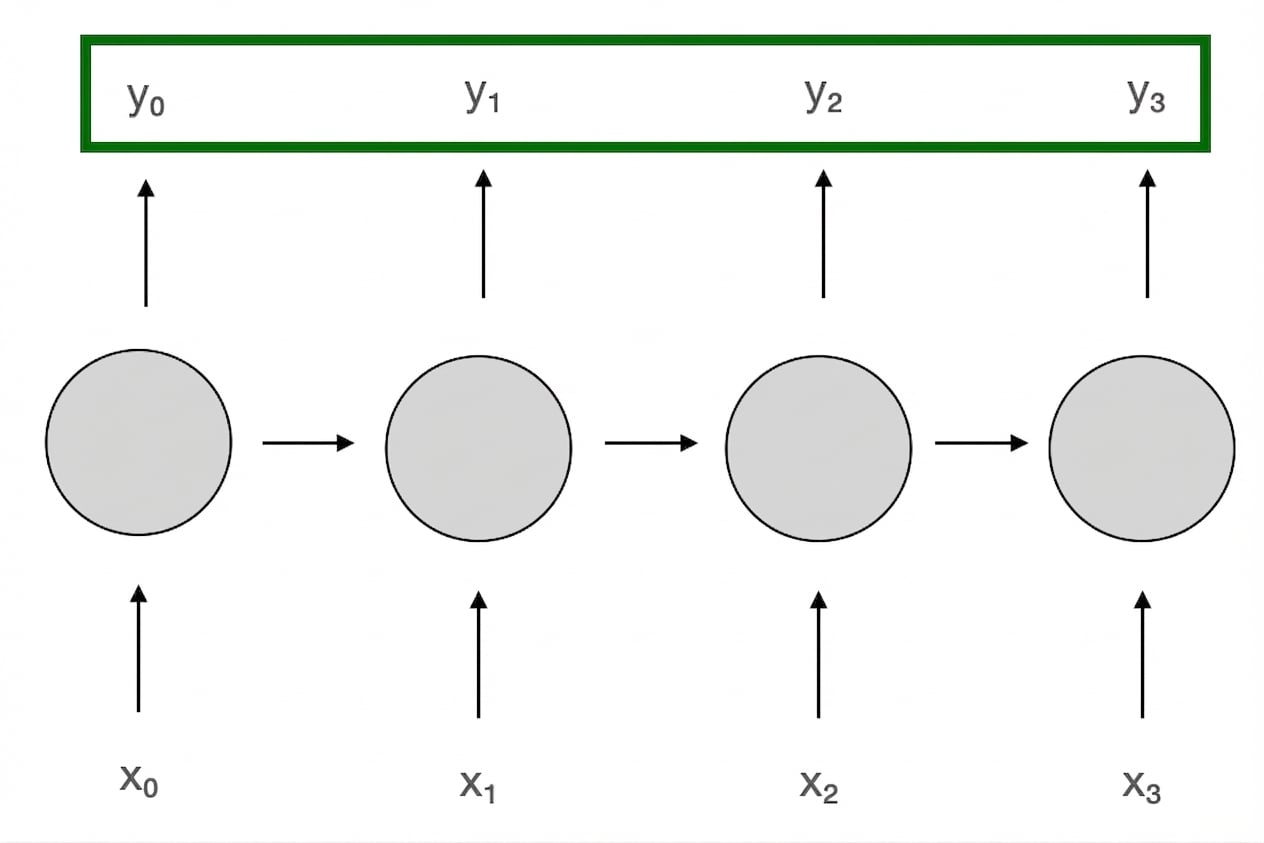

Architecture séquence-à-séquence

- Entrée: une séquence, utiliser toute la séquence de sorties

- Exemple: reconnaissance vocale en temps réel

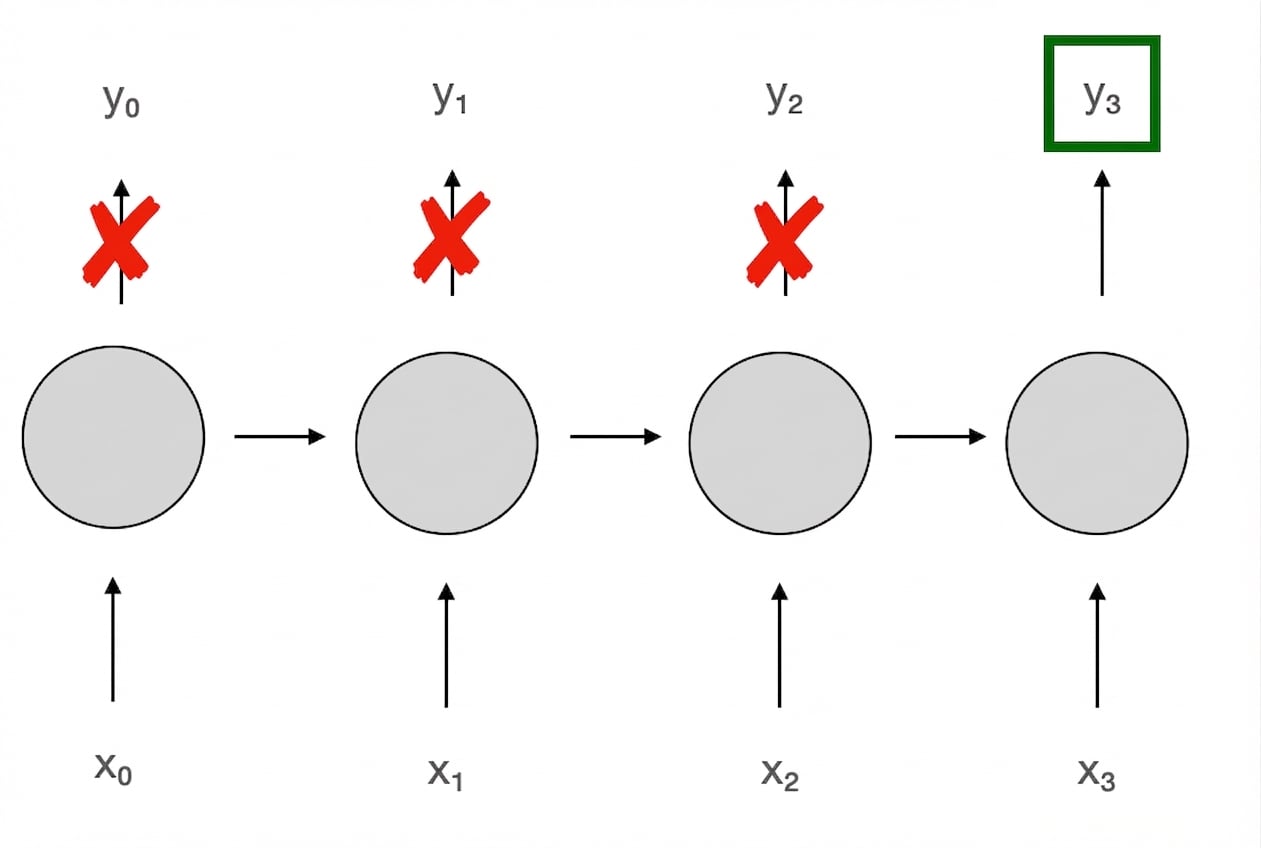

Architecture séquence-à-vecteur

- Entrée: une séquence, n’utiliser que la dernière sortie

- Exemple: classification de sujets de texte

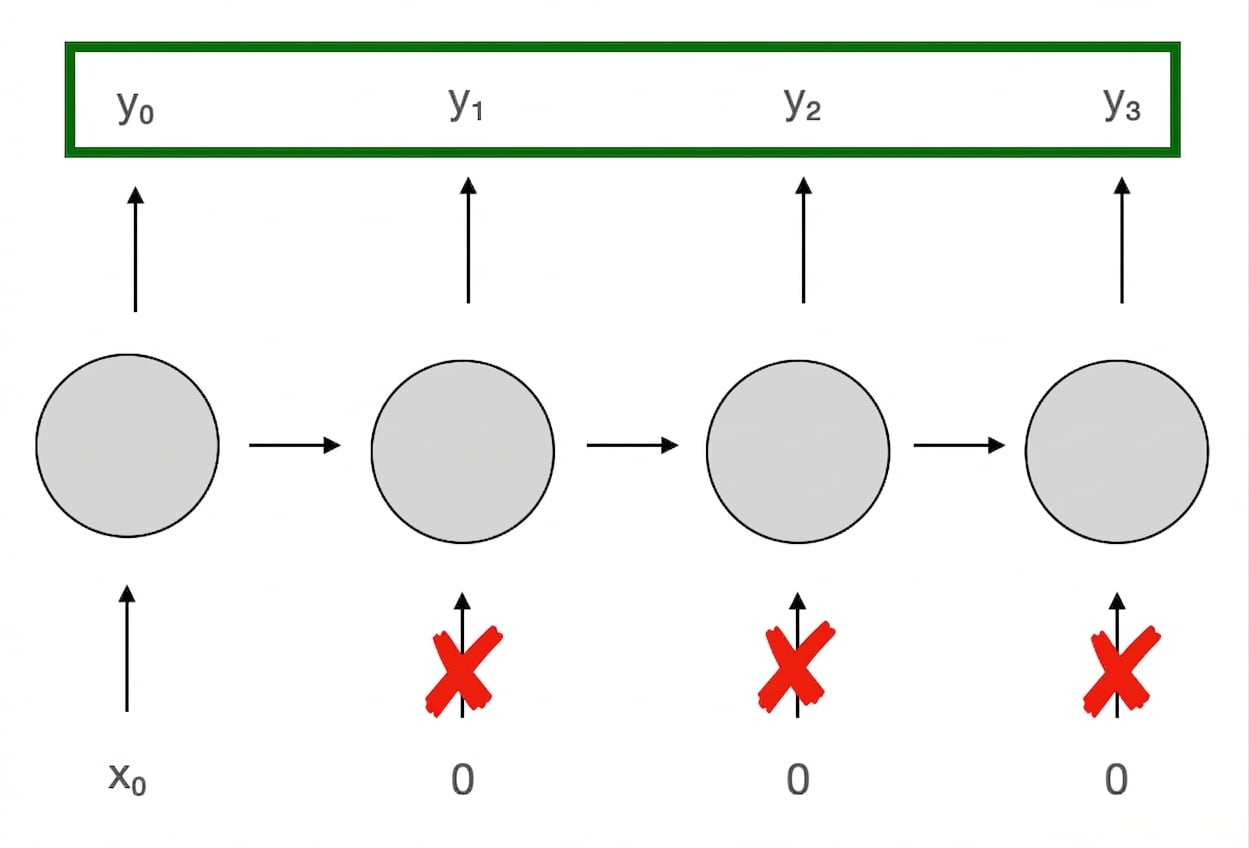

Architecture vecteur-à-séquence

- Entrée: un seul vecteur, utiliser toute la séquence de sorties

- Exemple: génération de texte

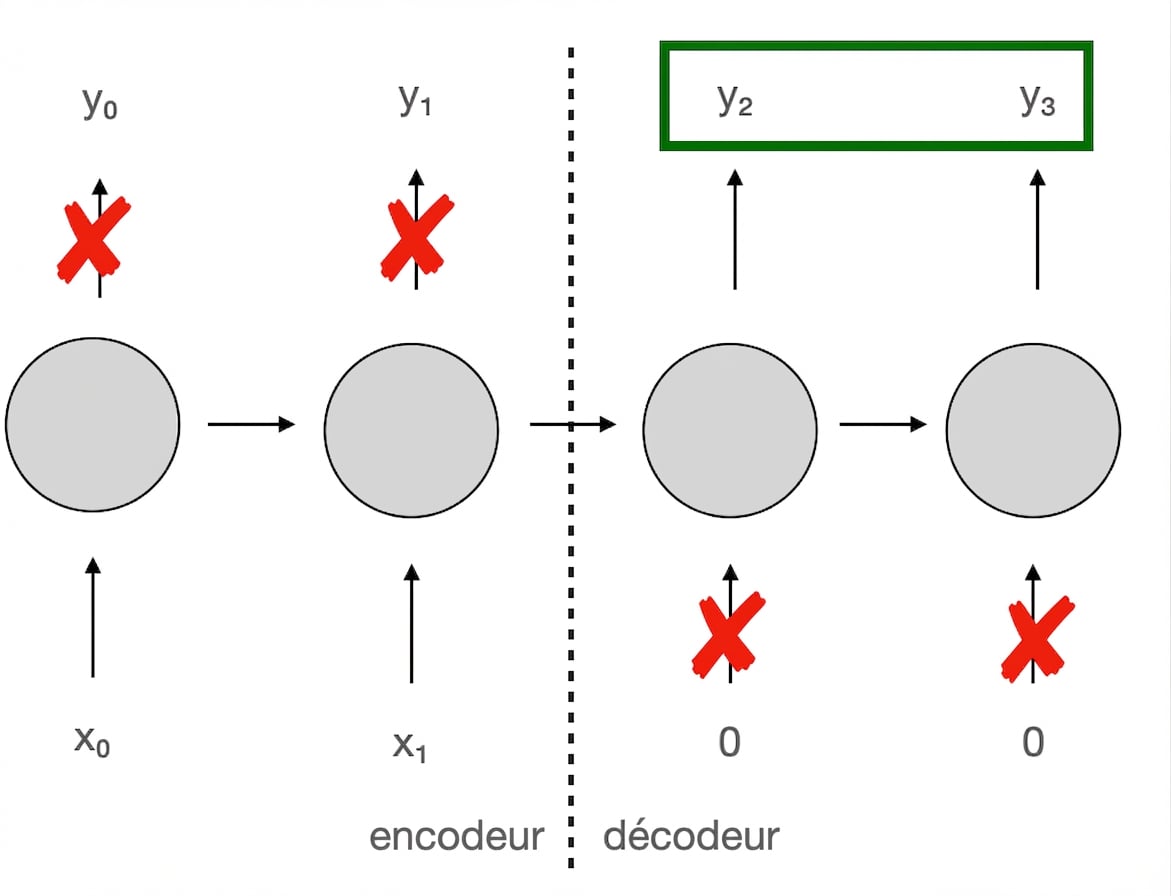

Architecture encodeur-décodeur

- Traiter toute la séquence d’entrée, puis commencer à utiliser la séquence de sorties

- Exemple: traduction automatique

RNN avec PyTorch

class Net(nn.Module): def __init__(self): super().__init__()self.rnn = nn.RNN( input_size=1, hidden_size=32, num_layers=2, batch_first=True, )self.fc = nn.Linear(32, 1)def forward(self, x): h0 = torch.zeros(2, x.size(0), 32)out, _ = self.rnn(x, h0)out = self.fc(out[:, -1, :]) return out

- Définir la classe du modèle avec

__init__ - Définir la couche récurrente,

self.rnn - Définir la couche linéaire,

fc - Dans

forward(), initialiser le premier état caché à zéro - Passer l’entrée et le premier état caché dans la couche RNN

- Prendre la dernière sortie du RNN et la passer dans la couche linéaire

Passons à la pratique !

Deep learning intermédiaire avec PyTorch