Réseaux de neurones convolutionnels

Deep learning intermédiaire avec PyTorch

Michal Oleszak

Machine Learning Engineer

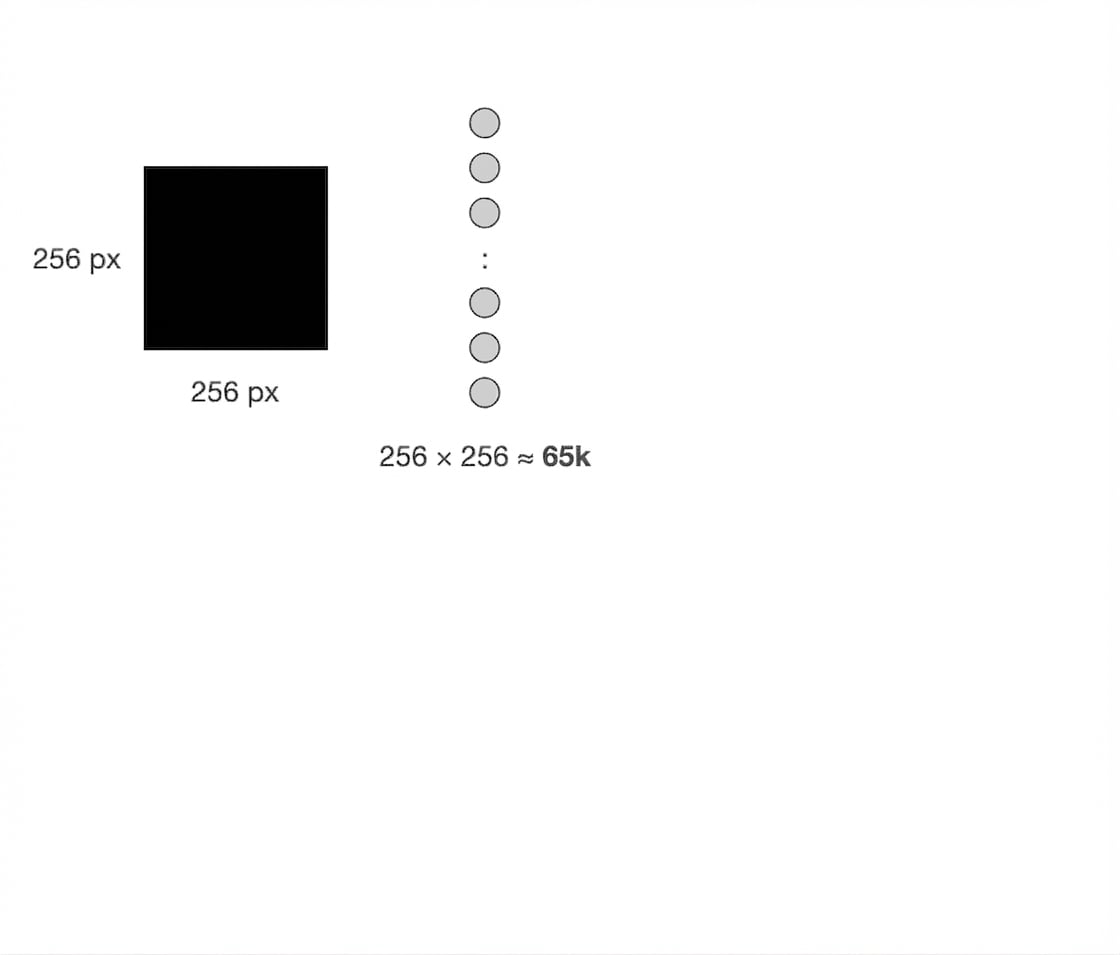

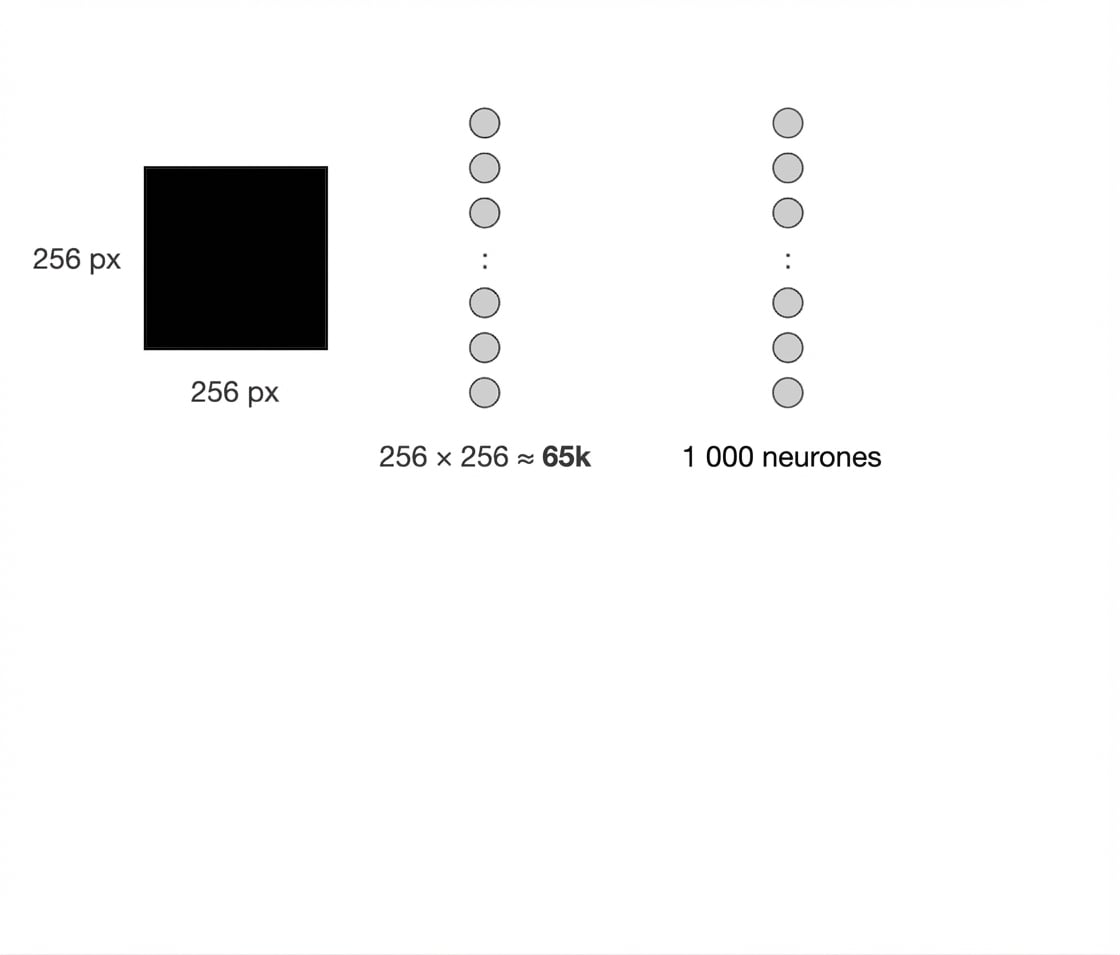

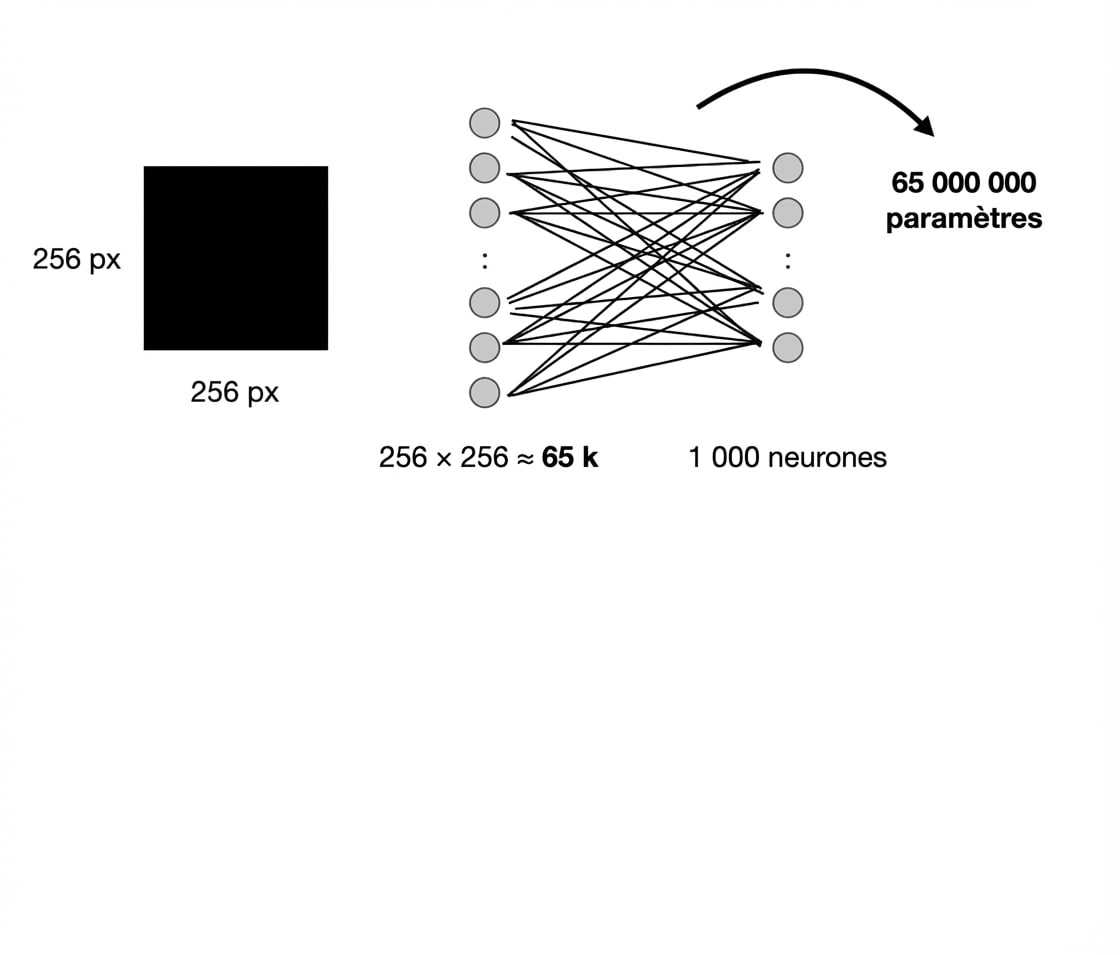

Pourquoi pas des couches linéaires ?

Pourquoi pas des couches linéaires ?

Pourquoi pas des couches linéaires ?

Pourquoi pas des couches linéaires ?

Pourquoi pas des couches linéaires ?

Pourquoi pas des couches linéaires ?

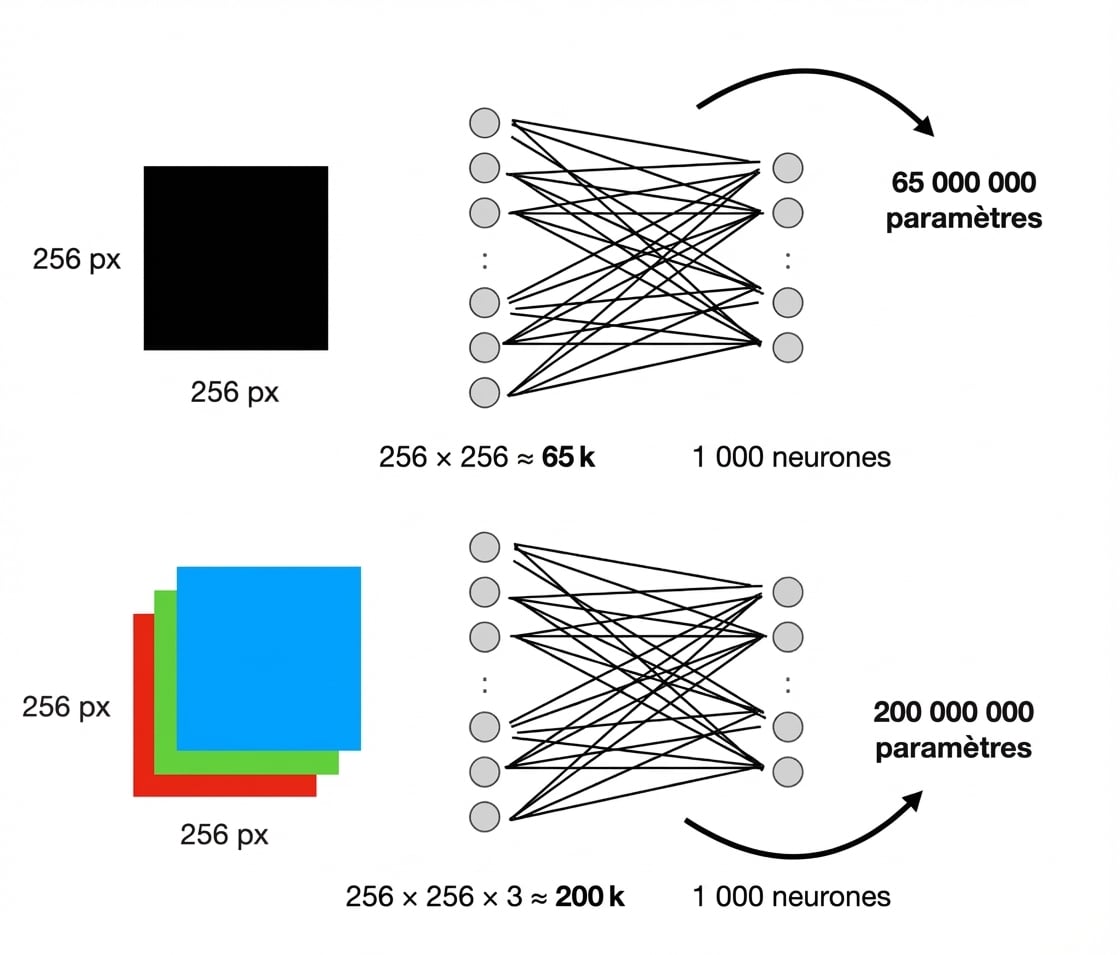

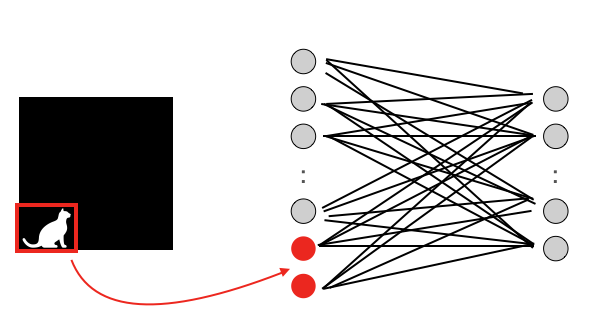

- Couches linéaires :

- Apprentissage lent

- Surapprentissage

- Ne détectent pas les motifs spatiaux

- Meilleure option : couches convolutionnelles !

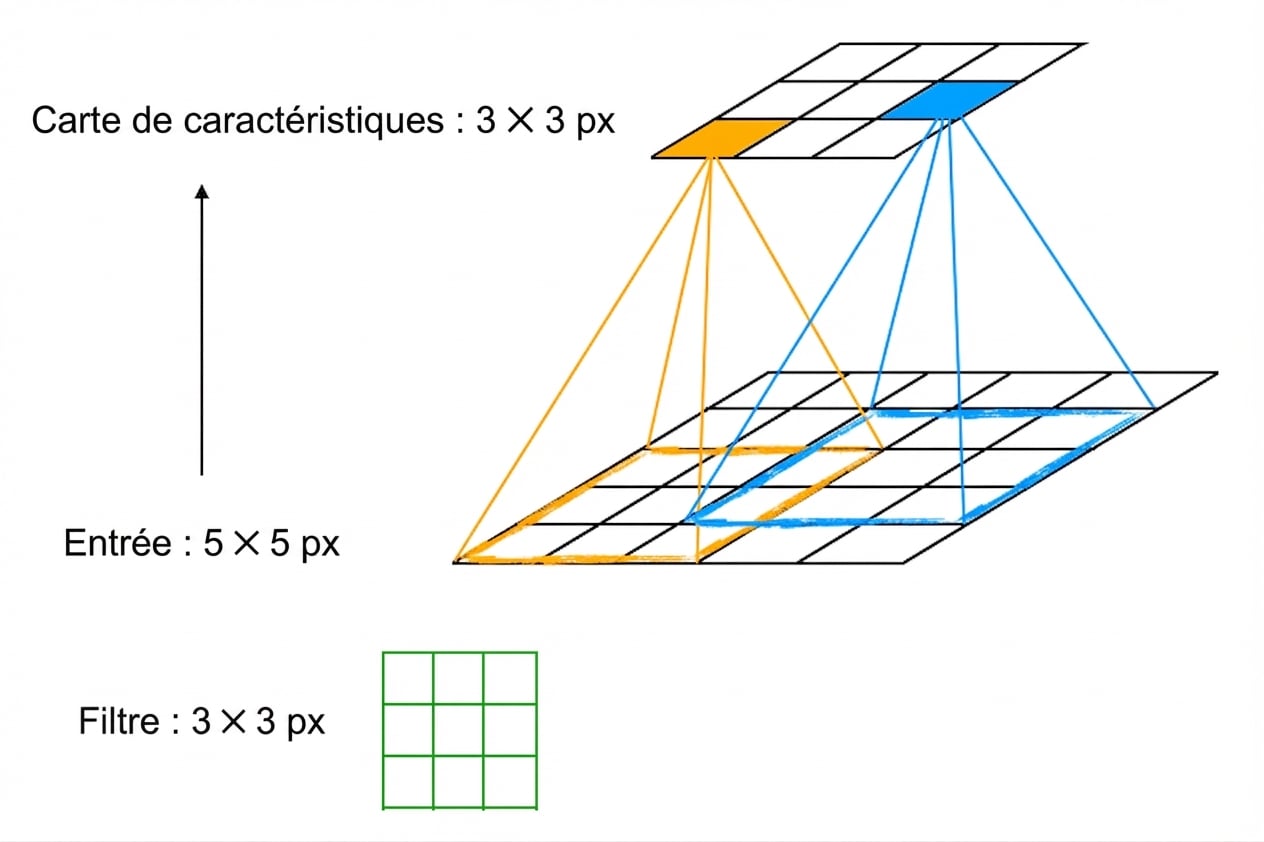

Couche convolutionnelle

- Faire glisser le(s) filtre(s) de paramètres sur l'entrée

- À chaque position, effectuer la convolution

- Carte de caractéristiques obtenue :

- Préserve les motifs spatiaux de l'entrée

- Moins de paramètres qu'une couche linéaire

- Un filtre = une carte de caractéristiques

- Appliquer des activations aux cartes

- Toutes les cartes combinées forment la sortie

nn.Conv2d(3, 32, kernel_size=3)

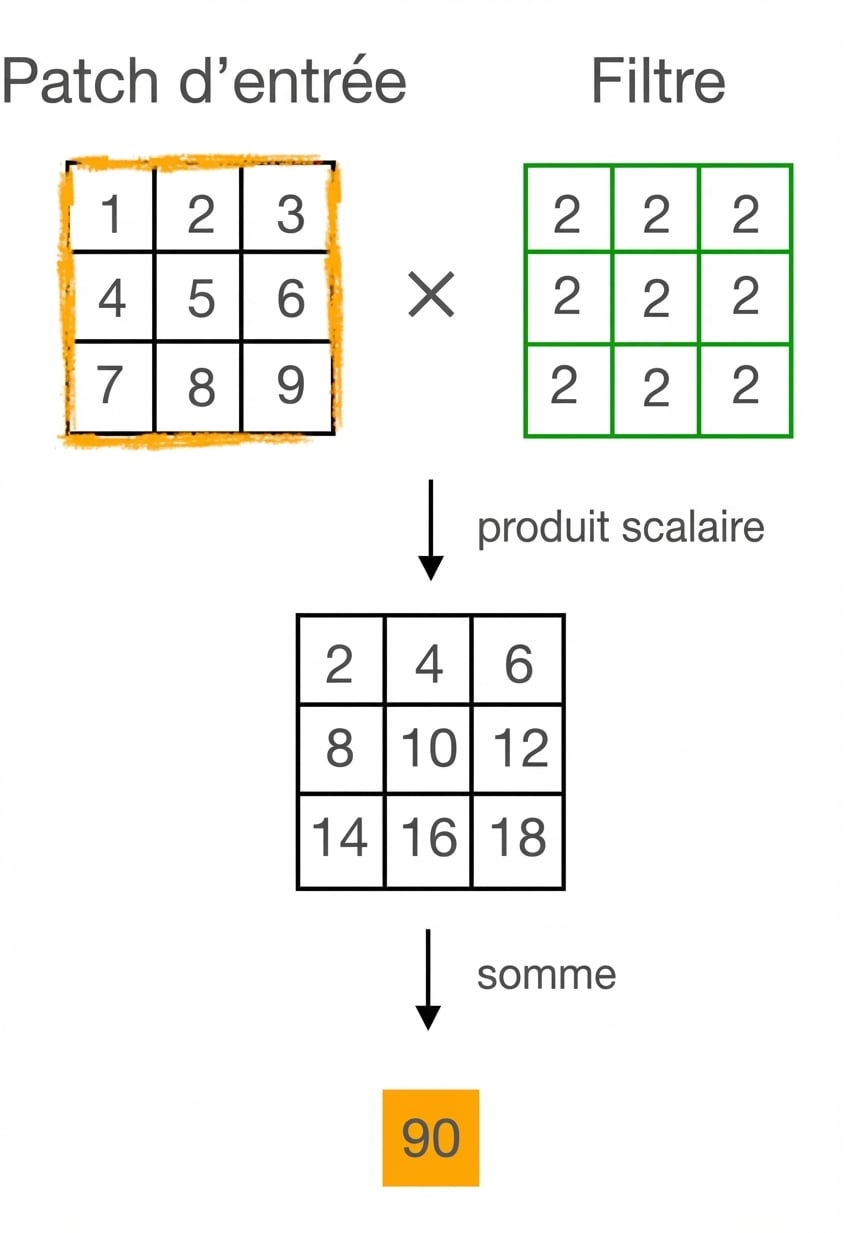

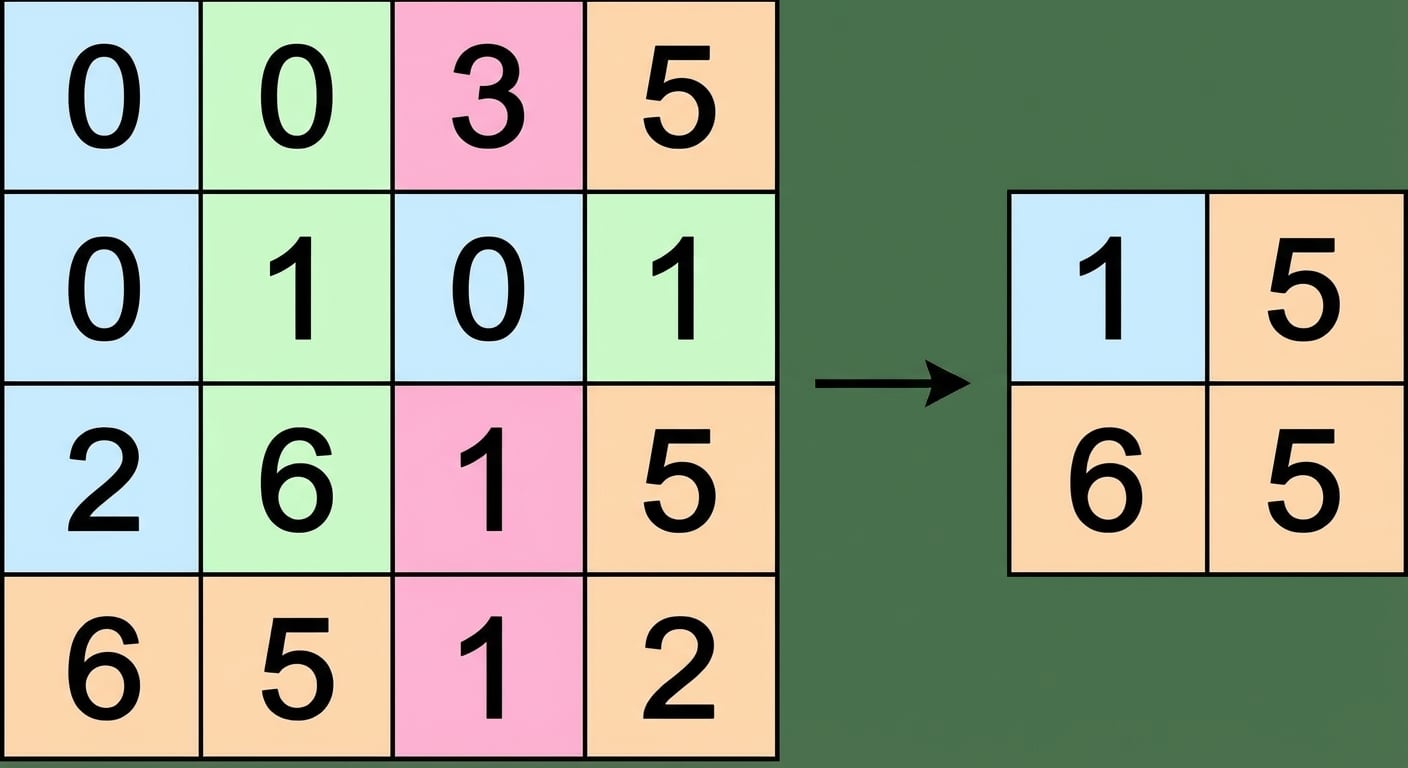

Convolution

- Calculer le produit scalaire entre le patch d'entrée et le filtre

- Case en haut à gauche : 2 × 1 = 2

- Additionner le résultat

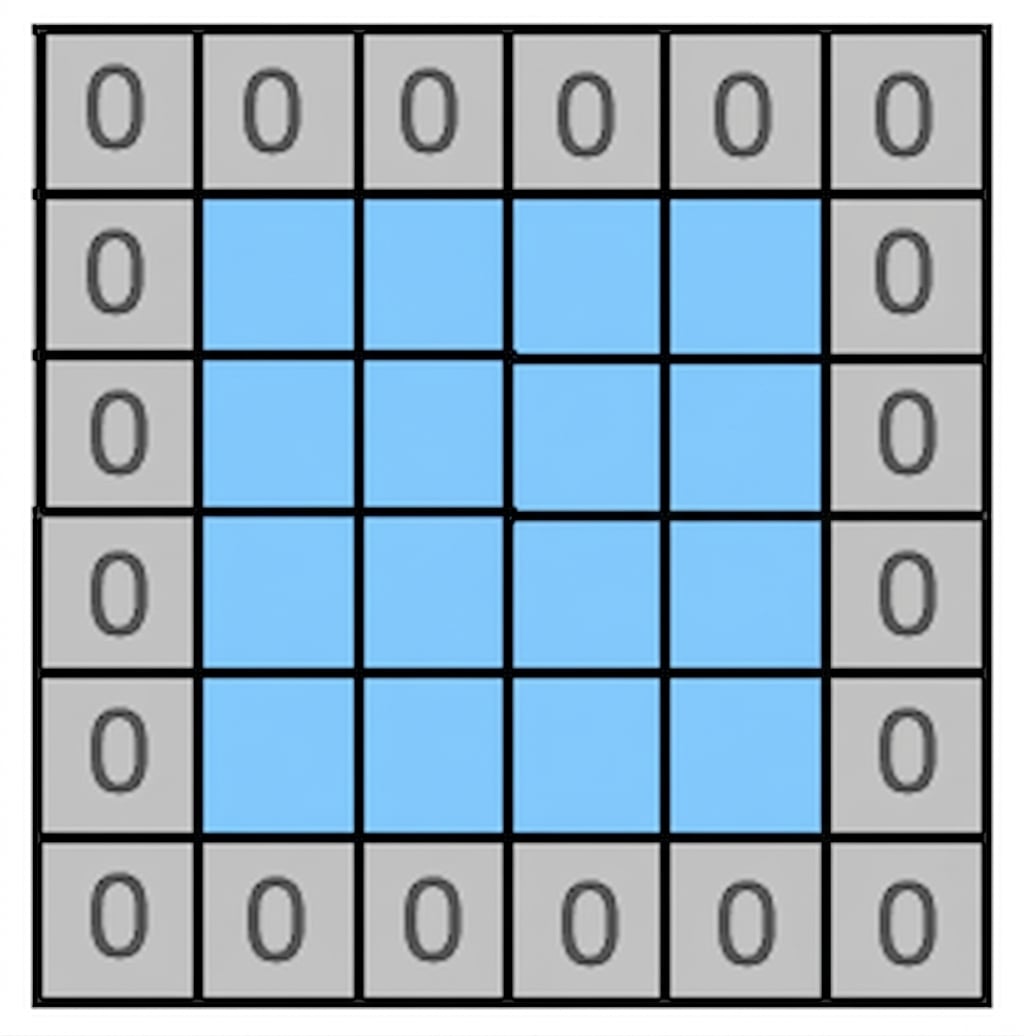

Zero-padding

- Ajouter un cadre de zéros à l'entrée de la couche convolutionnelle

nn.Conv2d(

3, 32, kernel_size=3, padding=1

)

- Conserve les dimensions spatiales des tenseurs d'entrée et de sortie

- Assure un traitement équitable des pixels en bordure

Max pooling

- Faire glisser une fenêtre sans chevauchement sur l'entrée

- À chaque position, ne garder que la valeur maximale

- Utilisé après les convolutions pour réduire les dimensions spatiales

nn.MaxPool2d(kernel_size=2)

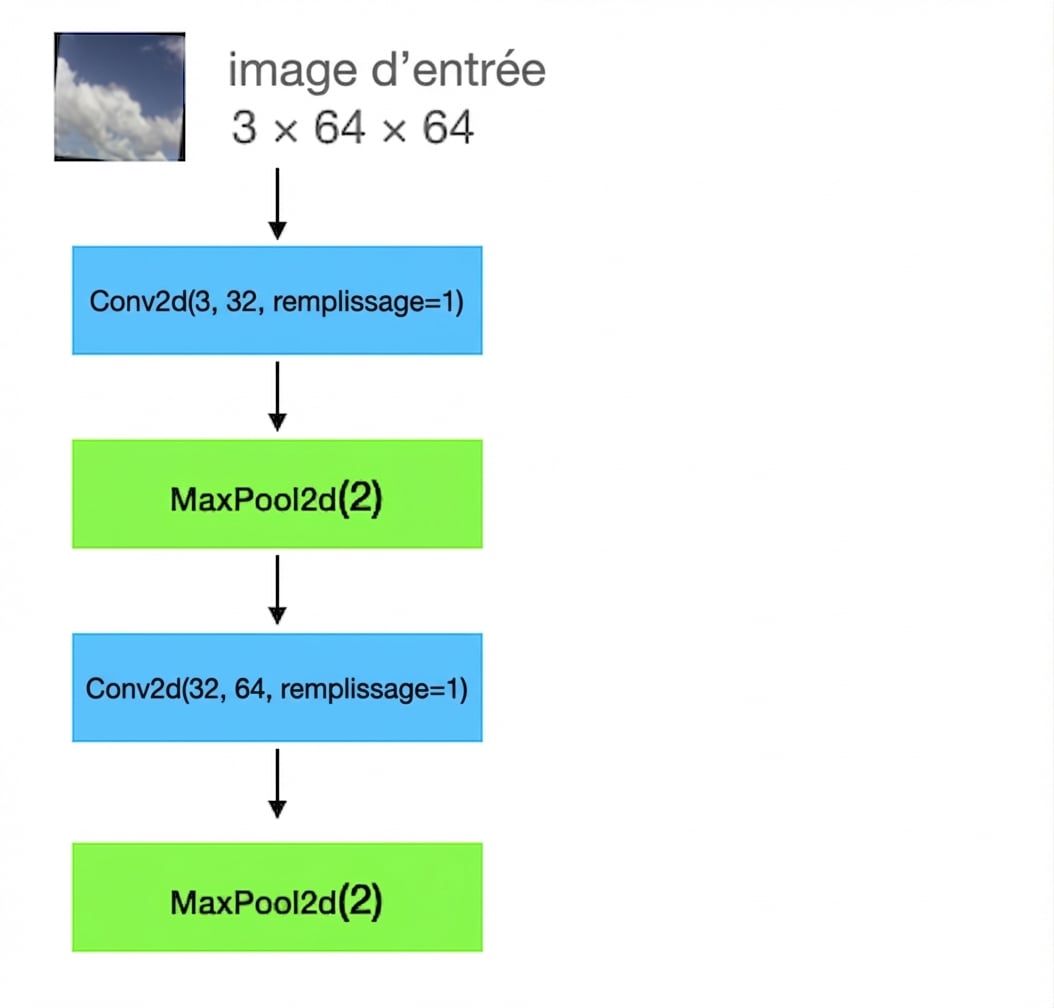

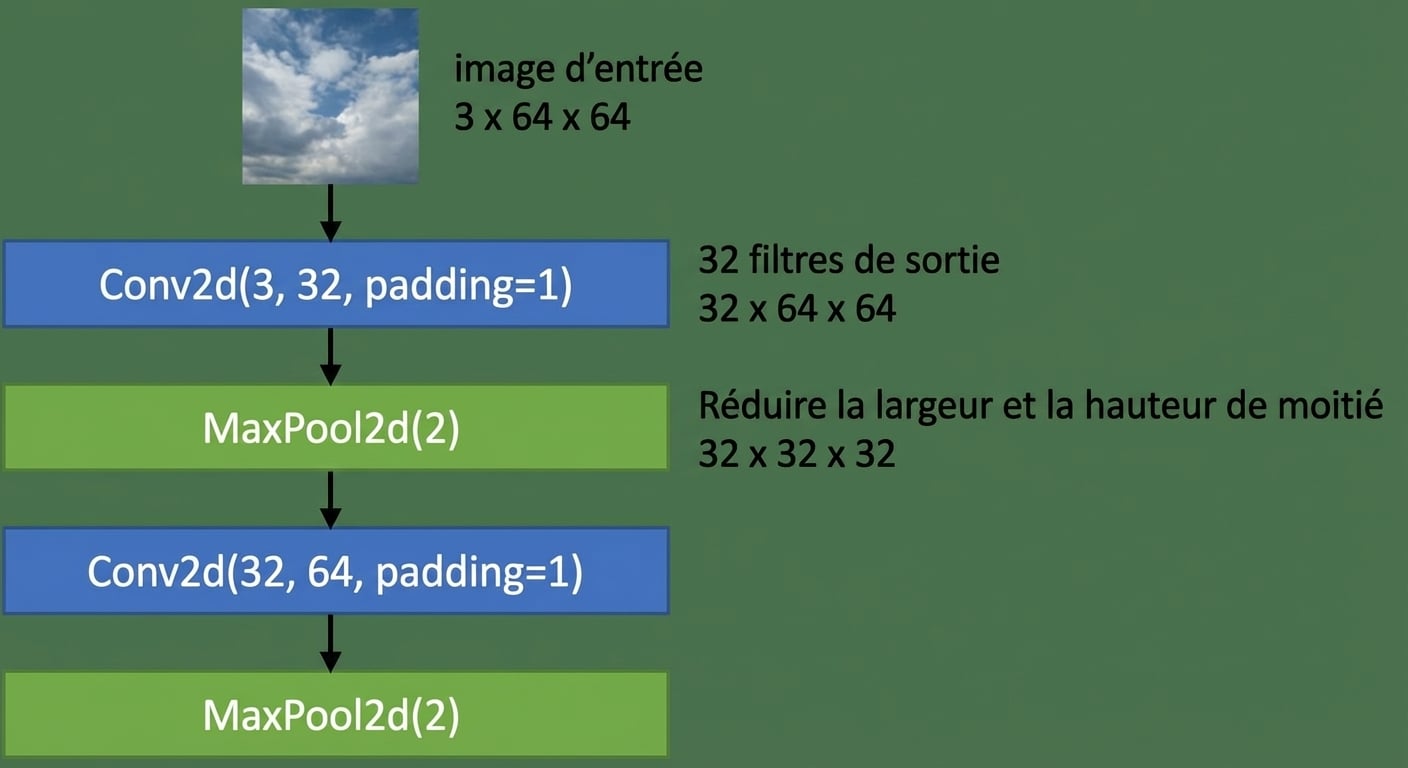

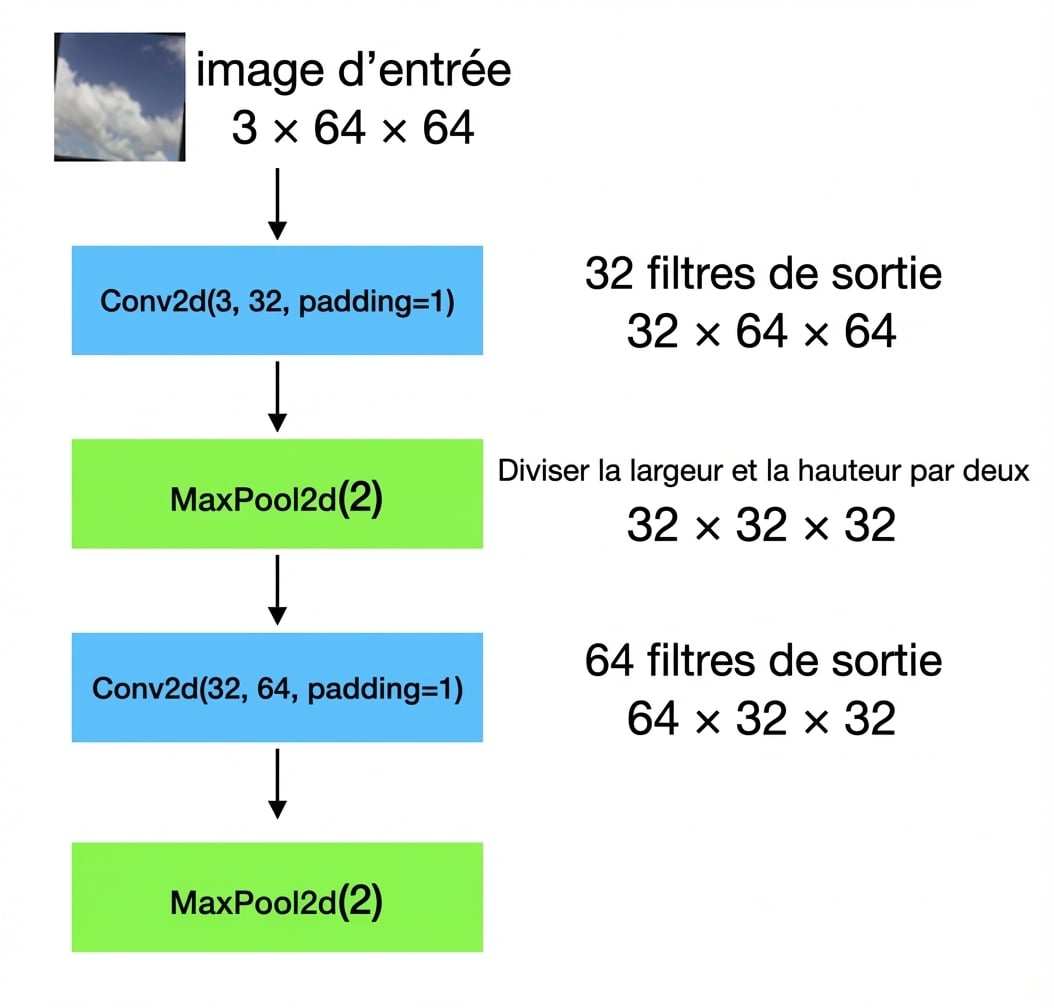

Réseau de neurones convolutionnel

class Net(nn.Module): def __init__(self, num_classes): super().__init__()self.feature_extractor = nn.Sequential( nn.Conv2d(3, 32, kernel_size=3, padding=1), nn.ELU(), nn.MaxPool2d(kernel_size=2), nn.Conv2d(32, 64, kernel_size=3, padding=1), nn.ELU(), nn.MaxPool2d(kernel_size=2), nn.Flatten(), )self.classifier = nn.Linear(64*16*16, num_classes)def forward(self, x): x = self.feature_extractor(x) x = self.classifier(x) return x

feature_extractor: (convolution, activation, pooling), deux fois puis aplaticlassifier: une couche linéaireforward(): passer l'image d'entrée par l'extracteur puis le classifieur

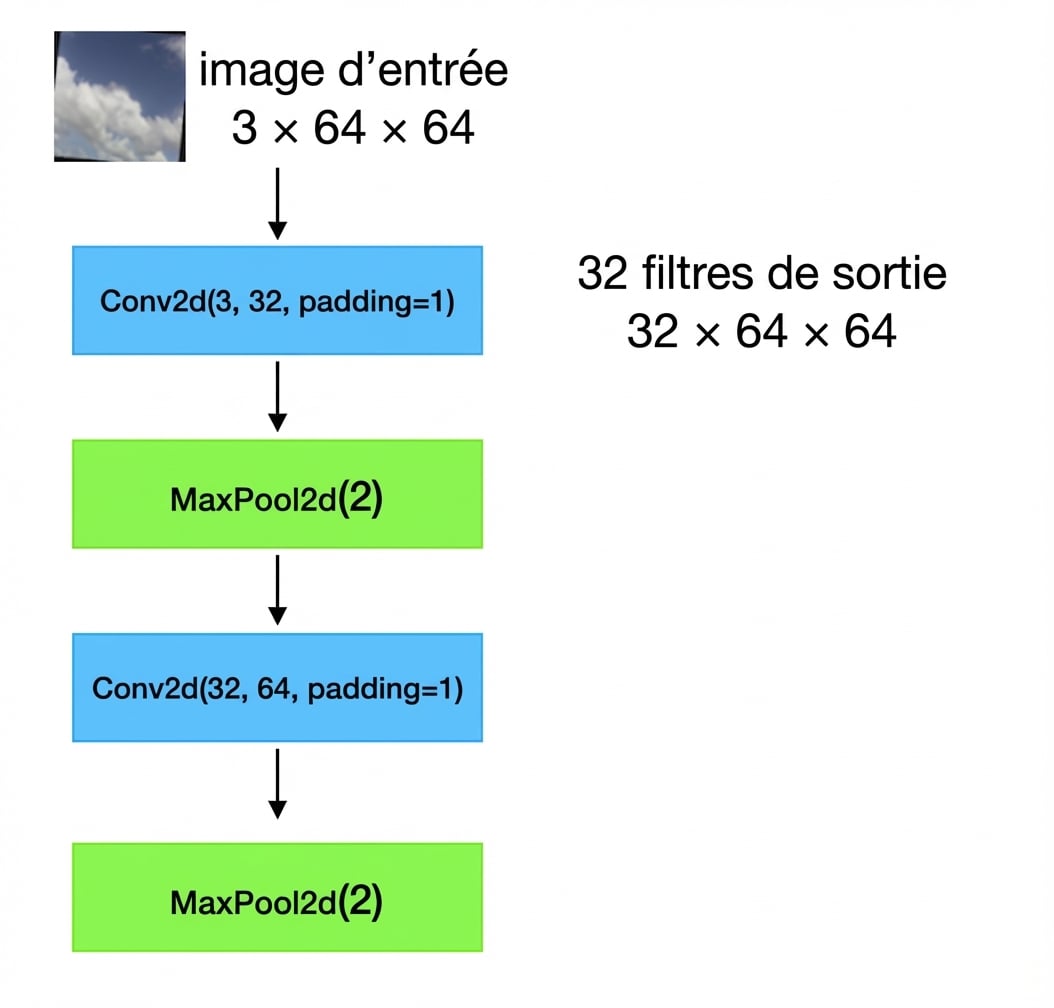

Taille de sortie de l'extracteur de caractéristiques

self.feature_extractor = nn.Sequential(

nn.Conv2d(3, 32, kernel_size=3, padding=1),

nn.ELU(),

nn.MaxPool2d(kernel_size=2),

nn.Conv2d(32, 64, kernel_size=3, padding=1),

nn.ELU(),

nn.MaxPool2d(kernel_size=2),

nn.Flatten(),

)

self.classifier = nn.Linear(64*16*16, num_classes)

`

Taille de sortie de l'extracteur de caractéristiques

self.feature_extractor = nn.Sequential(

nn.Conv2d(3, 32, kernel_size=3, padding=1),

nn.ELU(),

nn.MaxPool2d(kernel_size=2),

nn.Conv2d(32, 64, kernel_size=3, padding=1),

nn.ELU(),

nn.MaxPool2d(kernel_size=2),

nn.Flatten(),

)

self.classifier = nn.Linear(64*16*16, num_classes)

`

Taille de sortie de l'extracteur de caractéristiques

self.feature_extractor = nn.Sequential(

nn.Conv2d(3, 32, kernel_size=3, padding=1),

nn.ELU(),

nn.MaxPool2d(kernel_size=2),

nn.Conv2d(32, 64, kernel_size=3, padding=1),

nn.ELU(),

nn.MaxPool2d(kernel_size=2),

nn.Flatten(),

)

self.classifier = nn.Linear(64*16*16, num_classes)

`

Taille de sortie de l'extracteur de caractéristiques

self.feature_extractor = nn.Sequential(

nn.Conv2d(3, 32, kernel_size=3, padding=1),

nn.ELU(),

nn.MaxPool2d(kernel_size=2),

nn.Conv2d(32, 64, kernel_size=3, padding=1),

nn.ELU(),

nn.MaxPool2d(kernel_size=2),

nn.Flatten(),

)

self.classifier = nn.Linear(64*16*16, num_classes)

`

Taille de sortie de l'extracteur de caractéristiques

self.feature_extractor = nn.Sequential(

nn.Conv2d(3, 32, kernel_size=3, padding=1),

nn.ELU(),

nn.MaxPool2d(kernel_size=2),

nn.Conv2d(32, 64, kernel_size=3, padding=1),

nn.ELU(),

nn.MaxPool2d(kernel_size=2),

nn.Flatten(),

)

self.classifier = nn.Linear(64*16*16, num_classes)

`

Passons à la pratique !

Deep learning intermédiaire avec PyTorch