Regrouper les upserts

Bases de données vectorielles pour les intégrations avec Pinecone

James Chapman

Curriculum Manager, DataCamp

Limites d’upsert

- Taux de requêtes

- Taille des requêtes

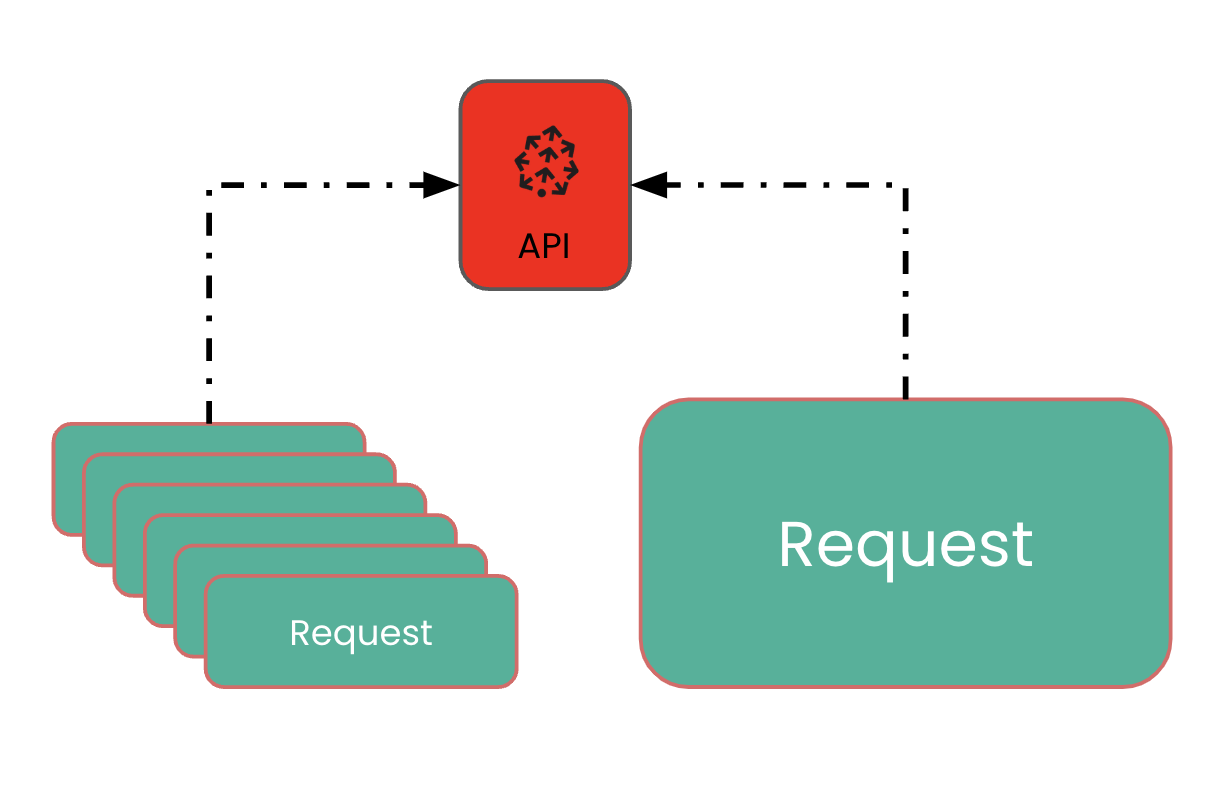

- Batching : découper les requêtes en plus petits blocs

1 https://docs.pinecone.io/reference/quotas-and-limits#rate-limits

Définir une fonction de découpage

def chunks(iterable, batch_size=100):it = iter(iterable)chunk = tuple(itertools.islice(it, batch_size))while chunk:yield chunkchunk = tuple(itertools.islice(it, batch_size))

Regroupement séquentiel

- Découper les requêtes et les envoyer une par une

pc.Pinecone(api_key="YOUR API KEY") index = pc.Index('datacamp-index')for chunk in chunks(vectors): index.upsert(vectors=chunk)

Avantages :

- Résout les limites de taux et de taille

Inconvénients :

- Très lent !

Regroupement parallèle

- Découper les requêtes et les envoyer en parallèle

pc = Pinecone(api_key="YOUR_API_KEY", pool_threads=30)with pc.Index('datacamp-index', pool_threads=30) as index:async_results = [index.upsert(vectors=chunk, async_req=True) for chunk in chunks(vectors, batch_size=100)][async_result.get() for async_result in async_results]

Passons à la pratique !

Bases de données vectorielles pour les intégrations avec Pinecone