Aktivierungsfunktionen

Einführung in Deep Learning mit Python

Dan Becker

Data Scientist and contributor to Keras and TensorFlow libraries

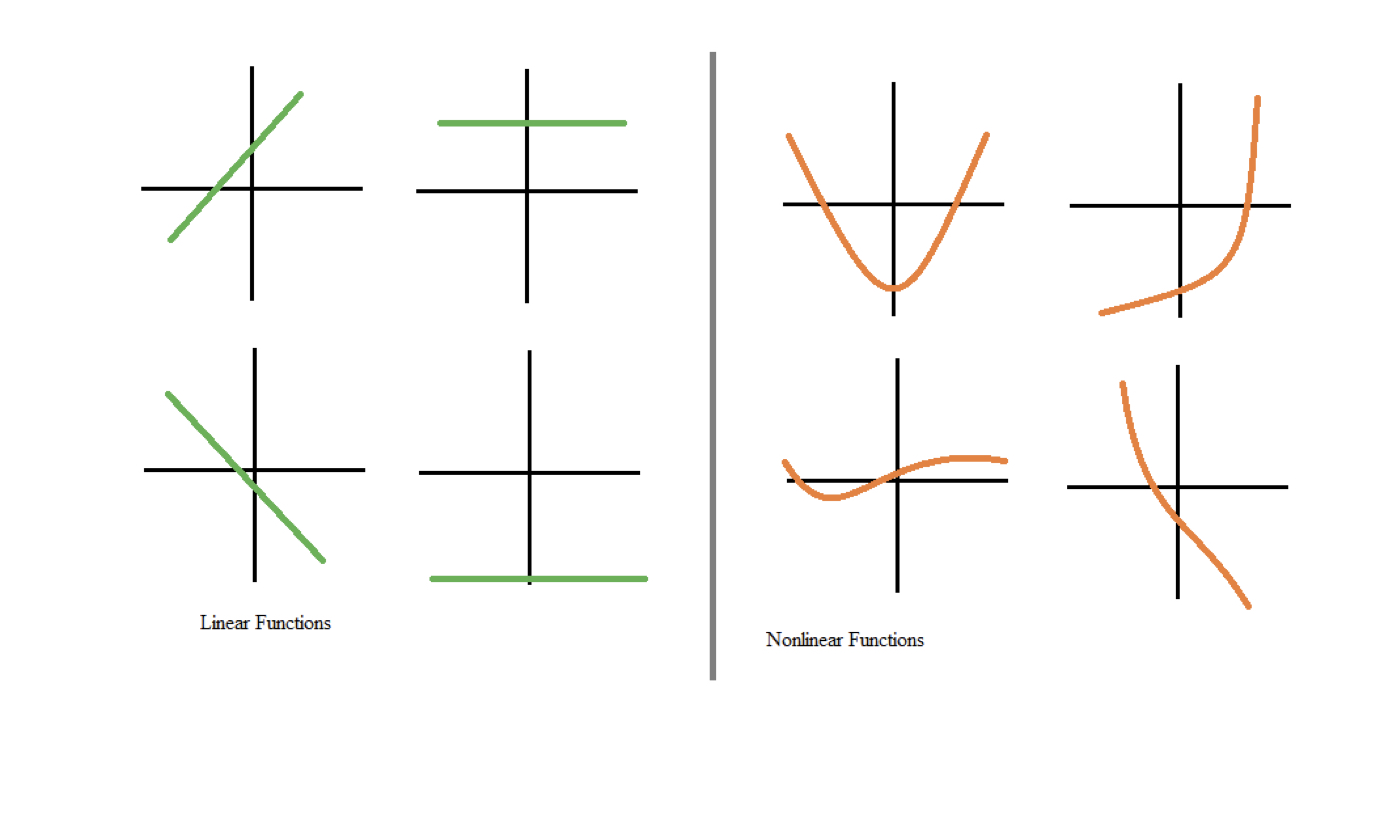

Lineare vs. nichtlineare Funktionen

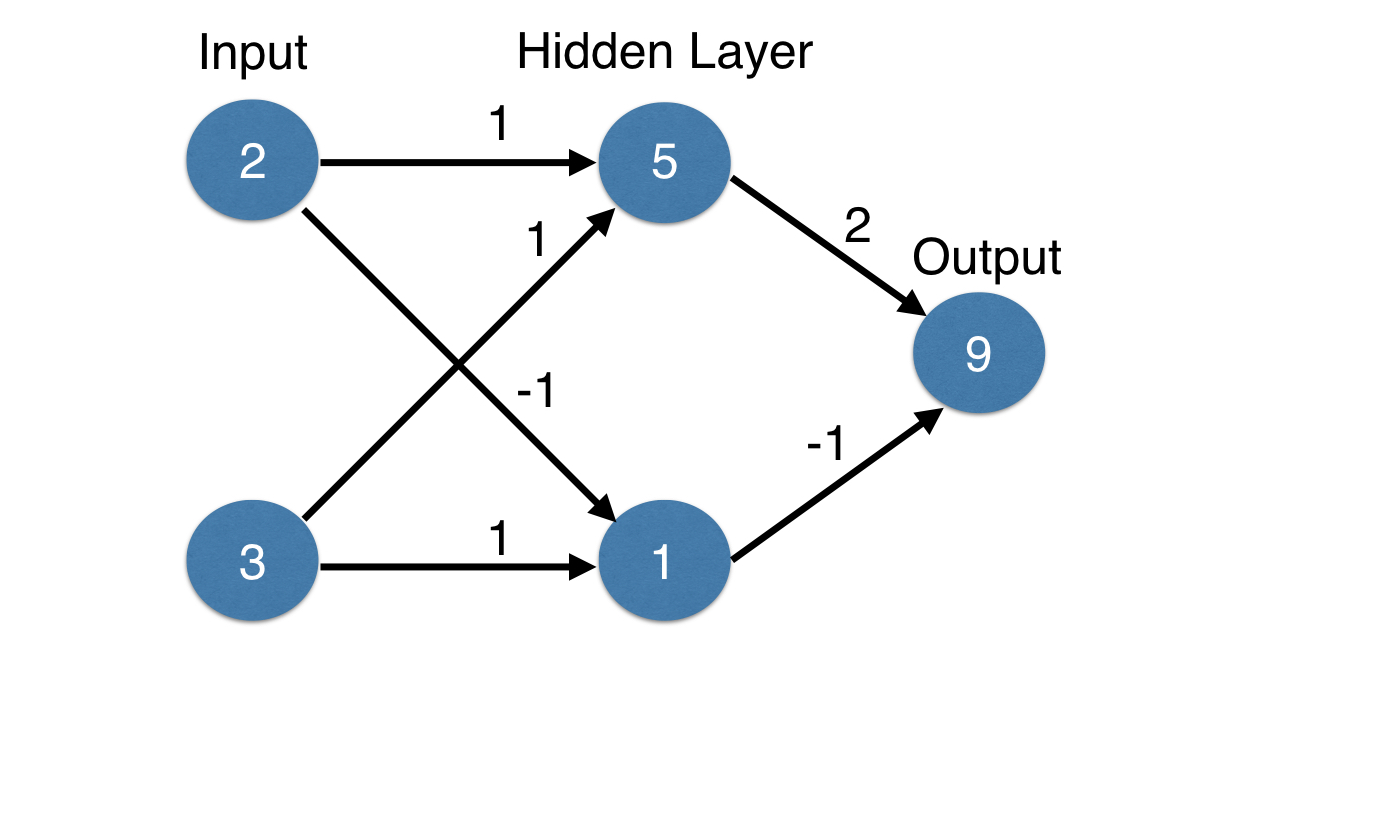

Aktivierungsfunktionen

- Auf Knoten-Eingaben angewandt, um den Knoten-Ausgang zu erzeugen

Unser neuronales Netz verbessern

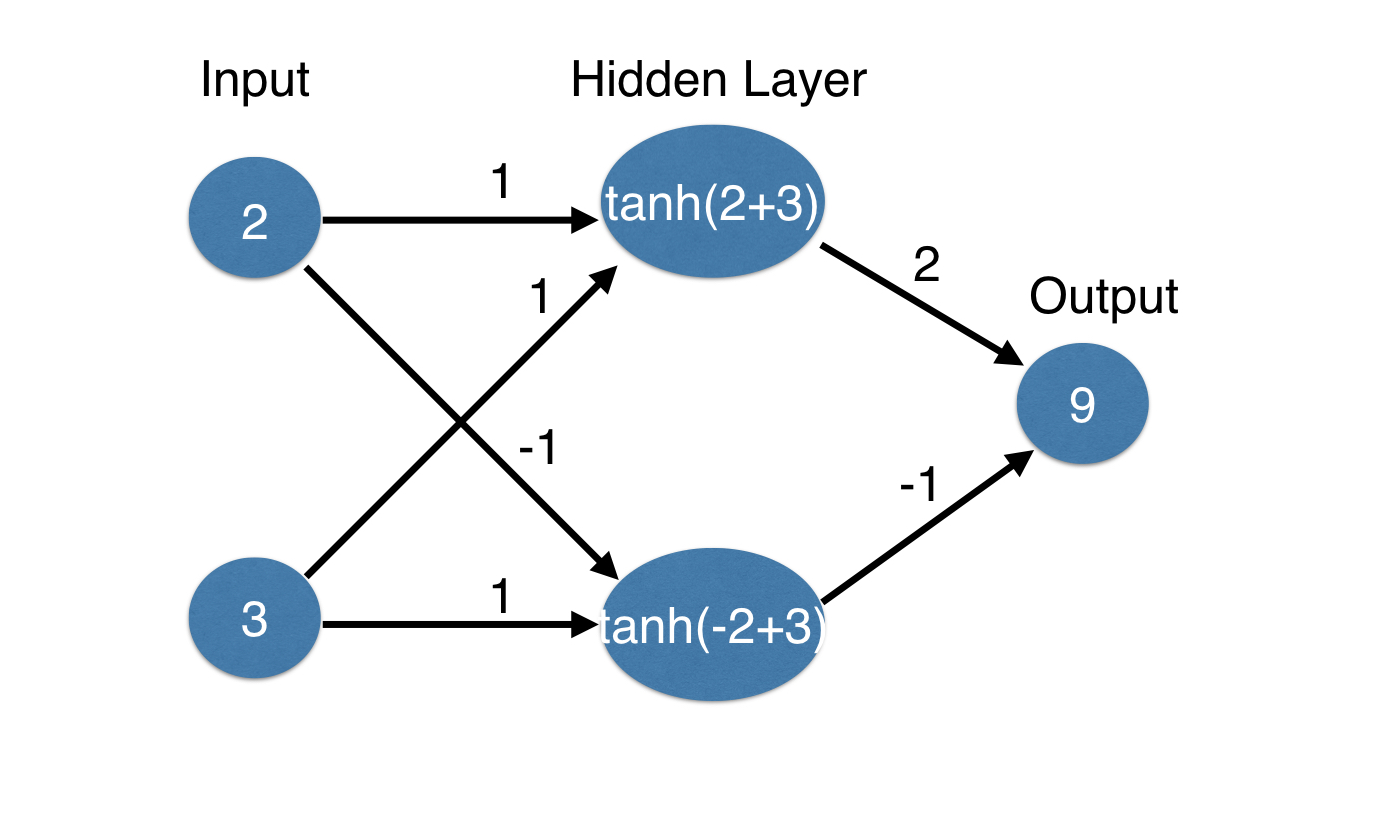

Aktivierungsfunktionen

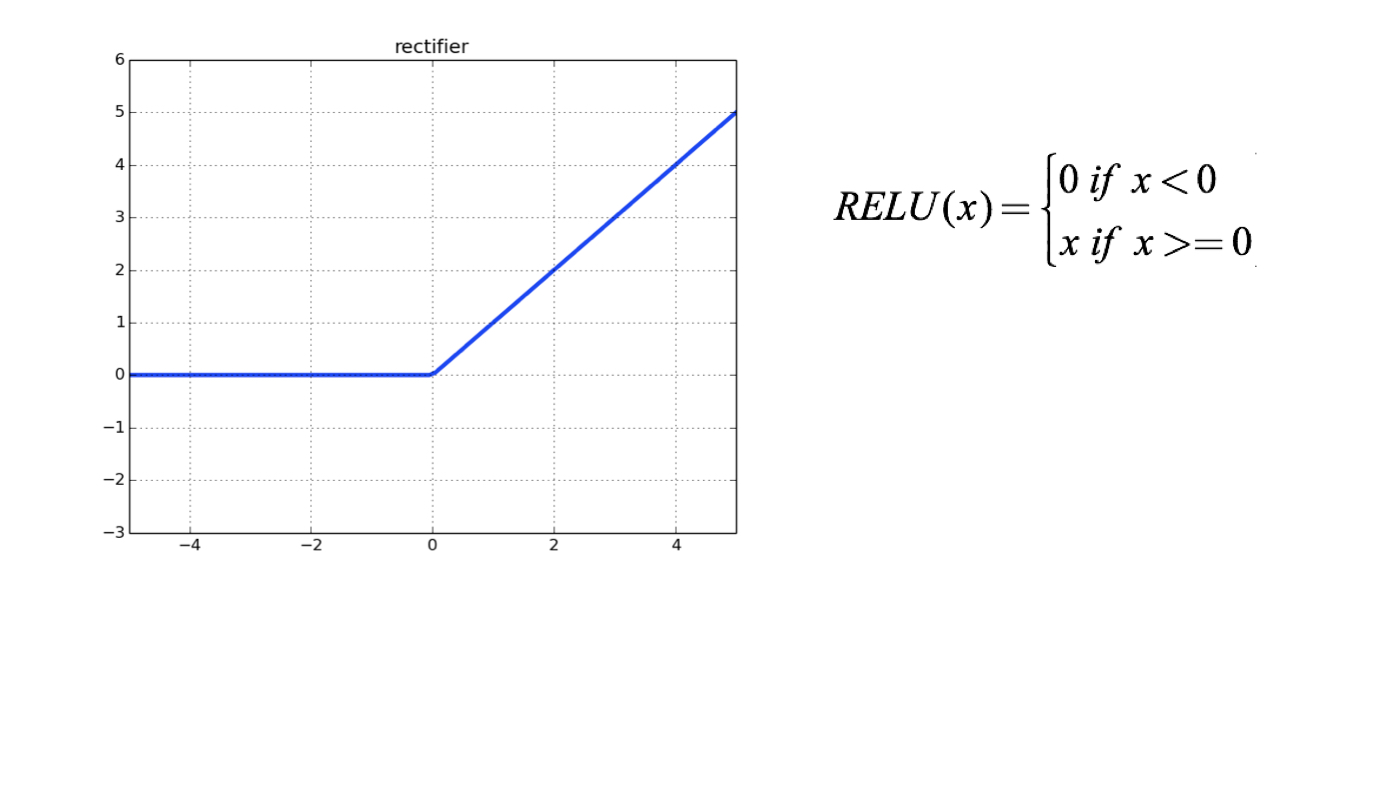

ReLU (Rectified Linear Activation)

Aktivierungsfunktionen

import numpy as np

input_data = np.array([-1, 2])

weights = {'node_0': np.array([3, 3]),

'node_1': np.array([1, 5]),

'output': np.array([2, -1])}

node_0_input = (input_data * weights['node_0']).sum()

node_0_output = np.tanh(node_0_input)

node_1_input = (input_data * weights['node_1']).sum()

node_1_output = np.tanh(node_1_input)

hidden_layer_outputs = np.array([node_0_output, node_1_output])

output = (hidden_layer_output * weights['output']).sum()

print(output)

1.2382242525694254

Lass uns üben!

Einführung in Deep Learning mit Python