AI yang Dapat Dijelaskan

Etika Kecerdasan Buatan

Joe Franklin

Associate Data Literacy and Essentials Manager, DataCamp

Apa itu AI yang Dapat Dijelaskan?

- Sistem kecerdasan buatan (AI) yang cara kerjanya dipahami oleh manusia.

- Tujuan: Membuat proses pengambilan keputusan AI menjadi jelas, mudah dipahami, dan dapat dijelaskan.

- Membantu memahami mengapa dan bagaimana AI mengambil keputusan.

- Langkah besar menuju penggunaan kecerdasan buatan yang etis

1 Ikon dibuat oleh vectorsmarket15 dari www.flaticon.com

Pilar-Pilar Utama

- Transparansi, keadilan, dan akuntabilitas merupakan hal yang utama.

- Kesimpulan AI harus dapat dipahami dan logis bagi manusia.

- Model yang dibangun dengan kejelasan sebagai inti utamanya

- Menggunakan model yang dapat diinterpretasikan seperti pohon keputusan atau regresi linier

- Kekuatan dalam melihat proses, meskipun mungkin kinerja lebih rendah

1 Ikon dibuat oleh juicy_fish & Becris dari www.flaticon.com

Bagaimana cara kerjanya?

Bagaimana cara kerjanya?

Penjelasan yang Dapat Dipahami dan Independen dari Model Lokal (LIME)

- LIME sebagai penerjemah yang membantu model berkomunikasi

- Membuat versi yang lebih sederhana dari proses pengambilan keputusan model untuk prediksi tertentu.

- Contoh:

- Menjelaskan prediksi kesuksesan sebuah film berdasarkan faktor-faktor seperti popularitas sutradara dan anggaran yang tinggi.

1 Ikon dibuat oleh Freepik dari www.flaticon.com

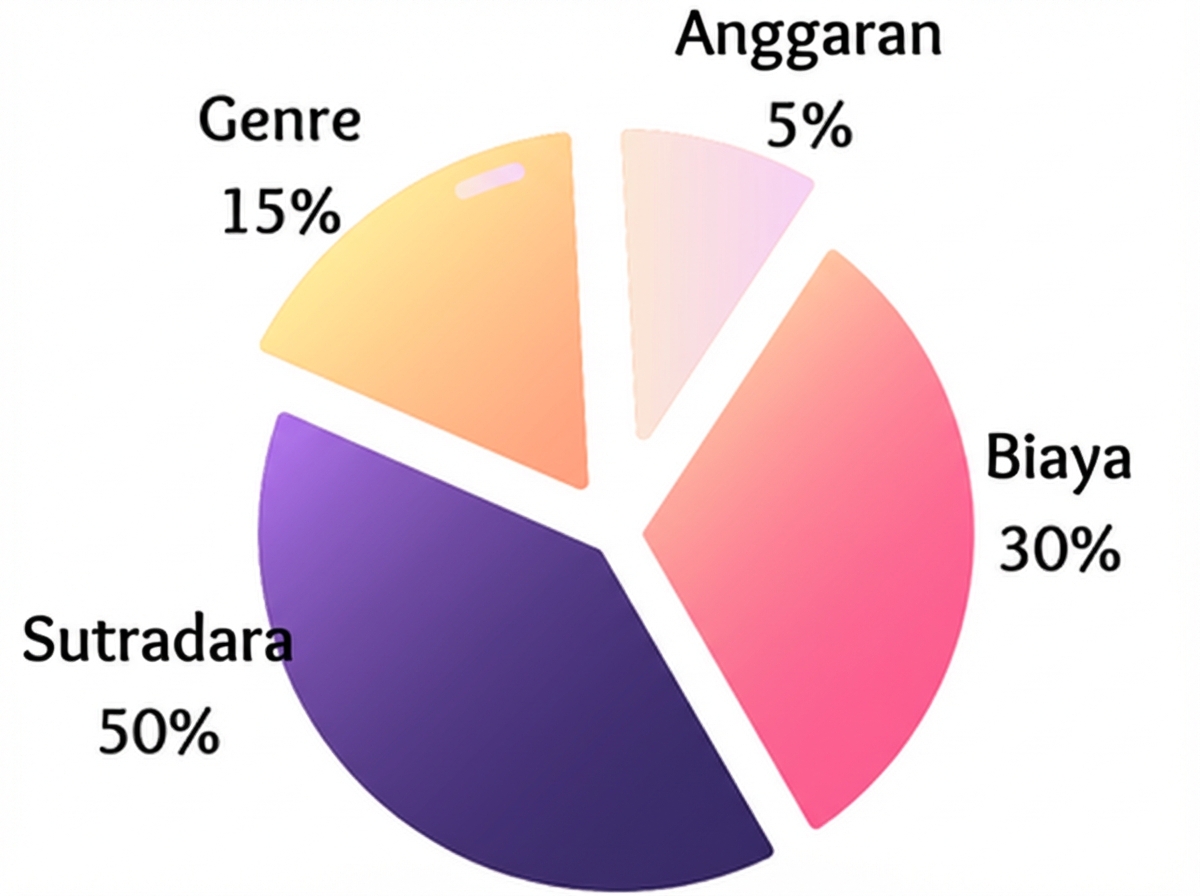

Penjelasan Aditif Shapley (SHAP)

- SHAP: Seorang detektif kecerdasan buatan (AI), mengungkap pentingnya fitur.

- SHAP dalam Aksi

- Direktur: 50%

- Pemeran: 30%

- Genre: 15%

- Anggaran: 5%

Masa Depan XAI

- Banyak teknik dan pendekatan lain yang tersedia dalam XAI.

- Selisih antara XAI dan kecerdasan buatan tradisional semakin menyempit

- Penelitian yang sedang berlangsung terus meningkatkan keterbacaan kecerdasan buatan (AI).

Ayo berlatih!

Etika Kecerdasan Buatan