Introduzione a PySpark

Introduzione a PySpark

Benjamin Schmidt

Data Engineer

Conosci il tuo istruttore

- Quasi un decennio di esperienza con PySpark

Usato PySpark per Machine Learning, ETL e molto altro

Insegnante appassionato di nuovi strumenti per tutti!

-

Cos'è PySpark?

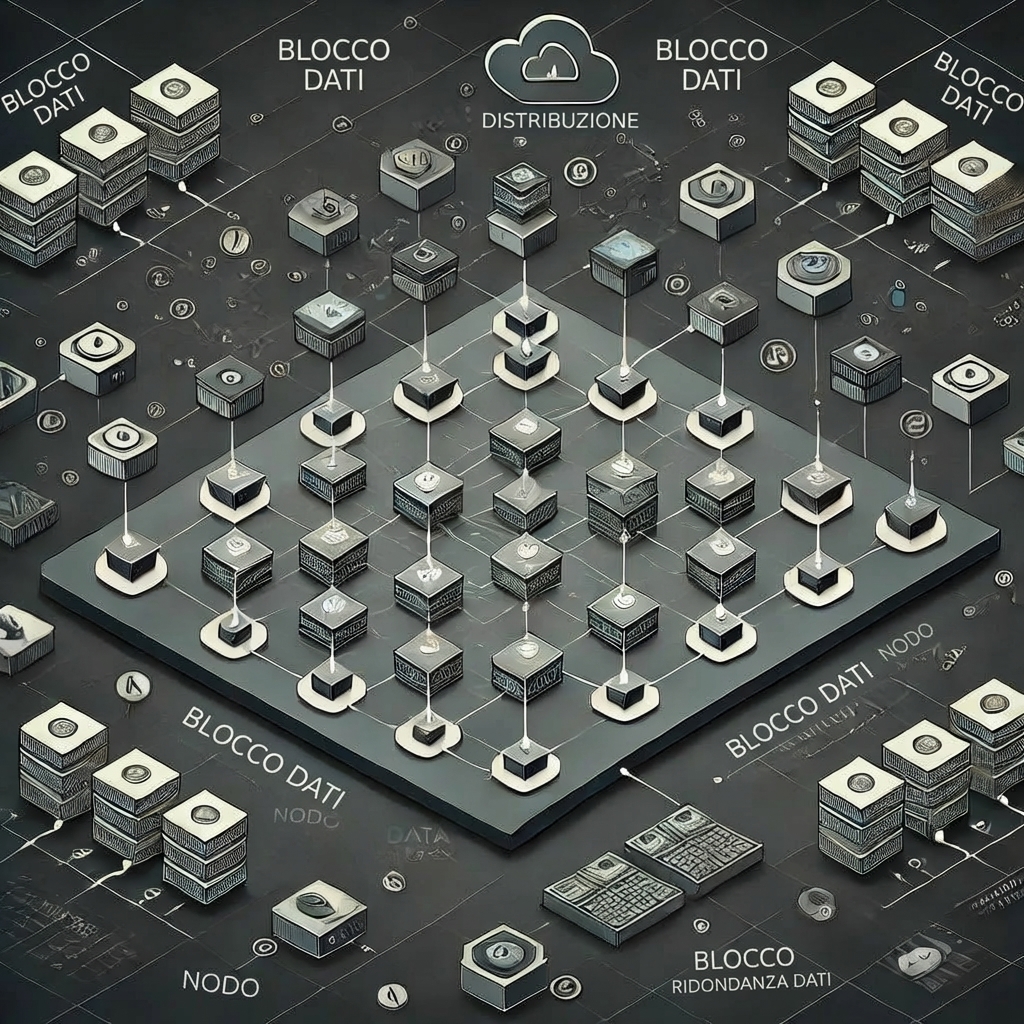

Elaborazione dati distribuita: Progettata per gestire grandi dataset su cluster

Supporta vari formati dati inclusi CSV, Parquet e JSON

Integrazione SQL permette di interrogare i dati usando sia Python che SQL

Ottimizzato per velocità su larga scala

Quando usare PySpark?

Analisi di big data

Elaborazione dati distribuita

Streaming dati in tempo reale

Machine learning su grandi dataset

Pipeline ETL ed ELT

Lavorare con fonti dati diverse:

- CSV

- JSON

- Parquet

- Molti altri

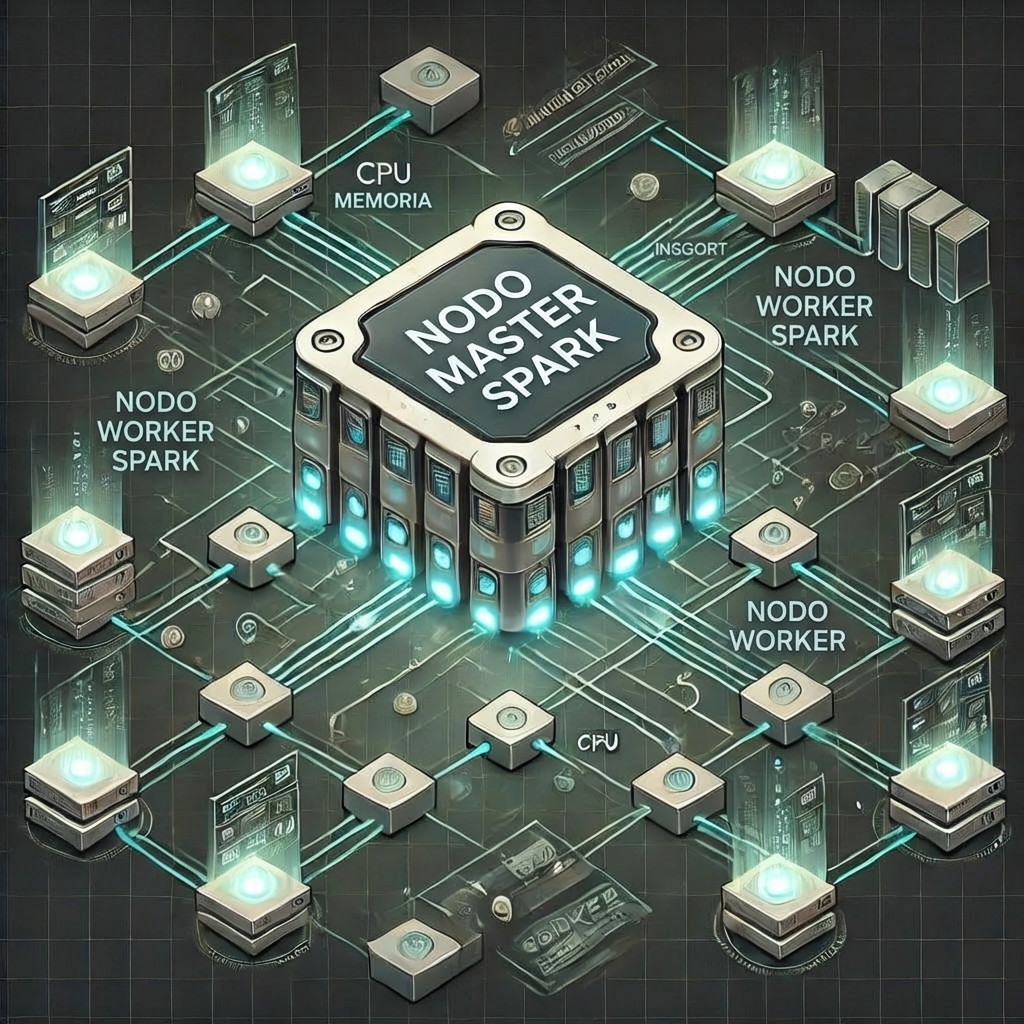

Cluster Spark

Nodo Master

- Gestisce il cluster, coordina i compiti e pianifica i lavori

Nodi Worker

- Eseguono i compiti assegnati dal master

- Responsabili dell'esecuzione dei calcoli e della memorizzazione dei dati in memoria o su disco

SparkSession

- SparkSessions ti permettono di accedere al tuo cluster Spark e sono essenziali per usare PySpark.

# Importa SparkSession

from pyspark.sql import SparkSession

# Inizializza una SparkSession

spark = SparkSession.builder.appName("MySparkApp").getOrCreate()

$$

.builder()imposta una sessionegetOrCreate()crea o recupera una sessione.appName()aiuta a gestire più sessioni

DataFrame PySpark

- Simili ad altri DataFrame ma

- Ottimizzati per PySpark

# Importa e inizializza una sessione Spark

from pyspark.sql import SparkSession

spark = SparkSession.builder.appName("MySparkApp").getOrCreate()

# Crea un DataFrame

census_df = spark.read.csv("census.csv",

["gender","age","zipcode","salary_range_usd","marriage_status"])

# Mostra il DataFrame

census_df.show()

Facciamo pratica!

Introduzione a PySpark