PySpark'a Giriş

PySpark'e Giriş

Benjamin Schmidt

Data Engineer

Eğitmeninizle Tanışın

- PySpark ile Neredeyse On Yıllık Veri Deneyimi

PySpark'ı Makine Öğrenimi, ETL görevleri ve daha fazlası için kullandı

Herkes için yeni araçlar öğretmeye hevesli

-

PySpark Nedir?

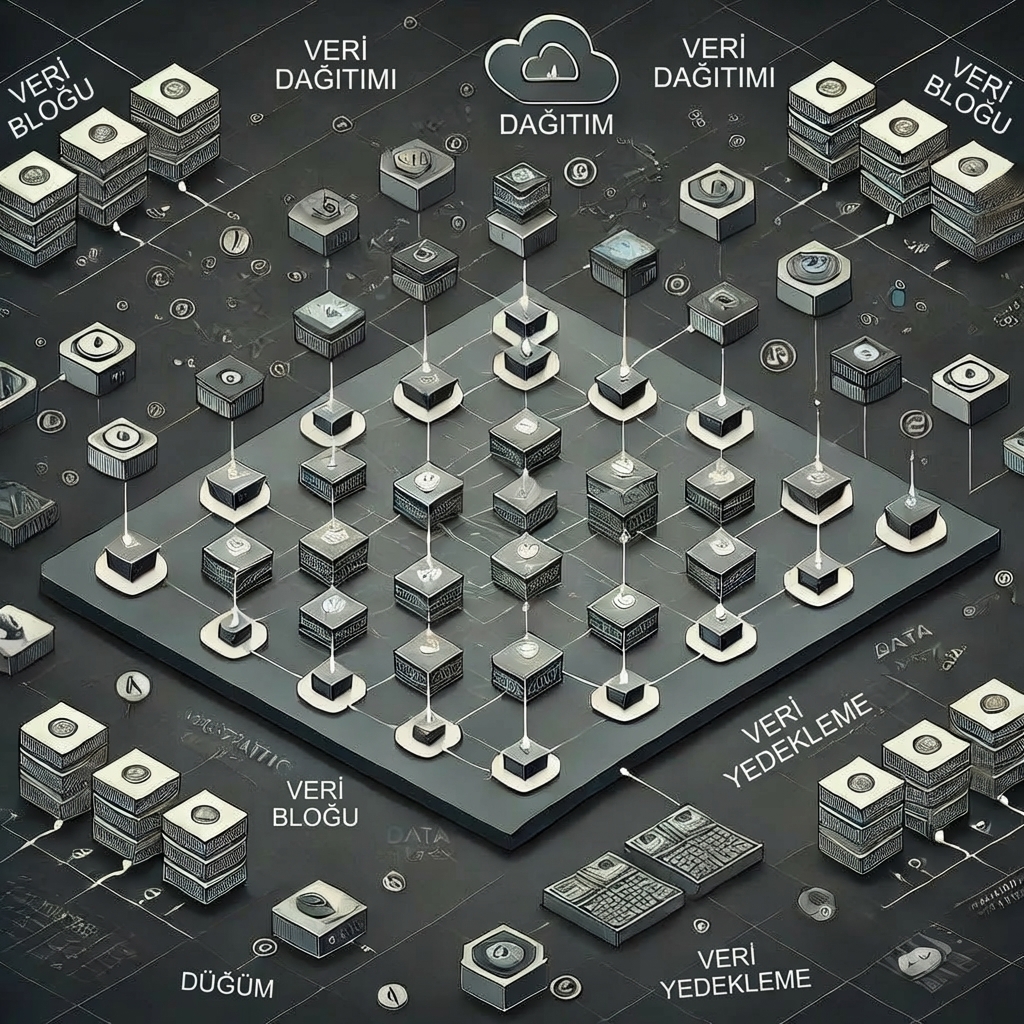

Dağıtık veri işleme: Büyük veri kümelerini kümeler arasında işlemek için tasarlanmıştır

CSV, Parquet ve JSON dahil çeşitli veri formatlarını destekler

SQL entegrasyonu, hem Python hem de SQL sözdizimi ile veri sorgulamaya olanak tanır

Ölçekli hız için optimize edilmiştir

PySpark'ı Ne Zaman Kullanırız?

Büyük veri analitiği

Dağıtık veri işleme

Gerçek zamanlı veri akışı

Büyük veri kümeleri üzerinde makine öğrenimi

ETL ve ELT hatları

Çeşitli veri kaynaklarıyla çalışma:

- CSV

- JSON

- Parquet

- Daha Fazlası

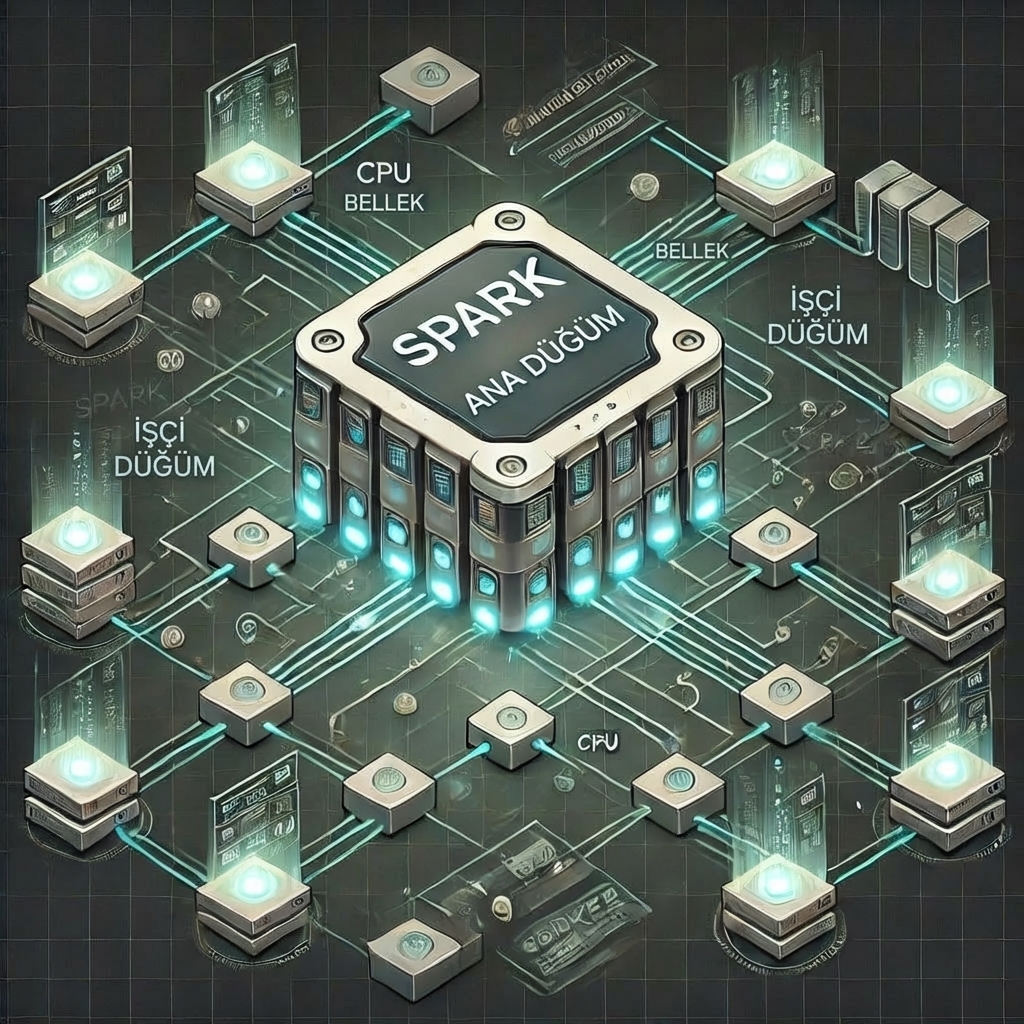

Spark Kümesi

Ana Düğüm

- Küme yönetir, görevleri koordine eder ve işleri planlar

İşçi Düğümleri

- Ana düğüm tarafından atanan görevleri yürütür

- Gerçek hesaplamaları yürütmek ve verileri bellekte veya diskte depolamakla sorumludur

SparkSession

- SparkSession'lar, Spark kümenize erişmenizi sağlar ve PySpark kullanımı için kritiktir.

# SparkSession'ı içe aktar

from pyspark.sql import SparkSession

# Bir SparkSession başlat

spark = SparkSession.builder.appName("MySparkApp").getOrCreate()

$$

.builder()bir oturum kurargetOrCreate()oturum oluşturur veya mevcut olanı alır.appName()birden fazla oturumu yönetmeye yardımcı olur

PySpark DataFrame'leri

- Diğer DataFrame'lere benzer ama

- PySpark için optimize edilmiştir

# Bir Spark oturumu içe aktar ve başlat

from pyspark.sql import SparkSession

spark = SparkSession.builder.appName("MySparkApp").getOrCreate()

# Bir DataFrame oluştur

census_df = spark.read.csv("census.csv",

["gender","age","zipcode","salary_range_usd","marriage_status"])

# DataFrame'i göster

census_df.show()

Hadi pratik yapalım!

PySpark'e Giriş