Pengantar PySpark

Pengantar PySpark

Benjamin Schmidt

Data Engineer

Kenali instruktur Anda

- Hampir Satu Dekade Pengalaman Data dengan PySpark

Menggunakan PySpark untuk Pembelajaran Mesin, tugas ETL, dan banyak lagi

Pengajar antusias alat baru untuk semua!

-

Apa itu PySpark?

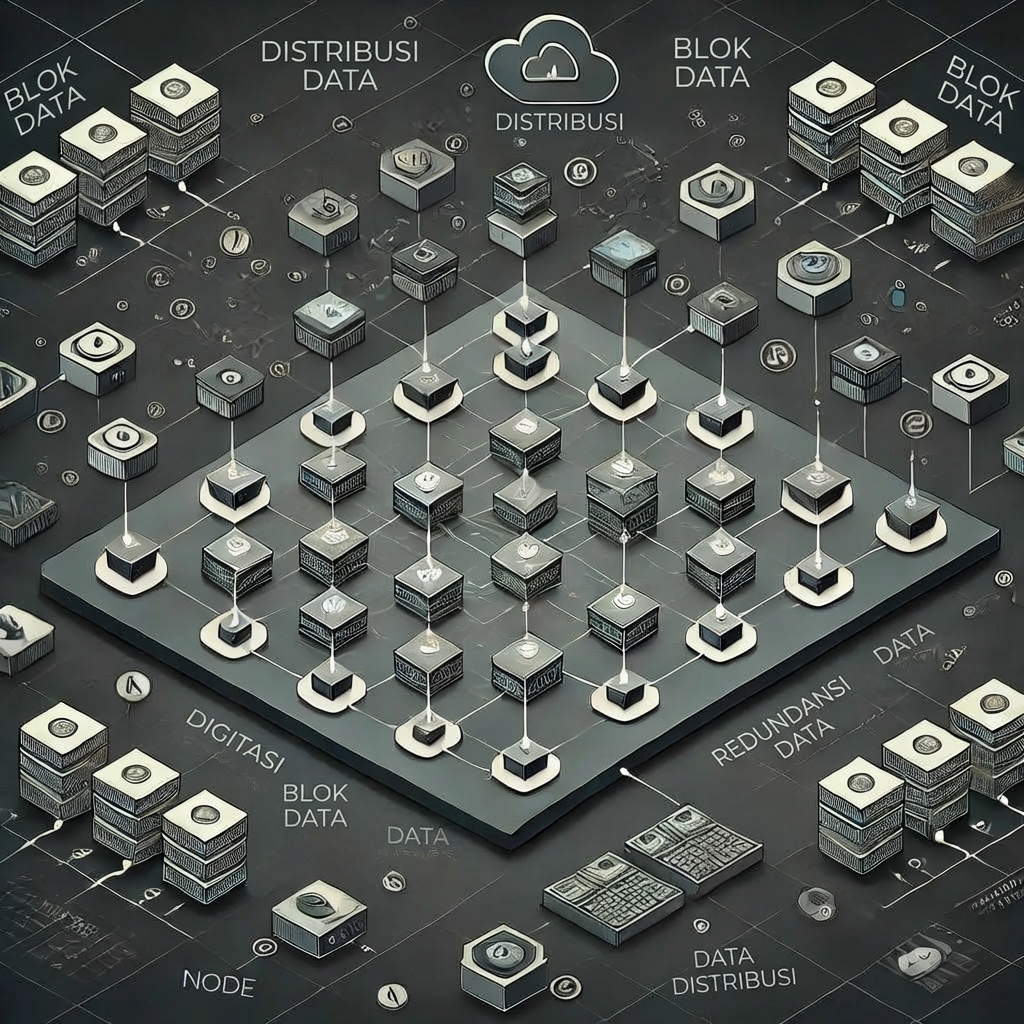

Pemrosesan data terdistribusi: Dirancang untuk menangani dataset besar di seluruh kluster

Mendukung berbagai format data termasuk CSV, Parquet, dan JSON

Integrasi SQL memungkinkan kueri data menggunakan sintaks Python dan SQL

Dioptimalkan untuk kecepatan dalam skala besar

Kapan kita menggunakan PySpark?

Analitik data besar

Pemrosesan data terdistribusi

Streaming data real-time

Pembelajaran mesin pada dataset besar

Pipeline ETL dan ELT

Bekerja dengan berbagai sumber data:

- CSV

- JSON

- Parquet

- Banyak Lagi

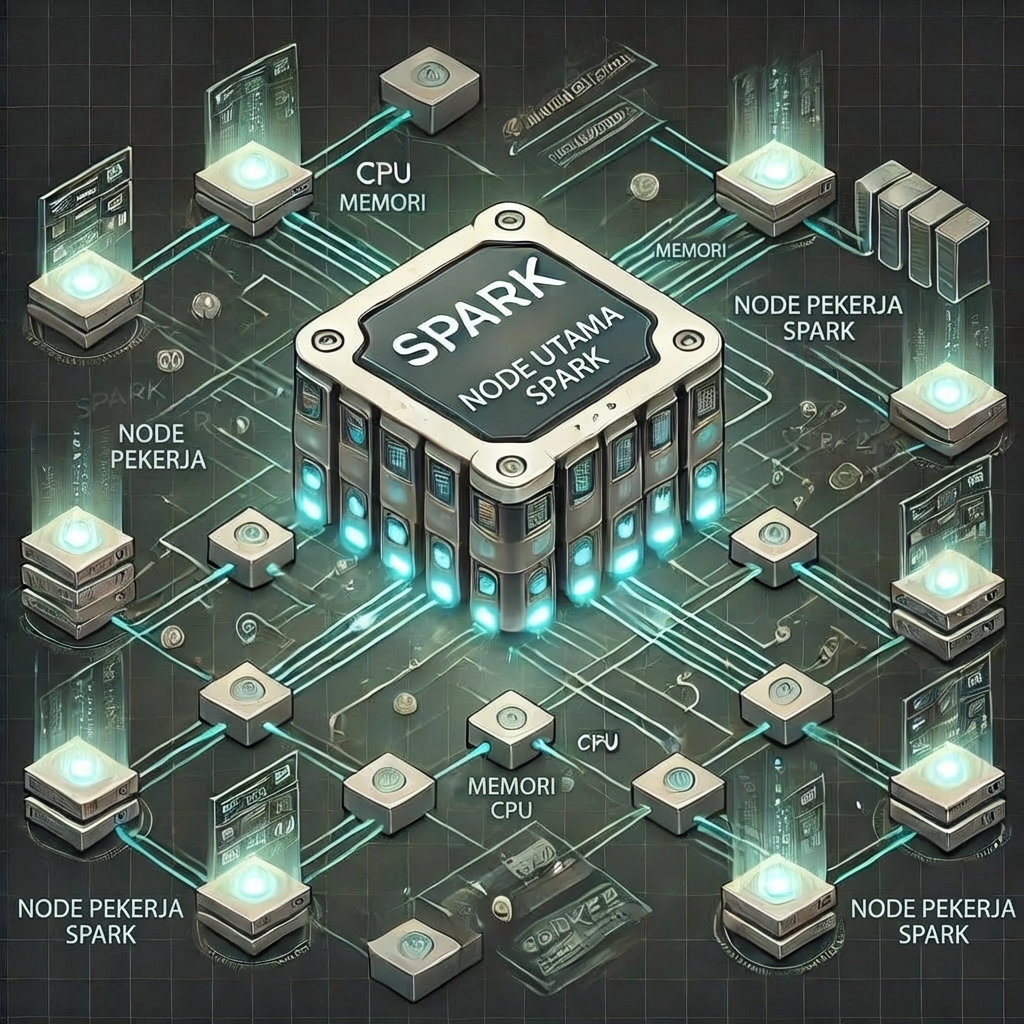

Kluster Spark

Node Master

- Mengelola kluster, mengoordinasikan tugas, dan menjadwalkan pekerjaan

Node Pekerja

- Menjalankan tugas yang ditugaskan oleh master

- Bertanggung jawab untuk menjalankan perhitungan aktual dan menyimpan data di memori atau disk

SparkSession

- SparkSessions memungkinkan Anda mengakses kluster Spark dan penting untuk menggunakan PySpark.

# Impor SparkSession

from pyspark.sql import SparkSession

# Inisialisasi SparkSession

spark = SparkSession.builder.appName("MySparkApp").getOrCreate()

$$

.builder()menyiapkan sesigetOrCreate()membuat atau mengambil sesi.appName()membantu mengelola beberapa sesi

PySpark DataFrames

- Mirip dengan DataFrames lainnya tetapi

- Dioptimalkan untuk PySpark

# Impor dan inisialisasi sesi Spark

from pyspark.sql import SparkSession

spark = SparkSession.builder.appName("MySparkApp").getOrCreate()

# Buat DataFrame

census_df = spark.read.csv("census.csv",

["gender","age","zipcode","salary_range_usd","marriage_status"])

# Tampilkan DataFrame

census_df.show()

Mari berlatih!

Pengantar PySpark