Introductie tot PySpark

Introductie tot PySpark

Benjamin Schmidt

Data Engineer

Ontmoet je instructeur

- Bijna tien jaar ervaring met PySpark

PySpark gebruikt voor Machine Learning, ETL-taken en meer

Enthousiaste leraar van nieuwe tools voor iedereen!

-

Wat is PySpark?

Gedistribueerde dataverwerking: Ontworpen voor grote datasets over clusters

Ondersteunt verschillende dataformaten zoals CSV, Parquet en JSON

SQL-integratie voor dataquery's met Python en SQL-syntaxis

Geoptimaliseerd voor snelheid op schaal

Wanneer gebruiken we PySpark?

Big data-analyse

Gedistribueerde dataverwerking

Realtime datastreaming

Machine learning op grote datasets

ETL en ELT pipelines

Werken met diverse databronnen:

- CSV

- JSON

- Parquet

- En nog veel meer

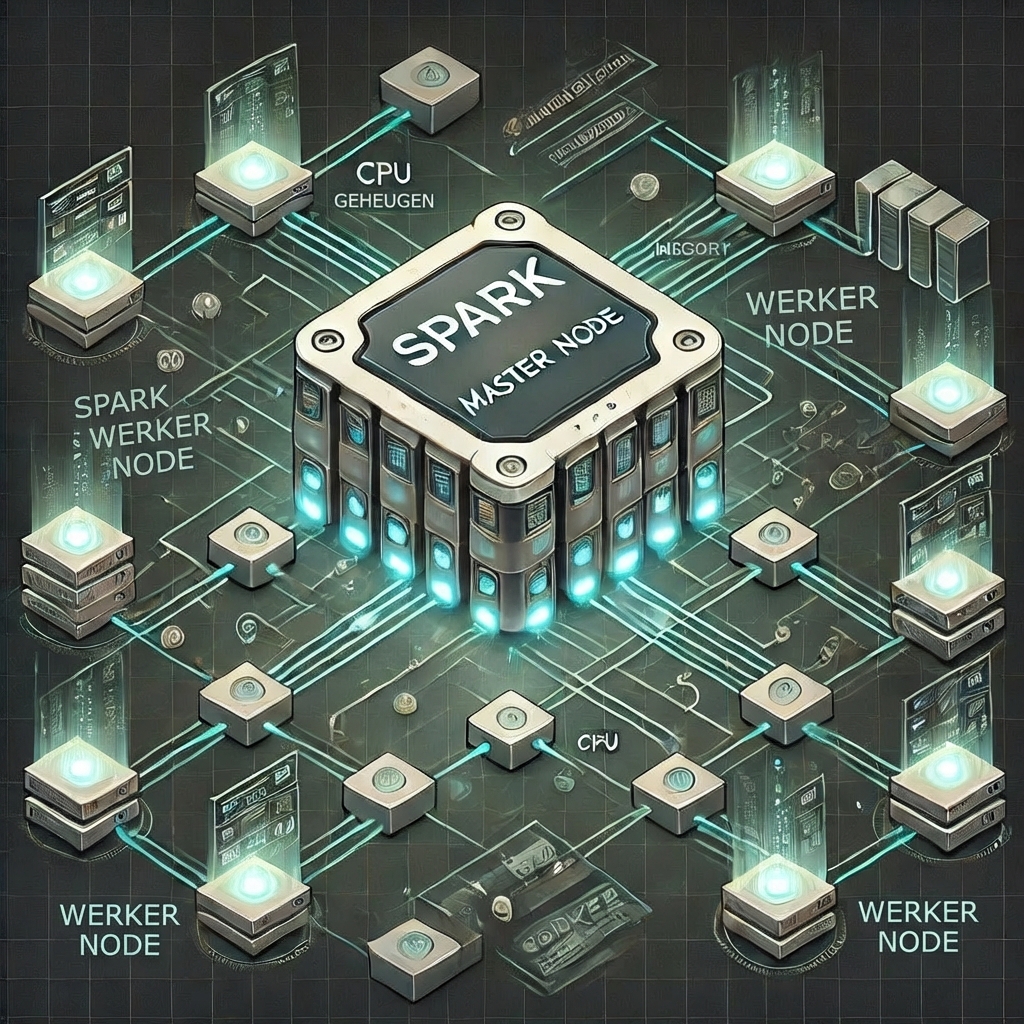

Spark-cluster

Master Node

- Beheert de cluster, coördineert taken en plant jobs

Worker Nodes

- Voeren de taken uit die door de master zijn toegewezen

- Verantwoordelijk voor het uitvoeren van berekeningen en het opslaan van data in geheugen of op schijf

SparkSession

- SparkSessions geven toegang tot je Spark-cluster en zijn essentieel voor PySpark.

# Importeer SparkSession

from pyspark.sql import SparkSession

# Start een SparkSession

spark = SparkSession.builder.appName("MySparkApp").getOrCreate()

$$

.builder()stelt een sessie ingetOrCreate()maakt of haalt een sessie op.appName()beheert meerdere sessies

PySpark DataFrames

- Vergelijkbaar met andere DataFrames maar

- Geoptimaliseerd voor PySpark

# Importeer en start een Spark-sessie

from pyspark.sql import SparkSession

spark = SparkSession.builder.appName("MySparkApp").getOrCreate()

# Maak een DataFrame

census_df = spark.read.csv("census.csv",

["gender","age","zipcode","salary_range_usd","marriage_status"])

# Toon het DataFrame

census_df.show()

Laten we oefenen!

Introductie tot PySpark