Évaluation et visualisation de modèles

Machine Learning de bout en bout

Joshua Stapleton

Machine Learning Engineer

Exactitude

- Des métriques d’exactitude adaptées sont essentielles pour une évaluation robuste

- Les résultats sont faciles à mal interpréter ou à biaiser

Exactitude standard :

- Exactitude = nb de prédictions correctes / nb total

- Peut être peu utile

Exemple :

# achieves ~99% accuracy for imbalanced dataset of 99 positive and 1 negative

for patient_datapoint in heart_disease_dataset:

model.prediction(patient_datapoint) = 'positive'

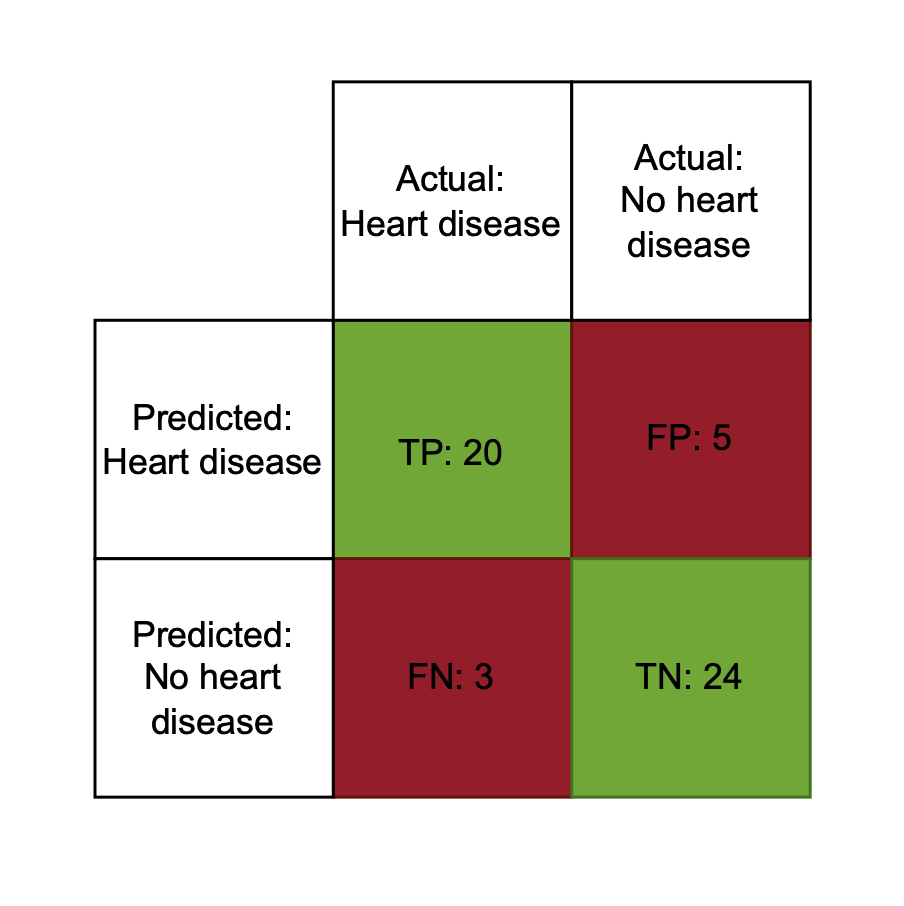

Matrice de confusion

Vrais positifs (VP)

- Prédiction = classe réelle = positive

- Le modèle a prédit une maladie cardiaque, le patient en avait une

Faux positifs (FP)

- Prédiction = positive, classe réelle = négative

- Le modèle a prédit une maladie cardiaque, le patient n’en avait pas

Faux négatifs (FN)

- Prédiction = négative, classe réelle = positive

- Le modèle a prédit aucune maladie cardiaque, le patient en avait une

Vrais négatifs (VN)

- Prédiction = classe réelle = négative

- Le modèle a prédit aucune maladie cardiaque, le patient n’en avait pas

Exactitude équilibrée

- Meilleure métrique que l’exactitude simple pour la plupart des binaires

- Moyenne pondérée sur les deux classes

- Exactitude équilibrée = (TP + TN) / 2

from sklearn.metrics import balanced_accuracy_score

# Assume y_test is the true labels and y_pred are the predicted labels

y_pred = model.predict(X_test)

bal_accuracy = balanced_accuracy_score(y_test, y_pred)

print(f"Balanced Accuracy: {bal_accuracy:.2f}")

Balanced Accuracy: 0.85

Utilisation de la matrice de confusion

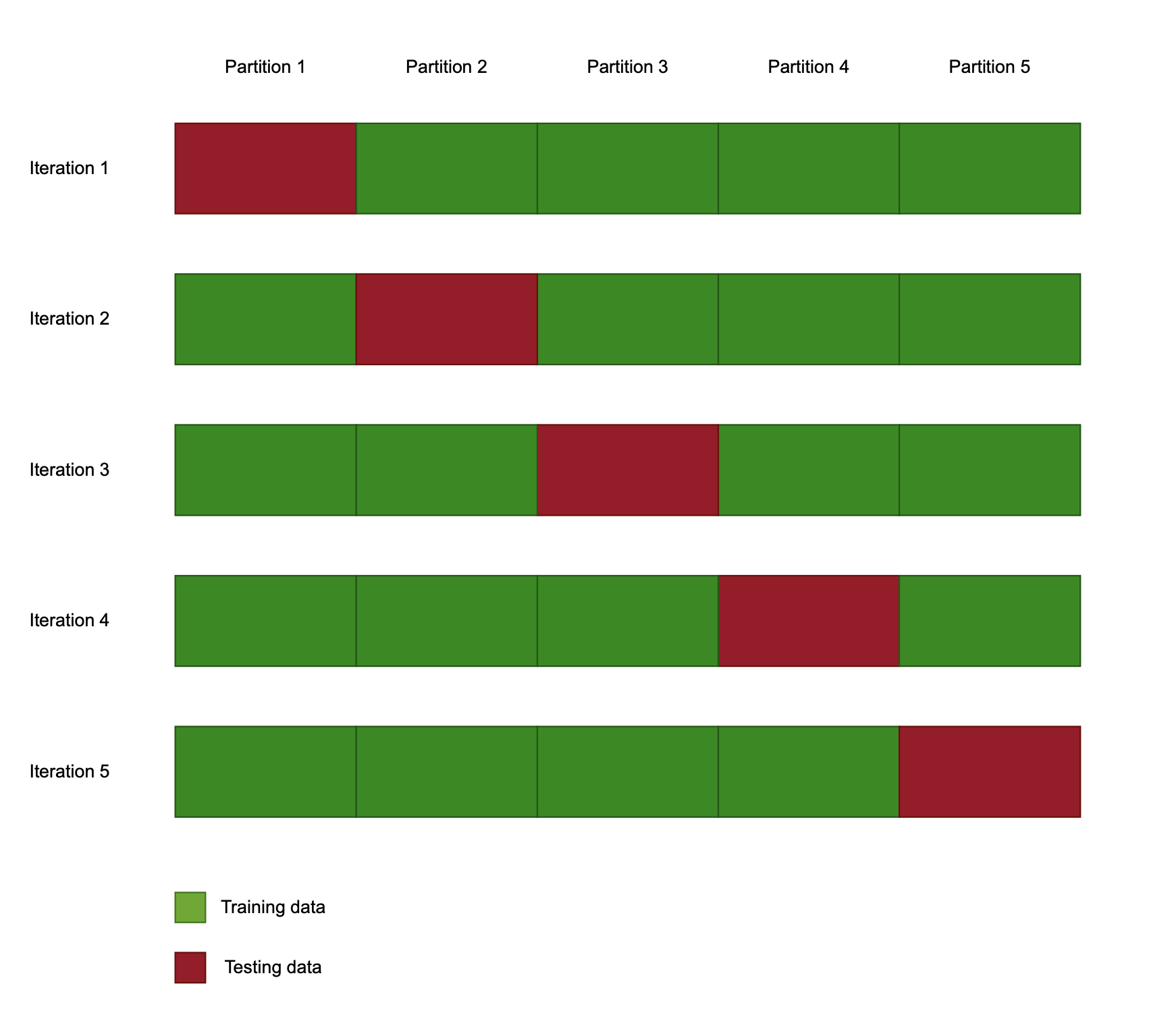

Validation croisée

Validation croisée

- Procédure de rééchantillonnage

- Assure la robustesse des résultats

Validation croisée k-fold

- Paramètre « k » = nombre de partitions du jeu de données

- Nouveau découpage train/test à chaque exécution

Utilisation de la validation croisée

- Implémentation simple de la k-fold avec sklearn

- Score indépendant du modèle

Utilisation :

from sklearn.model_selection import cross_val_score, KFold # split the data into 10 equal parts kfold = KFold(n_splits=5, shuffle=True, random_state=42)# get the cross validation accuracy for a given model cv_results = cross_val_score(model, heart_disease_X, heart_disease_y, cv=kfold, scoring='balanced_accuracy')

Ajustement des hyperparamètres

Hyperparamètre :

- Paramètre global du modèle (ne varie pas pendant l’entraînement)

- À ajuster pour améliorer les performances

# Hyperparameters to test

C_values = [0.001, 0.01, 0.1, 1, 10, 100, 1000]

# Manually iterate over the hyperparameters

for C in C_values:

model = LogisticRegression(max_iter=200, C=C)

model.fit(X_train, y_train)

accuracy = cross_val_score(model, X, y, cv=kfold, scoring='balanced_accuracy')

print(f"C = {C}: Bal Acc: {accuracy.mean():.4f} (+/- {accuracy.std():.4f})")

Exemple d’ajustement d’hyperparamètres

Exemple de sortie pour l’ajustement d’hyperparamètres :

C = 0.001: Bal Acc: 0.6200 (+/- 0.0215)

C = 0.01: Bal Acc: 0.7325 (+/- 0.0234)

C = 0.1: Bal Acc: 0.7923 (+/- 0.0202)

C = 1: Bal Acc: 0.8050 (+/- 0.0191)

C = 10: Bal Acc: 0.8034 (+/- 0.0185)

C = 100: Bal Acc: 0.8021 (+/- 0.0187)

C = 1000: Bal Acc: 0.8017 (+/- 0.0188)

Passons à la pratique !

Machine Learning de bout en bout