Méthodes Monte Carlo

Reinforcement Learning avec Gymnasium en Python

Fouad Trad

Machine Learning Engineer

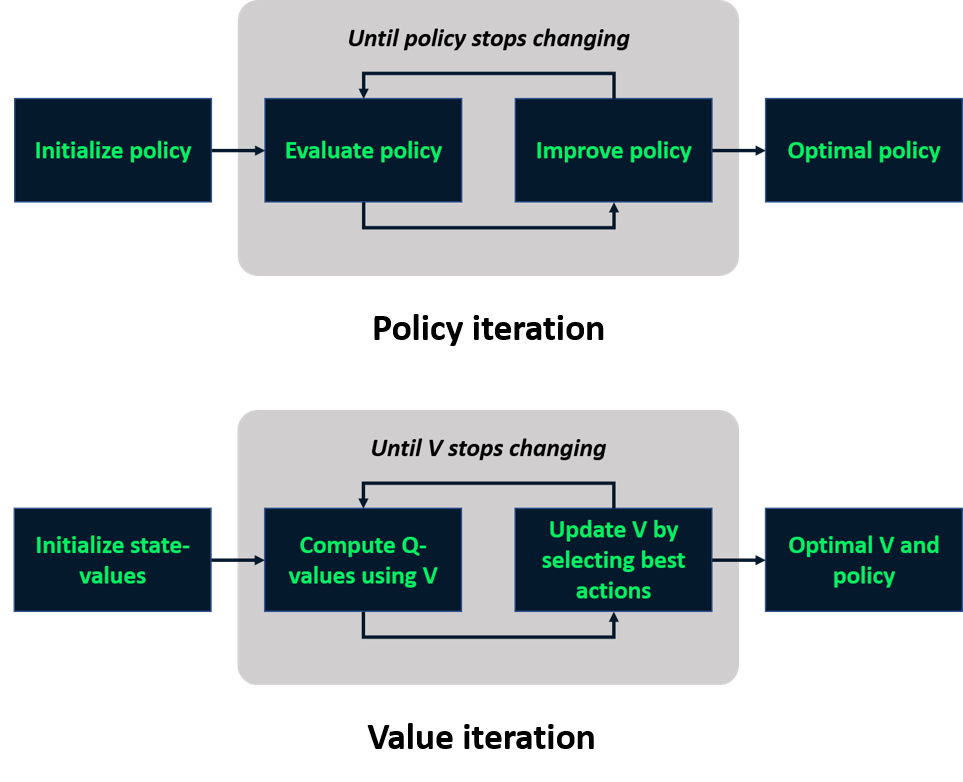

Rappel : apprentissage basé sur modèle

- S’appuie sur la dynamique de l’environnement

- Aucune interaction avec l’environnement

Apprentissage sans modèle

- Ne dépend pas de la dynamique de l’environnement

- L’agent interagit avec l’environnement

- Apprend la politique par essai-erreur

- Plus adapté aux cas réels

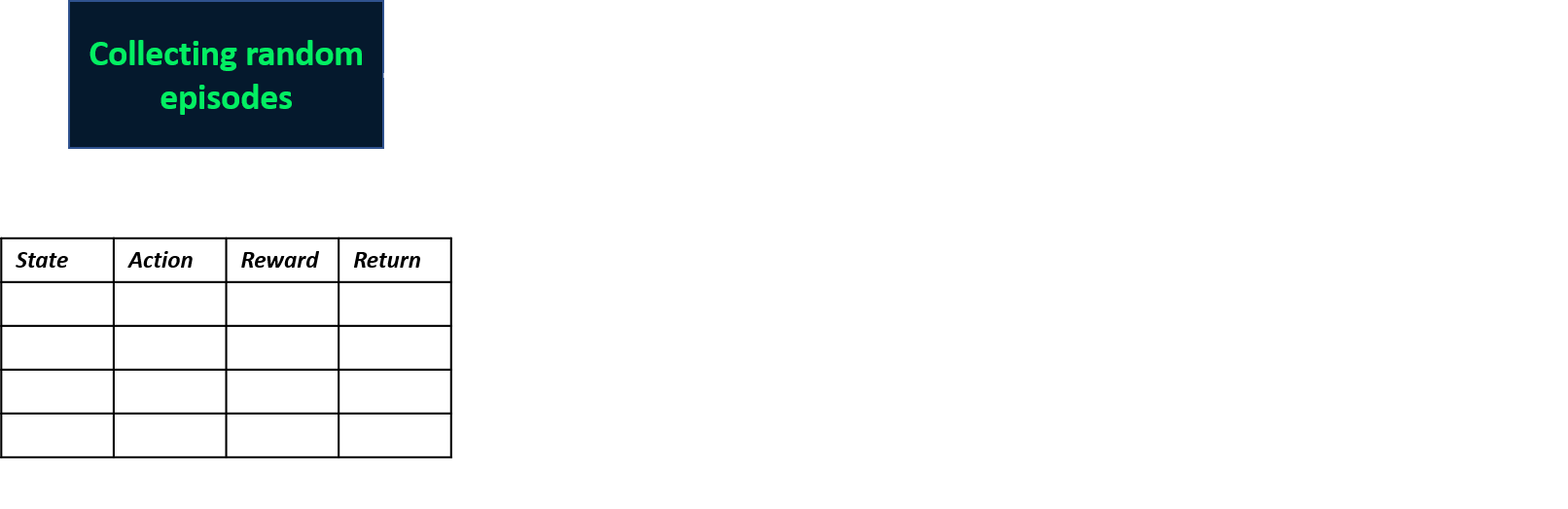

Méthodes Monte Carlo

- Techniques sans modèle

- Estiment les Q-valeurs à partir des épisodes

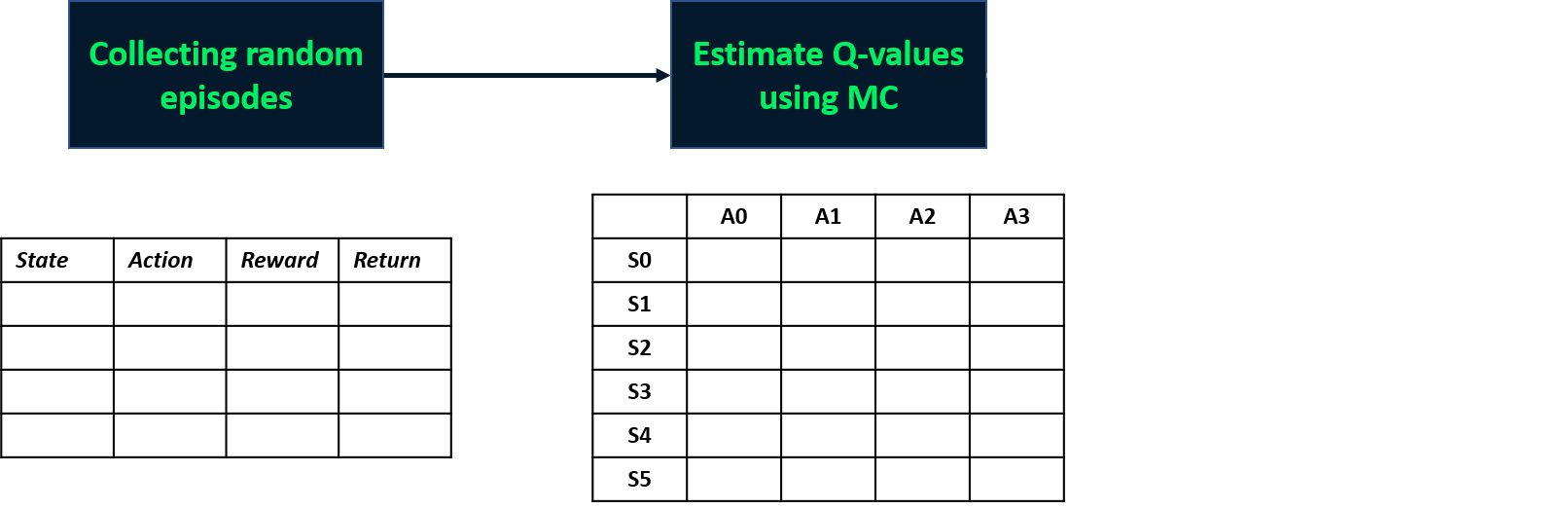

Méthodes Monte Carlo

- Techniques sans modèle

- Estiment les Q-valeurs à partir des épisodes

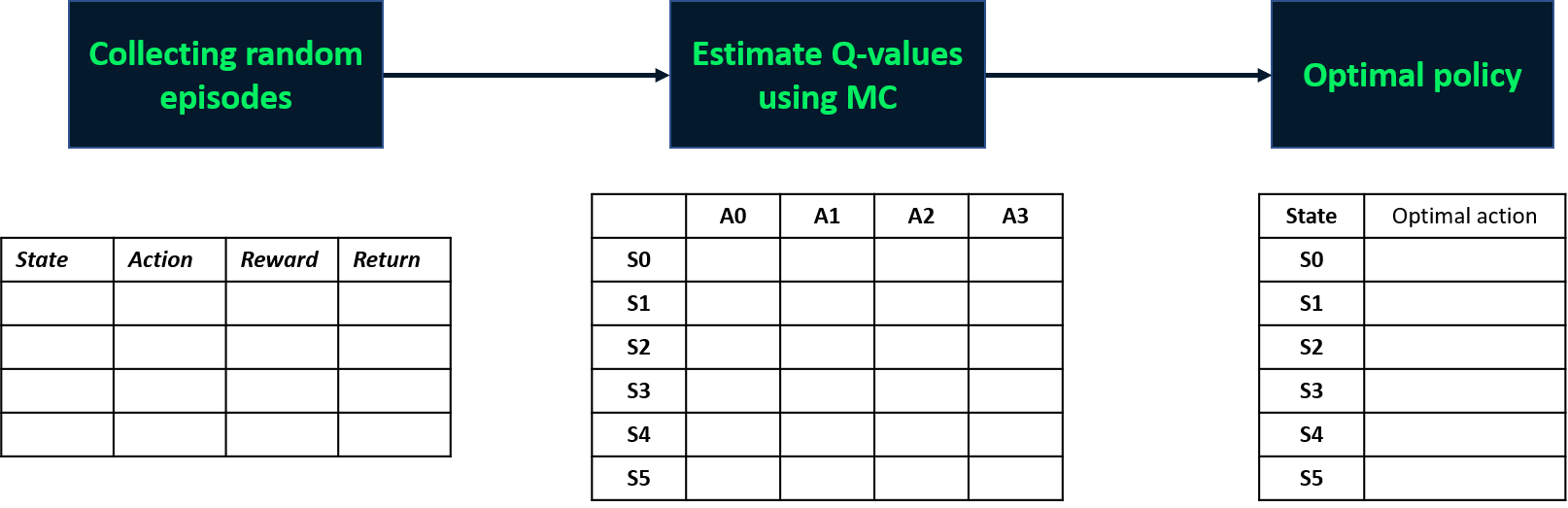

Méthodes Monte Carlo

- Techniques sans modèle

- Estiment les Q-valeurs à partir des épisodes

- Deux variantes : première visite, toutes visites

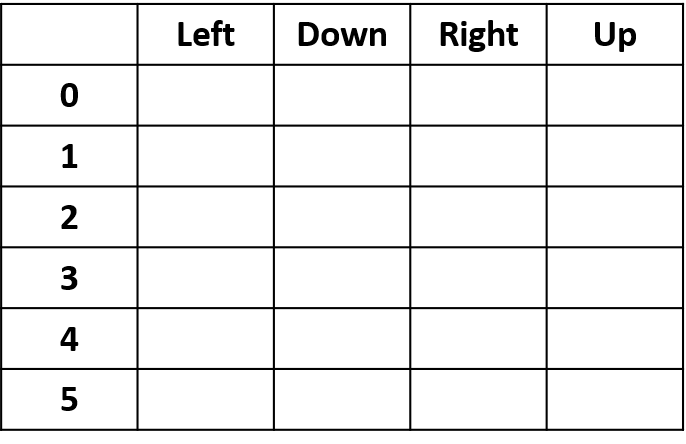

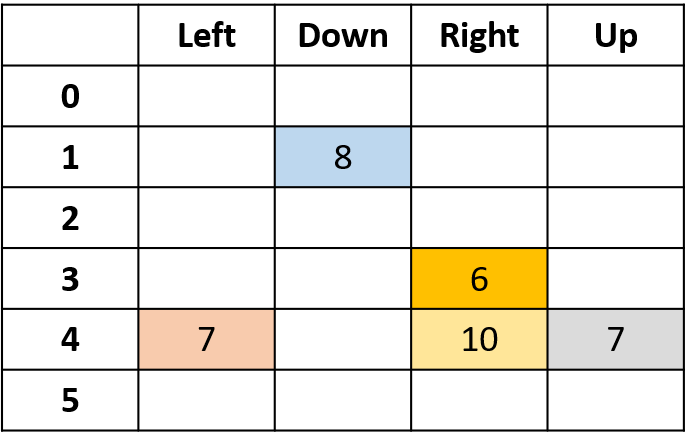

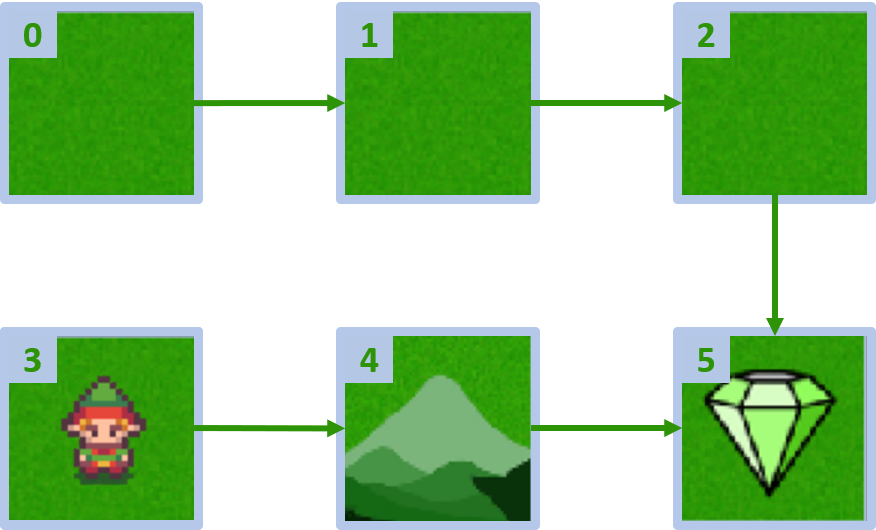

Grid world personnalisé

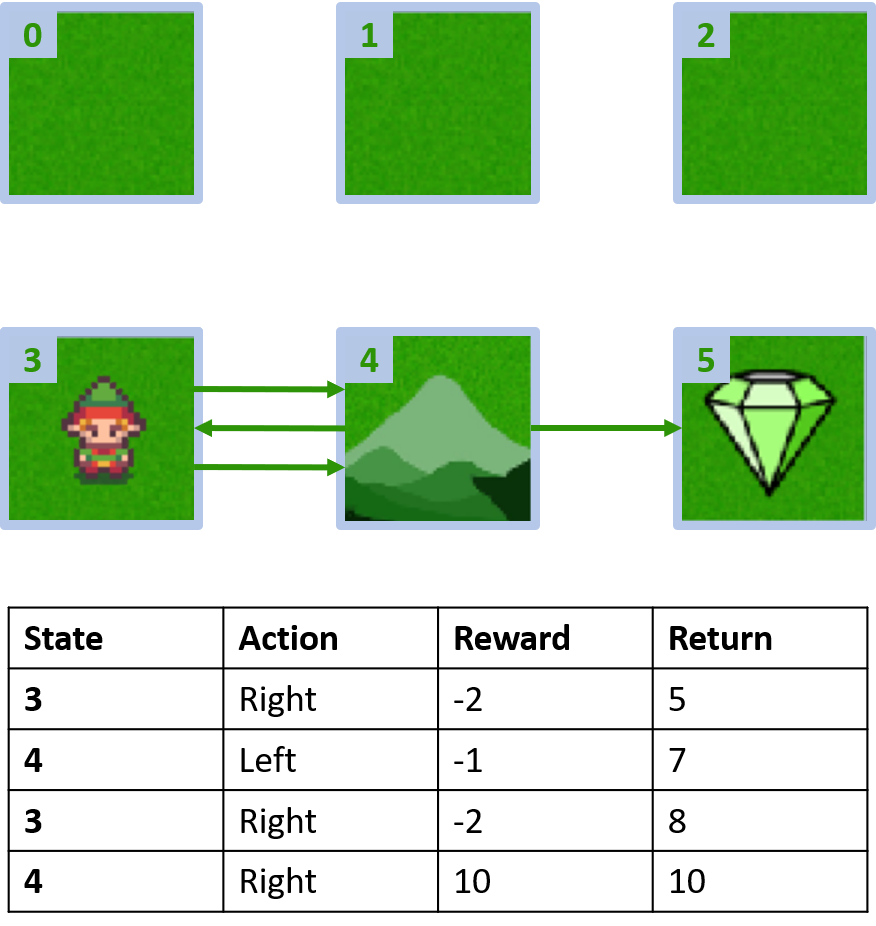

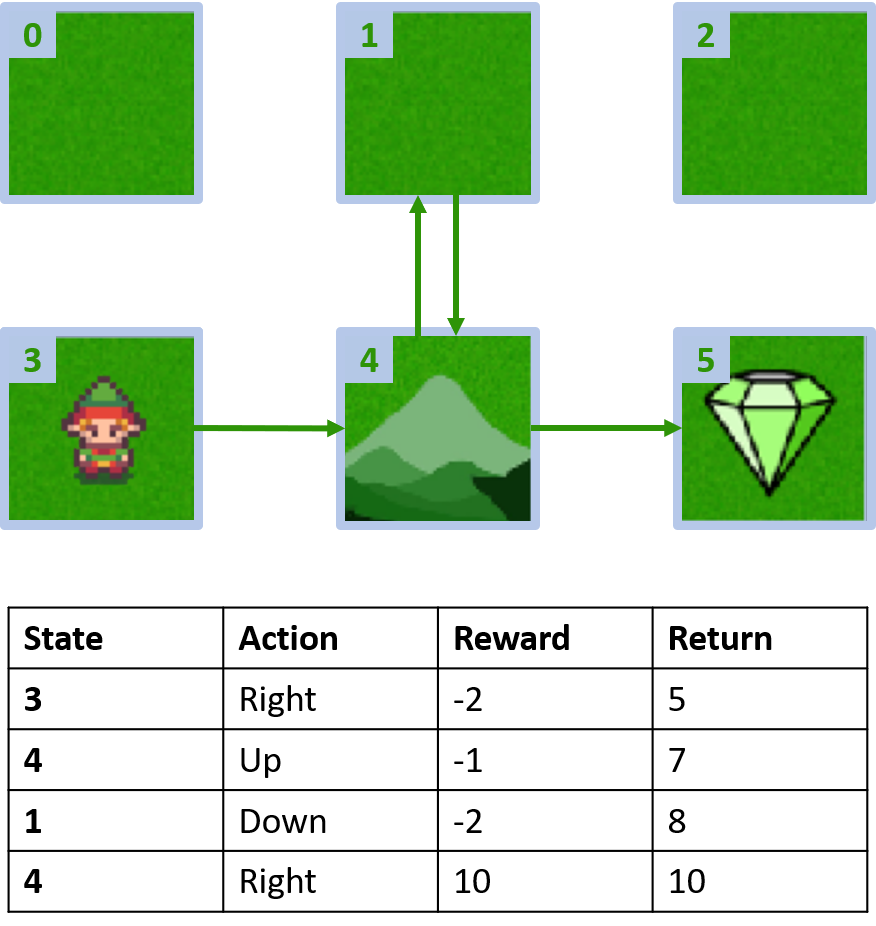

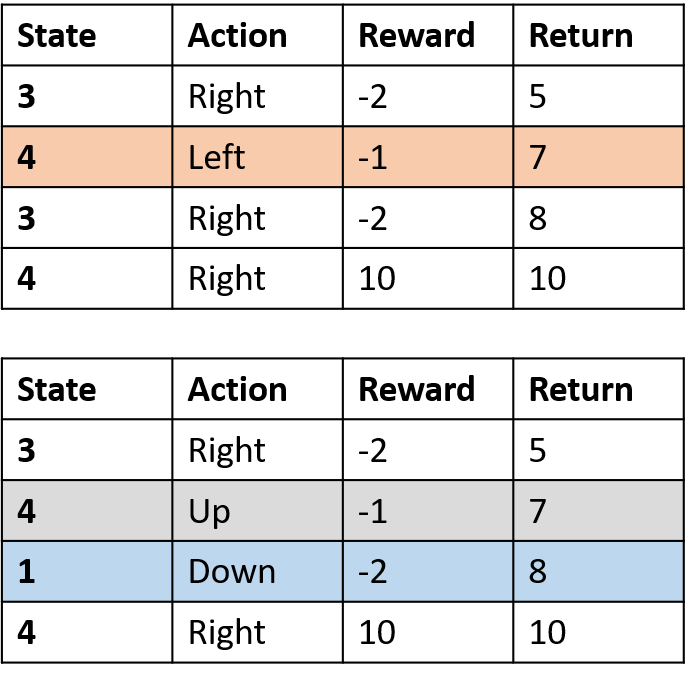

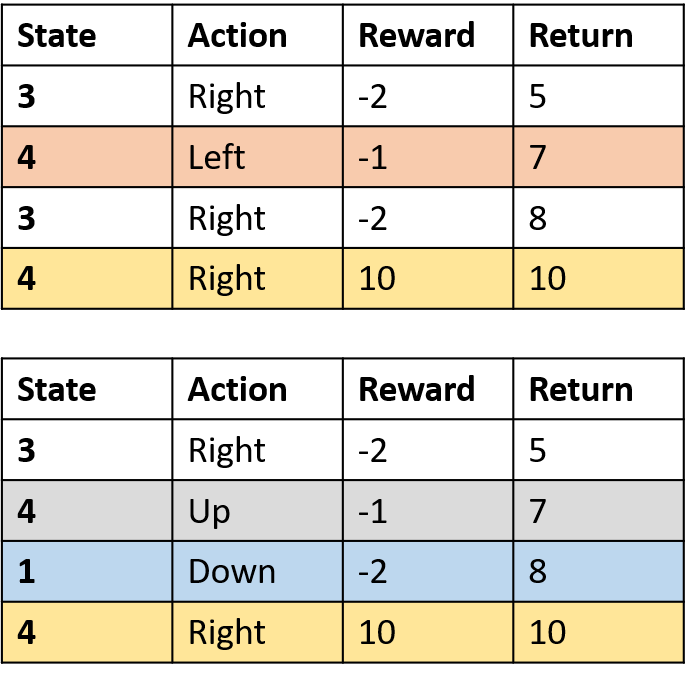

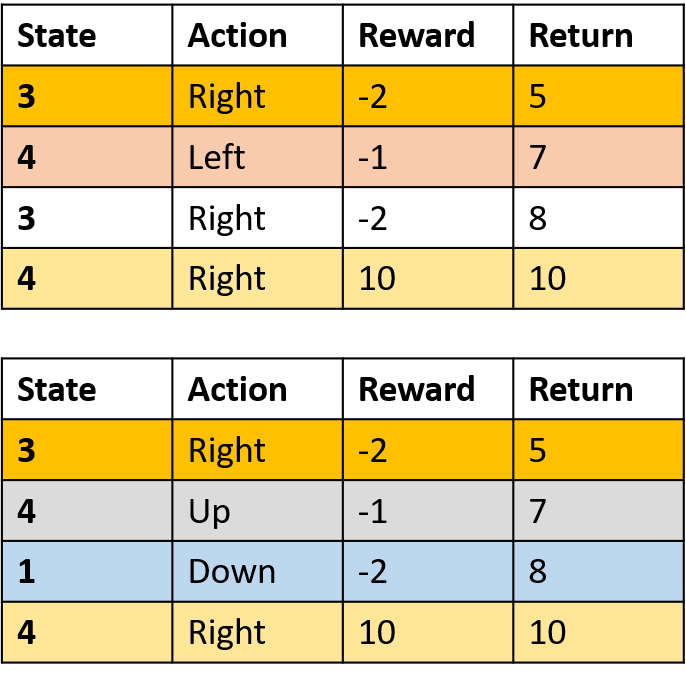

Collecte de deux épisodes

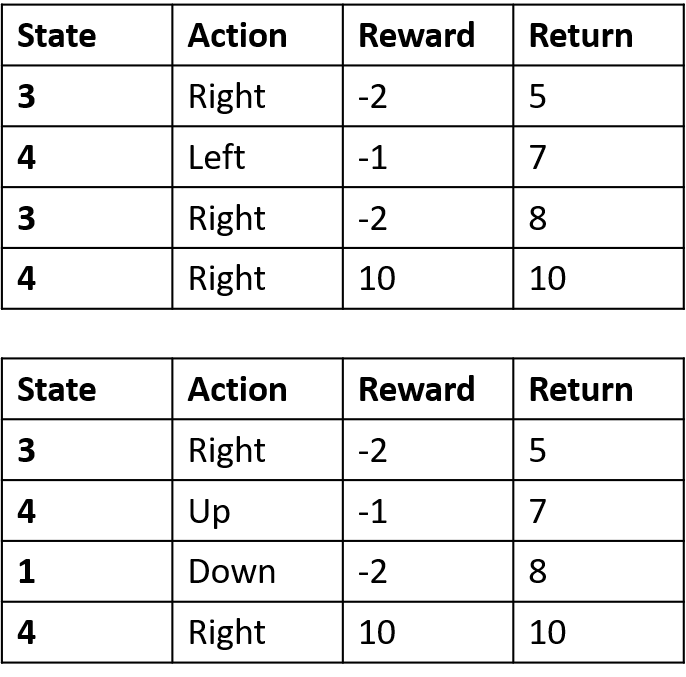

Estimation des Q-valeurs

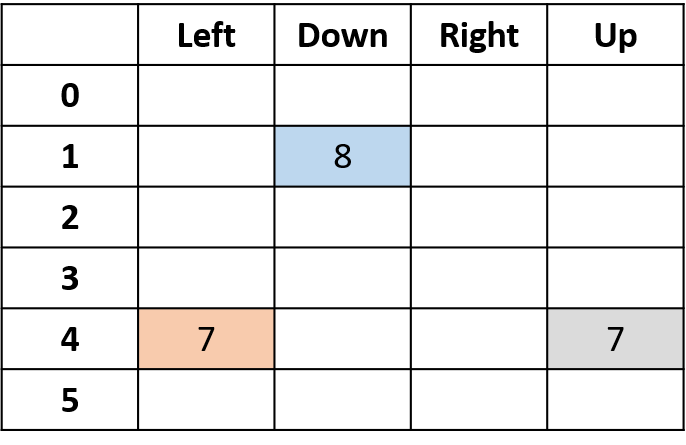

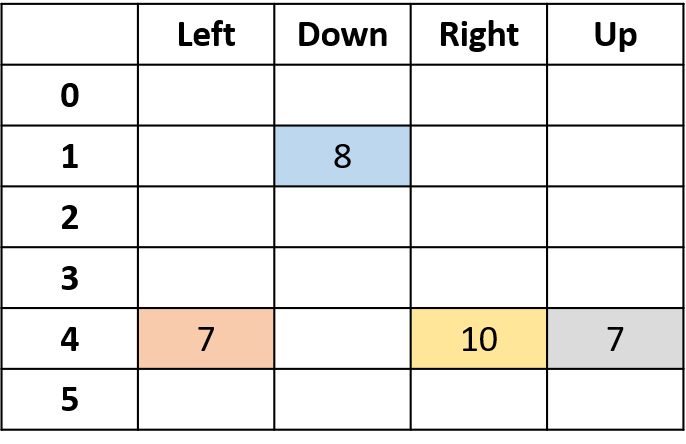

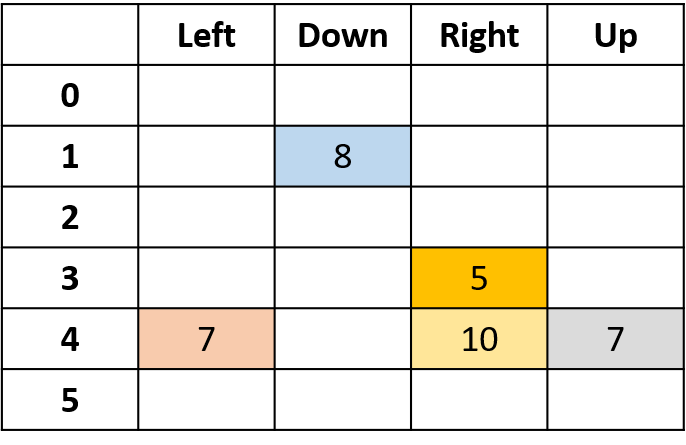

- Q-table : table des Q-valeurs

Q(4, gauche), Q(4, haut) et Q(1, bas)

- (s,a) apparaît une fois -> remplir avec le retour

Q(4, droite)

- (s,a) survient une fois par épisode -> moyenne

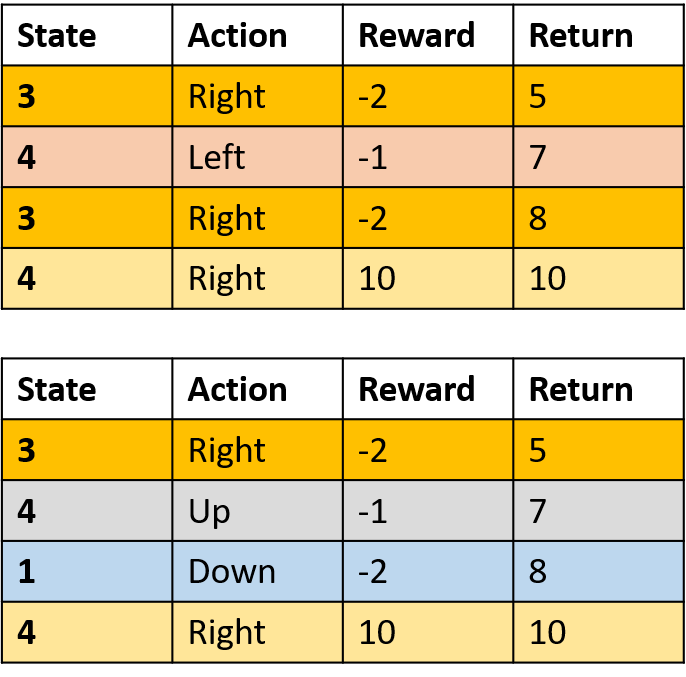

Q(3, droite) - Monte Carlo première visite

- Moyenne de la première visite de (s,a) dans les épisodes

Q(3, droite) - Monte Carlo toutes visites

- Moyenne de chaque visite de (s,a) dans les épisodes

Générer un épisode

def generate_episode(): episode = [] state, info = env.reset()terminated = False while not terminated: action = env.action_space.sample()next_state, reward, terminated, truncated, info = env.step(action)episode.append((state, action, reward)) state = next_statereturn episode

Monte Carlo première visite

def first_visit_mc(num_episodes): Q = np.zeros((num_states, num_actions)) returns_sum = np.zeros((num_states, num_actions)) returns_count = np.zeros((num_states, num_actions))for i in range(num_episodes): episode = generate_episode() visited_states_actions = set()for j, (state, action, reward) in enumerate(episode):if (state, action) not in visited_states:returns_sum[state, action] += sum([x[2] for x in episode[j:]])returns_count[state, action] += 1 visited_states_actions.add((state, action))nonzero_counts = returns_count != 0Q[nonzero_counts] = returns_sum[nonzero_counts] / returns_count[nonzero_counts] return Q

Monte Carlo toutes visites

def every_visit_mc(num_episodes):

Q = np.zeros((num_states, num_actions))

returns_sum = np.zeros((num_states, num_actions))

returns_count = np.zeros((num_states, num_actions))

for i in range(num_episodes):

episode = generate_episode()

for j, (state, action, reward) in enumerate(episode):

returns_sum[state, action] += sum([x[2] for x in episode[j:]])

returns_count[state, action] += 1

nonzero_counts = returns_count != 0

Q[nonzero_counts] = returns_sum[nonzero_counts] / returns_count[nonzero_counts]

return Q

Obtenir la politique optimale

def get_policy():

policy = {state: np.argmax(Q[state]) for state in range(num_states)}

return policy

Récapitulatif

Q = first_visit_mc(1000)policy_first_visit = get_policy()print("First-visit policy: \n", policy_first_visit)Q = every_visit_mc(1000)policy_every_visit = get_policy()print("Every-visit policy: \n", policy_every_visit)

First-visit policy:

{0: 2, 1: 2, 2: 1,

3: 2, 4: 2, 5: 0}

Every-visit policy:

{0: 2, 1: 2, 2: 1,

3: 2, 4: 2, 5: 0}

Passons à la pratique !

Reinforcement Learning avec Gymnasium en Python