Bandits manchots multiples

Reinforcement Learning avec Gymnasium en Python

Fouad Trad

Machine Learning Engineer

Bandits manchots multiples

- Joueur face à des machines à sous

- Objectif → maximiser les gains

- Solution → exploration/exploitation

Machines à sous

- Gain d’un bras : 0 ou 1

- Objectif de l’agent → accumuler un gain maximal

Résoudre le problème

- Epsilon-greedy décroissant

- Epsilon → choisir une machine au hasard

Résoudre le problème

- Epsilon-greedy décroissant

- Epsilon → choisir une machine au hasard

- 1 − epsilon → choisir la meilleure machine connue

- Epsilon diminue au fil du temps

Initialisation

n_bandits = 4 true_bandit_probs = np.random.rand(n_bandits)n_iterations = 100000 epsilon = 1.0 min_epsilon = 0.01 epsilon_decay = 0.999counts = np.zeros(n_bandits) # Nombre de tirages par banditvalues = np.zeros(n_bandits) # Proba de gain estimée par banditrewards = np.zeros(n_iterations) # Historique des gainsselected_arms = np.zeros(n_iterations, dtype=int) # Historique des bras choisis

Boucle d’interaction

for i in range(n_iterations): arm = epsilon_greedy()reward = np.random.rand() < true_bandit_probs[arm]rewards[i] = reward selected_arms[i] = arm counts[arm] += 1values[arm] += (reward - values[arm]) / counts[arm]epsilon = max(min_epsilon, epsilon * epsilon_decay)

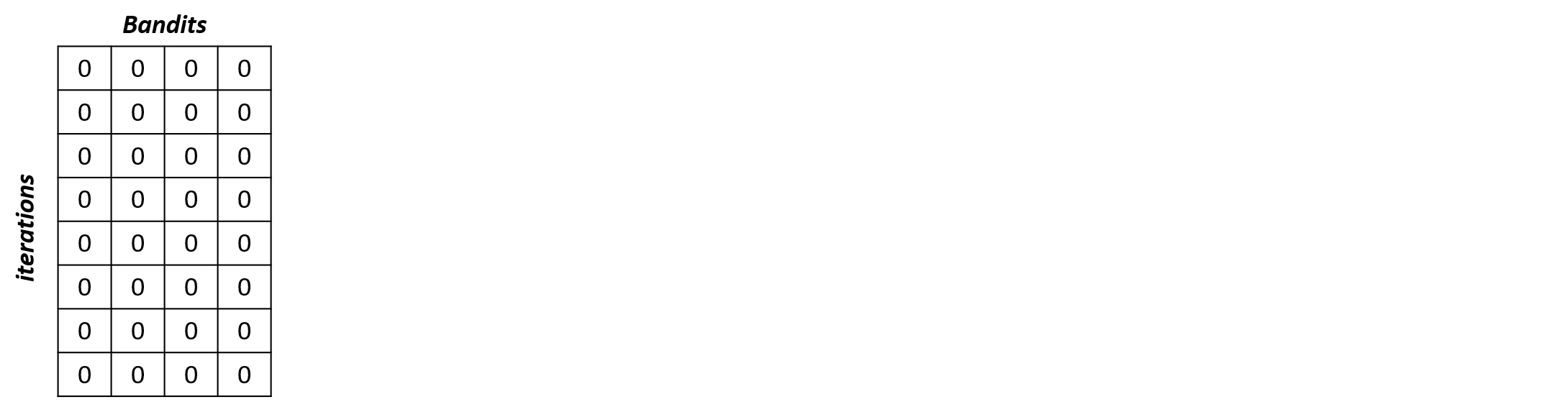

Analyse des sélections

selections_percentage = np.zeros((n_iterations, n_bandits))

Analyse des sélections

selections_percentage = np.zeros((n_iterations, n_bandits))for i in range(n_iterations): selections_percentage[i, selected_arms[i]] = 1

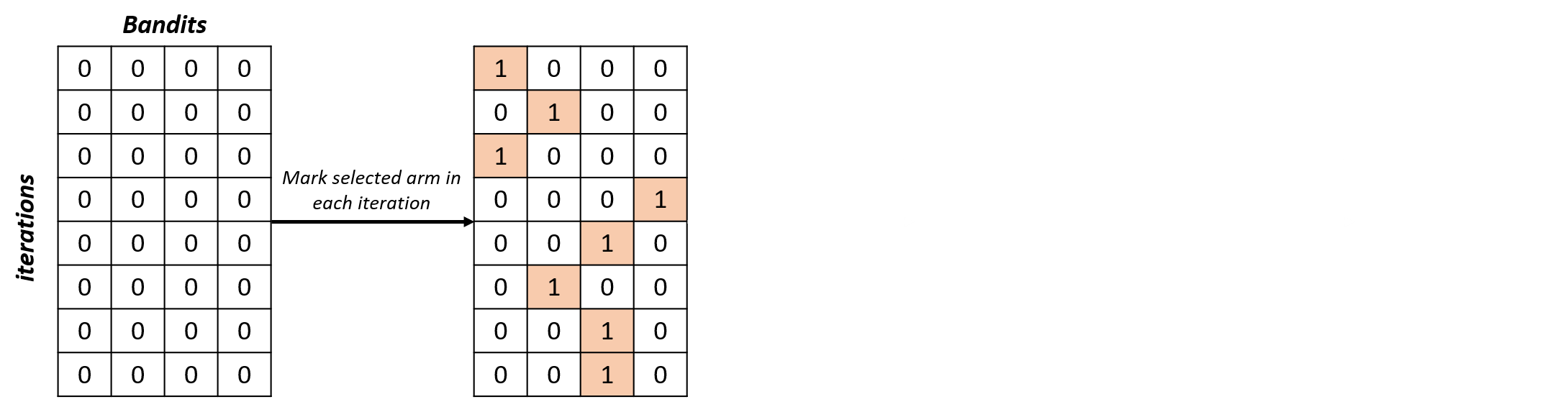

Analyse des sélections

selections_percentage = np.zeros((n_iterations, n_bandits))for i in range(n_iterations): selections_percentage[i, selected_arms[i]] = 1selections_percentage = np.cumsum(selections_percentage, axis=0) / np.arange(1, n_iterations + 1).reshape(-1, 1)

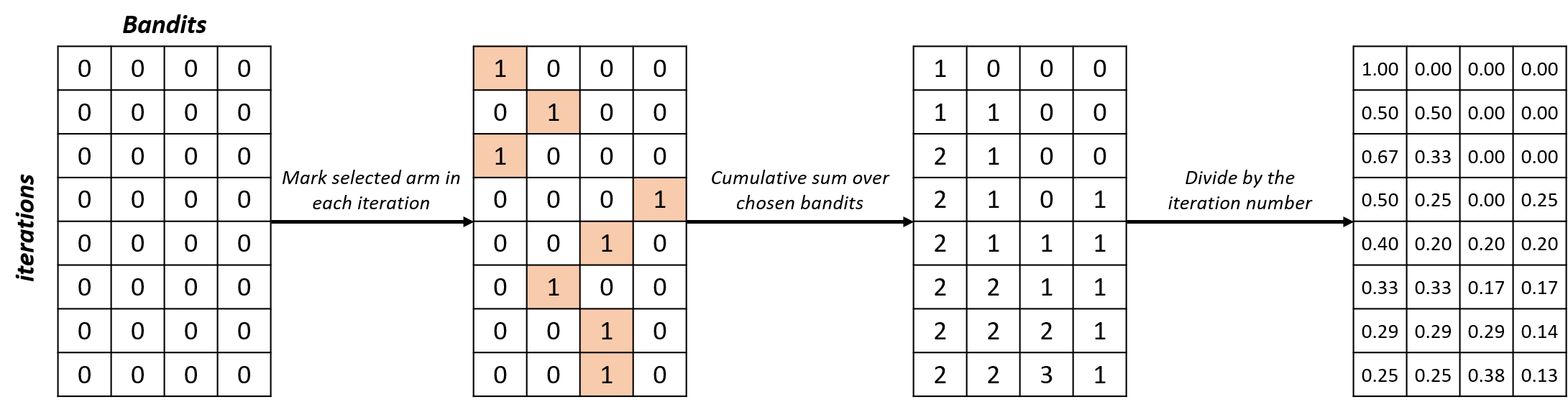

Analyse des sélections

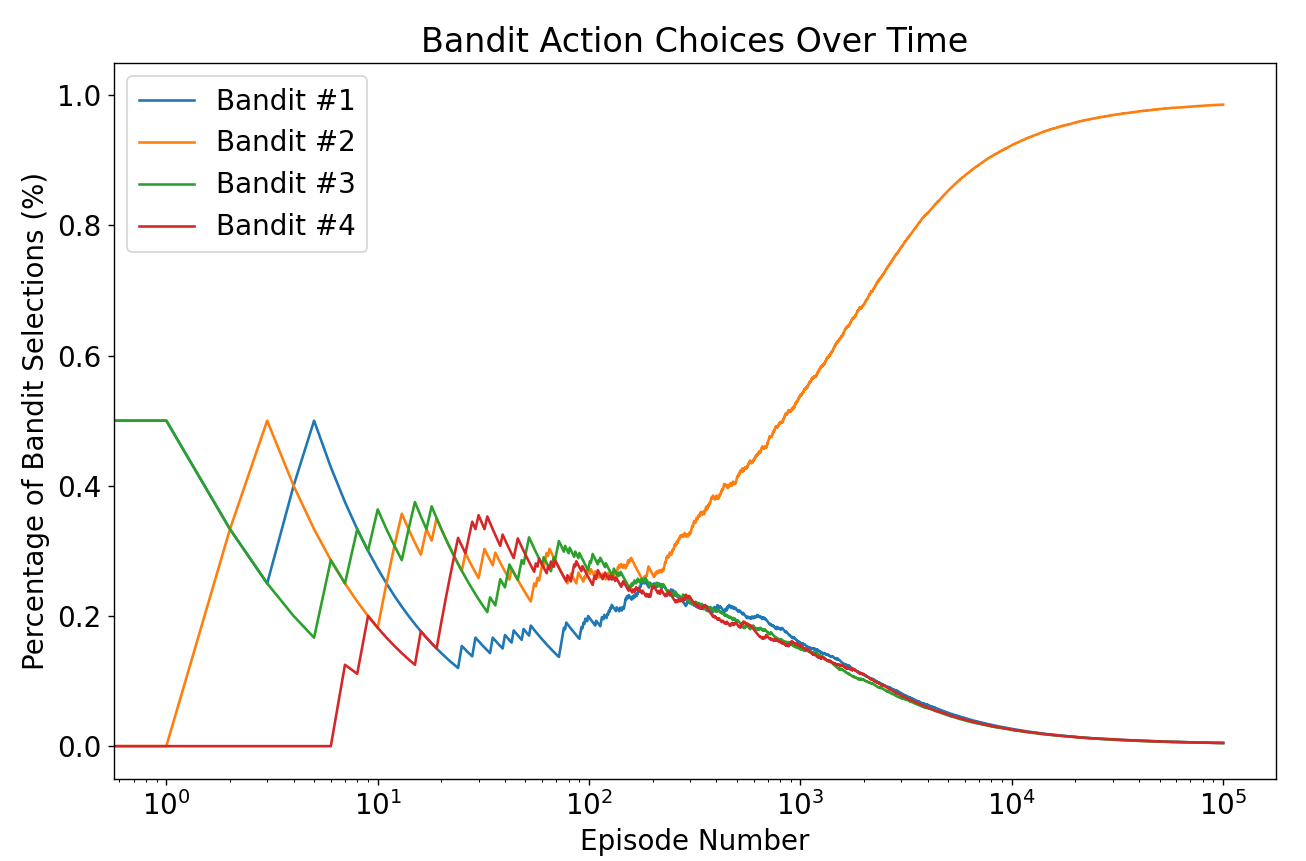

for arm in range(n_bandits): plt.plot(selections_percentage[:, arm], label=f'Bandit #{arm+1}') plt.xscale('log') plt.title('Choix des actions des bandits dans le temps') plt.xlabel('Numéro d’épisode') plt.ylabel('Pourcentage de sélections (%)') plt.legend() plt.show()for i, prob in enumerate(true_bandit_probs, 1): print(f"Bandit #{i} -> {prob:.2f}")

Bandit #1 -> 0.37

Bandit #2 -> 0.95

Bandit #3 -> 0.73

Bandit #4 -> 0.60

- L’agent apprend à choisir le bandit à la plus forte probabilité

Passons à la pratique !

Reinforcement Learning avec Gymnasium en Python