Glückwunsch!

Arbeiten mit Llama 3

Imtihan Ahmed

Machine Learning Engineer

Zur Erinnerung

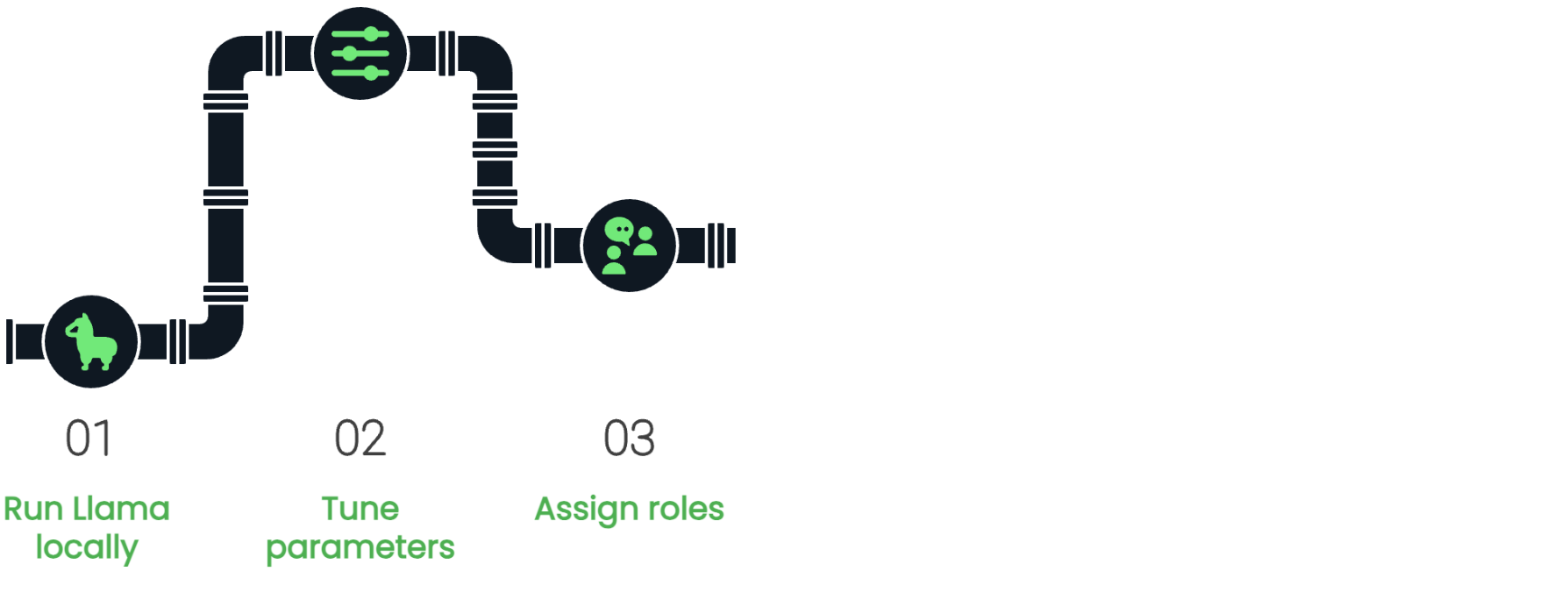

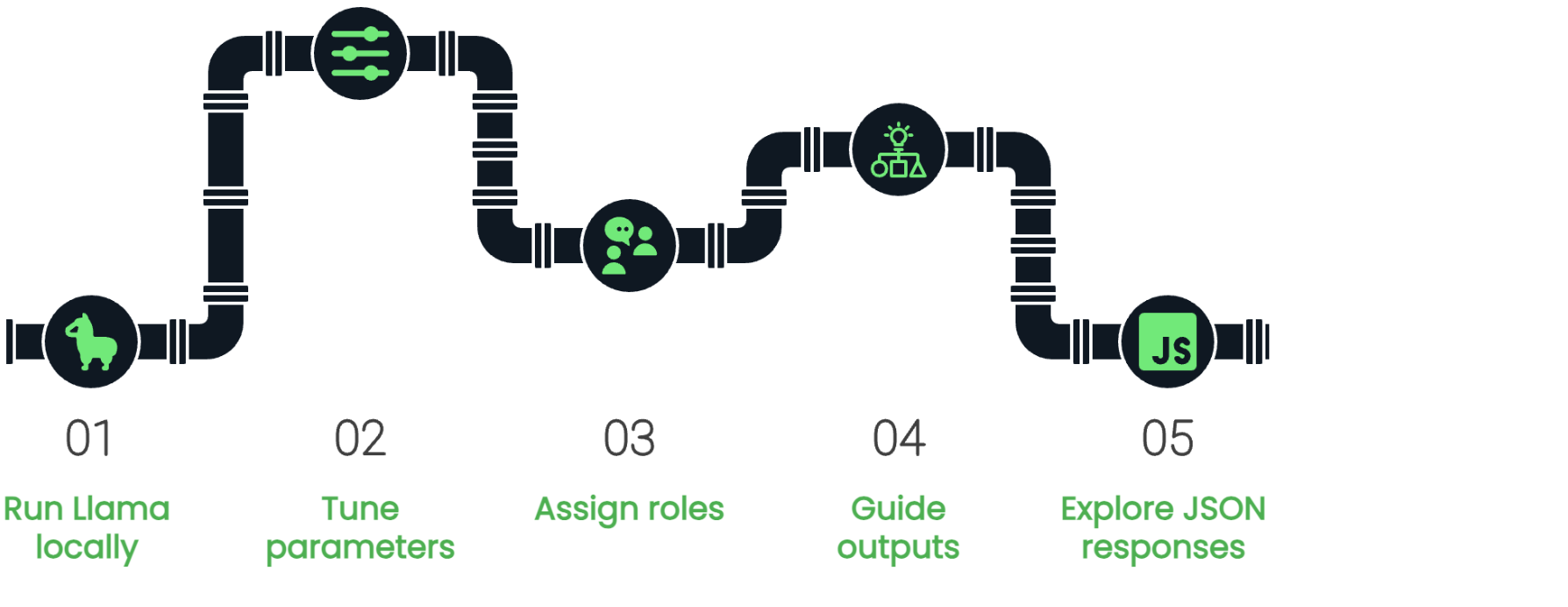

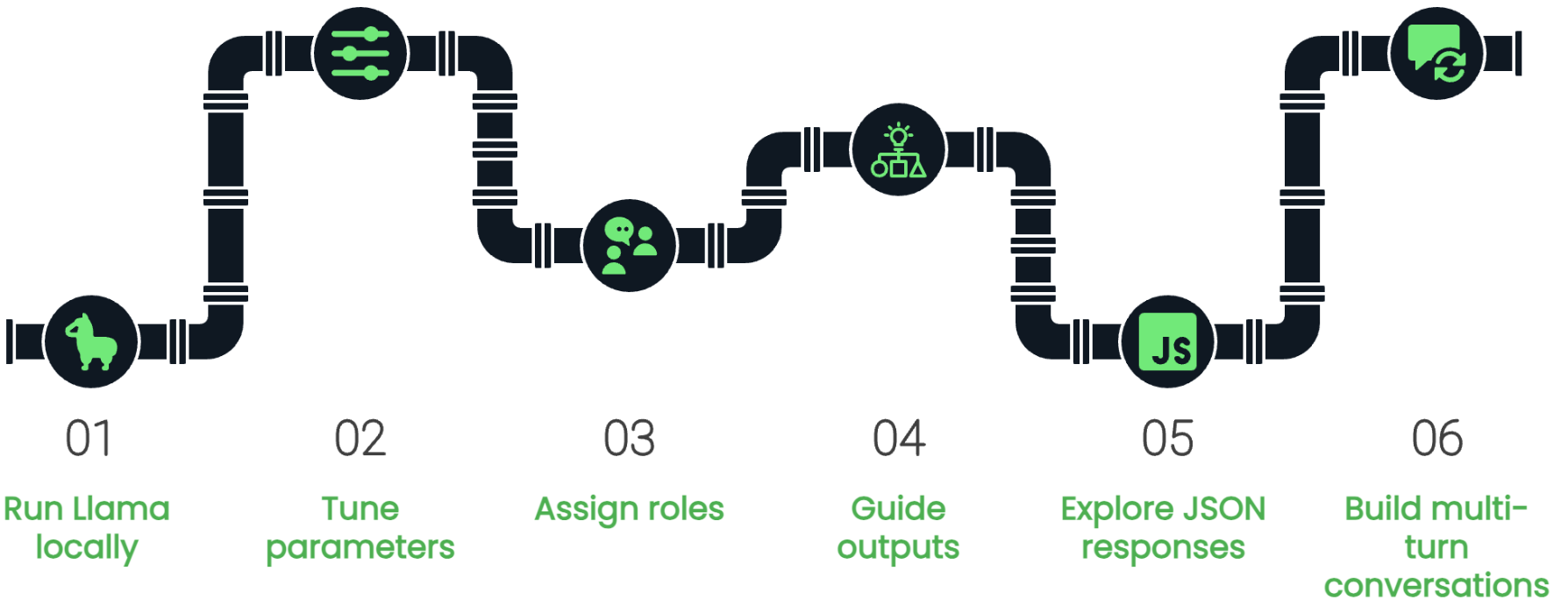

from llama_cpp import Llama

llm = Llama(model_path = "path/to/model.gguf")

Zur Erinnerung

$$

- Parameter

temperature,top_k,top_p

Zur Erinnerung

message_list = [{"role": "system", "content": system_message},

{"role": "user", "content": user_message}]

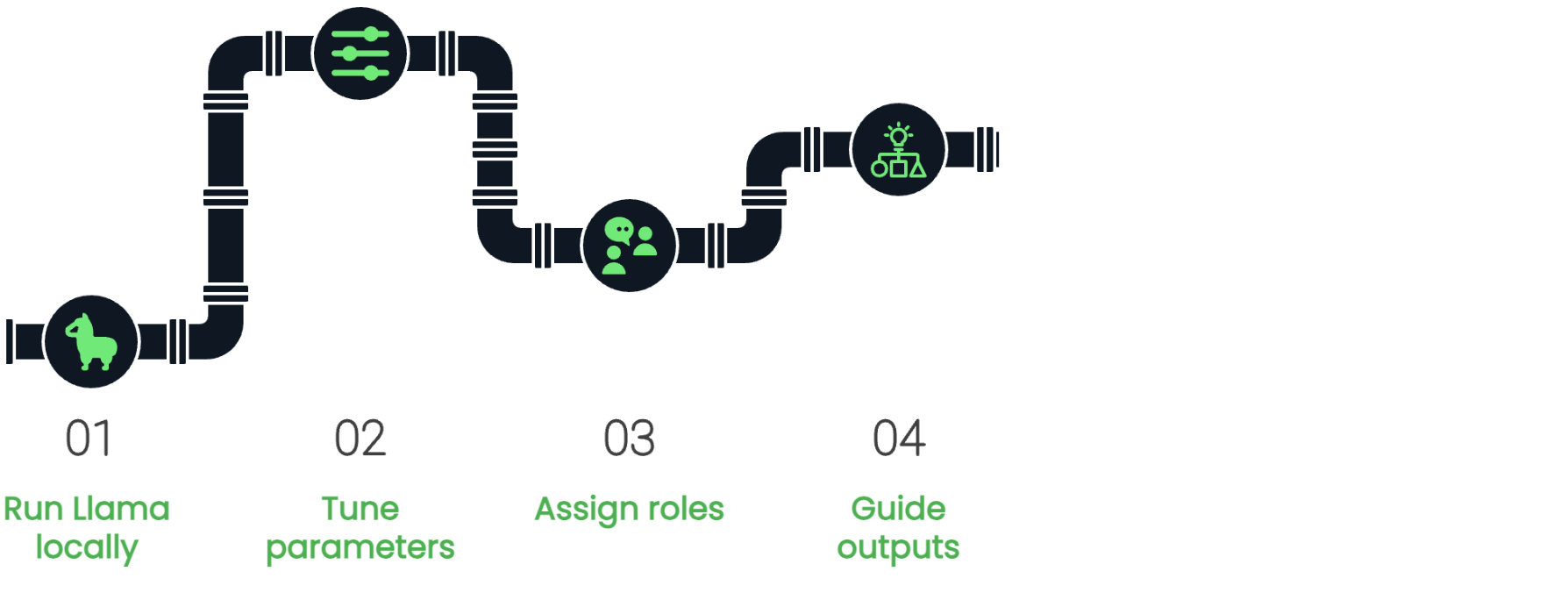

Zur Erinnerung

- Präzise Prompts

stop-Wörter- Zero-shot/Few-shot-Prompting

Zur Erinnerung

$$

$$

response_format = {"type": "json_object"}

Zur Erinnerung

Conversation-Klasse- Methode

.create_completion()

Wie geht’s weiter?

Danke!

Arbeiten mit Llama 3