Evaluación y visualización de modelos

Machine Learning de extremo a extremo

Joshua Stapleton

Machine Learning Engineer

Accuracy

- Métricas de accuracy adecuadas son clave para evaluar bien

- Es fácil malinterpretar u ocultar resultados

Accuracy estándar:

- Accuracy = nº aciertos / nº predicciones

- Puede no ser útil

Ejemplo:

# achieves ~99% accuracy for imbalanced dataset of 99 positive and 1 negative

for patient_datapoint in heart_disease_dataset:

model.prediction(patient_datapoint) = 'positive'

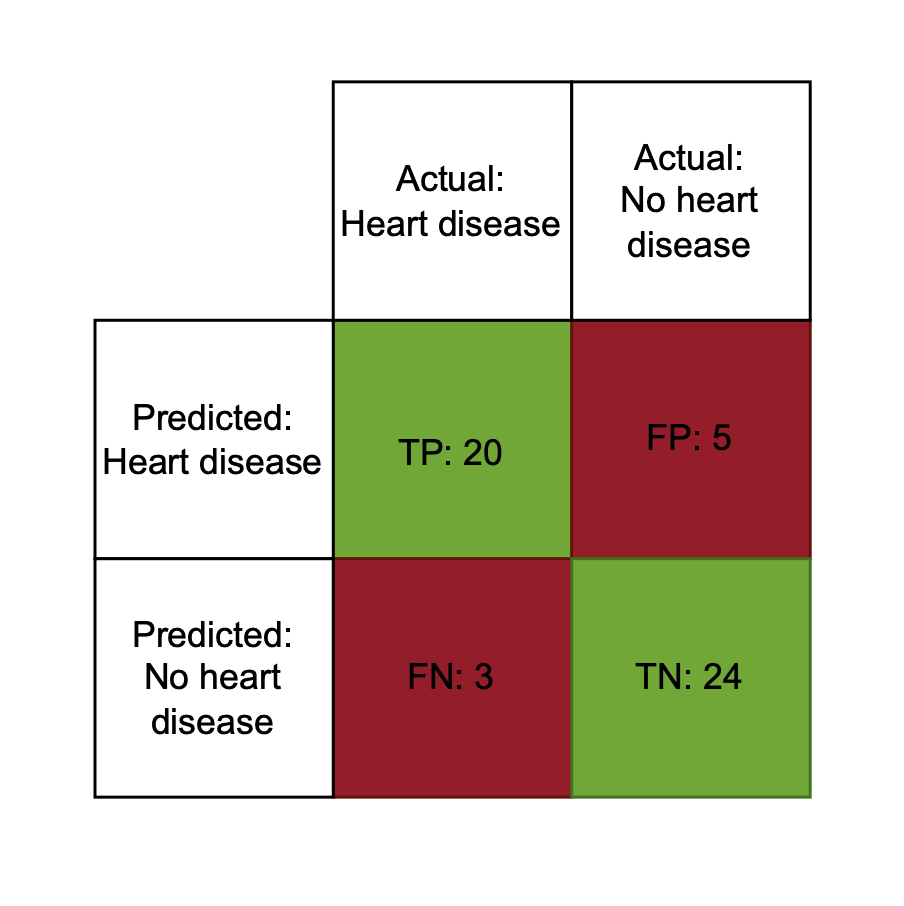

Matriz de confusión

Verdaderos positivos (TP)

- Predicción = realidad = positivo

- Predijo enfermedad cardiaca y el paciente la tenía

Falsos positivos (FP)

- Predicción = positivo, realidad = negativo

- Predijo enfermedad cardiaca y el paciente no la tenía

Falsos negativos (FN)

- Predicción = negativo, realidad = positivo

- Predijo sin enfermedad cardiaca y el paciente sí la tenía

Verdaderos negativos (TN)

- Predicción = realidad = negativo

- Predijo sin enfermedad cardiaca y el paciente no la tenía

Balanced accuracy

- Mejor métrica que el accuracy simple para la mayoría de binarios

- Media ponderada entre ambas clases

- Balanced accuracy = (TP + TN) / 2

from sklearn.metrics import balanced_accuracy_score

# Assume y_test is the true labels and y_pred are the predicted labels

y_pred = model.predict(X_test)

bal_accuracy = balanced_accuracy_score(y_test, y_pred)

print(f"Balanced Accuracy: {bal_accuracy:.2f}")

Balanced Accuracy: 0.85

Uso de la matriz de confusión

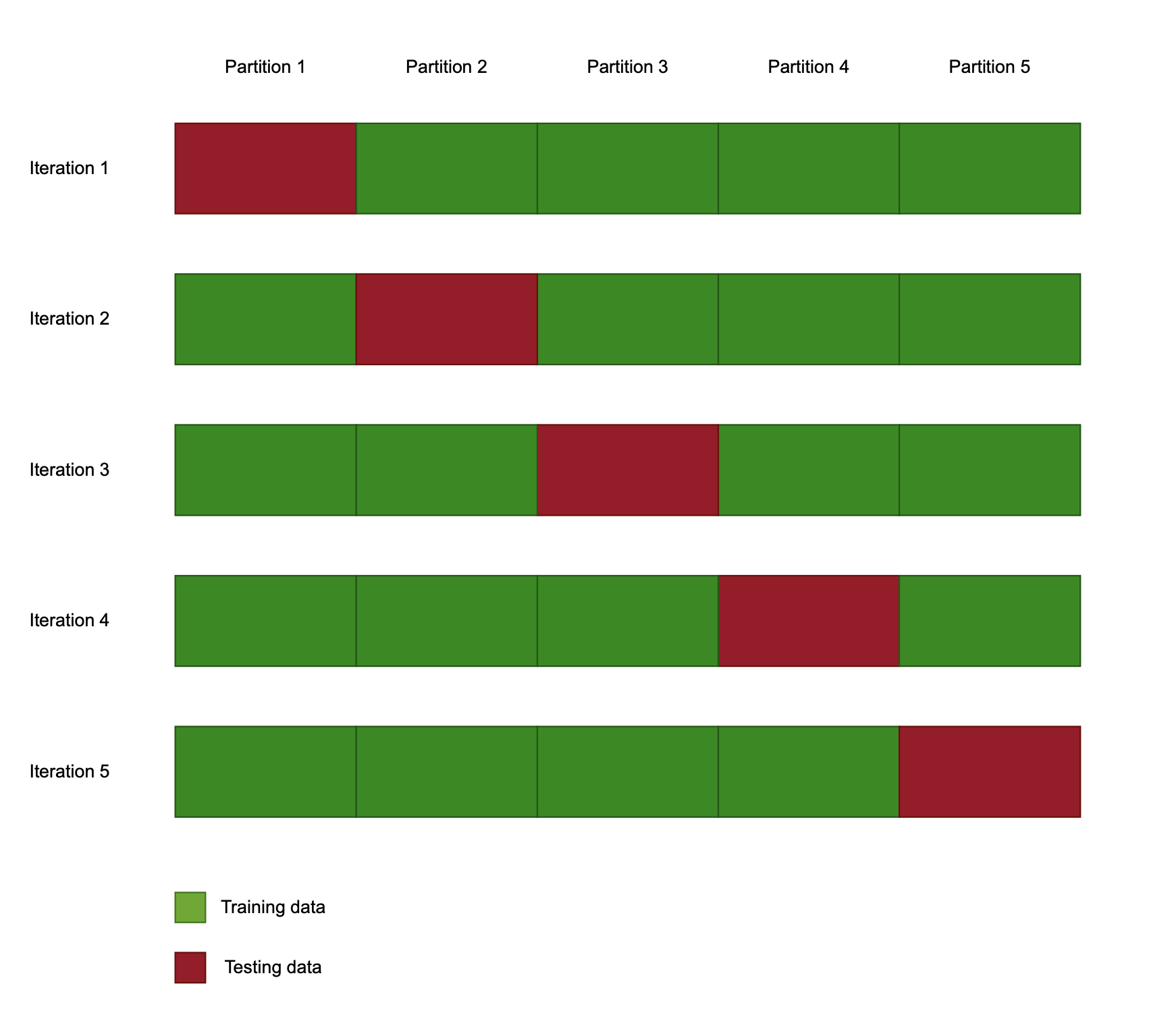

Validación cruzada

Validación cruzada

- Procedimiento de remuestreo

- Asegura resultados robustos

Validación cruzada k-fold

- Parámetro 'k' = nº de particiones del dataset

- Re-muestrea un nuevo train/test en cada ejecución

Uso de la validación cruzada

- Implementación sencilla de k-fold con sklearn

- Métrica independiente del modelo

Uso:

from sklearn.model_selection import cross_val_score, KFold # split the data into 10 equal parts kfold = KFold(n_splits=5, shuffle=True, random_state=42)# get the cross validation accuracy for a given model cv_results = cross_val_score(model, heart_disease_X, heart_disease_y, cv=kfold, scoring='balanced_accuracy')

Ajuste de hiperparámetros

Hiperparámetro:

- Parámetro global del modelo (no cambia al entrenar)

- Ajusta para mejorar el rendimiento

# Hyperparameters to test

C_values = [0.001, 0.01, 0.1, 1, 10, 100, 1000]

# Manually iterate over the hyperparameters

for C in C_values:

model = LogisticRegression(max_iter=200, C=C)

model.fit(X_train, y_train)

accuracy = cross_val_score(model, X, y, cv=kfold, scoring='balanced_accuracy')

print(f"C = {C}: Bal Acc: {accuracy.mean():.4f} (+/- {accuracy.std():.4f})")

Ejemplo de ajuste de hiperparámetros

Ejemplo de salida del ajuste de hiperparámetros:

C = 0.001: Bal Acc: 0.6200 (+/- 0.0215)

C = 0.01: Bal Acc: 0.7325 (+/- 0.0234)

C = 0.1: Bal Acc: 0.7923 (+/- 0.0202)

C = 1: Bal Acc: 0.8050 (+/- 0.0191)

C = 10: Bal Acc: 0.8034 (+/- 0.0185)

C = 100: Bal Acc: 0.8021 (+/- 0.0187)

C = 1000: Bal Acc: 0.8017 (+/- 0.0188)

¡Vamos a practicar!

Machine Learning de extremo a extremo