Métodos Monte Carlo

Reinforcement Learning con Gymnasium en Python

Fouad Trad

Machine Learning Engineer

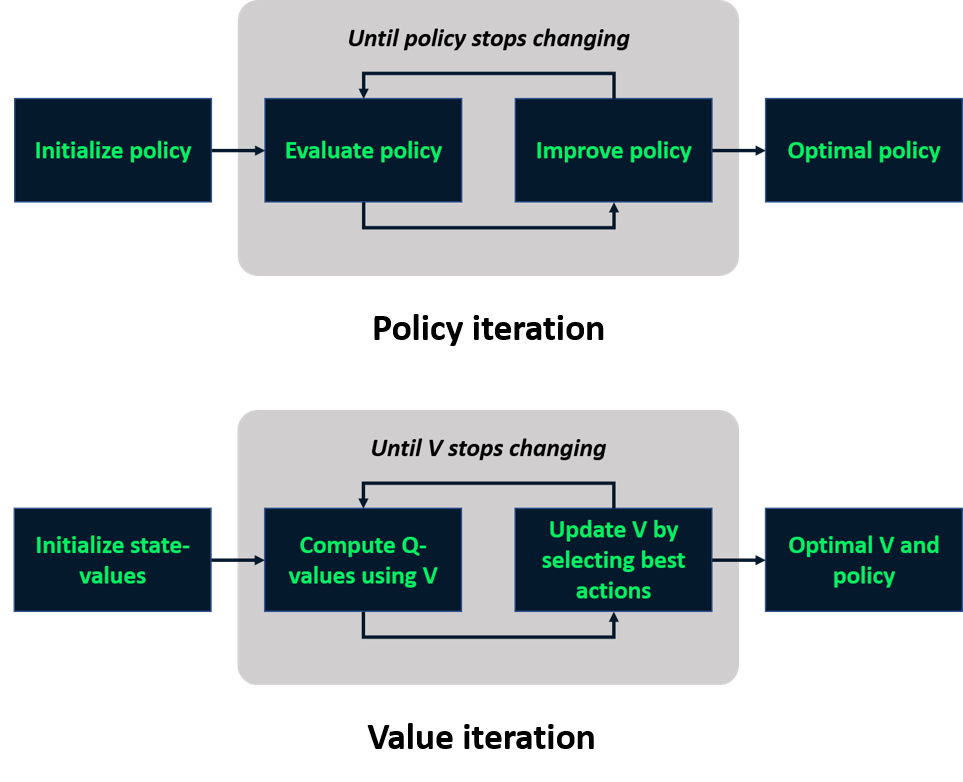

Repaso: aprendizaje con modelo

- Depende de la dinámica del entorno

- Sin interacción con el entorno

Aprendizaje sin modelo

- No depende de la dinámica del entorno

- El agente interactúa con el entorno

- Aprende la política por prueba y error

- Más adecuado para casos reales

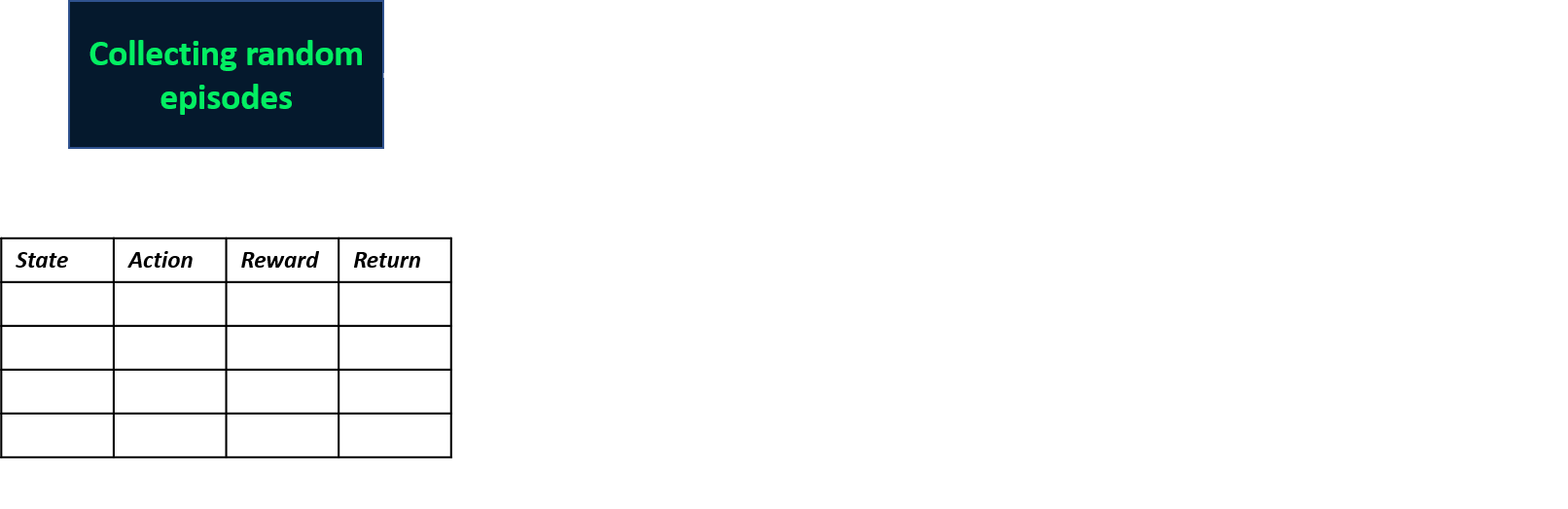

Métodos Monte Carlo

- Técnicas sin modelo

- Estiman Q a partir de episodios

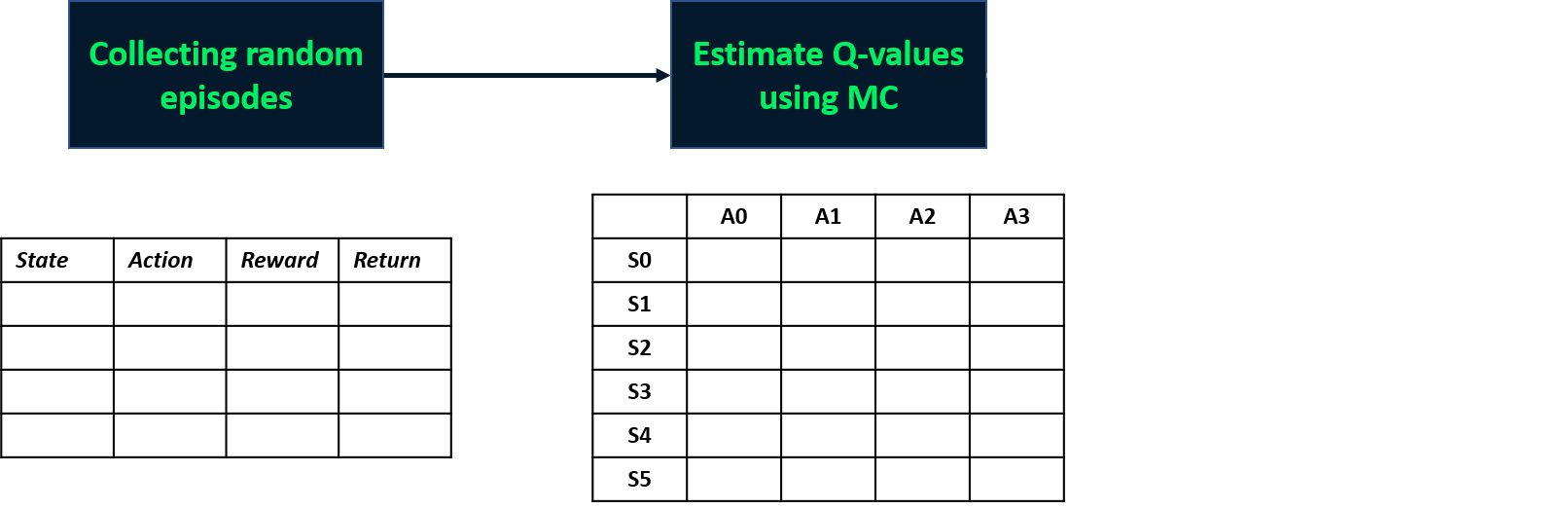

Métodos Monte Carlo

- Técnicas sin modelo

- Estiman Q a partir de episodios

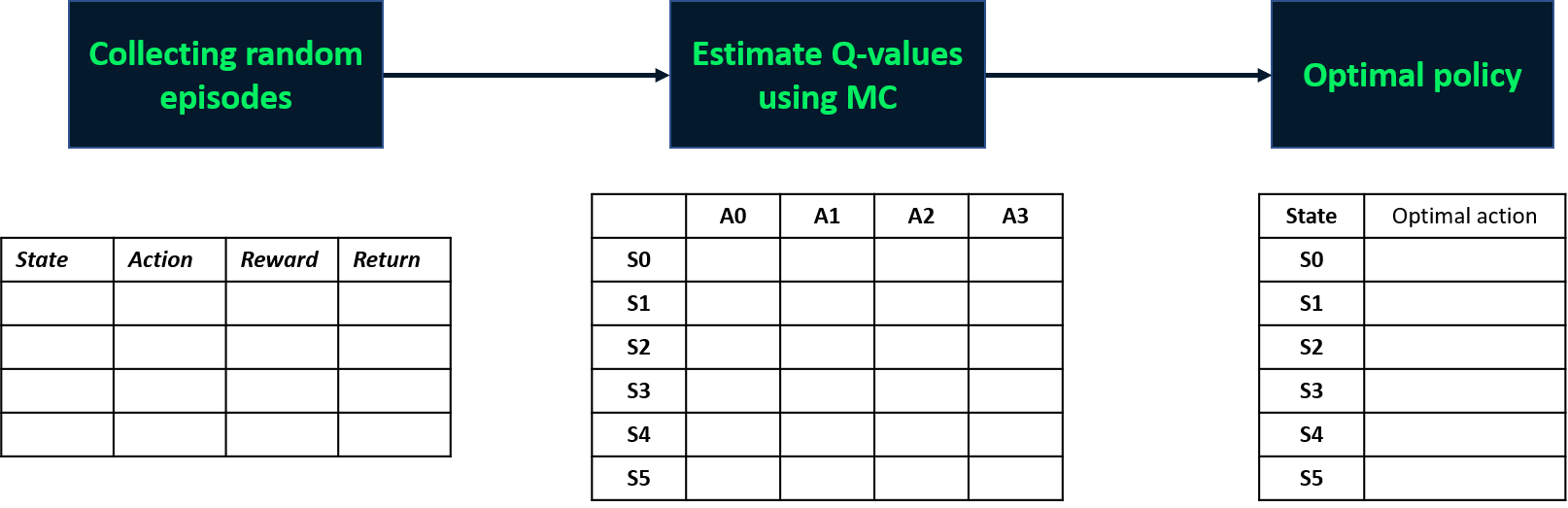

Métodos Monte Carlo

- Técnicas sin modelo

- Estiman Q a partir de episodios

- Dos métodos: first-visit, every-visit

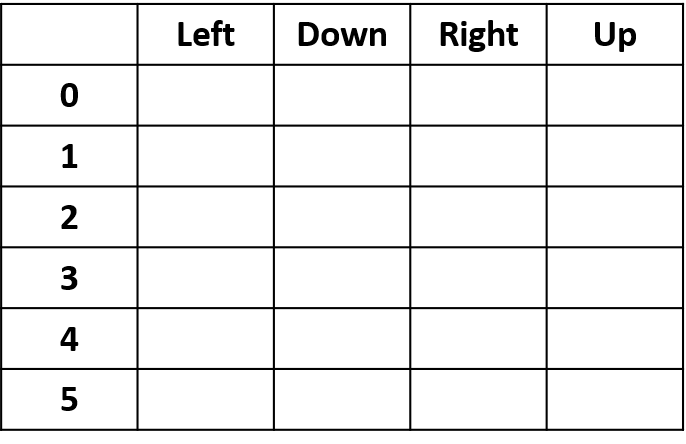

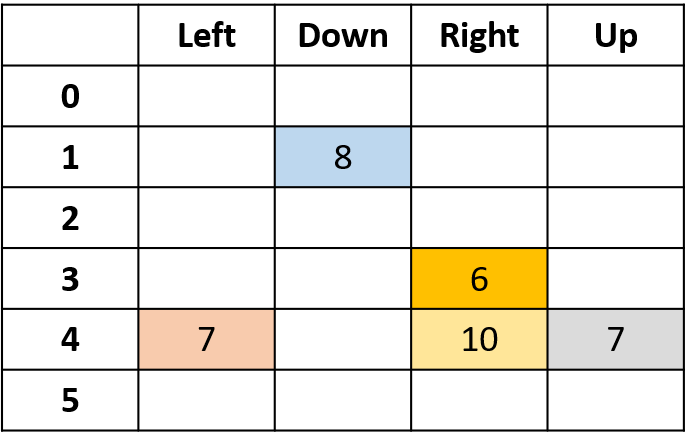

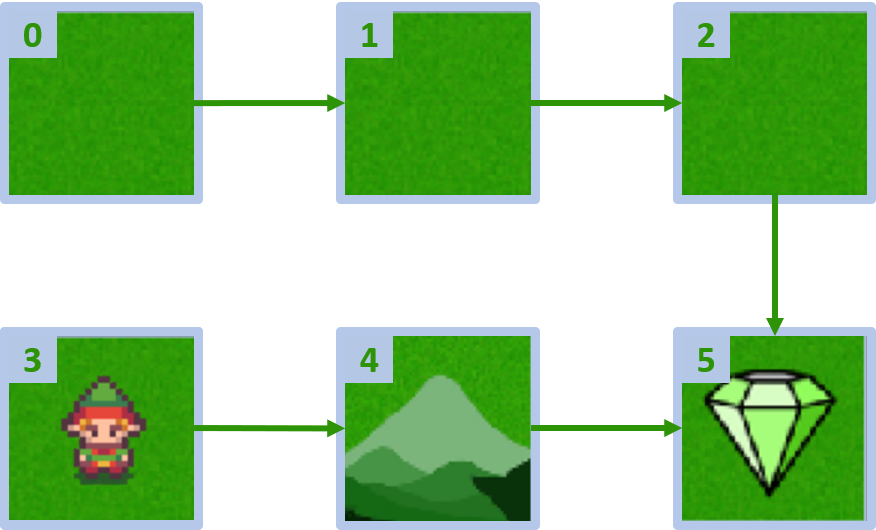

Grid world personalizado

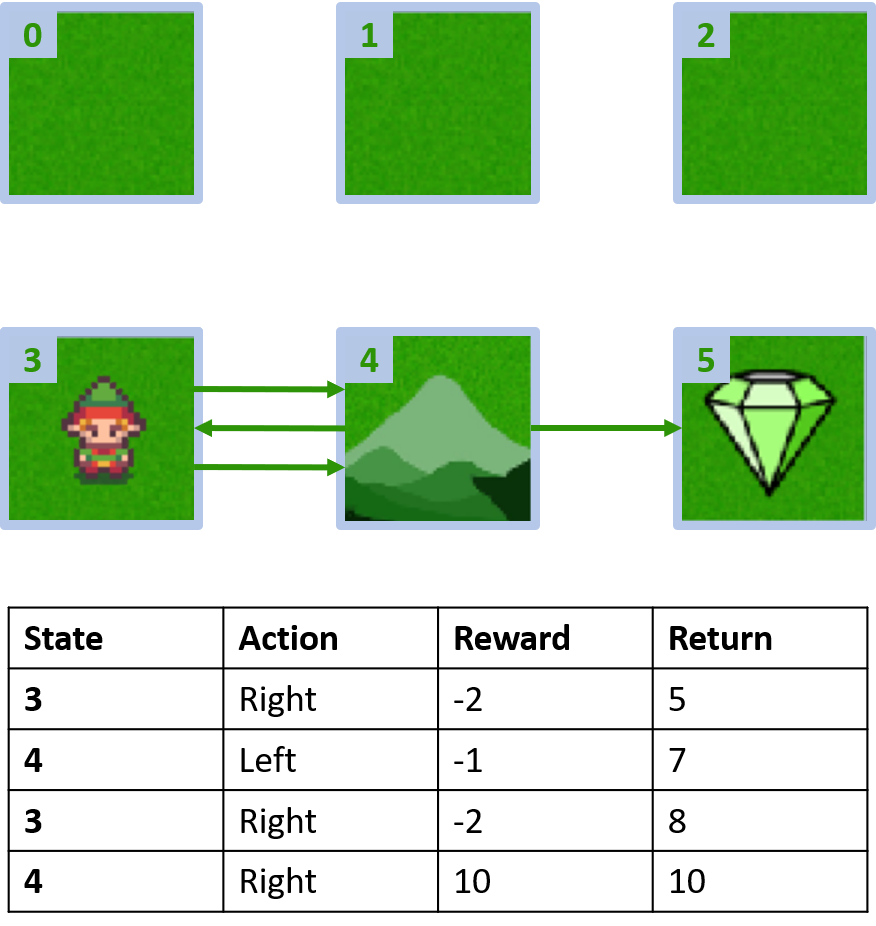

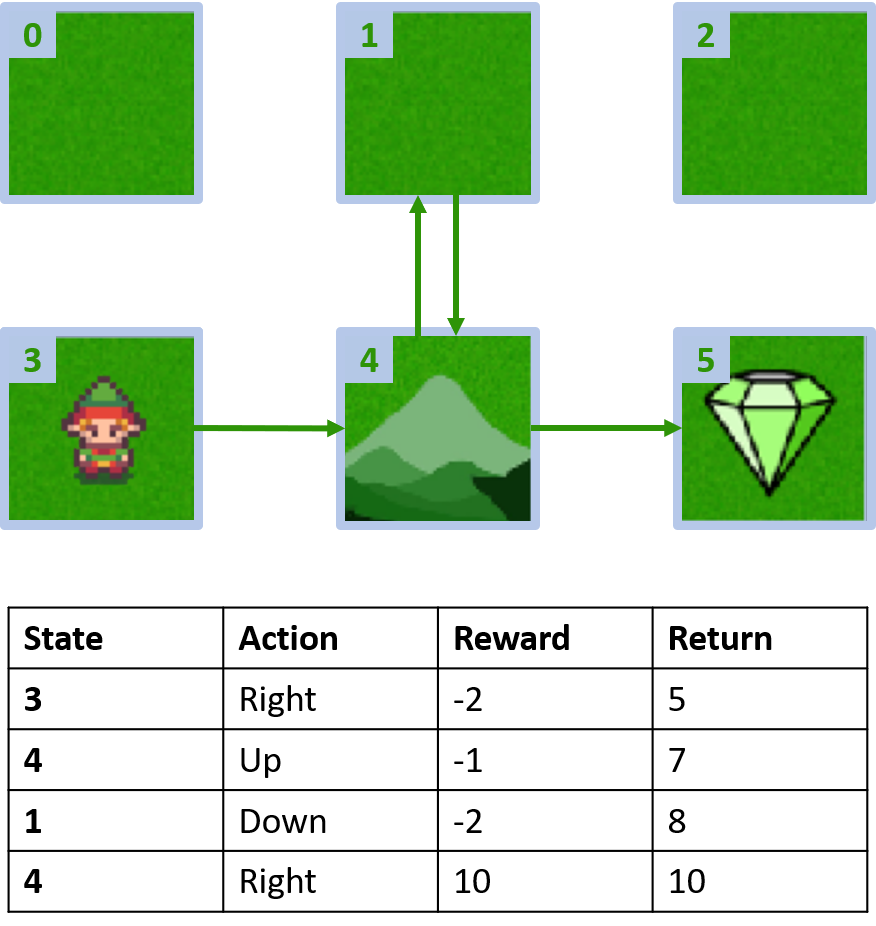

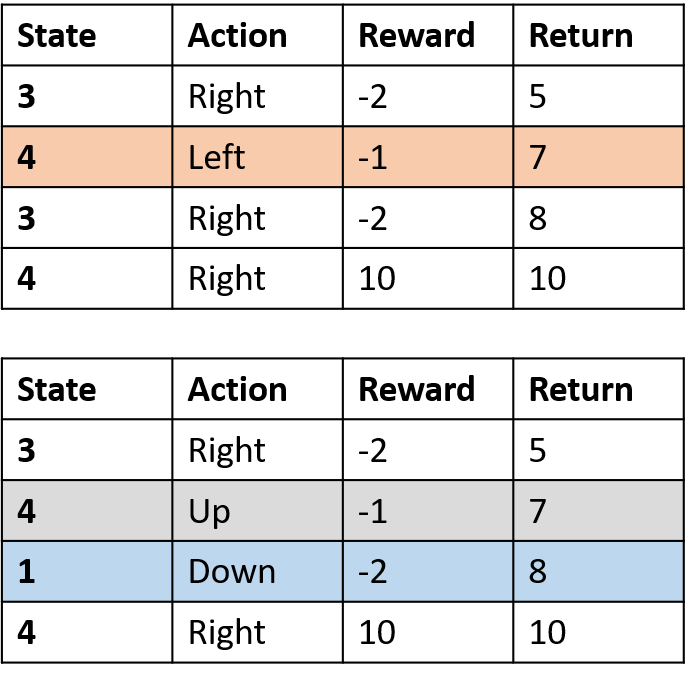

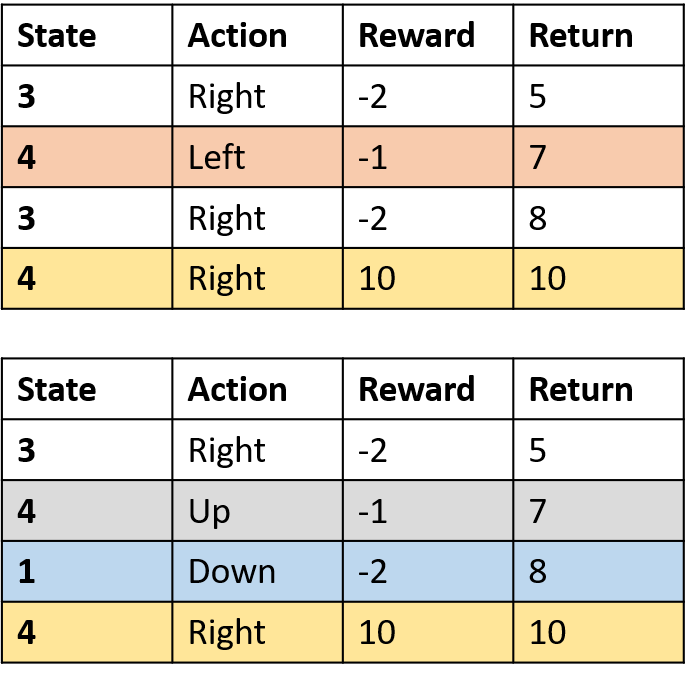

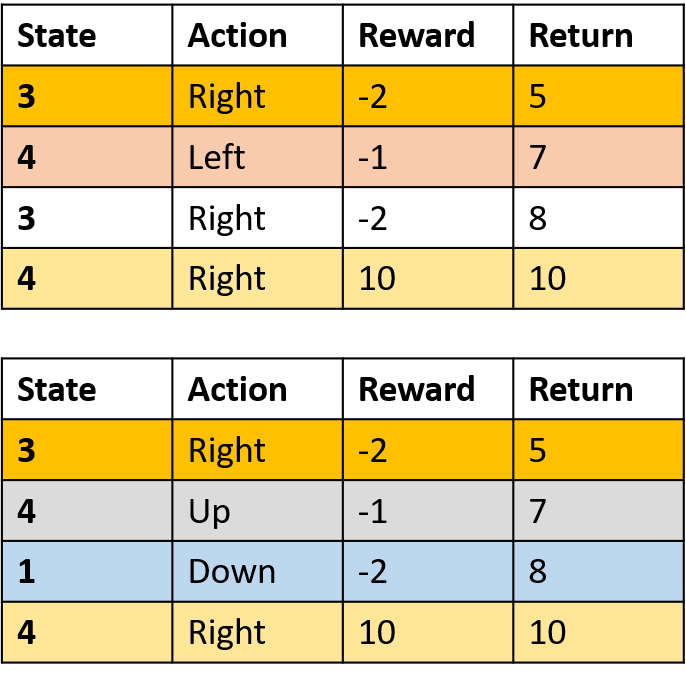

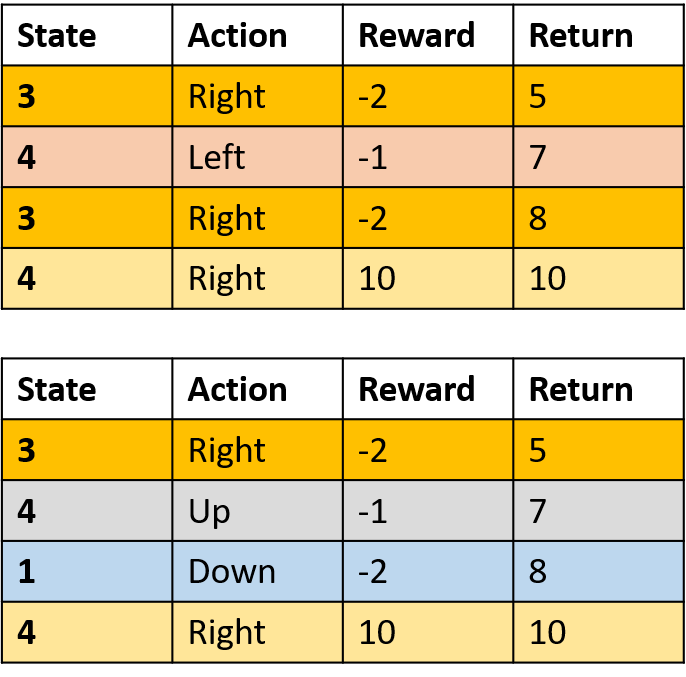

Recoger dos episodios

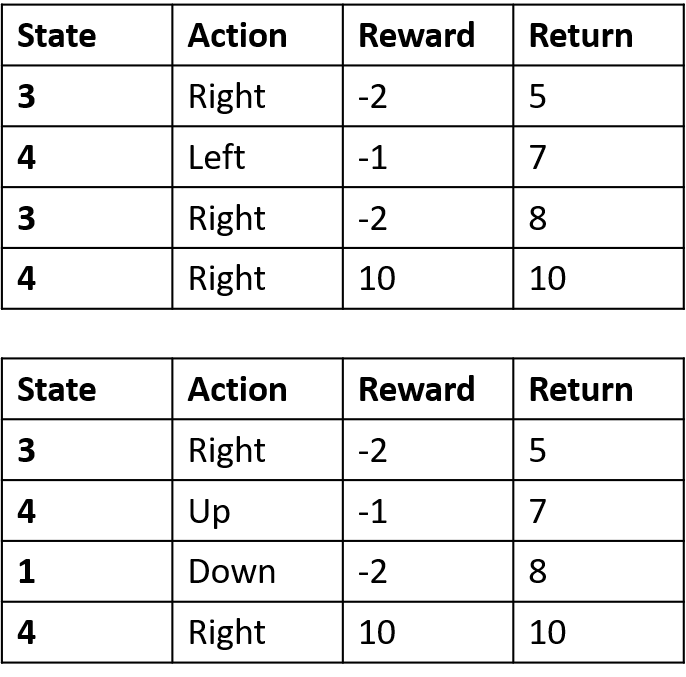

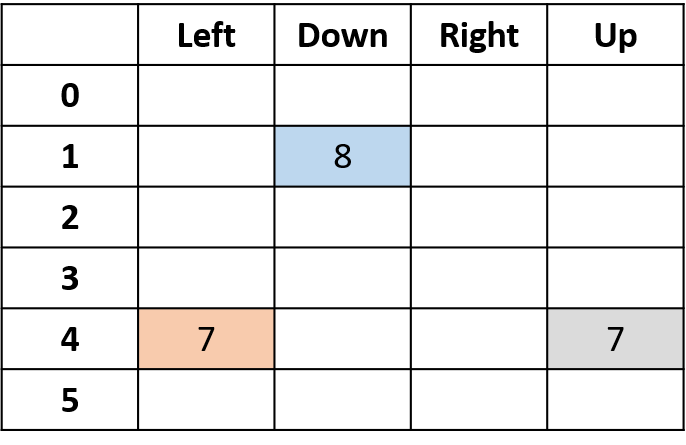

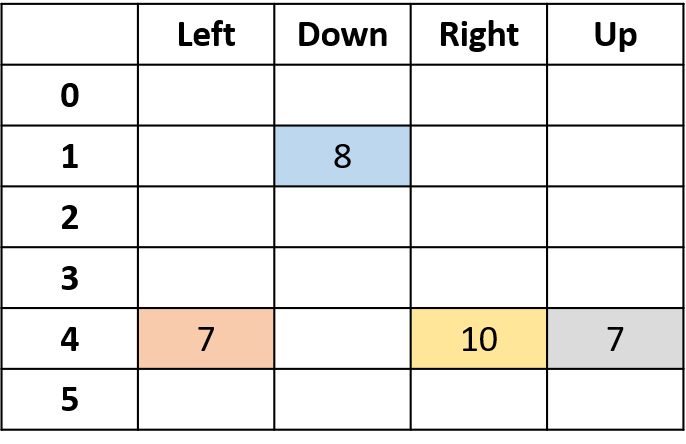

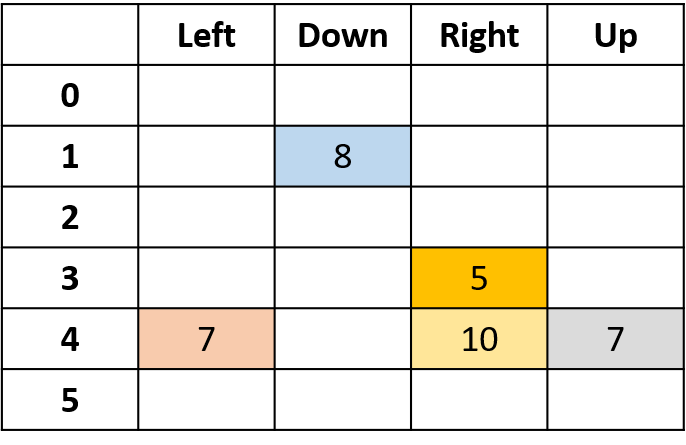

Estimación de Q-values

- Q-table: tabla de valores Q

Q(4, izquierda), Q(4, arriba) y Q(1, abajo)

- (s,a) aparece una vez -> rellena con el retorno

Q(4, derecha)

- (s,a) ocurre una vez por episodio -> promedio

Q(3, derecha) - Monte Carlo de primera visita

- Promedia la primera visita a (s,a) en cada episodio

Q(3, derecha) - Monte Carlo de cada visita

- Promedia cada visita a (s,a) en los episodios

Generar un episodio

def generate_episode(): episode = [] state, info = env.reset()terminated = False while not terminated: action = env.action_space.sample()next_state, reward, terminated, truncated, info = env.step(action)episode.append((state, action, reward)) state = next_statereturn episode

Monte Carlo de primera visita

def first_visit_mc(num_episodes): Q = np.zeros((num_states, num_actions)) returns_sum = np.zeros((num_states, num_actions)) returns_count = np.zeros((num_states, num_actions))for i in range(num_episodes): episode = generate_episode() visited_states_actions = set()for j, (state, action, reward) in enumerate(episode):if (state, action) not in visited_states:returns_sum[state, action] += sum([x[2] for x in episode[j:]])returns_count[state, action] += 1 visited_states_actions.add((state, action))nonzero_counts = returns_count != 0Q[nonzero_counts] = returns_sum[nonzero_counts] / returns_count[nonzero_counts] return Q

Monte Carlo de cada visita

def every_visit_mc(num_episodes):

Q = np.zeros((num_states, num_actions))

returns_sum = np.zeros((num_states, num_actions))

returns_count = np.zeros((num_states, num_actions))

for i in range(num_episodes):

episode = generate_episode()

for j, (state, action, reward) in enumerate(episode):

returns_sum[state, action] += sum([x[2] for x in episode[j:]])

returns_count[state, action] += 1

nonzero_counts = returns_count != 0

Q[nonzero_counts] = returns_sum[nonzero_counts] / returns_count[nonzero_counts]

return Q

Obtener la política óptima

def get_policy():

policy = {state: np.argmax(Q[state]) for state in range(num_states)}

return policy

Juntándolo todo

Q = first_visit_mc(1000)policy_first_visit = get_policy()print("First-visit policy: \n", policy_first_visit)Q = every_visit_mc(1000)policy_every_visit = get_policy()print("Every-visit policy: \n", policy_every_visit)

First-visit policy:

{0: 2, 1: 2, 2: 1,

3: 2, 4: 2, 5: 0}

Every-visit policy:

{0: 2, 1: 2, 2: 1,

3: 2, 4: 2, 5: 0}

¡Vamos a practicar!

Reinforcement Learning con Gymnasium en Python