Parabéns!

Trabalhando com Llama 3

Imtihan Ahmed

Machine Learning Engineer

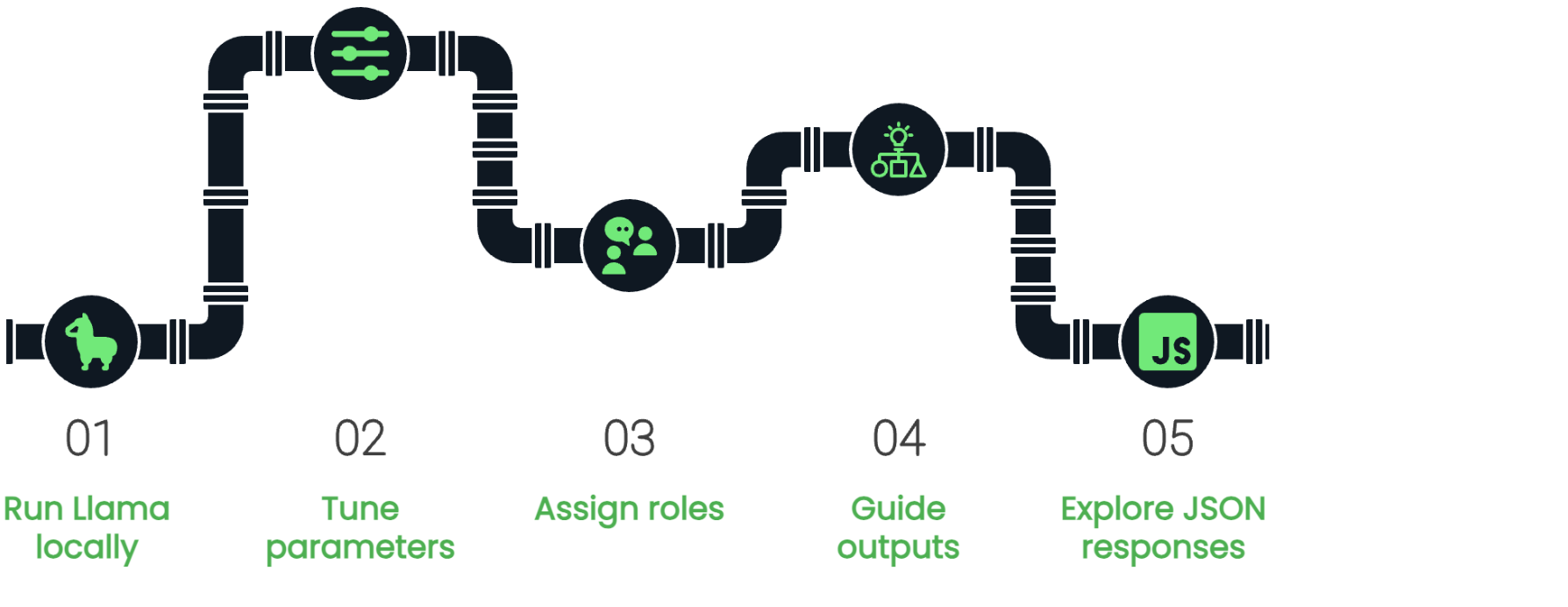

Vamos relembrar

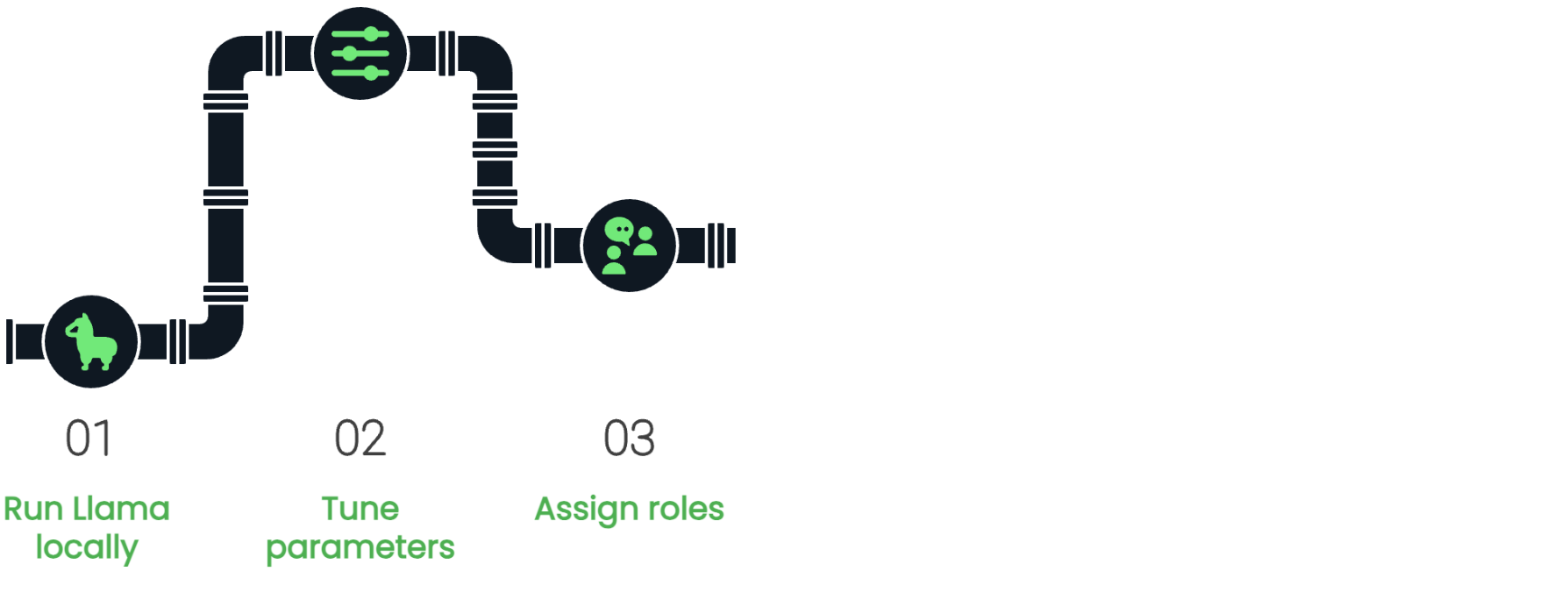

from llama_cpp import Llama

llm = Llama(model_path = "path/to/model.gguf")

Vamos relembrar

$$

- Parâmetros

temperature,top_k,top_p

Vamos relembrar

message_list = [{"role": "system", "content": system_message},

{"role": "user", "content": user_message}]

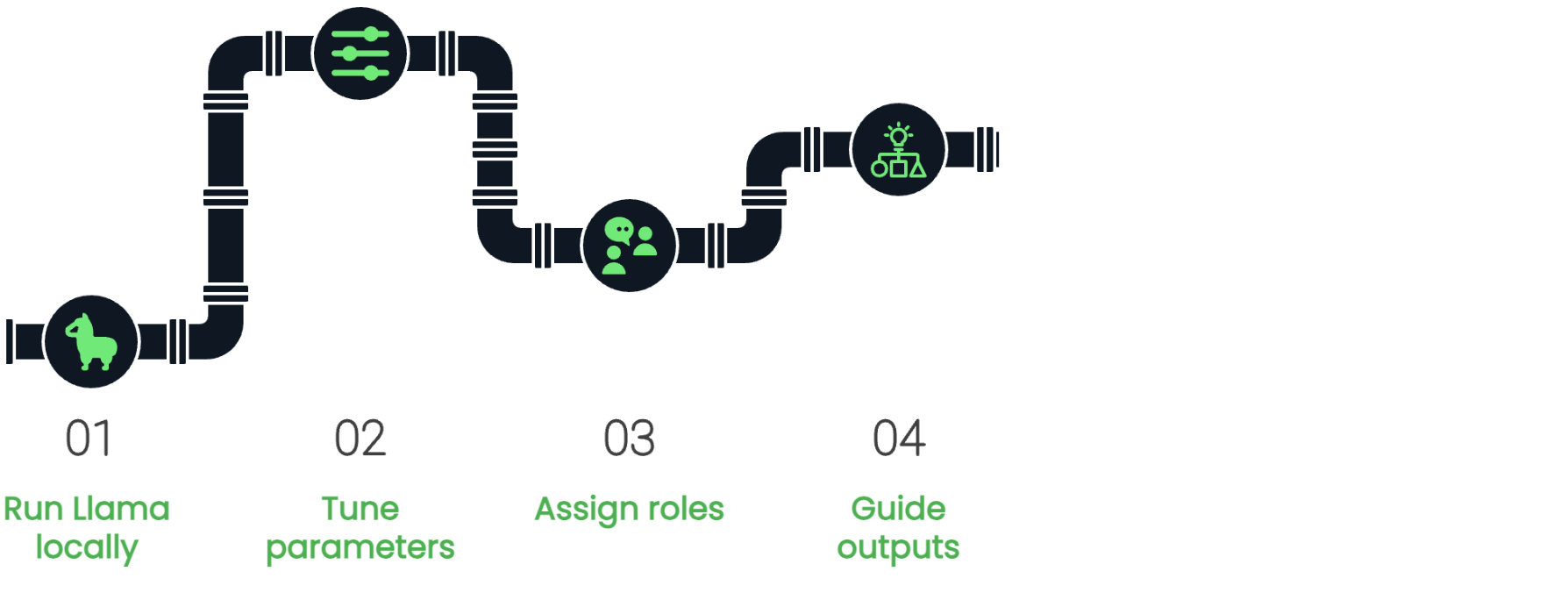

Vamos relembrar

- Prompts precisos

- Palavras de

stop - Zero-shot/Few-shot prompting

Vamos relembrar

$$

$$

response_format = {"type": "json_object"}

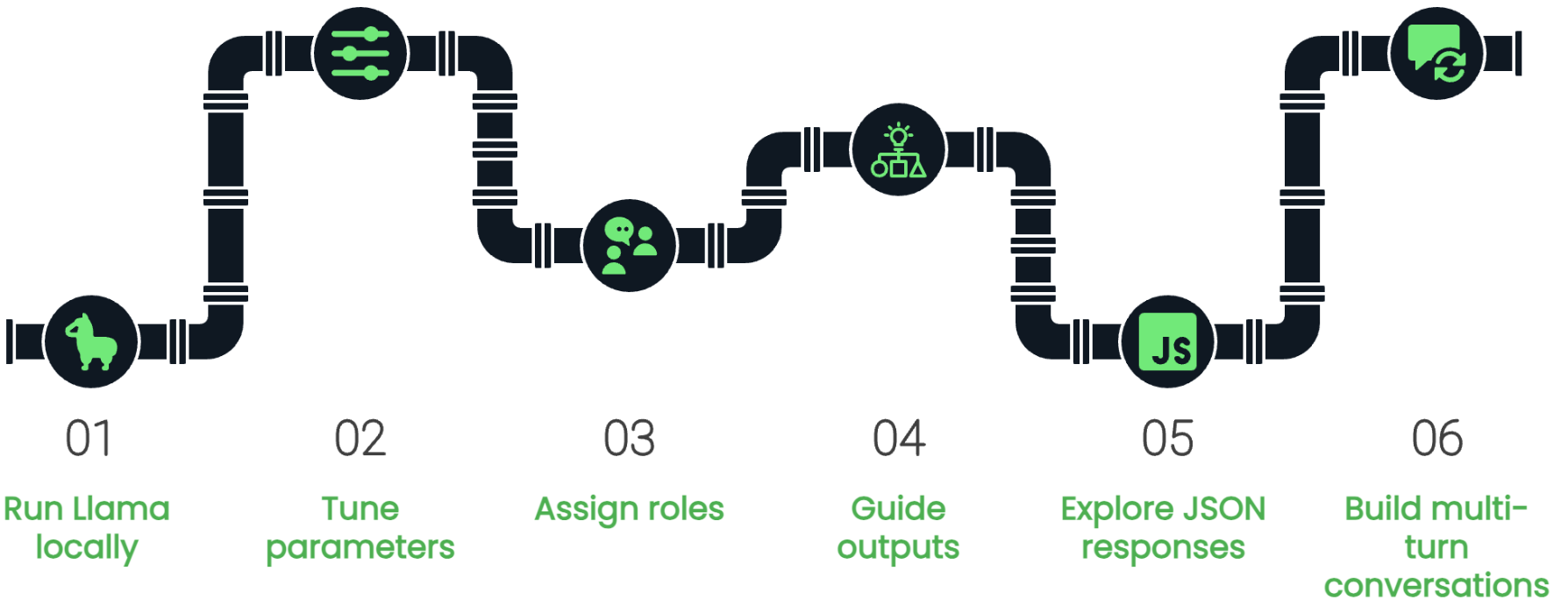

Vamos relembrar

- Classe

Conversation - Método

.create_completion()

O que vem a seguir?

Obrigado!

Trabalhando com Llama 3