Trainingslogica implementeren

Schaalbare AI-modellen met PyTorch Lightning

Sergiy Tkachuk

Director, GenAI Productivity

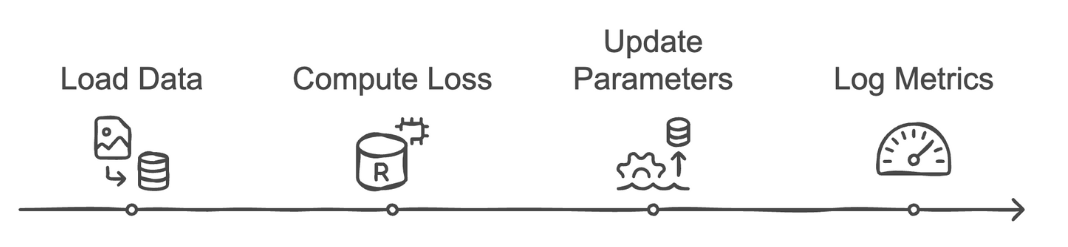

De training_step definiëren

- Verwerk batch met input en labels

- Bereken voorspellingen met de forward pass

- Bereken cross-entropy-verlies voor classificatie

- Log trainingsverlies voor monitoring

def training_step(self, batch, batch_idx): x, y = batchy_hat = self(x)loss = cross_entropy(y_hat, y)self.log("train_loss", loss) return loss

Optimizers configureren

- Kies een passende optimizer voor updates

- Koppel modelparameters voor gradiënten

- Stel een geschikte learning rate in voor convergentie

- Retourneer de optimizer voor Lightning-integratie

def configure_optimizers(self):

optimizer = torch.optim.Adam(self.parameters(), lr=1e-3)

return optimizer

Trainen met Lightning Trainer

- Integreer trainingslogica met Lightning Trainer

- Beheer trainingslussen en epochs automatisch

- Monitor prestatiemetingen in real time

trainer.fit en trainer.validate gebruiken

$$

- Start training met trainer.fit

- Valideer het model met trainer.validate

$$

trainer.fit(model, train_dataloader)trainer.validate(model, val_dataloader)

- Automatiseer trainings- en validatiecycli

- Monitor metrics in beide fases

Voorbeeld: volledige trainingslogica

$$

- Maak een eigen LightningModule met een classifier

- Implementeer training_step om verlies te berekenen en te loggen

- Configureer optimizers om modelparameters te updaten

- Train en valideer het model

class LightClassifier(pl.LightningModule): def __init__(self): super().__init__() self.layer=torch.nn.Linear(28 * 28, 10) def forward(self, x): return self.layer(x.view(x.size(0), -1))def training_step(self, batch, batch_idx): ...def configure_optimizers(self): params=self.parameters() optimizer=torch.optim.Adam(params,lr=1e-3) return optimizermodel = LightClassifier() # Define classifier model trainer = Trainer(max_epochs=5) # Define trainer trainer.fit(model, train_dataloader) trainer.validate(model, val_dataloader)

Toepassingen in de industrie

Waarom is trainingslogica belangrijk?

- Zorgt voor nauwkeurige verliesmeting voor kwaliteitsbewaking

- Optimaliseert pipelines voor schaalbare deployment

Praktijkvoorbeelden:

- Betere beeldanalyse in medische diagnostiek

- Ondersteunt fraudedetectie in financiële diensten

Toepassingen in de industrie

Waarom is trainingslogica belangrijk?

- Zorgt voor nauwkeurige verliesmeting voor kwaliteitsbewaking

- Optimaliseert pipelines voor schaalbare deployment

Praktijkvoorbeelden:

- Betere beeldanalyse in medische diagnostiek

- Ondersteunt fraudedetectie in financiële diensten

Laten we oefenen!

Schaalbare AI-modellen met PyTorch Lightning