Clustering di documenti

Analisi di cluster in Python

Shaumik Daityari

Business Analyst

Clustering di documenti: concetti

- Pulisci i dati prima dell'elaborazione

- Determina l'importanza dei termini in un documento (nella matrice TF-IDF)

- Raggruppa la matrice TF-IDF

- Trova termini e documenti principali in ogni cluster

Pulisci e tokenizza i dati

- Converti il testo in token e pulisci i dati per l'elaborazione

from nltk.tokenize import word_tokenize import re def remove_noise(text, stop_words = []): tokens = word_tokenize(text)cleaned_tokens = [] for token in tokens: token = re.sub('[^A-Za-z0-9]+', '', token)if len(token) > 1 and token.lower() not in stop_words: # Get lowercase cleaned_tokens.append(token.lower()) return cleaned_tokensremove_noise("It is lovely weather we are having. I hope the weather continues.")

['lovely', 'weather', 'hope', 'weather', 'continues']

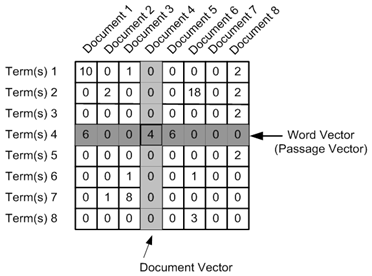

TF-IDF (Term Frequency - Inverse Document Frequency)

- Misura pesata: valuta quanto è importante una parola in un documento di una raccolta

from sklearn.feature_extraction.text import TfidfVectorizertfidf_vectorizer = TfidfVectorizer(max_df=0.8, max_features=50, min_df=0.2, tokenizer=remove_noise)tfidf_matrix = tfidf_vectorizer.fit_transform(data)

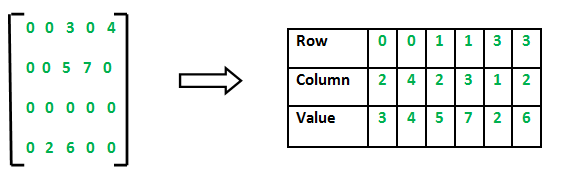

Clustering con matrice sparsa

kmeans()in SciPy non supporta matrici sparse- Usa

.todense()per convertirla in matrice densa

cluster_centers, distortion = kmeans(tfidf_matrix.todense(), num_clusters)

Termini top per cluster

- Centroidi: liste di dimensione pari al numero di termini

- Ogni valore nel centroide indica l'importanza

- Crea un dizionario e stampa i termini principali

terms = tfidf_vectorizer.get_feature_names_out() for i in range(num_clusters): center_terms = dict(zip(terms, list(cluster_centers[i])))sorted_terms = sorted(center_terms, key=center_terms.get, reverse=True)print(sorted_terms[:3])

['room', 'hotel', 'staff']

['bad', 'location', 'breakfast']

Altre considerazioni

- Gestisci hyperlink, emoticon, ecc.

- Normalizza le parole (run, ran, running -> run)

.todense()può non funzionare su dataset grandi

Prossimo: esercizi!

Analisi di cluster in Python