Preprocessare i dati per il fine-tuning

Fine-tuning con Llama 3

Francesca Donadoni

Curriculum Manager, DataCamp

Usare i dataset per il fine-tuning

La qualità dei dati è fondamentale

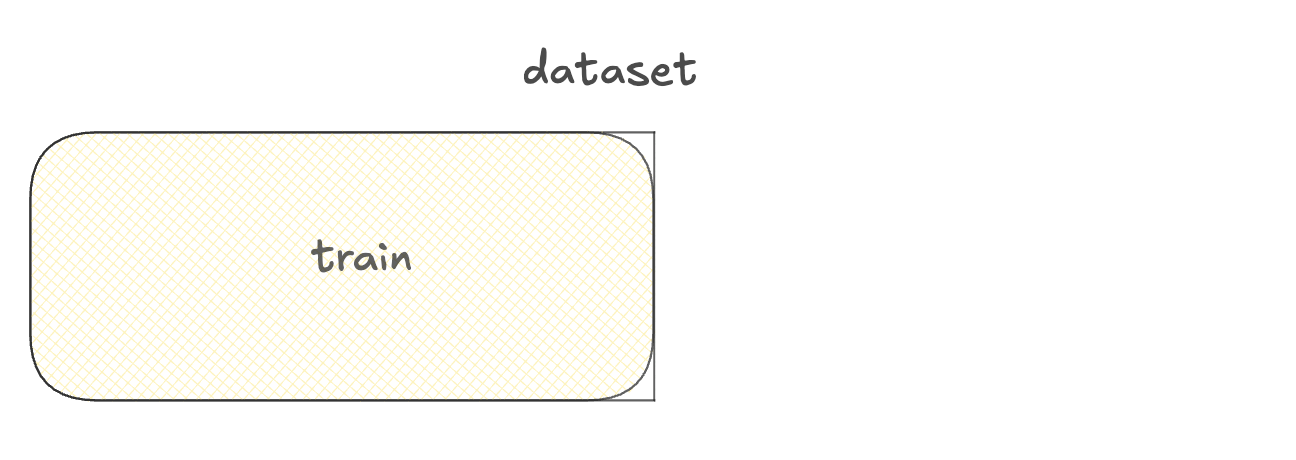

Training set:

- Per addestrare il modello

- Gran parte dei dati

Usare i dataset per il fine-tuning

La qualità dei dati è fondamentale

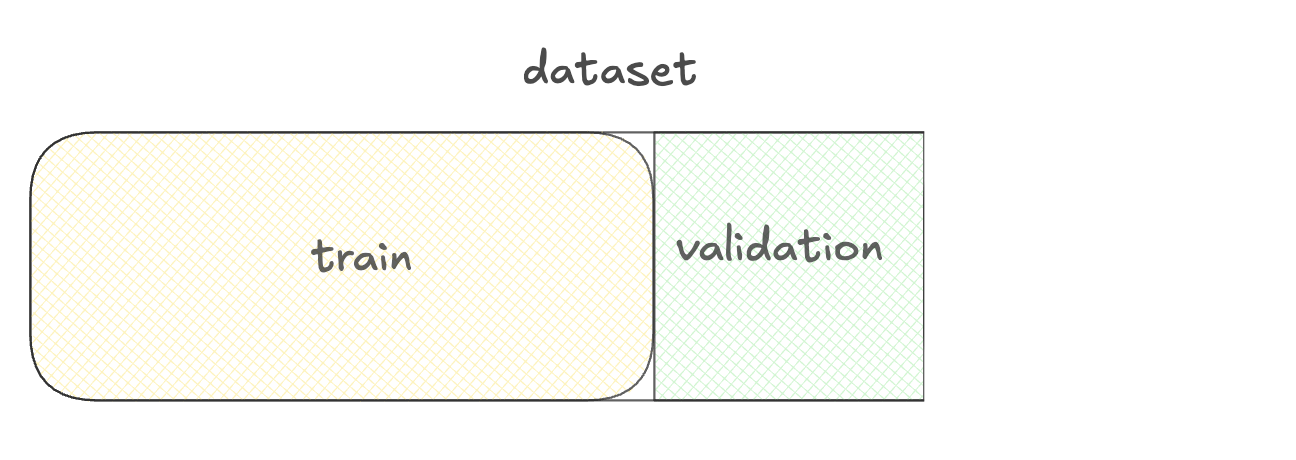

Training set:

- Per addestrare il modello

- Gran parte dei dati

- Validation set:

- Per selezionare la versione migliore del modello

Usare i dataset per il fine-tuning

La qualità dei dati è fondamentale

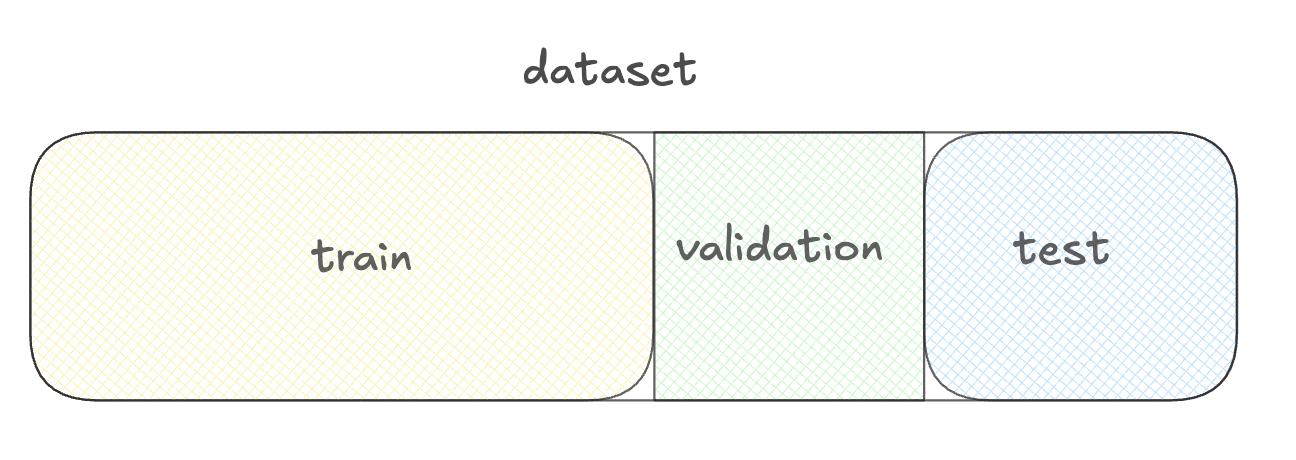

Training set:

- Per addestrare il modello

- Gran parte dei dati

- Validation set:

- Per selezionare la versione migliore del modello

- Test set:

- Per valutare le prestazioni del modello

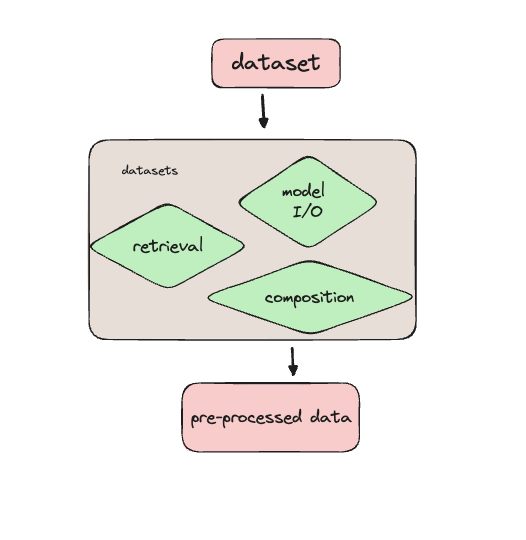

Preparare i dati con la libreria Datasets

- Libreria Datasets

- Preprocessing

- Split

- Load

- Gestione memoria

Caricare un dataset di assistenza clienti

from datasets import load_datasetds = load_dataset( 'bitext/Bitext-customer-support-llm-chatbot-training-dataset',split="train")print(ds.column_names)

['flags', 'instruction', 'category', 'intent', 'response']

Dare un'occhiata ai dati

import pprint

pprint.pprint(ds[0])

{'category': 'ORDER',

'flags': 'B',

'instruction': 'question about cancelling order {{Order Number}}',

'intent': 'cancel_order',

'response': "I've understood you have a question regarding canceling order "

"{{Order Number}}, and I'm here to provide you with the "

'information you need. Please go ahead and ask your question, and '

"I'll do my best to assist you."}

Filtrare il dataset

from datasets import load_dataset, Dataset ds = load_dataset( 'bitext/Bitext-customer-support-llm-chatbot-training-dataset', split="train")print(ds.shape)

(26872, 5)

first_thousand_points = ds[:1000]ds = Dataset.from_dict(first_thousand_points)

Preprocessare il dataset

def merge_example(row):row['conversation'] = f"Query: {row['instruction']}\nResponse: {row['response']}" return rowds = ds.map(merge_example)print(ds[0]['conversation'])

Query: question about cancelling order {{Order Number}}

Response: I've understood you have a question regarding canceling order {{Order Number}},

and I'm here to provide you with the information you need. Please go ahead and ask your

question, and I'll do my best to assist you.

Salvare il dataset preprocessato

ds.save_to_disk("preprocessed_dataset")

Saving the dataset (1/1 shards): 100%

26872/26872 [00:00<00:00, 383823.33 examples/s]

from datasets import load_from_disk

ds_preprocessed = load_from_disk("preprocessed_dataset")

Usare i dataset Hugging Face con TorchTune

- Puoi usare un dataset Hugging Face con TorchTune

- Imposta percorso e configurazioni del dataset

tune run full_finetune_single_device --config llama3/8B_full_single_device \

dataset=preprocessed_dataset dataset.split=train

Passiamo alla pratica !

Fine-tuning con Llama 3