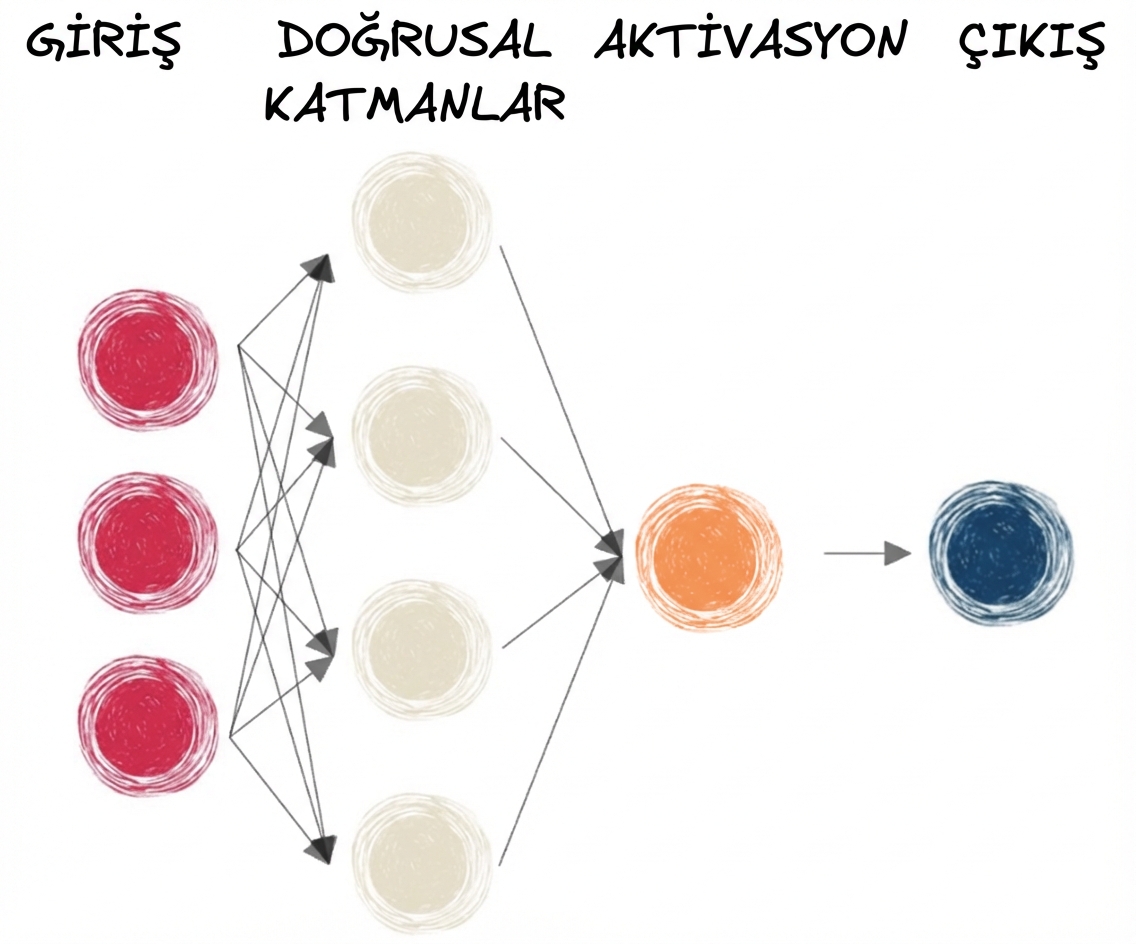

Aktivasyon fonksiyonlarını keşfetme

PyTorch ile Deep Learning'e Giriş

Jasmin Ludolf

Senior Data Science Content Developer, DataCamp

Aktivasyon fonksiyonları

$$

- Aktivasyon fonksiyonları ağa doğrusal olmayanlık katar

- İkili sınıflandırma için sigmoid

- Çok sınıflı sınıflandırma için softmax

- Doğrusal olmayanlık ile ağ daha karmaşık ilişkileri öğrenir

- "Aktivasyon öncesi" çıktı aktivasyon fonksiyonuna verilir

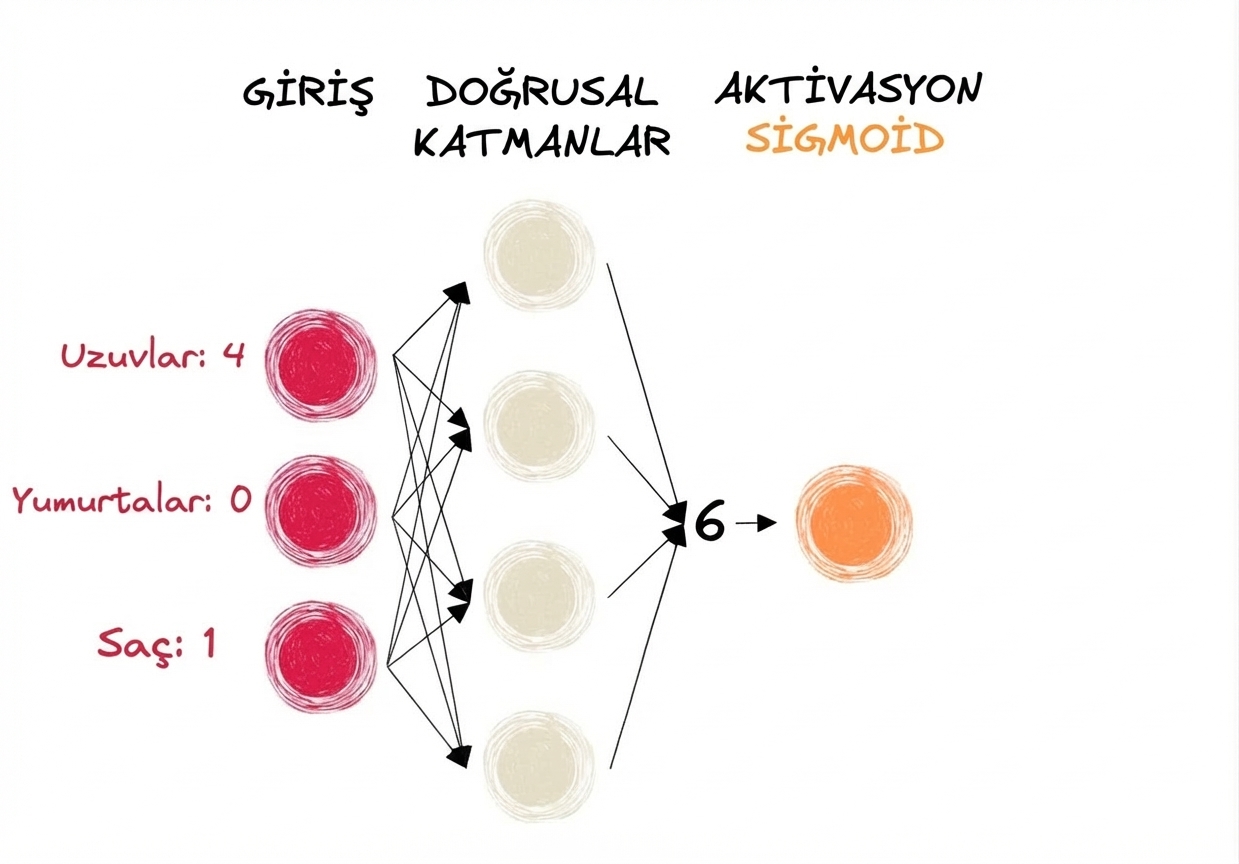

Sigmoid fonksiyonuyla tanışın

- Memeli mi değil mi?

Sigmoid fonksiyonuyla tanışın

- Memeli mi değil mi?

- Girdi:

- Uzuv: 4

- Yumurta: 0

- Kıl: 1

Sigmoid fonksiyonuyla tanışın

- Memeli mi değil mi?

- Doğrusal katmanlara çıktı: 6

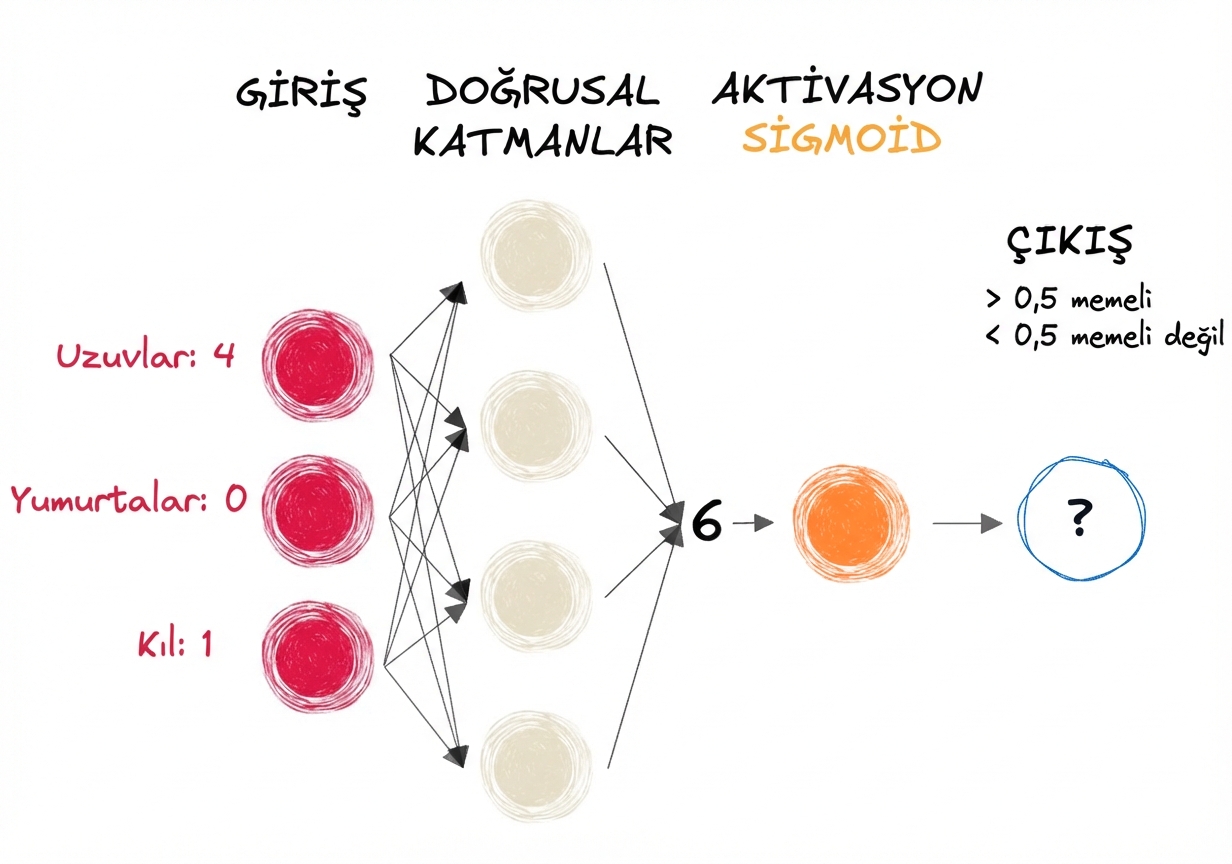

Sigmoid fonksiyonuyla tanışın

- Memeli mi değil mi?

- Aktivasyon öncesi çıktıyı (6) alıp sigmoid fonksiyonuna veririz

Sigmoid fonksiyonuyla tanışın

- Memeli mi değil mi?

- Aktivasyon öncesi çıktıyı (6) alıp sigmoid fonksiyonuna veririz

0 ile 1 arasında bir değer elde ederiz

Çıktı > 0.5 ise, sınıf etiketi = 1 (memeli)

- Çıktı <= 0.5 ise, sınıf etiketi = 0 (memeli değil)

Sigmoid fonksiyonuyla tanışın

import torch import torch.nn as nn input_tensor = torch.tensor([[6]]) sigmoid = nn.Sigmoid()output = sigmoid(input_tensor) print(output)

tensor([[0.9975]])

Son katmanda aktivasyon

model = nn.Sequential(

nn.Linear(6, 4), # First linear layer

nn.Linear(4, 1), # Second linear layer

nn.Sigmoid() # Sigmoid activation function

)

Doğrusal katmanlardan oluşan bir ağda sigmoidin son adım olması, klasik lojistik regresyona eşdeğerdir

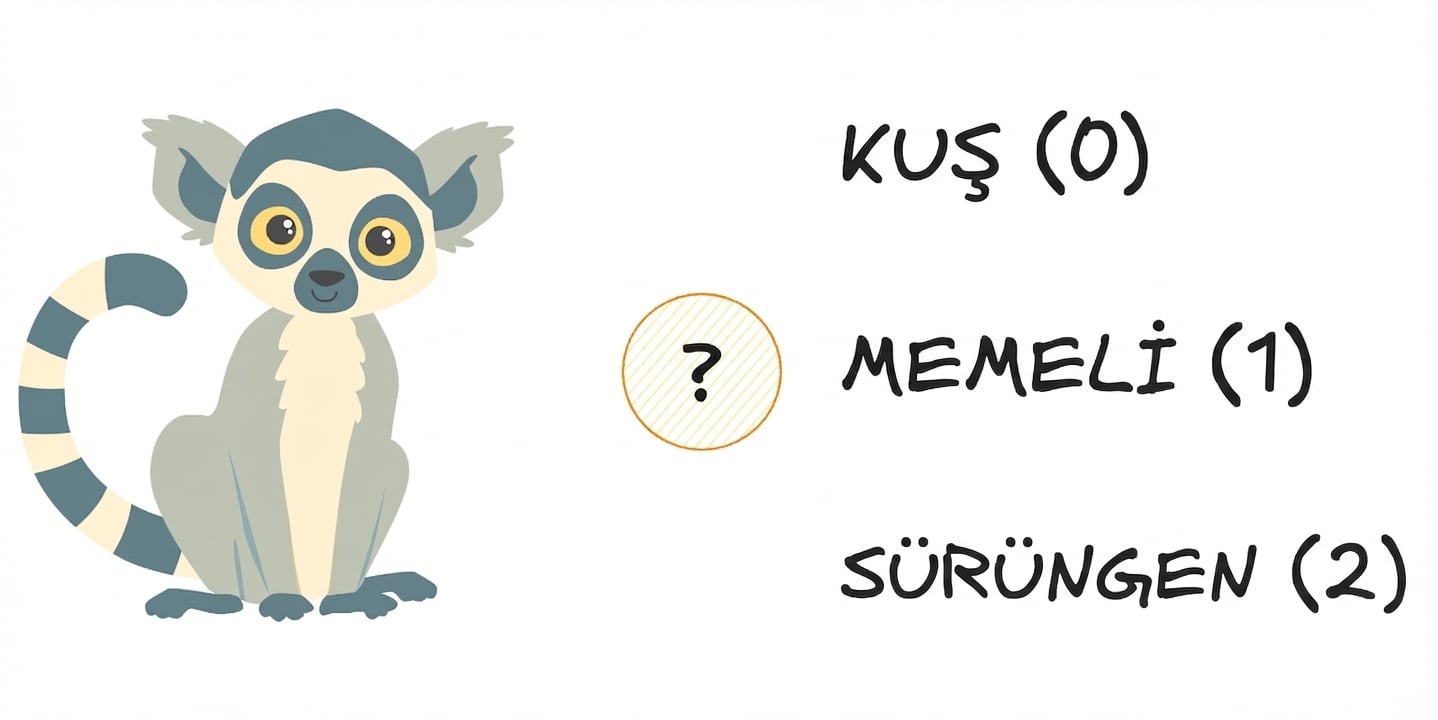

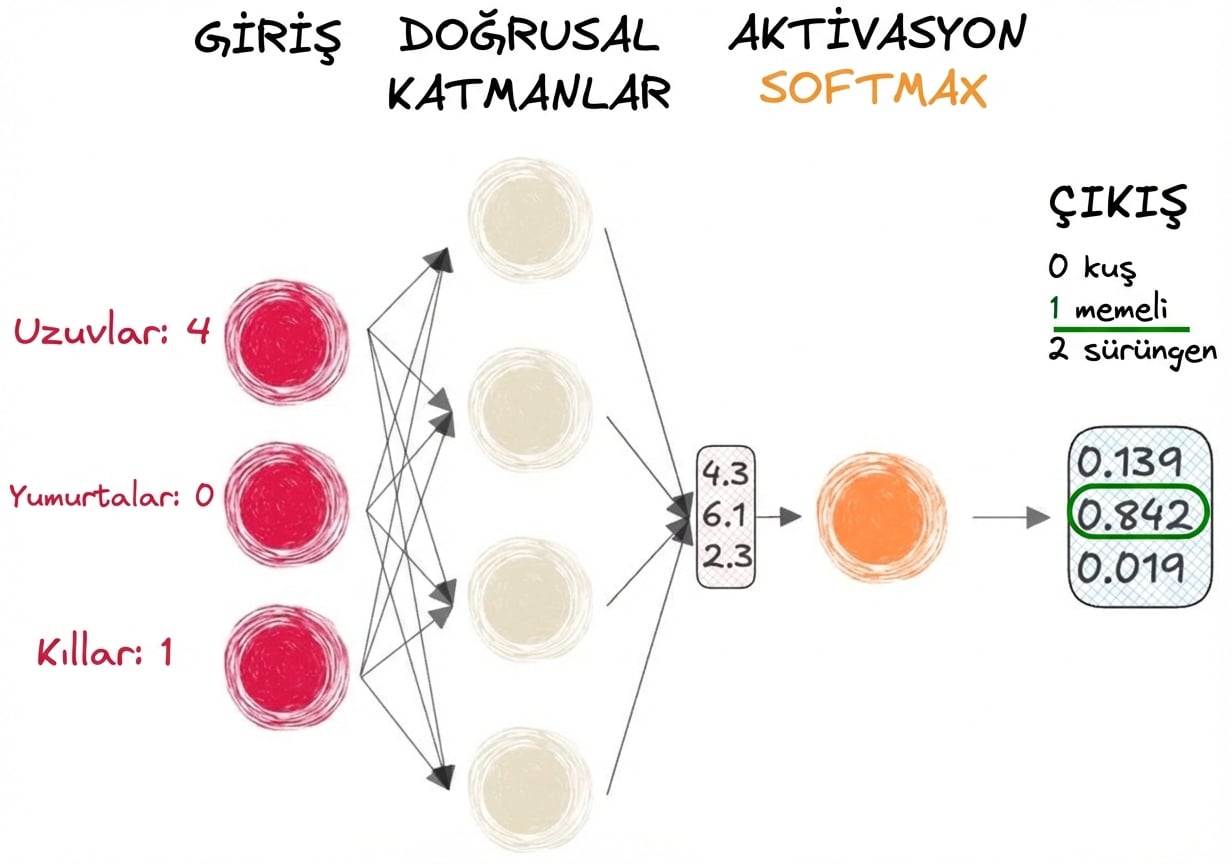

Softmax ile tanışma

- Üç sınıf:

Softmax ile tanışma

- Üç sınıf:

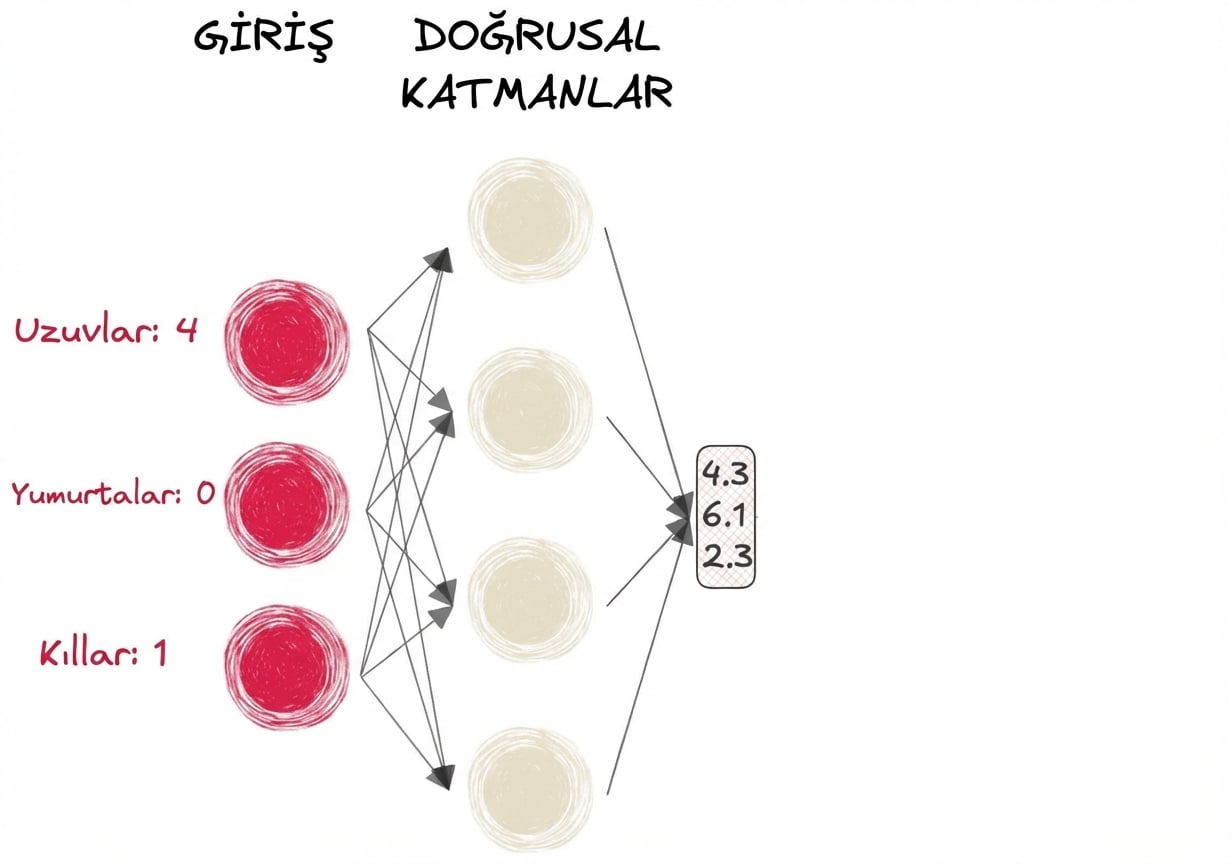

Softmax ile tanışma

- Üç sınıf:

Softmax ile tanışma

- Üç sınıf:

Softmax ile tanışma

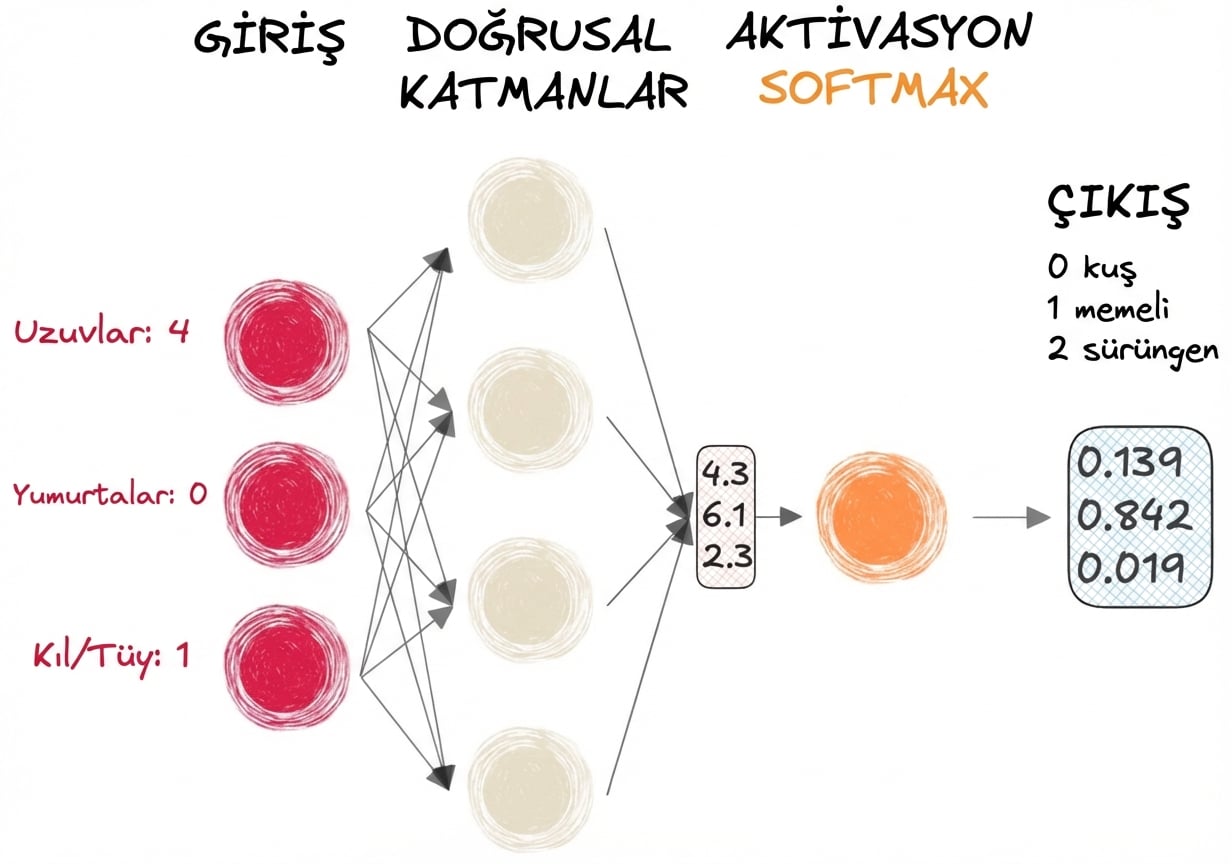

- Üç boyutlu girdiyi alır, aynı şekli döndürür

Softmax ile tanışma

- Üç boyutlu girdiyi alır, aynı şekli döndürür

- Olasılık dağılımı üretir:

- Her eleman bir olasılıktır (0 ile 1 arasında)

- Çıktı vektörünün toplamı 1’e eşittir

Softmax ile tanışma

- Üç boyutlu girdiyi alır, aynı şekli döndürür

- Olasılık dağılımı üretir:

- Her eleman bir olasılıktır (0 ile 1 arasında)

- Çıktı vektörünün toplamı 1’e eşittir

Softmax ile tanışma

import torch import torch.nn as nn # Create an input tensor input_tensor = torch.tensor( [[4.3, 6.1, 2.3]]) # Apply softmax along the last dimensionprobabilities = nn.Softmax(dim=-1) output_tensor = probabilities(input_tensor) print(output_tensor)

tensor([[0.1392, 0.8420, 0.0188]])

dim = -1, softmax’in giriş tensörünün son boyutuna uygulandığını belirtirnn.Softmax(),nn.Sequential()içinde son adım olarak kullanılabilir

Ayo berlatih!

PyTorch ile Deep Learning'e Giriş