Öğrenme oranı ve momentum

PyTorch ile Deep Learning'e Giriş

Jasmin Ludolf

Senior Data Science Content Developer, DataCamp

SGD ile ağırlıkları güncelleme

- Bir sinir ağını eğitmek = bir optimizasyon problemi çözmek.

Stochastic Gradient Descent (SGD) optimizörü

sgd = optim.SGD(model.parameters(), lr=0.01, momentum=0.95)

- İki argüman:

- learning rate: adım boyutunu kontrol eder

- momentum: sıkışmayı önlemek için atalet ekler

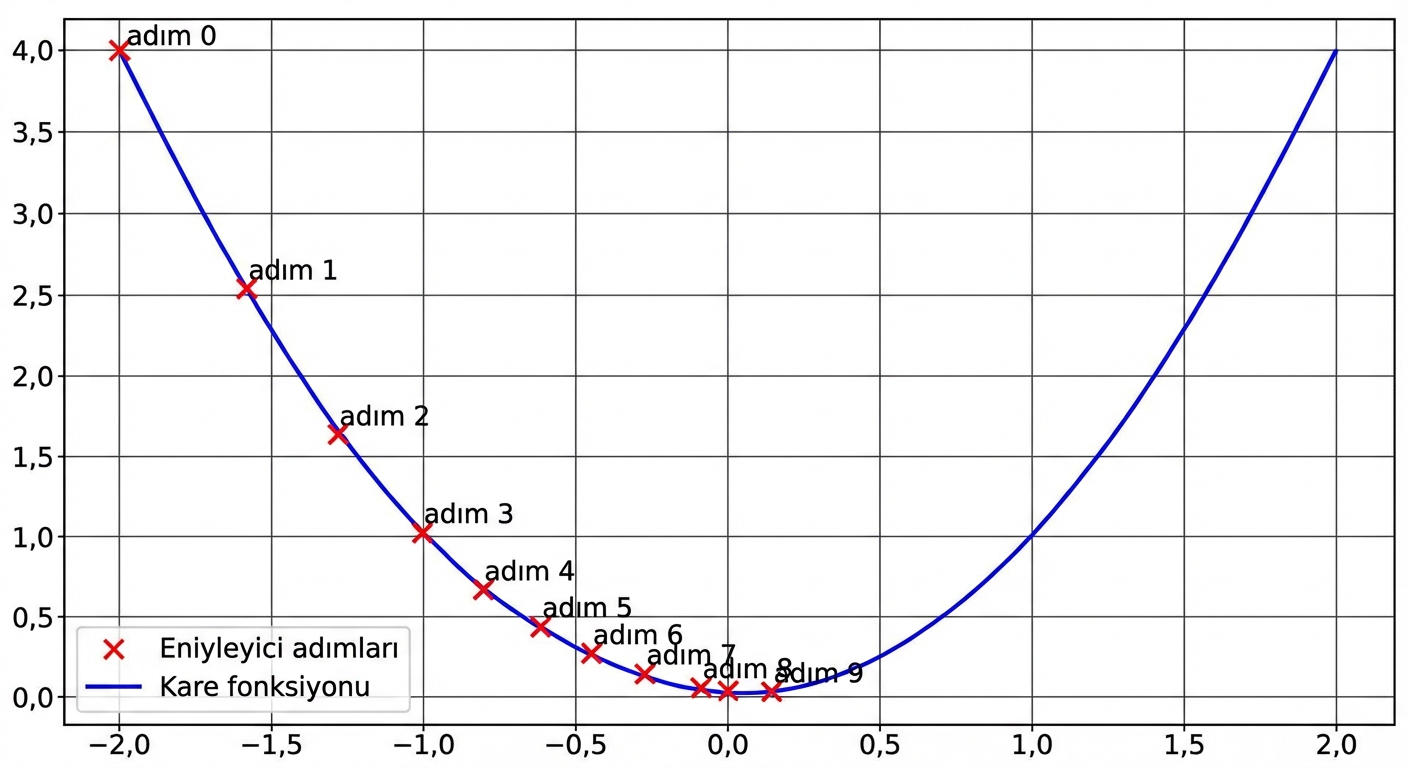

Öğrenme oranının etkisi: optimal öğrenme oranı

- Gradyan küçüldükçe sıfıra yakın bölgede adım boyutu azalır

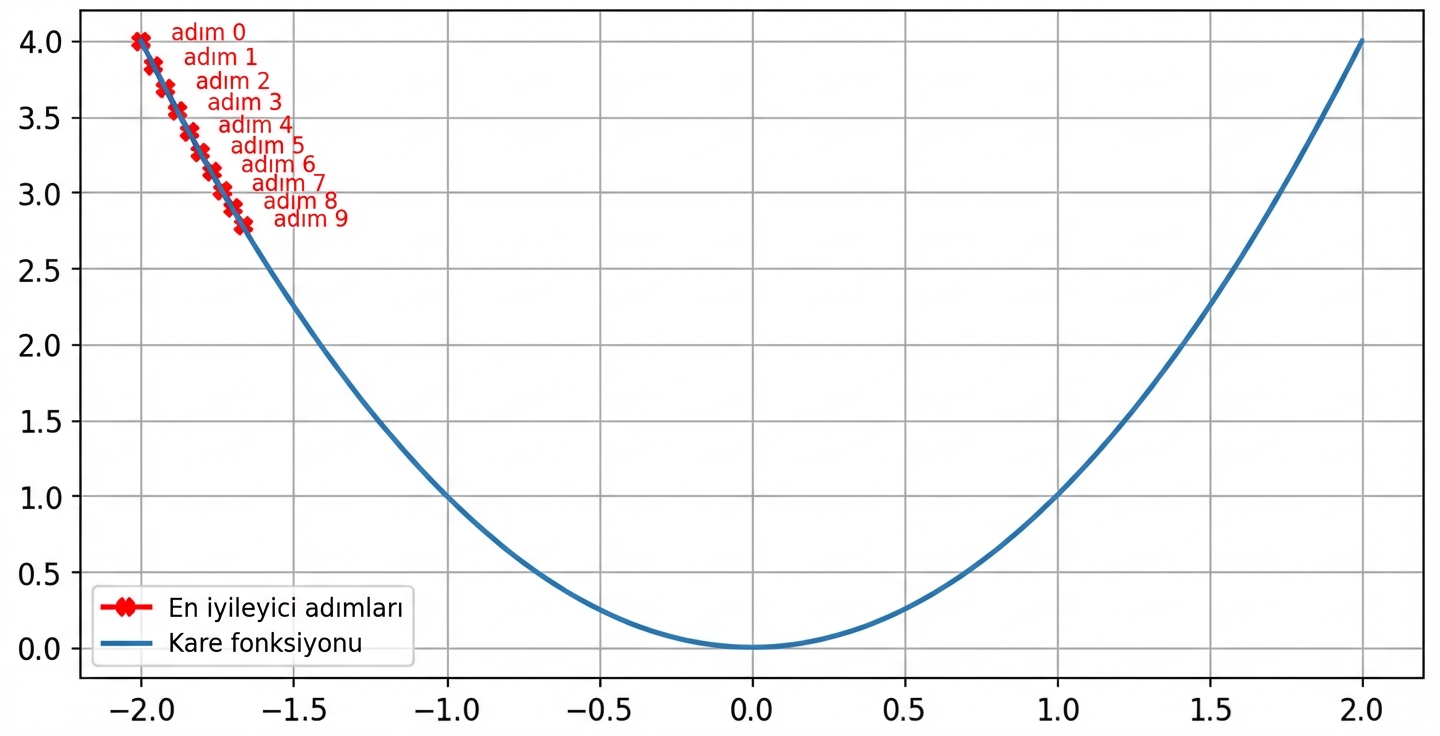

Öğrenme oranının etkisi: küçük öğrenme oranı

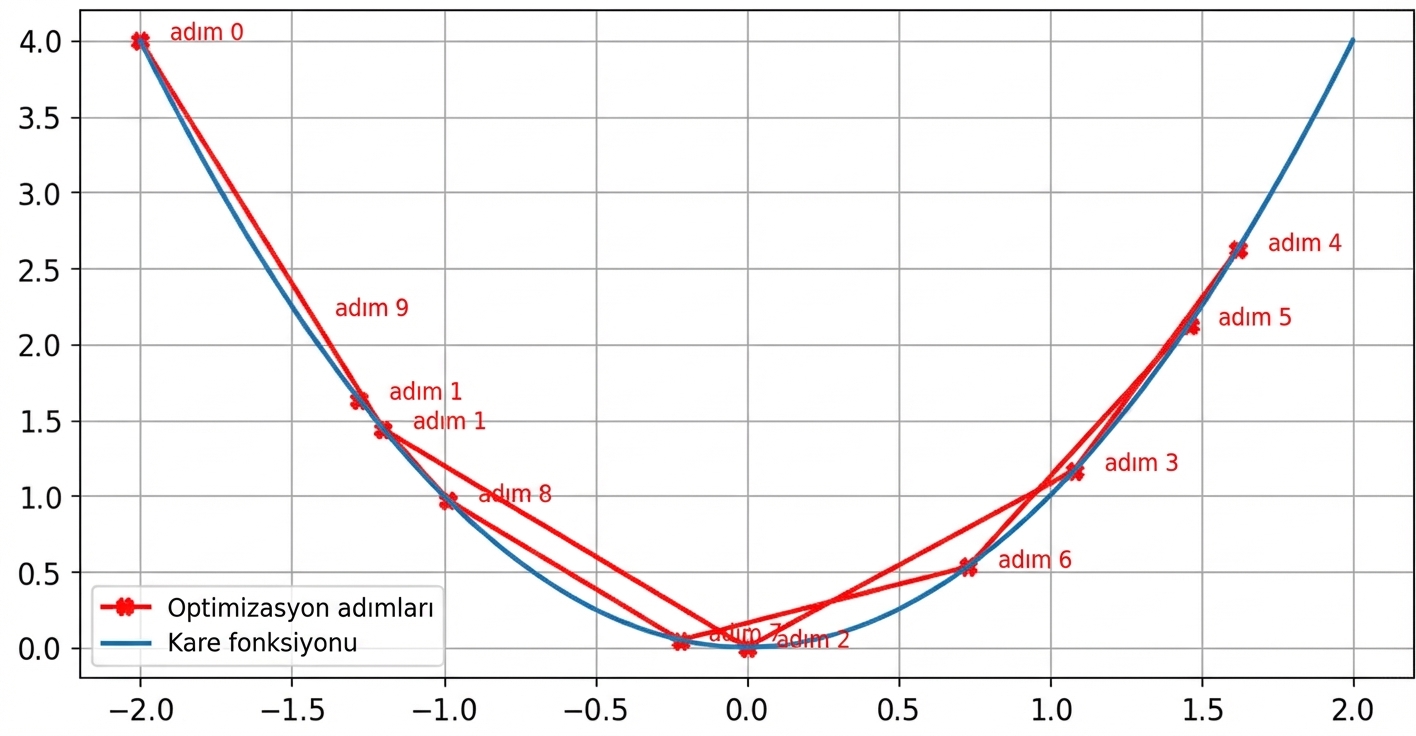

Öğrenme oranının etkisi: yüksek öğrenme oranı

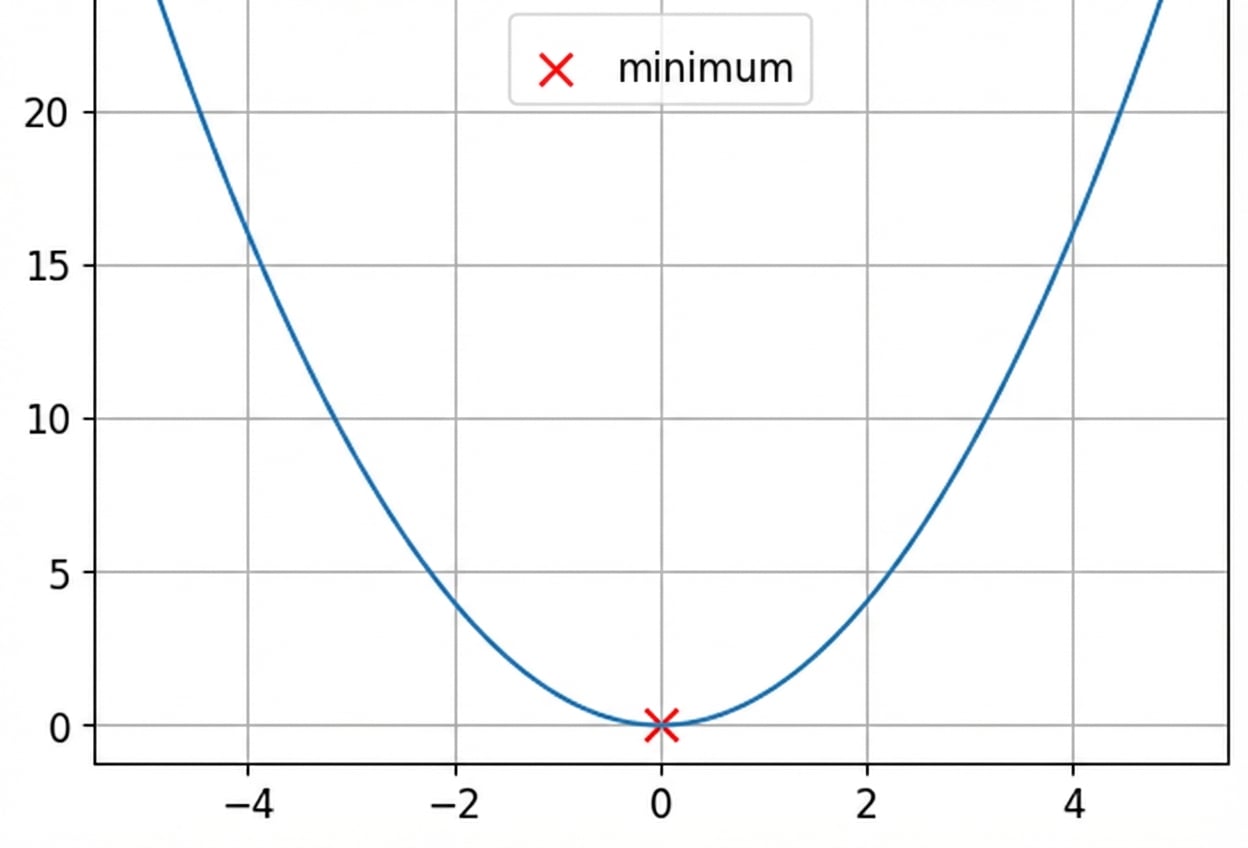

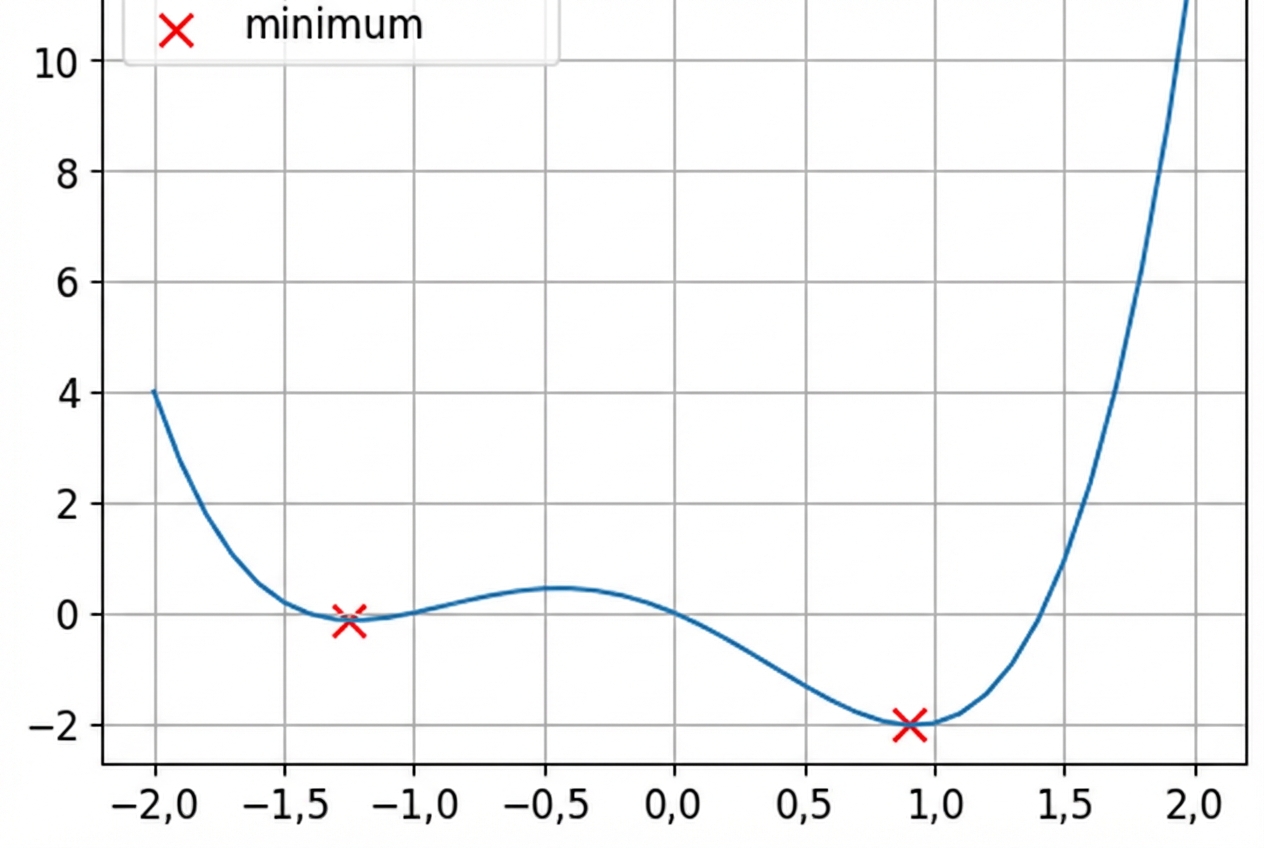

Konveks ve konveks olmayan fonksiyonlar

Bu bir konveks fonksiyon.

Bu bir konveks olmayan fonksiyon.

- Kayıp fonksiyonları konveks değildir

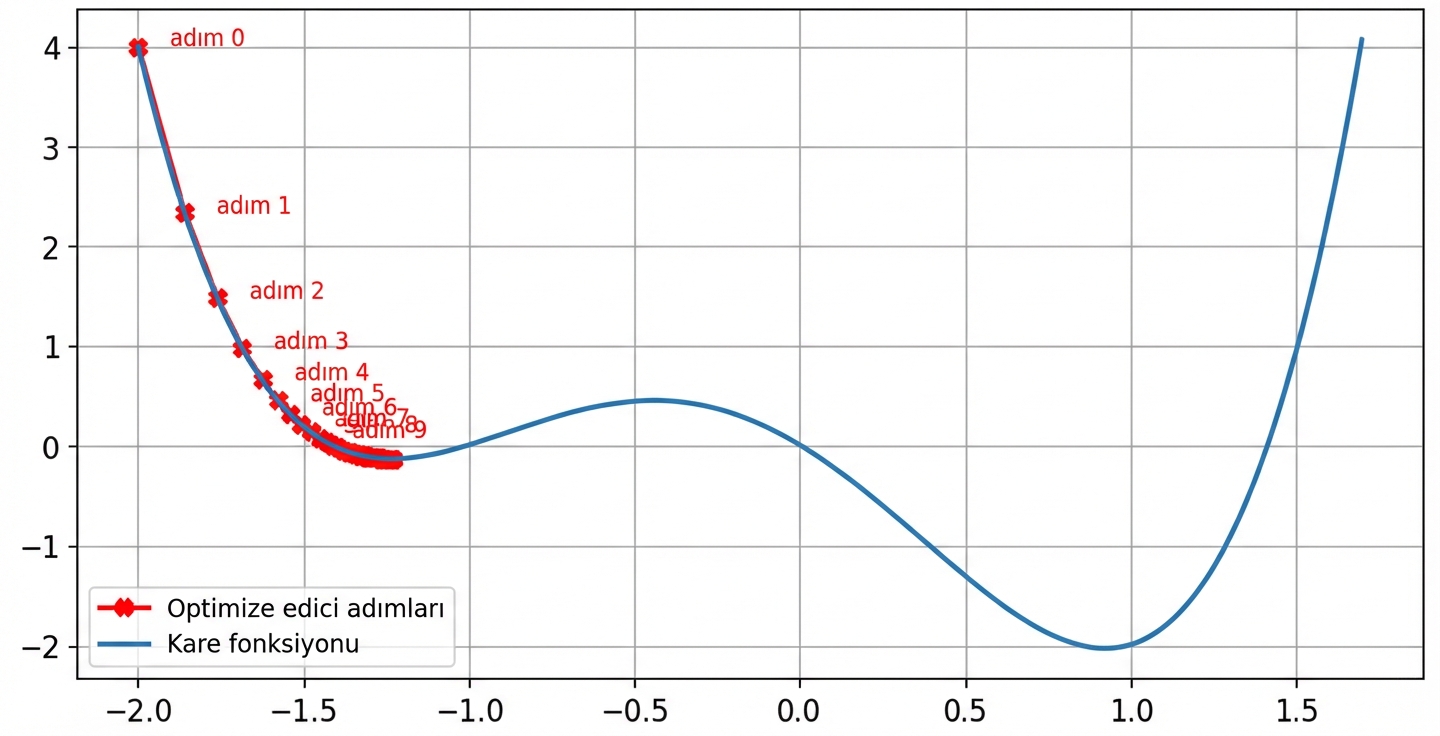

Momentum olmadan

lr = 0.01momentum = 0, 100 adım sonra bulunan minimum:x = -1.23,y = -0.14

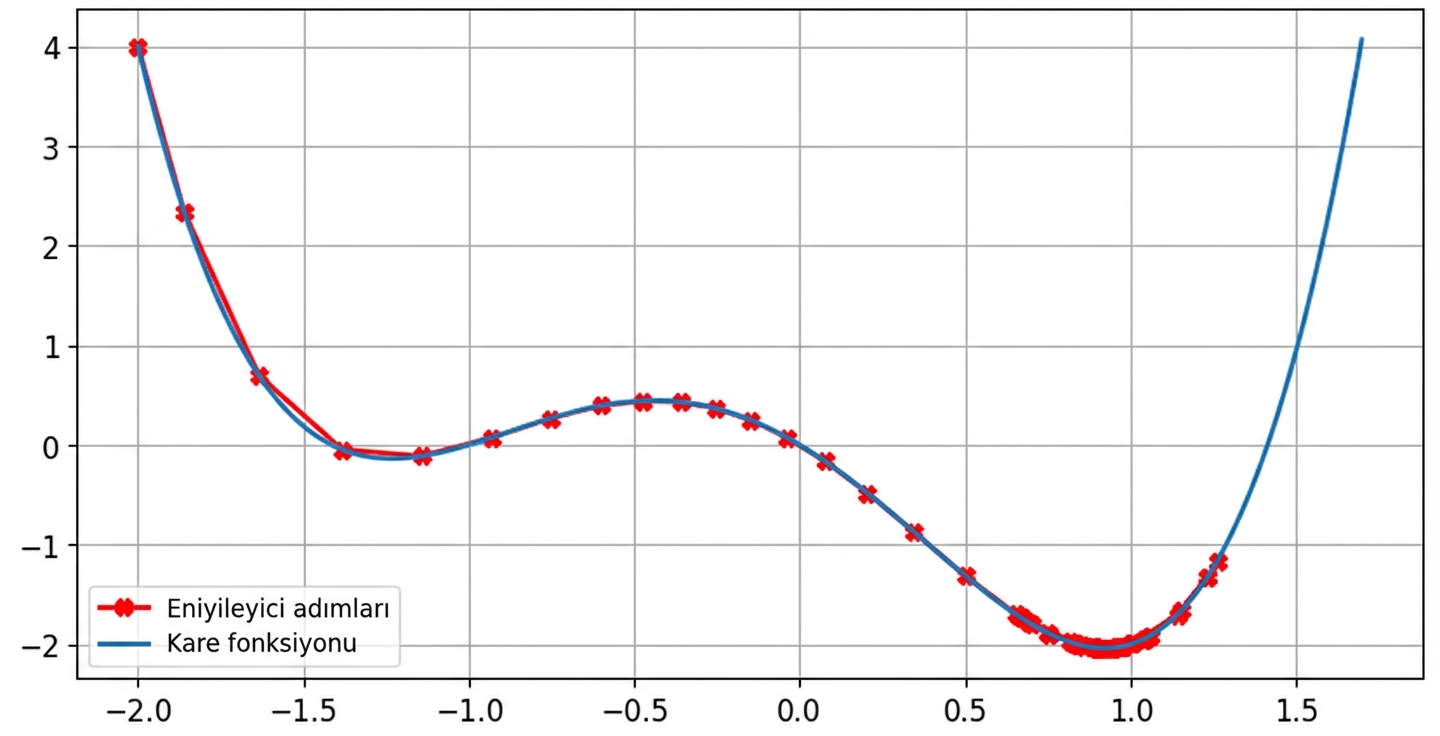

Momentum ile

lr = 0.01momentum = 0.9, 100 adım sonra bulunan minimum:x = 0.92,y = -2.04

Özet

$$

| Öğrenme oranı | Momentum |

|---|---|

| Adım boyutunu kontrol eder | Ataleti kontrol eder |

| Çok yüksek → zayıf performans | Yerel minimumdan kaçmaya yardım eder |

| Çok düşük → yavaş eğitim | Çok küçük → optimizör sıkışır |

| Tipik aralık: 0.01 ($10^{-2}$) ve 0.0001 ($10^{-4}$) | Tipik aralık: 0.85–0.99 |

Hadi pratik yapalım!

PyTorch ile Deep Learning'e Giriş