Türevleri kullanarak model parametrelerini güncelleme

PyTorch ile Deep Learning'e Giriş

Jasmin Ludolf

Senior Data Science Content Developer, DataCamp

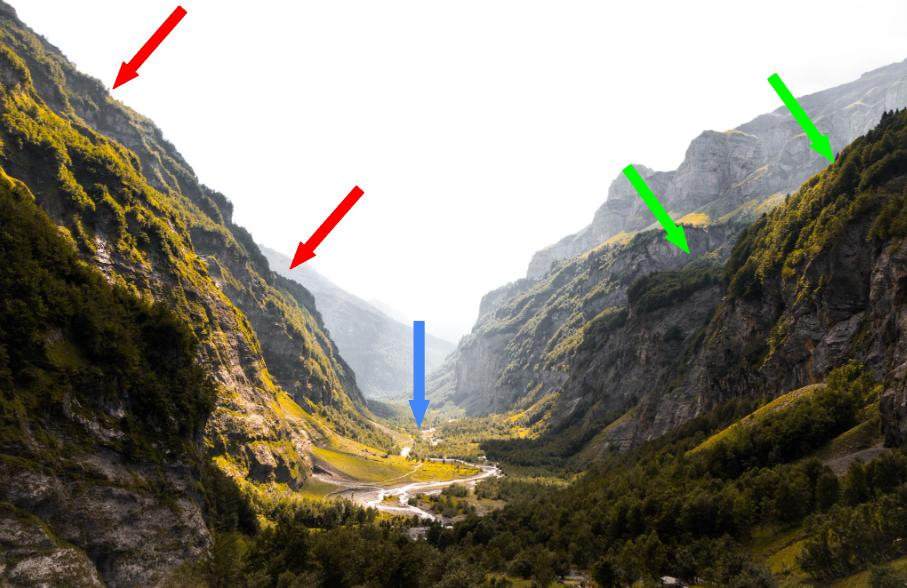

Türevler için bir benzetme

$$

Türev, eğrinin eğimini gösterir

$$

- Dik eğimler (kırmızı oklar):

- Büyük adımlar, türev yüksektir

- Daha yatık eğimler (yeşil oklar):

- Küçük adımlar, türev düşüktür

- Vadi tabanı (mavi ok):

- Düz, türev sıfırdır

$$

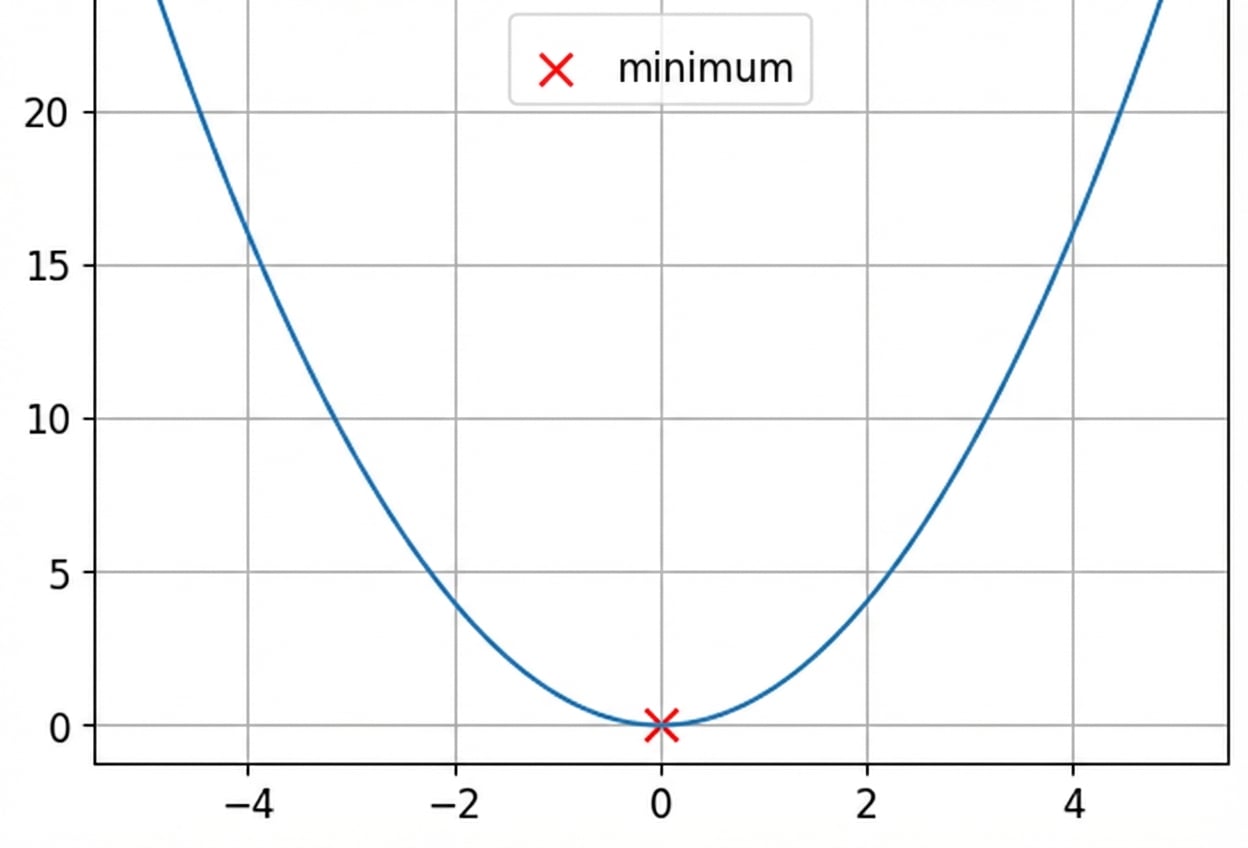

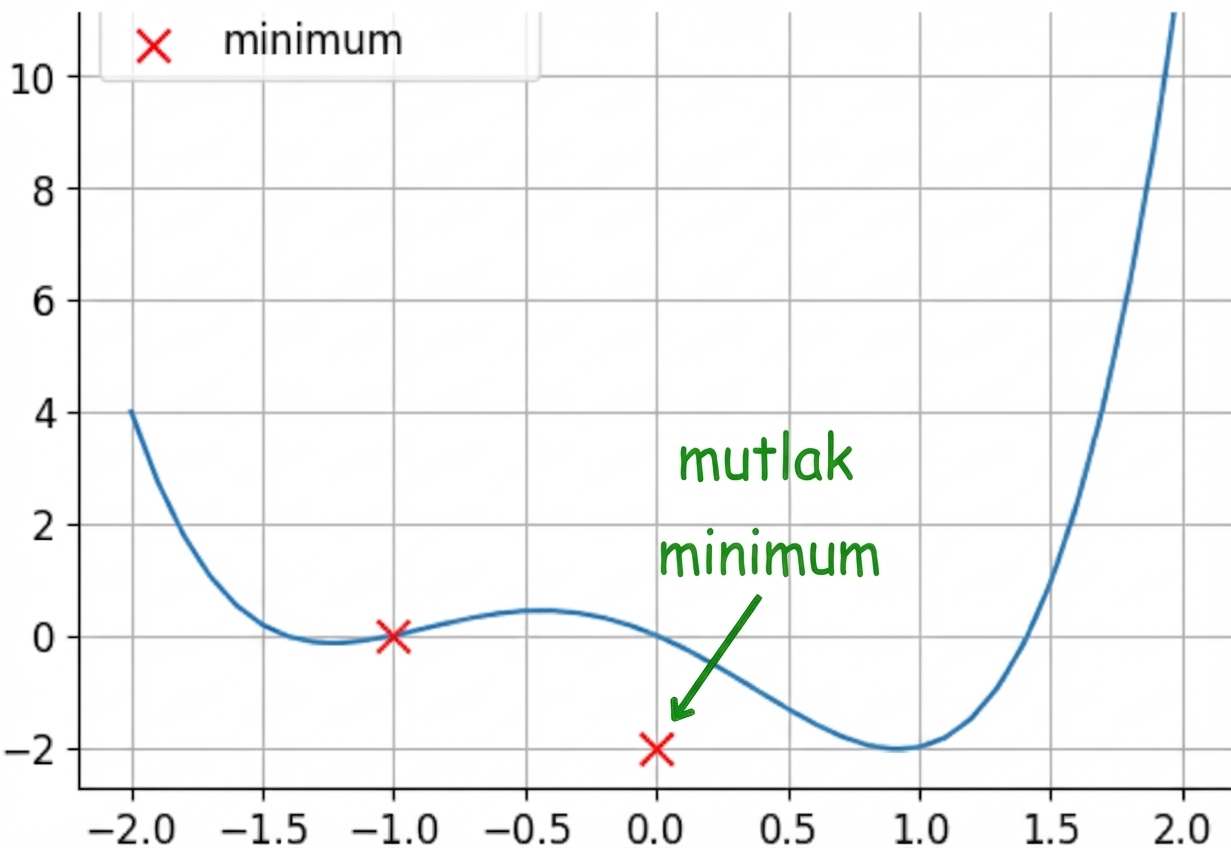

Konveks ve konveks olmayan fonksiyonlar

Bu bir konveks fonksiyondur

Bu bir konveks olmayan fonksiyondur

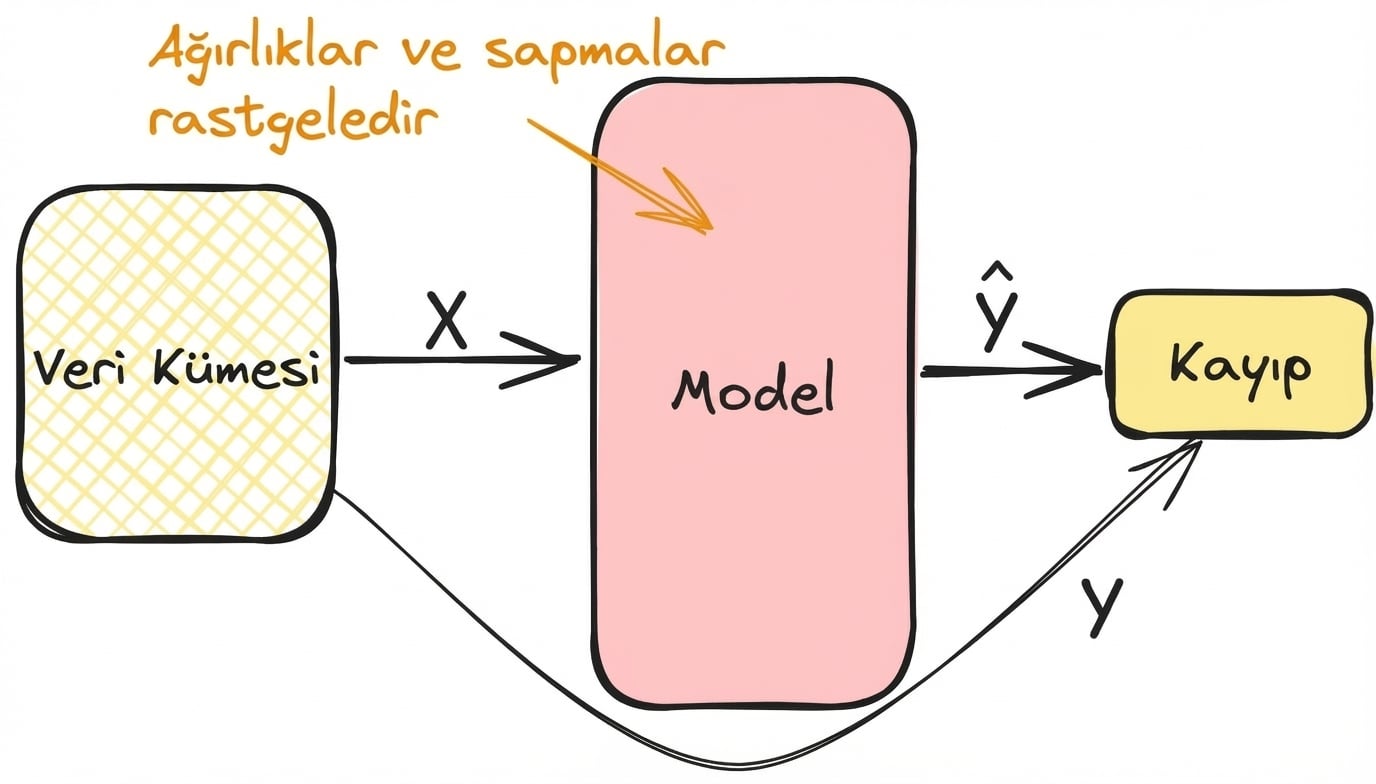

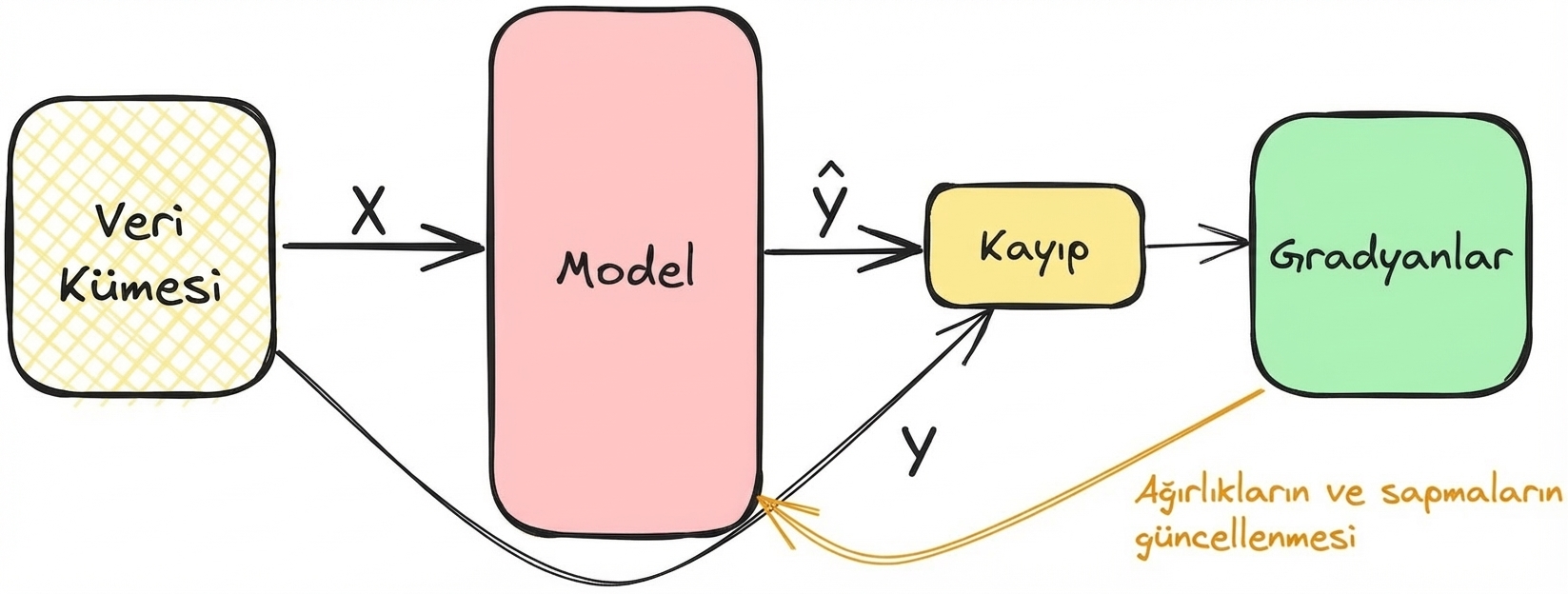

Türevleri model eğitimiyle ilişkilendirme

- Eğitimde ileri geçişte kaybı hesaplayın

$$

Türevleri model eğitimiyle ilişkilendirme

- Gradyanlar kaybı azaltır; katman ağırlık ve biaslarını ayarlar

- Katmanlar ayarlandıkça tekrarlayın

$$

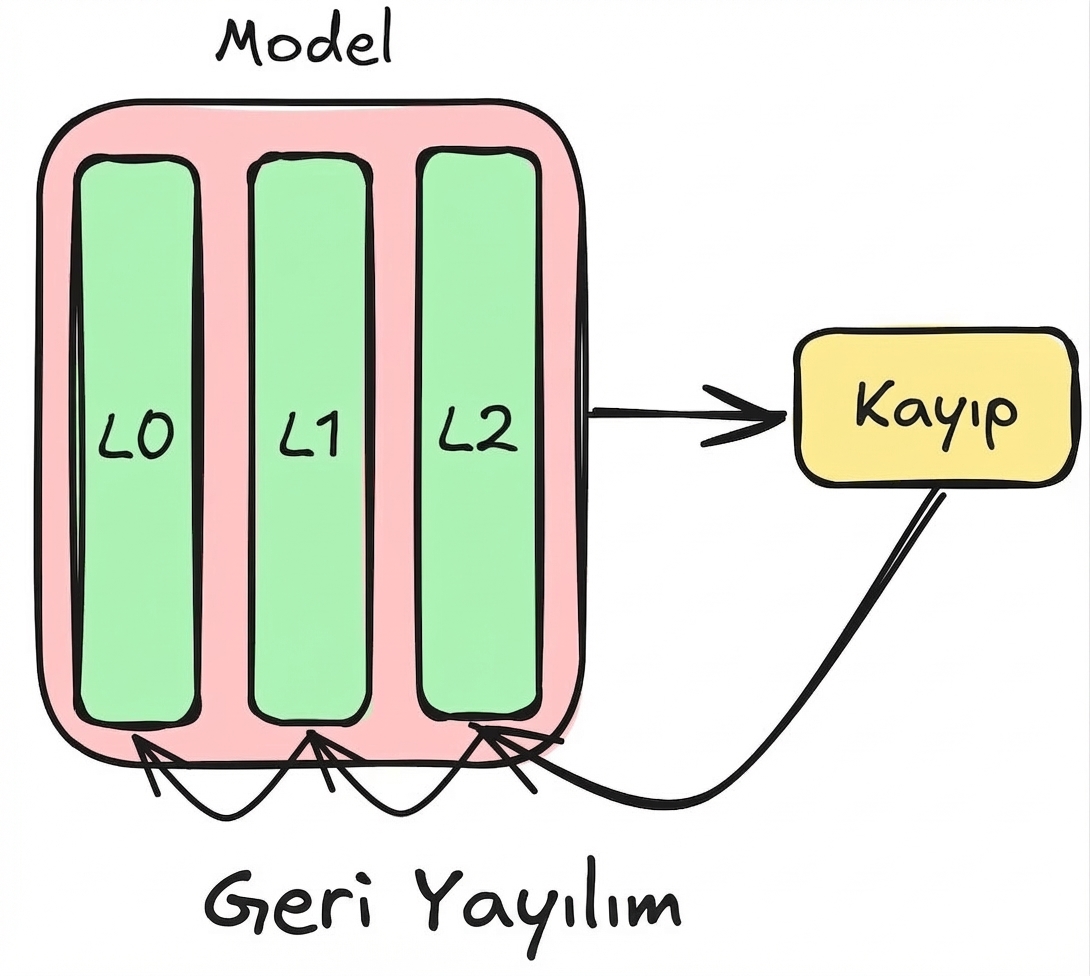

Geri yayılım kavramları

$$

Üç katmanlı bir ağ düşünün:

- $L2$ için kayıp gradyanlarıyla başlayın

- $L2$ ile $L1$ gradyanlarını hesaplayın

- Tüm katmanlar için tekrarlayın ($L1$, $L0$)

PyTorch'ta geri yayılım

# Run a forward pass model = nn.Sequential(nn.Linear(16, 8), nn.Linear(8, 4), nn.Linear(4, 2)) prediction = model(sample)# Calculate the loss and gradients criterion = CrossEntropyLoss() loss = criterion(prediction, target) loss.backward()

# Access each layer's gradients

model[0].weight.grad

model[0].bias.grad

model[1].weight.grad

model[1].bias.grad

model[2].weight.grad

model[2].bias.grad

Model parametrelerini elle güncelleme

# Learning rate is typically small lr = 0.001 # Update the weights weight = model[0].weight weight_grad = model[0].weight.gradweight = weight - lr * weight_grad# Update the biases bias = model[0].bias bias_grad = model[0].bias.gradbias = bias - lr * bias_grad

$$

- Her katmanın gradyanına erişin

- Öğrenme oranı ile çarpın

- Bu çarpımı ağırlıktan çıkarın

Gradyan inişi

Konveks olmayan fonksiyonlar için gradyan inişi kullanırız

PyTorch bunu optimizatörlerle basitleştirir

- Stokastik gradyan inişi (SGD)

import torch.optim as optim # Create the optimizer optimizer = optim.SGD(model.parameters(), lr=0.001)# Perform parameter updates optimizer.step()

Hadi pratik yapalım!

PyTorch ile Deep Learning'e Giriş