İnce ayara hazırlık

Python ile LLM'lere Giriş

Jasmin Ludolf

Senior Data Science Content Developer, DataCamp

Pipelines ve auto sınıfları

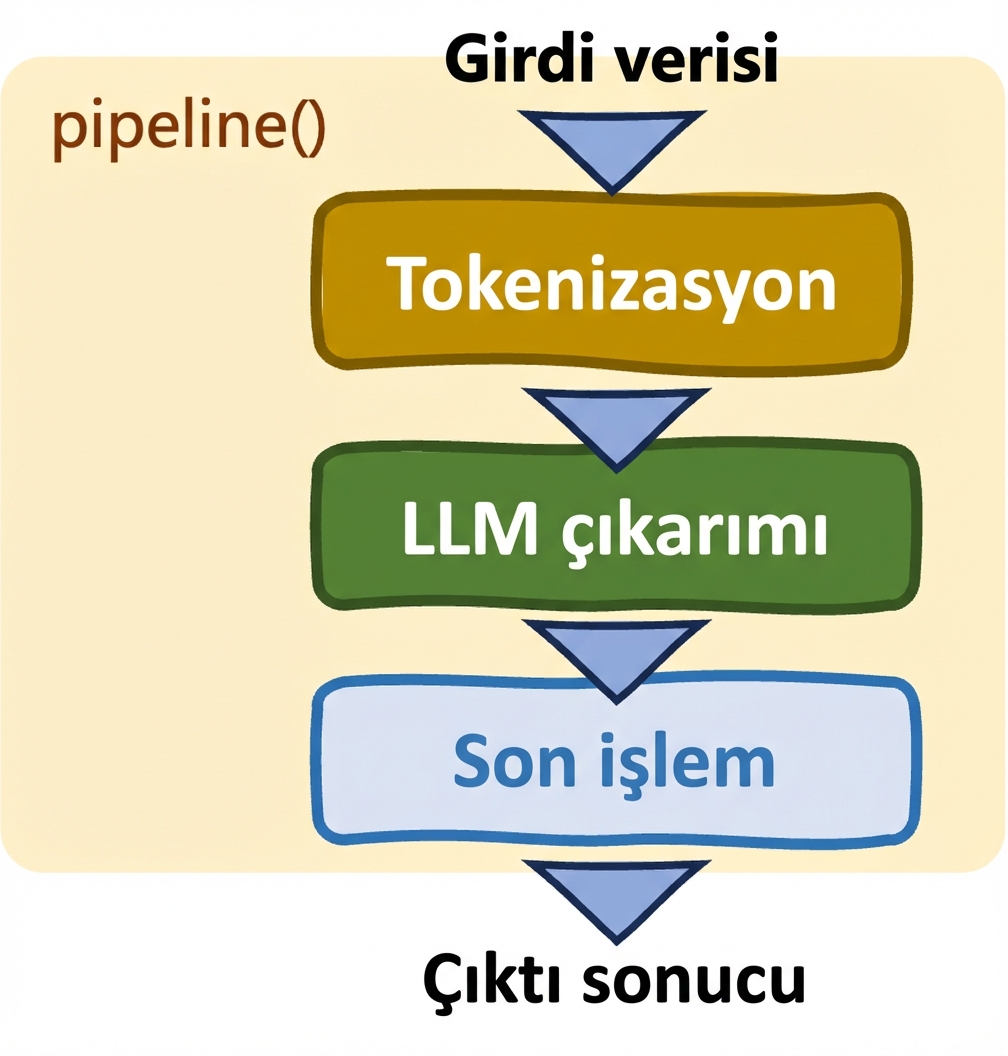

Pipelines: pipeline()

- Görevleri basitleştirir

- Model ve tokenizer'ı otomatik seçer

- Sınırlı kontrol

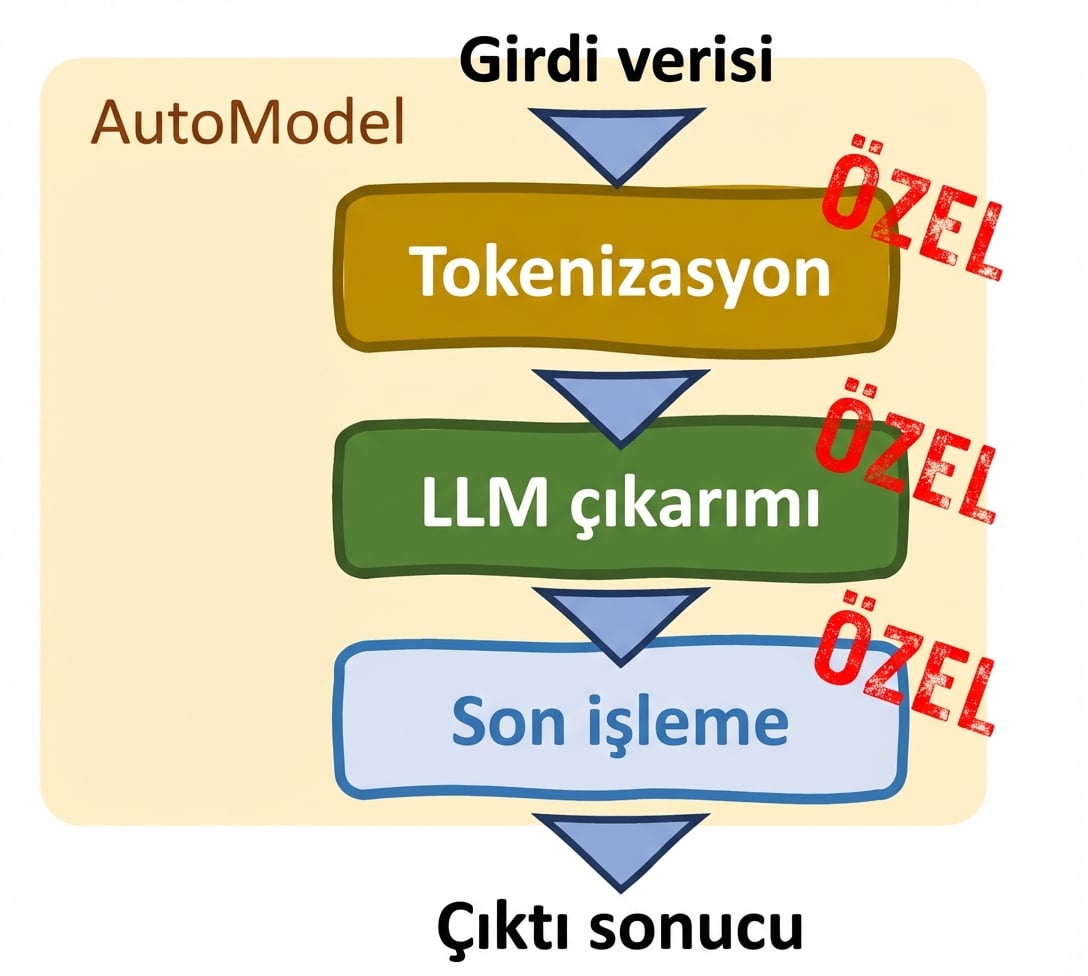

Auto sınıfları (AutoModel sınıfı)

- Özelleştirme

- Manuel ayarlamalar

- İnce ayarı destekler

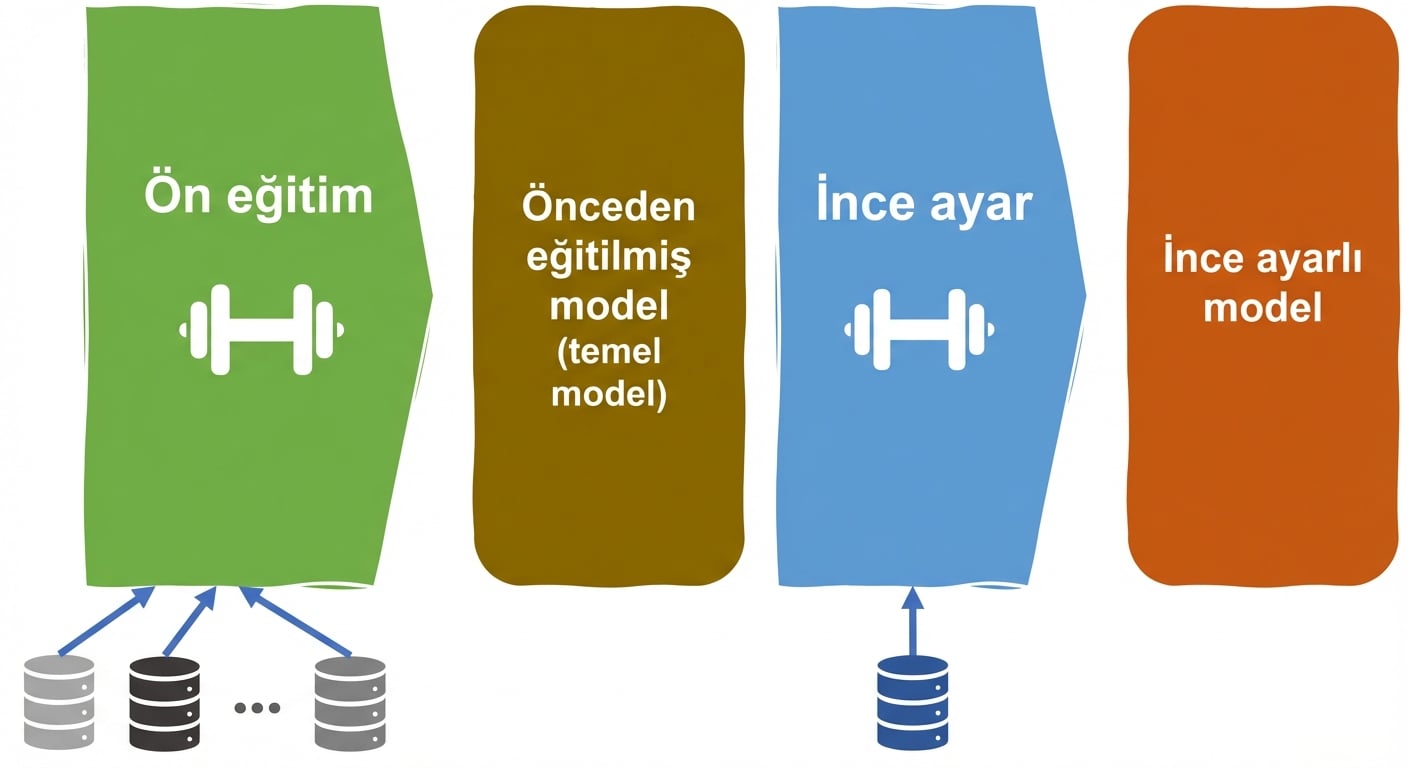

LLM yaşam döngüsü

Ön eğitim

- Geniş veri

- Genel kalıpları öğrenir

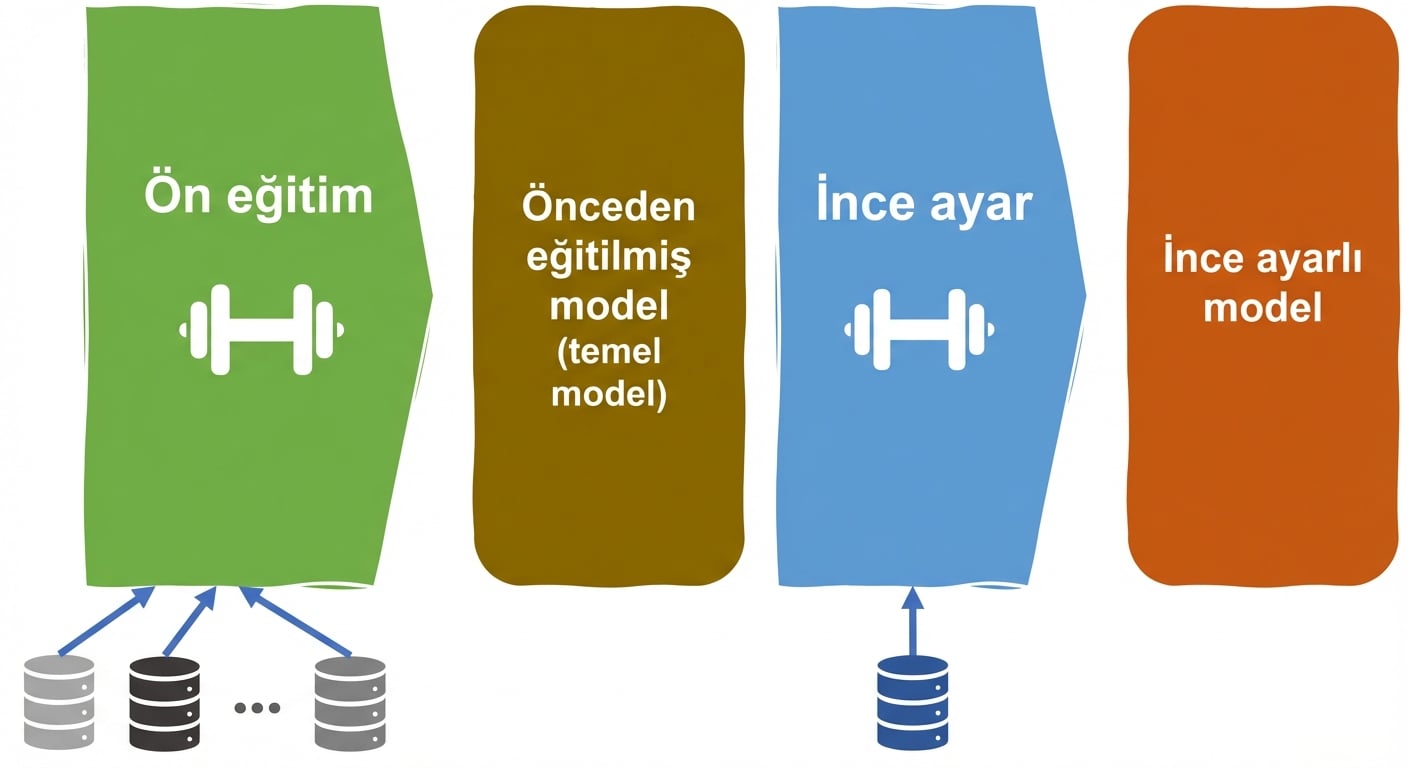

LLM yaşam döngüsü

Ön eğitim İnce ayar

- Geniş veri Alan odaklı

- Genel kalıpları öğrenir Uzmanlaşmış görevler

İnce ayar için veri kümesi yükleme

from datasets import load_datasettrain_data = load_dataset("imdb", split="train")train_data = data.shard(num_shards=4, index=0)test_data = load_dataset("imdb", split="test")test_data = data.shard(num_shards=4, index=0)

load_dataset(): Hugging Face hub'dan veri kümesi yükler- imdb: yorum sınıflandırma

Auto sınıfları

from transformers import AutoModel, AutoTokenizerfrom transformers import AutoModelForSequenceClassificationmodel = AutoModelForSequenceClassification.from_pretrained("bert-base-uncased") tokenizer = AutoTokenizer.from_pretrained("bert-base-uncased")

Tokenleştirme

from transformers import AutoTokenizer, AutoModelForSequenceClassification from datasets import load_dataset train_data = load_dataset("imdb", split="train") train_data = data.shard(num_shards=4, index=0) test_data = load_dataset("imdb", split="test") test_data = data.shard(num_shards=4, index=0) model = AutoModelForSequenceClassification.from_pretrained("bert-base-uncased") tokenizer = AutoTokenizer.from_pretrained("bert-base-uncased")# Tokenize the data tokenized_training_data = tokenizer(train_data["text"], return_tensors="pt", padding=True, truncation=True, max_length=64) tokenized_test_data = tokenizer(test_data["text"], return_tensors="pt", padding=True, truncation=True, max_length=64)

Tokenleştirme çıktısı

print(tokenized_training_data)

{'input_ids': tensor([[ 101, 1045, 12524, 1045, 2572, 8025, 1011, 3756,

2013, 2026, 2678, 3573, 2138, 1997, 2035, 1996, 6704, 2008, 5129, 2009,

2043, 2009, 2001, 2034, 2207, 1999, 3476, 1012, 1045, 2036, ...

Satır satır tokenleştirme

def tokenize_function(text_data): return tokenizer(text_data["text"], return_tensors="pt", padding=True, truncation=True, max_length=64) # Tokenize in batches tokenized_in_batches = train_data.map(tokenize_function, batched=True)# Tokenize row by row tokenized_by_row = train_data.map(tokenize_function, batched=False)

Dataset({

features: ['text', 'label', 'input_ids', 'token_type_ids', 'attention_mask'],

num_rows: 1563

})

Alt-birim tokenleştirme

- Modern tokenizer'larda yaygın

- Sözcükler anlamlı alt parçalara bölünür

Alt-birim tokenleştirme

- Modern tokenizer'larda yaygın

- Sözcükler anlamlı alt parçalara bölünür

Haydi pratik yapalım!

Python ile LLM'lere Giriş