AdaBoost

Python ile Ağaç Tabanlı Modellerle Machine Learning

Elie Kawerk

Data Scientist

Boosting

Boosting: Birden çok zayıf öğreneni birleştirip güçlü bir öğrenen oluşturan topluluk yöntemi.

Zayıf öğrenen: Rastgele tahminden biraz daha iyi olan model.

Zayıf öğrenene örnek: Karar kütüğü (maks. derinliği 1 olan CART).

Boosting

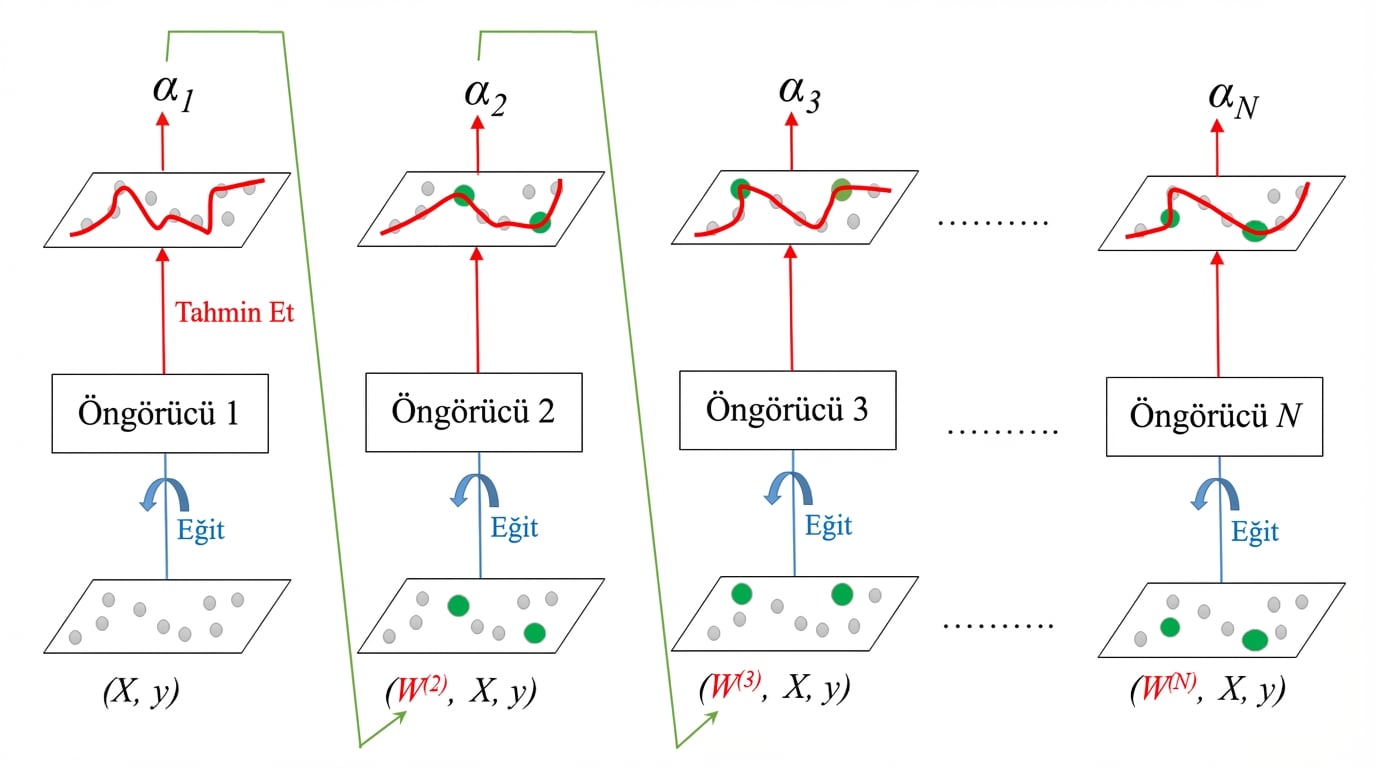

Tahminciler topluluğunu sıralı olarak eğitin.

Her tahminci öncekini düzeltmeye çalışır.

En yaygın boosting yöntemleri:

AdaBoost,

Gradient Boosting.

Adaboost

Adaptive Boosting ifadesinin kısaltmasıdır.

Her tahminci, selefi tarafından yanlış tahmin edilen örneklere daha çok odaklanır.

Bu, eğitim örneklerinin ağırlıklarını değiştirerek sağlanır.

Her tahminciye bir $\alpha$ katsayısı atanır.

$\alpha$, tahmincinin eğitim hatasına bağlıdır.

AdaBoost: Eğitim

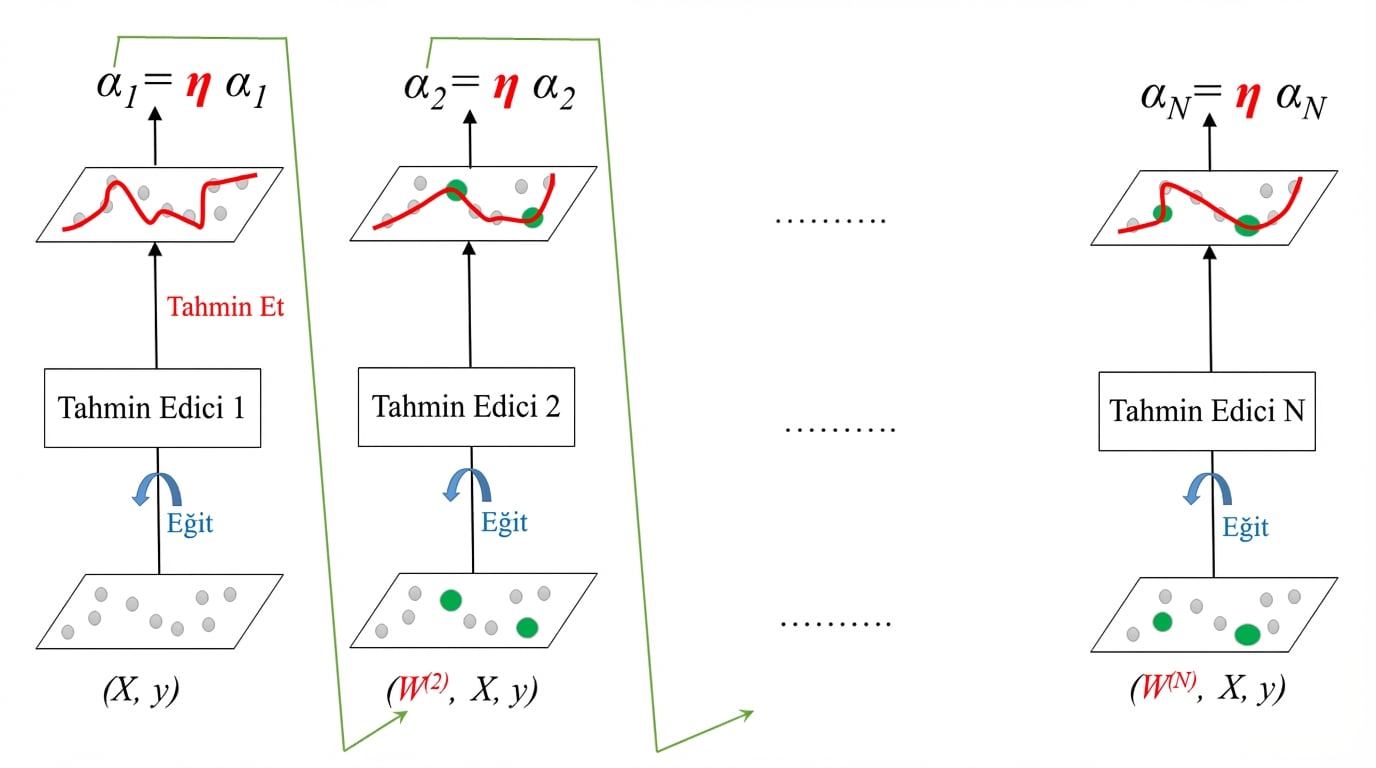

Öğrenme Hızı

Öğrenme hızı: $0 < \eta \leq 1$

AdaBoost: Tahmin

Sınıflandırma:

- Ağırlıklı çoğunluk oylaması.

- sklearn'de:

AdaBoostClassifier.

Regresyon:

- Ağırlıklı ortalama.

- sklearn'de:

AdaBoostRegressor.

sklearn ile AdaBoost Sınıflandırma (Meme Kanseri veri seti)

# Import models and utility functions

from sklearn.ensemble import AdaBoostClassifier

from sklearn.tree import DecisionTreeClassifier

from sklearn.metrics import roc_auc_score

from sklearn.model_selection import train_test_split

# Set seed for reproducibility

SEED = 1

# Split data into 70% train and 30% test

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.3,

stratify=y,

random_state=SEED)

# Instantiate a classification-tree 'dt' dt = DecisionTreeClassifier(max_depth=1, random_state=SEED)# Instantiate an AdaBoost classifier 'adab_clf' adb_clf = AdaBoostClassifier(base_estimator=dt, n_estimators=100)# Fit 'adb_clf' to the training set adb_clf.fit(X_train, y_train) # Predict the test set probabilities of positive class y_pred_proba = adb_clf.predict_proba(X_test)[:,1]# Evaluate test-set roc_auc_score adb_clf_roc_auc_score = roc_auc_score(y_test, y_pred_proba)

sklearn ile AdaBoost Sınıflandırma (Meme Kanseri veri seti)

# Print adb_clf_roc_auc_score

print('ROC AUC score: {:.2f}'.format(adb_clf_roc_auc_score))

ROC AUC score: 0.99

Haydi pratik yapalım!

Python ile Ağaç Tabanlı Modellerle Machine Learning