Eniyileyiciler, eğitim ve değerlendirme

PyTorch ile Orta Düzey Deep Learning

Michal Oleszak

Machine Learning Engineer

Eğitim döngüsü

import torch.nn as nn import torch.optim as optim criterion = nn.BCELoss() optimizer = optim.SGD(net.parameters(), lr=0.01)for epoch in range(1000): for features, labels in dataloader_train:optimizer.zero_grad()outputs = net(features)loss = criterion( outputs, labels.view(-1, 1) )loss.backward()optimizer.step()

- Kayıp fonksiyonu ve eniyileyiciyi tanımla

- İkili sınıflama için

BCELoss SGDeniyileyici

- İkili sınıflama için

- Dönemler ve eğitim yığınları üzerinde yinele

- Gradyanları temizle

- İleri geçiş: model çıktıları

- Kayıp hesapla

- Gradyanları hesapla

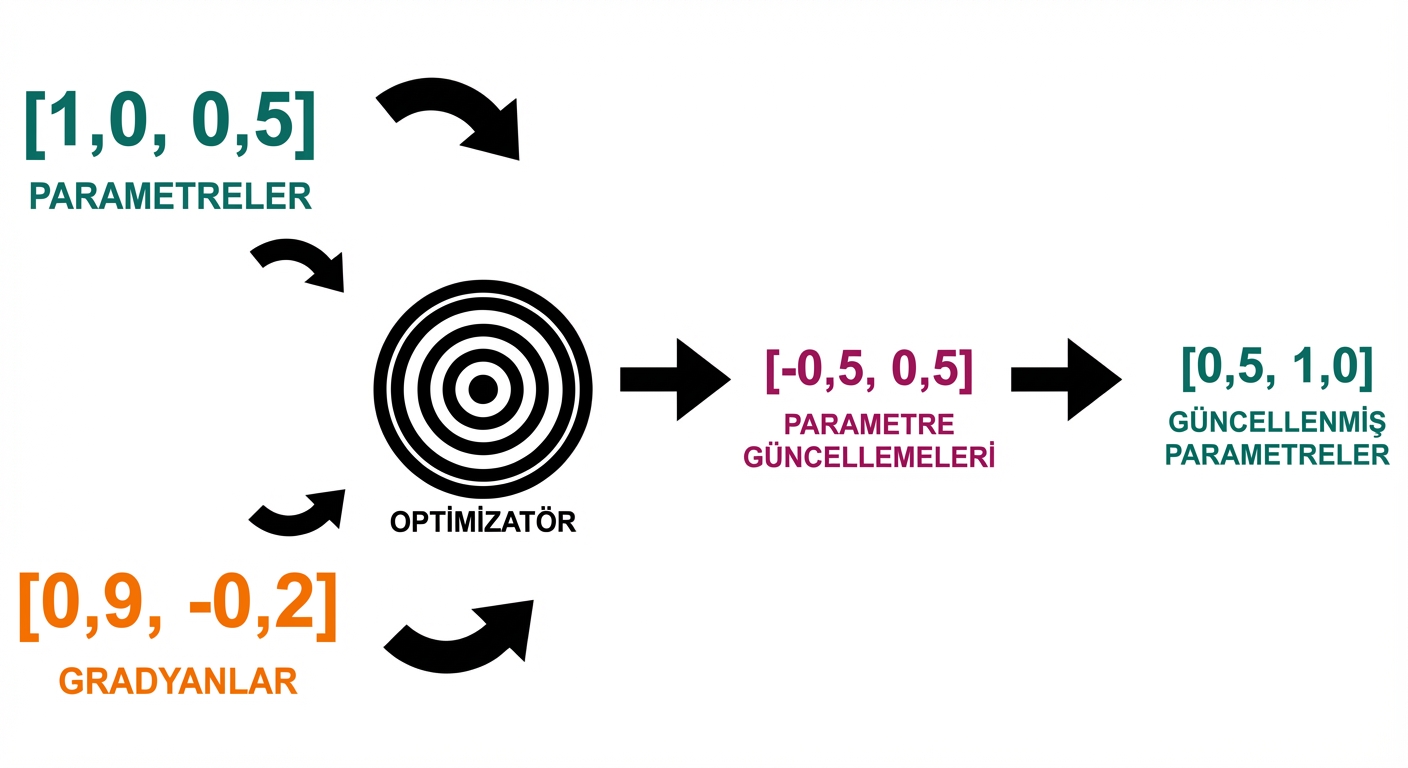

- Eniyileyici adımı: parametreleri güncelle

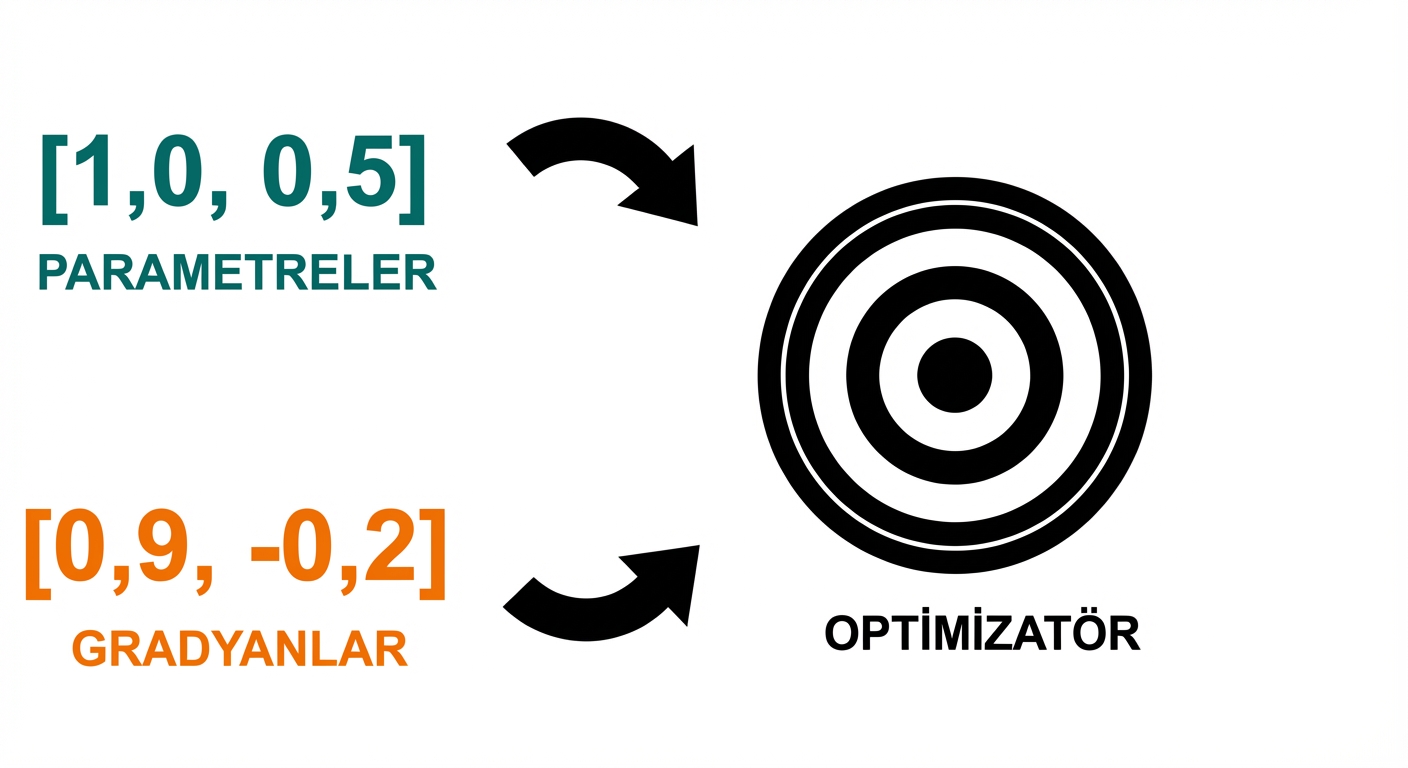

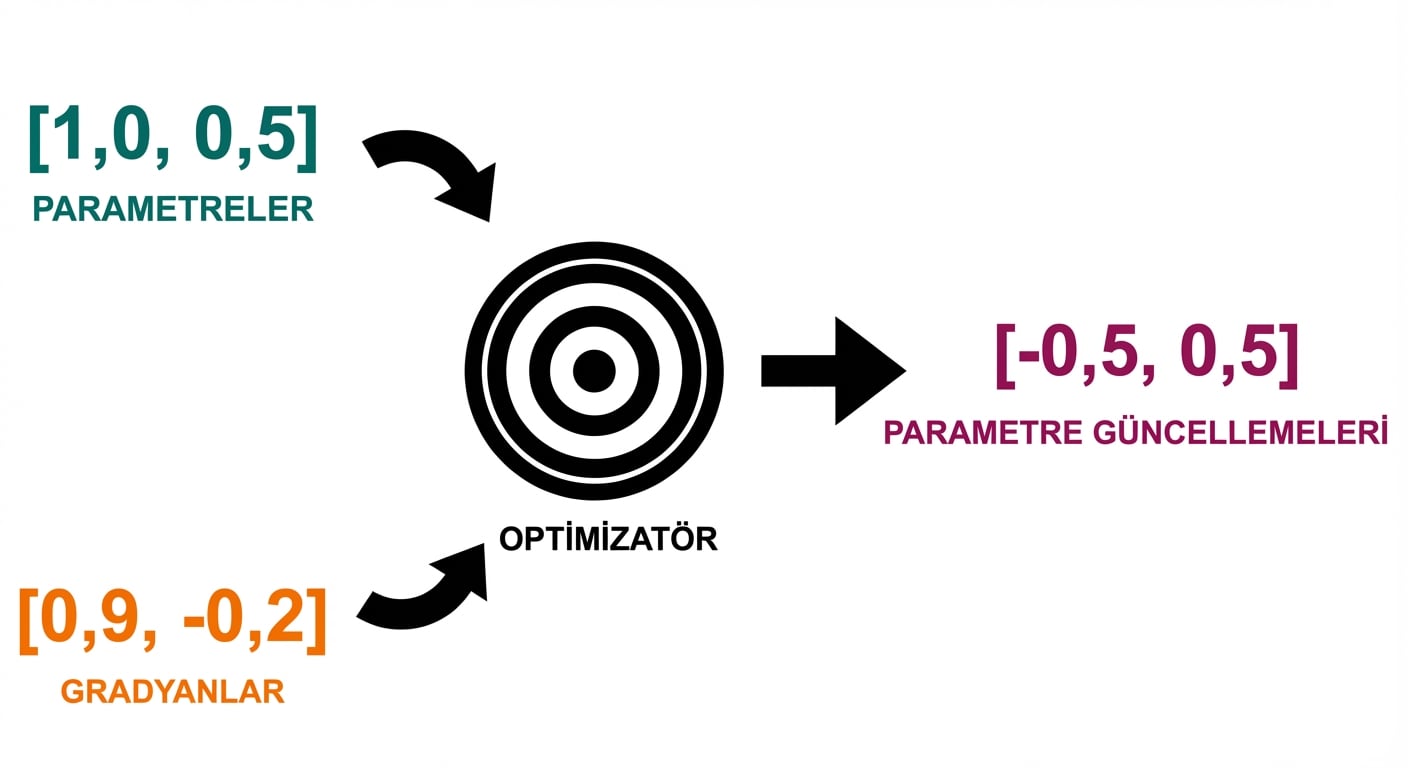

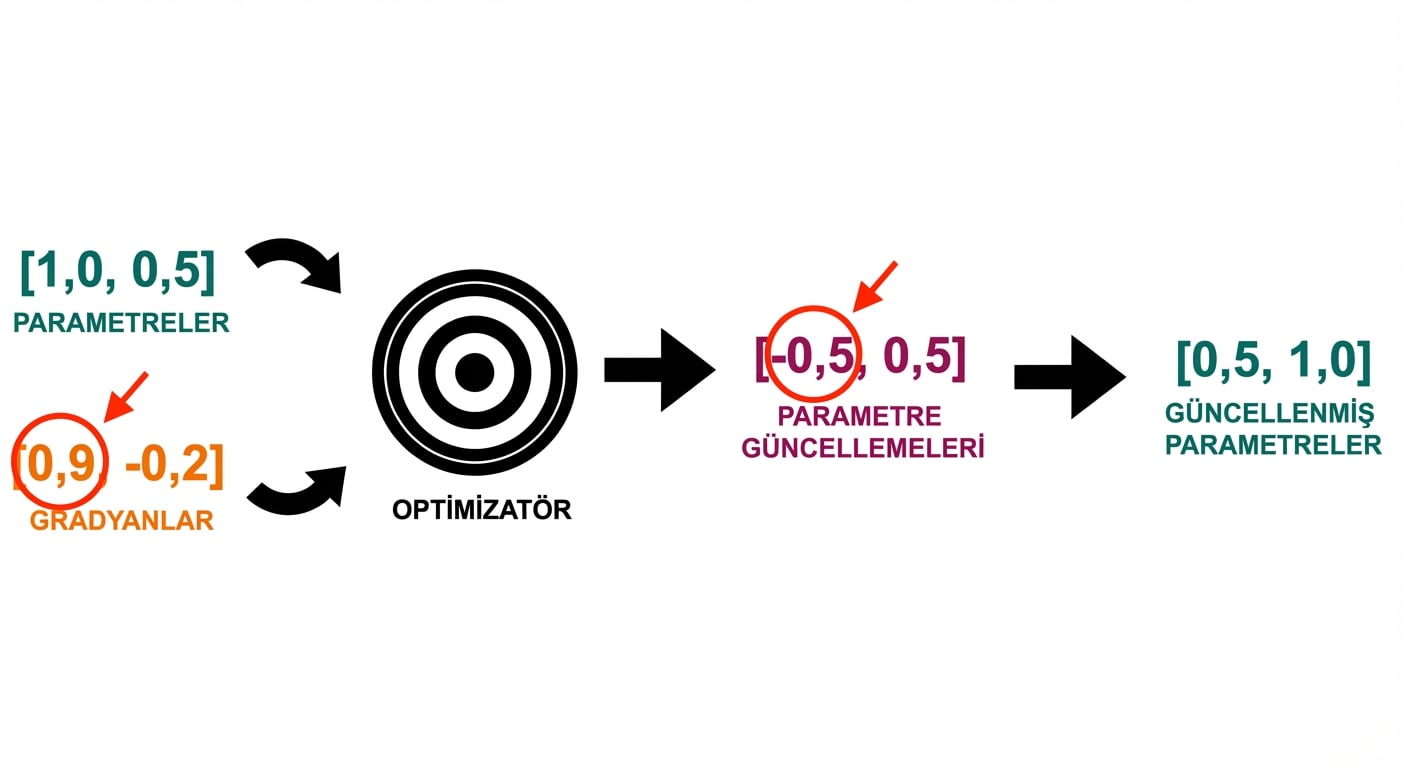

Bir eniyileyici nasıl çalışır

Bir eniyileyici nasıl çalışır

Bir eniyileyici nasıl çalışır

Bir eniyileyici nasıl çalışır

Bir eniyileyici nasıl çalışır

Stokastik Gradyan İnişi (SGD)

optimizer = optim.SGD(net.parameters(), lr=0.01)

- Güncelleme, öğrenme hızına bağlıdır

- Basit ve verimli; temel modeller için

- Uygulamada nadiren kullanılır

Uyarlamalı Gradyan (Adagrad)

optimizer = optim.Adagrad(net.parameters(), lr=0.01)

- Her parametre için öğrenme hızını uyarlar

- Seyrek veriler için iyi

- Öğrenme hızını çok hızlı düşürebilir

Kök Ortalama Kare Yayılımı (RMSprop)

optimizer = optim.RMSprop(net.parameters(), lr=0.01)

- Her parametre için güncelleme, önceki gradyanlarının büyüklüğüne göre yapılır

Uyarlamalı Moment Tahmini (Adam)

optimizer = optim.Adam(net.parameters(), lr=0.01)

- Muhtemelen en esnek ve en yaygın kullanılan

- RMSprop + gradyan momentumu

- Çoğunlukla varsayılan tercih

Model değerlendirme

from torchmetrics import Accuracy acc = Accuracy(task="binary")net.eval() with torch.no_grad(): for features, labels in dataloader_test:outputs = net(features)preds = (outputs >= 0.5).float()acc(preds, labels.view(-1, 1))accuracy = acc.compute() print(f"Accuracy: {accuracy}")

Accuracy: 0.6759443283081055

- Doğruluk metriğini kur

- Modeli değerlendirme kipine al; test yığınlarını gradyansız dolaş

- Veriyi modele verip olasılıkları al

- Tahmin etiketlerini hesapla

- Doğruluk metriğini güncelle

Hadi pratik yapalım!

PyTorch ile Orta Düzey Deep Learning